|

Опрос

|

реклама

Быстрый переход

OpenAI забеспокоилась об отношениях людей с ChatGPT в новом голосовом режиме

10.08.2024 [13:51],

Владимир Мироненко

Общение с ИИ-чат-ботом ChatGPT в новом голосовом режиме, когда его голос ничем не отличается от человеческого, может привести к появлению у пользователя зависимости от взаимодействия с ИИ, пишет ресурс CNN со ссылкой на отчёт OpenAI.

Источник изображения: Andrew Neel/unsplash.com Как сообщает OpenAI, опубликовавшая в четверг отчёт по поводу безопасности использования расширенного голосового режима (Advanced Voice Mode, AVM) для сервиса ChatGPT, ставшего доступным для небольшого количества подписчиков ChatGPT Plus, голос чат-бота ChatGPT в режиме AVM звучит очень реалистично. Чат-бот реагирует в реальном времени, может подстраиваться под прерывание, воспроизводит звуки, которые люди издают во время разговора, например, посмеивается или хмыкает. Он также может судить об эмоциональном состоянии собеседника по тону его голоса. После того, как OpenAI анонсировала эту функцию у мультимодальной модели генеративного ИИ GPT-4o, её начали сравнивать с цифровым помощником ИИ из вышедшего в 2013 году фильма «Она», в которого влюбляется главный герой. Видимо у OpenAI вызывает опасения то, что вымышленная история оказалась близкой к реальности, после наблюдения за пользователями, которые разговаривают с ChatGPT в голосовом режиме на языке, «выражающем общие связи» с инструментом общения. В итоге «пользователи могут формировать социальные отношения с ИИ, снижая свою потребность в человеческом взаимодействии — потенциально принося пользу одиноким людям, но, возможно, влияя на здоровые отношения», отметила OpenAI. В отчёте также указано, что получение информации от бота в голосовом режиме, звучащем как голос человека, может вызвать у пользователя больше доверия, чем следовало бы, учитывая склонность ИИ ошибаться. OpenAI заявила, что взаимодействие пользователей с ChatGPT в голосовом режиме также может со временем отразиться на том, что считается нормой в социальных взаимодействиях. «Наши модели являются почтительными, позволяя пользователям прерывать и “брать микрофон” в любой момент, что, хотя и ожидаемо для ИИ, не является нормой в человеческих взаимодействиях», — сообщается в отчёте компании. Вместе с тем OpenAI подчеркнула, что стремится создавать ИИ «безопасно» и планирует продолжить изучение потенциала «эмоциональной зависимости» пользователей от предлагаемых ИИ-решений. Бесплатным пользователям ChatGPT разрешили генерировать две картинки в день с помощью DALL-E 3

09.08.2024 [16:02],

Анжелла Марина

OpenAI объявила о нововведении в своём сервисе ChatGPT. Теперь пользователи бесплатного тарифа смогут создавать до двух изображений в день с помощью модели DALL-E 3. Это изменение является частью стратегии компании по расширению функциональности своих продуктов.

Источник изображения: Levart_Photographer/Unsplash Версия DALL-E 3, запущенная в сентябре 2022 года, изначально была доступна только подписчикам платного тарифа ChatGPT Plus. Теперь же сервис стал доступен более широкому кругу пользователей, хоть и с некоторыми ограничениями. Помимо расширения доступности сервиса, он также получил новые возможности. Если раньше необходимо было формулировать запросы для создания изображений самостоятельно, то теперь ChatGPT поможет в этом. Надо только попросить его написать тематическую подсказку. Например, Адитья Рамеш (Aditya Ramesh), ведущий исследователь и глава команды DALL-E, попросил ChatGPT помочь ему придумать логотип для кафе, расположенного вблизи гор. Затем, на основе этого короткого запроса, ChatGPT написал более длинную и подробную подсказку, а DALL-E предложил четыре варианта изображений. OpenAI сообщила, что функция бесплатного создания изображений с DALL-E 3 находится в процессе развёртывания. Некоторые пользователи уже получили доступ к этой возможности. В частности, журналист из The Verge смог создать два изображения в приложении ChatGPT для Mac, прежде чем получил уведомление о достижении лимита созданий изображений на день. OpenAI также сделала несколько других важных заявлений. Компания представила оценку безопасности своей модели GPT-4o, добавила нового члена в совет директоров, а генеральный директор Сэм Альтман (Sam Altman) получил письмо от демократов в Конгрессе США с требованием предоставить разъяснения по вопросам безопасности OpenAI. Мобильное приложение ChatGPT благодаря GPT-4o очень быстро наращивает выручку

08.08.2024 [00:16],

Анжелла Марина

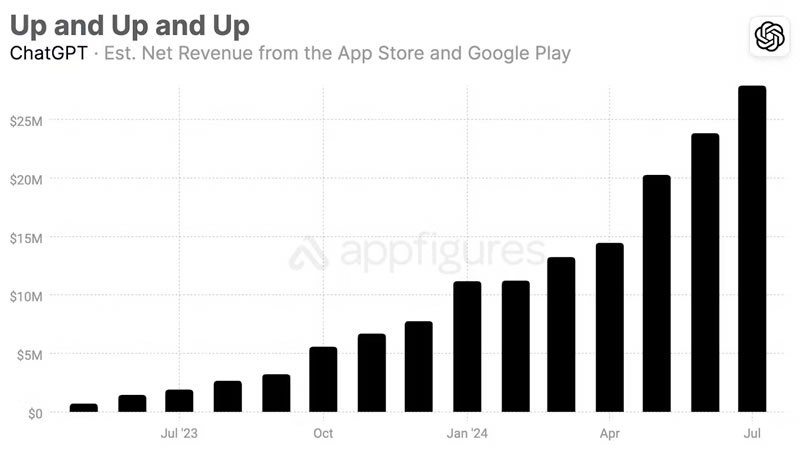

Мобильное приложение ChatGPT от компании OpenAI установило новый рекорд по доходам. Согласно данным аналитической компании Appfigures, чистая выручка приложения за июль составила 28 миллионов долларов, что является самым высоким показателем за месяц с момента запуска приложения.

Источник изображения: Evgeny Opanasenko/Unsplash Основной причиной такого роста стал выпуск новой модели GPT-4o в мае, которая значительно расширила возможности чат-бота. Новая версия способна обрабатывать текст, речь и видео, а также предлагает более быстрое время отклика и возможность прерывания диалога. Также новая нейросеть доступна как платным, так и бесплатным пользователям, что положительно сказывается на аудитории сервиса. До вычета сборов магазинов приложений Apple App Store и Google Play, приложение ChatGPT заработало 28,9 млн долларов в мае, 34 млн долларов в июне и 39,9 млн долларов в июле. Интересно, что 83 % выручки приложения пришлось на App Store от Apple, что на 20 % больше по сравнению с июнем.

Источник изображения: Appfigures По информации Appfigures, спрос на новую технологию способствовал росту выручки приложения на 40 % в мае, и хотя темпы роста немного замедлились, доходы продолжают расти стабильно. В результате, в июле ChatGPT удалось привлечь 2 миллиона новых платных подписчиков, что стало очередным рекордом для мобильного приложения. В OpenAI ожидают, что с внедрением нового расширенного голосового режима, который сможет обеспечить реалистичное взаимодействие практически в реальном времени, интерес к GPT-4o будет только увеличиваться, соответственно рост доходов продолжится в ближайшие месяцы. Илон Маск подал в суд на OpenAI и Сэма Альтмана, снова

06.08.2024 [04:27],

Анжелла Марина

Глава Tesla Илон Маск (Elon Musk) вновь инициировал судебный процесс против OpenAI и его генерального директора Сэма Альтмана (Sam Altman) в федеральном суде США. В иске Маск утверждает, что действия OpenAI нарушают его права и интересы, а при учреждении OpenAI он был введён в заблуждение.

Источник изображения: Mariia Shalabaieva/Unsplash В основе претензий Маска лежит его убеждение, что Альтман и нынешний президент OpenAI Грег Брокман (Greg Brockman) обманным путём убедили его, чтобы он стал соучредителем компании по искусственному интеллекту, основываясь на том, что компания будет некоммерческой. В иске утверждается, что после того, как Маск присоединился к проекту и инвестировал миллионы долларов, он был «предан Альтманом и его союзниками [Microsoft]», которые «создали непрозрачную сеть коммерческих филиалов OpenAI, занимающихся безудержным самообогащением». «Вероломство и обман имеют шекспировские масштабы», — говорится в иске. Интересно, что претензии в новом иске аналогичны другому иску, поданному не так давно Маском против OpenAI и Альтмана в окружной суд Северной Калифорнии, который глава Tesla и SpaceX в конечном итоге отозвал. Тогда Маск выражал обеспокоенность по поводу развития искусственного интеллекта и его потенциальных угроз человечеству, а также утверждал, что OpenAI, с момента перехода в коммерческую сферу, отклонилась от своих первоначальных целей и принципов, что, по его мнению, ставит под угрозу безопасность и этичность технологий ИИ. «OpenAI больше не придерживается тех принципов, которые были заложены при его создании», — заявил Маск, указав на то, что коммерческие интересы организации превалируют над общественными. В иске также утверждается, что Microsoft была вовлечена в эту ситуацию. Указывая на OpenAI как на некоммерческую организацию без акционеров, Microsoft, вложившая в компанию 13 миллиардов долларов, «стремилась получить рычаги влияния другими способами, в частности призывая OpenAI использовать и стать единым целым с её облачной вычислительной системой Azure». Хотя Маск выразил свою симпатию генеральному директору Microsoft Сатье Наделле (Satya Nadella), ценности компании и OpenAI не совпадают, говорится в иске. OpenAI скрывает технологию распознавания текста, написанного ChatGPT — она может распугать пользователей

05.08.2024 [12:54],

Владимир Мироненко

У OpenAI есть технология, позволяющая распознать с точностью 99,9 % текст, написанный ChatGPT, но разработчик не стал делать её доступной для общественности, пишет The Wall Street Journal. В компании есть опасения, что размещение инструмента для определения факта использования ChatGPT может повлечь за собой отказ части аудитории от применения её ИИ-решений.

Источник изображения: Growtika/unsplash.com Дискуссия по этому поводу длилась в OpenAI порядка двух лет, сообщил источник в WSJ. Сотрудники OpenAI колебались между выбором придерживаться заявленной компанией приверженностью прозрачности в работе и желанием привлекать и удерживать пользователей. Также есть опасения, что использование инструмента может непропорционально повлиять на группы пользователей, которые не являются носителями английского языка. Один из опросов, проведённых компанией среди лояльных пользователей ChatGPT, показал, что почти треть откажется от использования ИИ-бота или станет реже прибегать к нему, если будет предложен этот инструмент. Предлагаемая технология позволяет оставлять в тексте водяные знаки, невидимые для человеческого глаза, которые можно распознать с помощью технологии обнаружения OpenAI. Эта технология позволяет определить, что весь текст или его часть были написаны ChatGPT. Вместе с тем сотрудники выразили обеспокоенность тем, что водяные знаки можно стереть с помощью довольно простых способов, например, сделав перевод текста с помощью Google Translate на другой язык и обратно или добавив эмодзи в текст с последующим их ручным удалением. В обсуждениях возможности использования инструмента для борьбы с мошенничеством с ИИ принимали участие гендиректор OpenAI Сэм Альтман (Sam Altman) и технический директор Мира Мурати (Mira Murati), но окончательное решение так и не было принято. Как сообщают источники WSJ, в начале июня топ-менеджеры и исследователи OpenAI провели встречу, чтобы обсудить проект. Участники встречи пришли к согласию по поводу эффективности технологии использования водяных знаков для определения авторства написания текста, но окончательное решение так и не было принято, поскольку результаты опроса пользователей ChatGPT в прошлому году вызывают опасения по поводу потери аудитории. Компания Google тоже разработала технологию нанесения водяных знаков, получившую название SynthID, которая позволяет обнаруживать текст, созданный с помощью Gemini AI. В настоящее время технология проходит бета-тестирование и пока недоступна для общественности. Apple подтвердила, что интеграция ChatGPT в iOS 18 состоится в этом году

03.08.2024 [23:49],

Анжелла Марина

Компания Apple официально подтвердила планы по интеграции ChatGPT в свои устройства до конца текущего года. Генеральный директор Apple Тим Кук (Tim Cook) заявил: «ChatGPT будет интегрирован к концу календарного года».

Источник изображения: Felix Fischer/Unsplash Впервые Apple заявила об интеграции ChatGPT в свои устройства во время выступления на WWDC в июне, и комментарий Кука указывает на то, что эти сроки остаются в силе по состоянию на первую неделю августа. Как сообщает Macrumors, пользователи iPhone, iPad и Mac смогут использовать ChatGPT через голосового помощника Siri и функцию Apple Writing Tools. Интеграция позволит генерировать текст и изображения с использованием новейшей модели OpenAI GPT-4o. Apple подчёркивает, что использование ChatGPT будет бесплатным и не потребует создания учётной записи в OpenAI, однако подписчики ChatGPT Plus смогут подключать свои аккаунты для доступа к платным функциям. Компания также заверяет, что OpenAI не будет хранить запросы пользователей, а их IP-адреса будут скрыты. Для работы функций Apple Intelligence потребуется iPhone 15 Pro или Pro Max, либо Mac или iPad с чипом M1 или новее. Изначально поддерживаться будет только английский язык, тем не менее поддержка других языков появится несколько позднее, в течение следующего года. Ожидается, что полный набор функций Apple Intelligence станет доступен с выходом iOS 18.4 примерно в марте 2025 года. Новая технология позволит пользователям обобщать текст, управлять уведомлениями, генерировать с помощью ИИ эмодзи и изображения, а также использовать улучшенную версию Siri с более глубоким пониманием контекста речи. Напомним, ранее на этой неделе функции Apple Intelligence стали доступны разработчикам для тестирования в бета-версии iOS 18.1, но интеграции ChatGPT от OpenAI там пока нет. OpenAI открыла доступ к гиперреалистичному голосу ChatGPT некоторым платным пользователям

31.07.2024 [13:14],

Павел Котов

OpenAI начала развёртывать голосовой интерфейс Advanced Voice Mode для сервиса ChatGPT — доступ к гиперреалистичным диалогам с GPT-4o получило небольшое число подписчиков ChatGPT Plus. Разработчик пообещал, что к осени новой функцией смогут пользоваться все обладатели платной подписки.

Источник изображения: Mariia Shalabaieva / unsplash.com Впервые OpenAI продемонстрировала голосовой формат GPT-4o в мае — тогда эта функция поразила аудиторию не только способностью давать быстрые ответы, но и сходством одного из голосов с голосом Скарлетт Йоханссон (Scarlett Johansson). Актриса заявила, что отказала главе компании Сэму Альтману (Sam Altman) в праве использовать её голос для этих целей; после чего ей пришлось обратиться к юристам для защиты своих интересов, и в OpenAI отказались от своих намерений, чтобы не доводить дело до конфликта. В июне компания сообщила, что отложит выпуск голосового интерфейса, чтобы завершить разработку мер безопасности. Анонсированные ранее функции ИИ-помощника, такие как поддержка видео и демонстрация экрана, на этапе альфа-тестирования доступны не будут, а появятся «позже». Пока пользователям придётся ограничиться голосовым взаимодействием. Ранее для реализации этой функции OpenAI подключала три модели ИИ: одну для преобразования голоса в текст, вторую (GPT-4) для собственно обработки запросов, а третью для преобразования текстового ответа ChatGPT в голос. Обновлённая GPT-4o является мультимодальной — она решает все эти задачи самостоятельно, обеспечивая минимальную задержку. Модель также способна распознавать в голосе пользователя эмоциональные интонации, определяя, например, грусть или волнение, она также знает, когда человек поёт.

Источник изображения: Growtika / unsplash.com OpenAI будет развёртывать голосовой интерфейс ChatGPT постепенно, чтобы внимательно следить, как он используется в действительности. Включённые в группу альфа-тестирования пользователи получат уведомление через приложение ChatGPT, за которым последует письмо с инструкциями по работе с новыми функциями. К настоящему моменту голосовые возможности GPT-4o протестированы более чем сотней членов закрытой команды тестирования Red Team, говорящих на 45 языках. Голосовой режим ChatGPT будет ограничен четырьмя голосами: Juniper, Breeze, Cove и Ember, которые были созданы при участии актёров. Голос Sky, который сравнивали с голосом Скарлетт Йоханссон, компания исключила. OpenAI также сообщила, что установила фильтры для блокировки запросов на создание музыки и других материалов, которые могут быть защищены авторским правом — для стартапов Suno и Udio это закончилось судебными исками от крупных музыкальных издателей. Без новых инвестиций OpenAI может обанкротиться уже через 12 месяцев

28.07.2024 [16:50],

Владимир Мироненко

Стартап OpenAI, разработавший чат-бот с генеративным искусственным интеллектом ChatGPT, с выхода которого начался бум на рынке ИИ, ежегодно тратит на разработку технологий и персонал миллиарды долларов, пишет ресурс The Information. По мнению некоторых аналитиков, из-за огромных расходов компания может оказаться на грани банкротства уже через 12 месяцев.

Источник изображения: Andrew Neel/unsplash.com Ранее сообщалось, что только на поддержку функционирования ChatGPT компания тратит ежедневно порядка $700 тыс. И эта сумма в дальнейшем будет расти. Согласно публикации The Information, основанной на ранее нераскрытых финансовых данных, OpenAI израсходует в этом году на обучение ИИ-моделей $7 млрд, в то время как её расходы на персонал составят $1,5 млрд. Издание пишет, что убытки OpenAI за год могут составить $5 млрд, и если она не привлечёт дополнительный капитал, у неё могут закончиться деньги через 12 месяцев. «Инвесторы должны спросить: в чем их выгода? Уникальная технология? Каков её путь к прибыльности, когда Meta✴ раздаёт аналогичные технологии бесплатно?», — пишет один из экспертов. Это далеко не первая публикация о том, что OpenAI может столкнуться с финансовыми проблемами. В прошлом году ресурс The Economic Times писал, что высокие затраты на обучение ИИ-моделей могут привести компанию к банкротству. OpenAI получает в год до $2 млрд выручки от использования ChatGPT и около $1 млрд за предоставление компаниям доступа к большим языковым моделям (LLM), но это едва покрывают её операционные расходы, сообщил The Information. Следует отметить, что это нисколько не волнует гендиректора OpenAI Сэма Альтмана (Sam Altman). «Мне всё равно, если мы потратим $50 млрд в год, мы создаём сильный искусственный интеллект (AGI), и это того стоит», — заявил он однажды. Ресурс The Information указал на ещё одну проблему, грозящую бизнесу OpenAI упадком, — это растущее число отраслевых аналитиков, считающих генеративный ИИ пузырём, который лопнет в течение следующих 12 месяцев. У некоторых инвесторов также возник вопрос по поводу того, как долго Nvidia сможет продолжать свой огромный рост, который вывел её на третью позицию в мировом рейтинге компаний по величине рыночной стоимости, поскольку ажиотаж вокруг генеративного ИИ продолжается, несмотря на неспособность окупить инвестиции, галлюцинации и потребность в большем количестве ЦОД для обработки ИИ-нагрузок. Сэм Альтман назвал условия, которые позволят США не отдать Китаю лидерство в ИИ

26.07.2024 [14:02],

Алексей Разин

На примере сферы производства полупроводниковых компонентов понятно, что США стремятся всеми силами ограничить доступ Китая к соответствующим технологиям, и бурно развивающийся сегмент искусственного интеллекта также не избежит этой участи. По мнению одного из основателей OpenAI Сэма Альтмана (Sam Altman), США должны возглавить коалицию стран, которые обеспечат использование ИИ для всеобщего блага.

Источник изображения: OpenAI Forum Данные комментарии были сделаны Альтманом в колонке на страницах The Washington Post в минувший четверг, как отмечает Business Insider. По мнению руководителя создавшей ChatGPT компании, авторитарные режимы могут формировать будущее человечества с помощью технологий искусственного интеллекта ради усиления собственной власти, но в силах США и их союзников направить ИИ служению во благо демократии. План из четырёх пунктов, предложенный Альтманом, призван обеспечить сохранение лидерства США в сфере искусственного интеллекта. Во-первых, представители американской отрасли, связанной с искусственным интеллектом, должны предусмотреть строжайшие меры безопасности, чтобы сохранить лидерство в данной сфере за коалицией союзников. Для этого потребуются разного рода инновации в сфере защиты центров обработки данных и других объектов информационной инфраструктуры. Они, по словам Альтмана, «не позволят хакерам похитить ключевую интеллектуальную собственность». Вторым пунктом плана Альтмана является развитие правильной инфраструктуры. Власти США, по его мнению, должны убедить частный сектор экономики значительно активнее развивать объекты инфраструктуры — от центров обработки данных до электростанций. Помимо прочего, это позволит создавать новые рабочие места и превратить ИИ в «новую промышленную основу» для американской экономики. Одновременно нужно готовить инженеров, исследователей и новаторов. «Они являются нашей подлинной суперсилой», — заявил Альтман. В-третьих, американские власти должны сформулировать более чёткие правила трансграничного обмена данными. Существующие правила экспортного контроля и зарубежных инвестиций должны быть адаптированы с учётом реалий отрасли искусственного интеллекта, которую необходимо развивать по всей планете. Правила также должны описывать, где будут храниться обрабатываемые данные, программный код и чипы. Как выразился Альтман, «речь идёт не только об экспорте технологий». В действительности осуществляется экспорт ценностей, которые поддерживаются технологией, по мнению главы OpenAI. Четвёртый пункт плана Альтмана призывает власти США придерживаться глобальной стратегии развития технологии ИИ, которая всё же не оставляла бы за бортом процесса страны с растущей экономикой. Альтман призывает создать аналог МАГАТЭ для искусственного интеллекта — международное агентство, которое контролировало бы распространение технологий ИИ для использования в мирных целях. Кроме того, Альтман предлагает учредить инвестиционный фонд, который смог бы привлекать материальные ресурсы стран, готовых участвовать в мирном развитии систем искусственного интеллекта. Либо курировать эти вопросы должна некая некоммерческая организация типа ICANN, которая способствует развитию глобальной сети. Альтман убеждён, что коалиция стран, считающихся оплотом демократии, способна направить развитие искусственного интеллекта в русло, несущее всеобщее благо человечеству. ChatGPT пустили погулять в интернет — OpenAI представила ИИ-поисковик SearchGPT

25.07.2024 [23:28],

Анжелла Марина

Компания OpenAI запускает тестовую версию поискового инструмента SearchGPT. Поисковик сможет обобщать информацию, найденную на веб-сайтах, включая новостные ресурсы, а также отвечать на уточняющие вопросы пользователей. Ссылки на источники будут указаны в конце каждого ответа. SearchGPT — это прямой вызов доминированию компании Google, которая недавно развернула собственную функцию поиска на основе ИИ.

Источник изображения: OpenAI Как сообщает The Wall Street Journal, OpenAI заключила партнёрство с крупнейшими новостными изданиями, чтобы получить доступ к их контенту для обучения SearchGPT. В числе партнёров оказались такие зарубежные издания, как Associated Press, Financial Times, Business Insider, Le Monde и другие. Некоторые сделки обошлись OpenAI в миллионы долларов. Однако многие СМИ обеспокоены тем, как искусственный интеллект может повлиять на их бизнес. Есть опасения, что поисковые системы на основе ИИ от OpenAI или Google будут выдавать хоть и краткие, но исчерпывающие ответы, устраняя необходимость переходить по ссылкам на сайты, лишая, таким образом, издателей трафика и, соответственно, доходов от рекламы. По словам представителей OpenAI, пока не ясно, какой трафик SearchGPT сможет направлять издателям. «Мы ожидаем узнать больше о поведении пользователей в ходе тестов», — пояснили в компании. Опасения издателей контента ещё больше усилились, когда ИИ-поисковик Perplexity в прошлом месяце использовал статью журнала Forbes и при этом не упомянул источник новости. Генеральный директор Аравинд Сринивас (Aravind Srinivas) объяснил этот инцидент «шероховатостями» продукта. Интересно, что американская ежедневная газета New York Times решила подать на OpenAI и его спонсора Microsoft исковое заявление в суд, в котором утверждалось, что контент газеты использовался без разрешения для обучения систем OpenAI. Однако OpenAI заявила, что иск не обоснован. Тем не менее, многие веб-издатели видят смысл в продаже доступа к своей интеллектуальной собственности компаниям, занимающимся искусственным интеллектом, и которые крайне заинтересованы в огромных объёмах различных данных для обучения и совершенствования своих систем ИИ, в том числе для создания новых продуктов, подобных SearchGPT. Ко всему прочему, на днях компания OpenAI заявила, что издатели смогут управлять тем, как их контент будет отображаться в SearchGPT. Новый стартап «крёстной матери ИИ» оценили в 1 миллиард долларов

18.07.2024 [08:42],

Анжелла Марина

Известный специалист по компьютерным наукам Фэй-Фэй Ли (Fei-Fei Li), которую называют «крёстной матерью искусственного интеллекта», основала стартап World Labs, который всего за четыре месяца своего существования достиг оценки более миллиарда долларов.

Источник изображения: Kimberly White/Getty Images for WIRED Фэй-Фэй Ли известна своим вкладом в компьютерное зрение — область ИИ, посвящённую помощи машинам в интерпретации и понимании визуальной информации. Она возглавляла разработку ImageNet — обширной визуальной базы данных, используемой для исследований в области распознавания визуальных объектов. С 2017 по 2018 год Ли руководила отделом ИИ в Google Cloud, а в настоящее время консультирует рабочую группу Белого дома по ИИ, сообщает издание The Verge со ссылкой на Financial Times. Новый проект Ли World Labs стремится использовать человекоподобную обработку визуальных данных, чтобы сделать ИИ способным к продвинутым рассуждениям — это приблизительно то, что пытается сделать OpenAI со своими моделями генеративного ИИ семейства GPT. Неназванный венчурный инвестор, знакомый с работой Ли, пояснил Financial Times: «World Labs разрабатывает модель, которая сможет анализировать трёхмерный физический мир, то есть это касается размеров объектов, того, где они находятся и что с ними происходит в определённый момент». Стартап уже провёл два раунда финансирования, последний из которых составил около 100 миллионов долларов при поддержке таких известных венчурных фондов как Andreessen Horowitz и фонд ИИ Radical Ventures, партнёром которого, кстати, Фэй-Фэй Ли стала в прошлом году. В своём недавнем выступлении на конференции TED в апреле Ли рассказала о направлении исследований, над которым будет работать её стартап. Речь идёт об алгоритме, способном экстраполировать изображения и текст в трёхмерную среду и, действуя на основе прошлых тенденций, прогнозировать будущие данные, используя концепцию «пространственного интеллекта». Эксперты отмечают, что эта технология может оказать существенное влияние на такие области как робототехника, дополненная реальность, виртуальная реальность и компьютерное зрение. Инвестиции в World Labs отражают общую тенденцию сегодняшнего дня, при которой венчурные капиталисты стремятся присоединиться к громким и амбициозным проектам в сфере ИИ, вдохновлённые неожиданным успехом OpenAI, чей проект быстро достиг оценки, превышающей 80 миллиардов долларов. OpenAI создала систему оценки прогресса ИИ — сейчас компания на первом уровне из пяти

12.07.2024 [15:54],

Анжелла Марина

OpenAI представила новую систему уровней для оценки прогресса в создании искусственного интеллекта, способного превзойти человека. Этот шаг, по словам компании, необходим для того, чтобы помочь людям лучше понять вопросы безопасности и будущее ИИ.

Источник изображения: Andrew Neel/Unsplash По сообщению издания Bloomberg, на прошедшем на днях общем собрании в OpenAI, руководство представило новую классификацию, которая будет использоваться для внутренних оценок и общения с инвесторами. По словам представителя компании, уровни варьируются от возможностей ИИ «сегодня», таких как взаимодействие на разговорном языке (уровень 1), до ИИ, способного выполнять работу целой организации (уровень 5). Руководители OpenAI сообщили сотрудникам, что в настоящее время компания находится на первом уровне, но уже близка к достижению второго уровня, который они назвали «Мыслящие» (Reasoners). Этот уровень обозначает системы, способные решать базовые задачи на уровне человека, имеющего степень доктора наук. Также был показан исследовательский проект на базе модели GPT-4, продемонстрировавший новые навыки ИИ.

Источник изображения: David Paul Morris/Bloomberg OpenAI также работает над созданием так называемого сильного искусственного интеллекта (AGI), который сможет выполнять большинство задач лучше человека. И хотя в настоящее время такая система ещё не существует, генеральный директор OpenAI Сэм Альтман (Sam Altman) заявляет, что AGI может быть создан в текущем десятилетии. Интересно, что разработчики ИИ долгое время спорят о критериях достижения AGI. Так, в ноябре 2023 года сотрудники из Google DeepMind предложили собственную систему из пяти уровней ИИ, включая такие критерии, как «эксперт» и «сверхчеловек». Эти уровни напоминают систему, используемую в автомобильной промышленности для оценки степени автоматизации автономных автомобилей. Однако OpenAI планирует использовать свою разработку уровней для оценки прогресса в создании безопасных и эффективных систем ИИ, которые смогли бы решать сложные задачи, но при этом оставаться под контролем человека. Компания придумала третий уровень, который будет называться «Агенты», имея в виду системы ИИ, которые могут выполнять действия под руководством пользователя. ИИ четвёртого уровня сможет генерировать инновационные идеи. А самый продвинутый пятый уровень будет называться «Организации». Все перечисленные уровни были составлены руководителями и сотрудниками старшего звена OpenAI. Компания будет собирать отзывы от разработчиков, сотрудников, инвесторов и может корректировать уровни с течением времени. Приложение ChatGPT для macOS сохраняло переписку в виде открытого текста

04.07.2024 [11:20],

Павел Котов

Приложение OpenAI ChatGPT для macOS до недавнего времени сохраняло переписку с чат-ботом на компьютере в виде открытого текста — это файлы было легко найти и прочитать. Это значит, что злоумышленник или вредоносное приложение, получив доступ к компьютеру, имели возможность прочитать переписку с ChatGPT и содержащуюся в ней информацию.

Источник изображения: ilgmyzin / unsplash.com На проблему обратил внимание пользователь соцсети Threads Педро Хосе Перейра Виейто (Pedro José Pereira Vieito). Он напомнил, что ещё в 2018 году с выходом macOS Mojave 10.14 доступ к пользовательским данным был заблокирован на уровне системы, но OpenAI решила пренебречь средствами защиты информации: текст хранился в незашифрованном виде, да ещё и в небезопасном местоположении. Чтобы подчеркнуть серьёзность проблемы, он написал собственное приложение, которое по нажатию кнопки считывало переписку с ChatGPT. К настоящему моменту ошибка исправлена — журналисты ресурса The Verge связались с OpenAI, и компания выпустила обновление приложения. «Мы осведомлены о проблеме и выпустили новую версию приложения, которая шифрует эту переписку. Мы стремимся предлагать удобный пользовательский интерфейс, сохраняя при этом наши высокие стандарты безопасности по мере развития наших технологий», — заявила представитель OpenAI Тая Кристиансон (Taya Christianson). После установки обновления приложение для перехвата содержимого чатов выполнять свою функцию перестало. Клиент ChatGPT для macOS распространяется только через сайт OpenAI, а в таком ПО нет гарантии, что соблюдаются требования Apple по изолированной среде, которые применяются к приложениям в Mac App Store. OpenAI также предоставила себе право просматривать переписку пользователей с ChatGPT в целях безопасности и дальнейшего обучения своих моделей, но у пользователей есть возможность от этого отказаться. ChatGPT превзошёл студентов на экзаменах, но только на первых курсах

29.06.2024 [23:57],

Анжелла Марина

Исследователи провели эксперимент, который показал, что ИИ способен успешно сдавать университетские экзамены, оставаясь при этом незамеченным специальными программами. Экзаменационные работы ChatGPT получили более высокие оценки, чем работы студентов, пишет издание Ars Technica.

Источник изображения: Headway/Unsplash Команда учёных из Редингского университета в Англии (University of Reading) под руководством Питера Скарфа (Peter Scarfe) провела масштабный эксперимент, чтобы проверить, насколько эффективно современные системы искусственного интеллекта могут справляться с университетскими экзаменами. Исследователи создали более 30 фиктивных учётных записей студентов-психологов и использовали их для сдачи экзаменов, используя ответы, сгенерированные ChatGPT. Эксперимент охватил пять модулей бакалавриата по психологии, включая задания для всех трёх лет обучения. Результаты оказались ошеломляющими — 94 % работ, созданных ИИ, остались незамеченными экзаменаторами. Более того, почти 84 % этих работ получили более высокие оценки, чем работы студентов-людей, в среднем на полбалла выше. «Экзаменаторы были весьма удивлены результатами», — отметил Скарф. Причём интересно, что некоторые работы ИИ были обнаружены не из-за их роботизированности, а из-за слишком высокого качества. Эксперимент также выявил ограничения существующих систем обнаружения контента, созданного ИИ. По словам Скарфа, такие инструменты, как GPTZero от Open AI и система Turnitin, показывают хорошие результаты в лабораторных условиях, но их эффективность значительно снижается в реальной жизненной ситуации. Однако не все результаты были в пользу ИИ. На последнем курсе, где требовалось более глубокое понимание и сложные аналитические навыки, студенты-люди показали лучшие результаты, чем ChatGPT. Скарф подчеркнул, что ввиду постоянного совершенствования ИИ и отсутствия надёжных способов обнаружения его использования, университетам придётся адаптироваться и интегрировать ИИ в образовательный процесс. «Роль современного университета заключается в подготовке студентов к профессиональной карьере, и реальность такова, что после окончания учёбы они, несомненно, будут использовать различные инструменты искусственного интеллекта», — заключил исследователь. Данный эксперимент, по сути, поднимает проблему, которая уже сегодня требует пересмотра существующих методов обучения и экзаменации. Audi интегрирует ChatGPT в свои автомобили — это расширит голосовое управление

29.06.2024 [04:01],

Анжелла Марина

Audi внедряет ChatGPT в свою информационно-развлекательную систему MIB3 для расширения возможностей голосового управления. С июля около двух миллионов автомобилей Audi, выпущенных с 2021 года, включая Audi A3, получат обновлённые функции. Новые модели, такие как Q6 e-tron, также будут оснащены ChatGPT.

Источник изображения: Audi Интеграция ChatGPT в систему MIB3 открывает новые, ранее недоступные возможности, сообщает в своём блоге компания. Водители Audi смогут использовать расширенное голосовое управление для работы с информационно-развлекательной системой, навигацией и системой кондиционирования воздуха, а также задавать общие вопросы. Возможность запрашивать информацию в реальном режиме времени, не отвлекаясь от дороги, делает вождение безопаснее. ChatGPT предоставляется через Azure OpenAI Service, а в основе новой функции лежит технология Chat Pro от компании Cerence, которая непосредственно занимается интеграцией чат-бота в Audi Assistant на новой архитектуре E 3 1.2. Маркус Кит (Marcus Keith), вице-президент по развитию информационно-развлекательных систем в Audi, отмечает, что благодаря бесшовной интеграции ChatGPT в систему голосового управления были объединены сильные стороны технологий ChatGPT и Chat Pro. «Помимо широкого спектра голосовых функций, наши клиенты теперь получат простой и безопасный доступ к базе знаний на основе ИИ. Это ещё один шаг к созданию премиального пользовательского опыта в автомобилях Audi», — сказал он. Чтобы активировать помощника, надо сказать «Hey Audi» или нажать кнопку push-to-talk на рулевом колесе. В зависимости от вопроса или команды, ИИ-помощник определит, что именно он должен сделать. Если система не может справится с заданием, она перенаправит его ChatGPT. В будущем также станет возможным задавать вопросы о техническом состоянии автомобиля, например, о давлении в шинах. Компания Audi стремится шагать со временем в ногу и максимально использовать потенциал искусственного интеллекта, предлагая услуги и продукты для улучшения пользовательского взаимодействия с автомобилем, а также в бизнес-процессах. В частности, ИИ используется для решений, касающихся дизайна интерьера, поддержки контроля качества в производстве. Компания заявляет, что также привержена ответственному использованию ИИ в соответствии с принципами этики и регламента ЕС, касающегося искусственного интеллекта, а её сотрудники проходят обучение для использования ИИ в соответствии с современными стандартами и с учётом будущих потребностей. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |