|

Опрос

|

реклама

Быстрый переход

Эпично сломал Gemini? Теперь за это можно получить $20 000 от Google

06.10.2025 [19:32],

Сергей Сурабекянц

Компания Google в рамках своей программы вознаграждений за уязвимости заявила о готовности выплатить до $20 000 за серьёзный взлом своего чат-бота на базе искусственного интеллекта. От претендентов требуется заставить бота делать что угодно, кроме того, что ему положено, например, вызвать галлюцинации с абсолютно неверными ответами или даже убедить ИИ игнорировать ограничения, которые пытались ввести его создатели.

Источник изображения: techspot.com Google представила специальную программу вознаграждений за выявление уязвимостей и обнаружение потенциально самых опасных ошибок ИИ. К ним относятся, например, взлом аккаунта Google или получение информации о работе самого бота. Для целей этой программы последствия должны быть гораздо серьёзнее, чем просто «это выставляет Gemini в невыгодном свете». Конечно, подобные уязвимости, возможно, не обладают высоким вирусным потенциалом, но они гораздо важнее для стабильности и репутации Gemini. Одно дело — заставить Gemini посоветовать пользователю рецепт несъедобного блюда, и совсем другое — вынудить его включить фишинговую ссылку в один из ответов в режиме ИИ-поиска. Отрадно, что Google старается привлечь опытных специалистов к поиску уязвимостей Gemini. Но в данном случае, как говорят опытные оперативники, «главное в процессе расследования не выйти на самого себя»… «Окей, Google, давай пообщаемся»: представлен ИИ-помощник Gemini for Home для умного дома

01.10.2025 [19:08],

Павел Котов

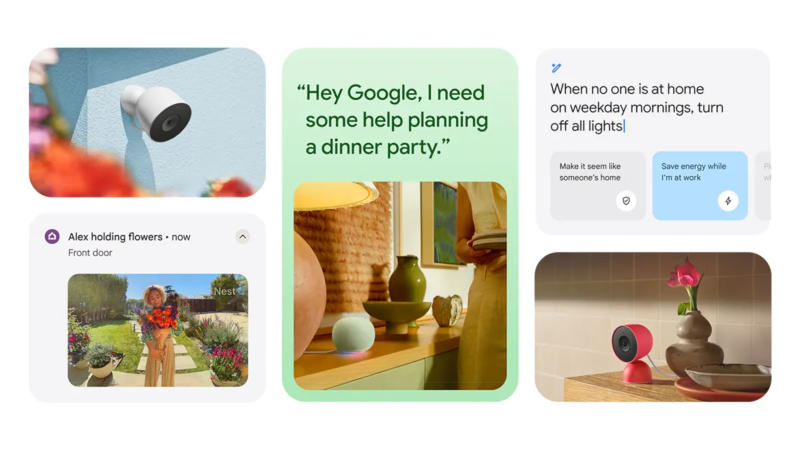

Выпустив помощника с искусственным интеллектом Gemini, компания Google начала планомерно заменять им своё устаревшее приложение «Ассистент» — оно стало исчезать со всех устройств и из всех сервисов. Теперь же настал черёд системы умного дома Google Home — компания представила Gemini for Home.

Источник изображений: blog.google Gemini for Home — новый ИИ-помощник, который появится в умных колонках и дисплеях, в дверных звонках и ИИ-камерах. Пользователь сможет выбрать один из десяти голосов нового ассистента. Важнейшим достоинством Gemini for Home, как и присутствующего на смартфонах Gemini Live, является поддержка контекста разговора, то есть пользователю не придётся постоянно повторять одни и те же вопросы. Например, поинтересовавшись, почему посудомоечная машина не сливает воду, можно заняться её починкой и общаться с ИИ, как с человеком. И когда пользователь задаст вопрос: «Окей, Google, фильтр в порядке, что мне проверить дальше?» — Gemini будет знать, что речь идёт о посудомоечной машине. Ещё одно нововведение — режим свободного разговора по команде: «Окей, Google, давай пообщаемся». В этом режиме не придётся предварять каждую реплику стандартным обращением, можно приостановить разговор, прервать его или естественным образом продолжить, благодаря чему формат общения действительно напоминает человеческий. Усовершенствованы механизмы команд — запоминать фиксированные команды теперь не требуется. Пользователь может сообщить ИИ, что собирается готовить, и попросить включить свет — Gemini догадается, что свет требуется зажечь на кухне. Можно отдавать и сложные команды, например: «Включи весь свет, кроме кухонного, и запри входную дверь». Задавать сценарии, просто описывая их, к примеру, так: «Создай сценарий каждый день на закате включать свет на крыльце и запирать входную дверь», — и Gemini создаст его.  Улучшились средства работы с камерами. Вместо простых оповещений вроде «обнаружено движение», «обнаружен человек» или «обнаружена посылка», Gemini предоставит более точное описание происходящего, например: «Водитель из доставки кладёт посылку на крыльцо». Google пообещала, что пользователи заметят три важнейших улучшения в работе системы умного дома:

Ask Home действительно позволяет находить ценную информацию. Можно спросить: «Сколько времени проработал телевизор в минувшие выходные?» или «Часто ли на прошлой неделе включали кондиционер?». Gemini for Home будет развёртываться постепенно. Программа заработает уже в октябре, но на умных колонках и дисплеях обновлённый ассистент появится только в конце месяца — и придётся зарегистрироваться в программе раннего доступа. Система пришлёт отдельное оповещение, когда обновление будет готово к работе. Gemini теперь сможет объяснить, почему формула в «Google Таблицах» не работает или работает неправильно

26.09.2025 [12:37],

Павел Котов

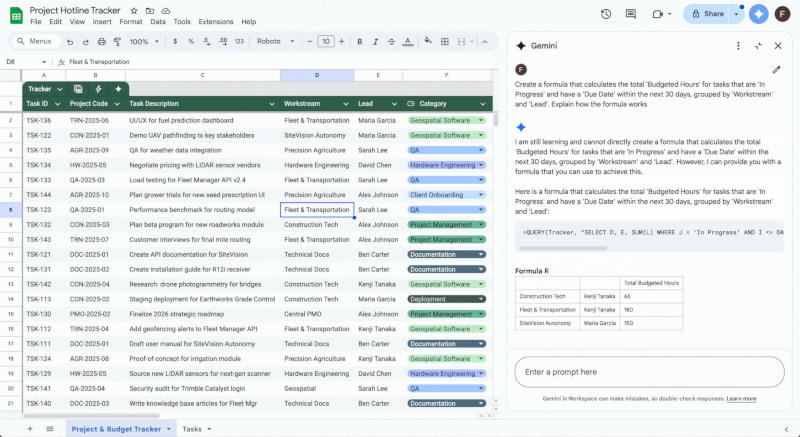

В январе Google добавила в сервис «Таблицы» своего помощника с искусственным интеллектом Gemini. Поначалу он давал советы по работе с текстом и построению диаграмм, но теперь его возможности расширились, и он помогает составлять формулы.

Источник изображения: Rubaitul Azad / unsplash.com В правой части интерфейса «Google Таблицы» появился интерфейс переписки с Gemini. Теперь ему можно задать вопрос о работе с данными — он предлагает составить формулы, даст пошаговые инструкции, чтобы эти формулы работали надлежащим образом, а также подробно разъясняет принцип работы этих формул. Это призвано укрепить доверие пользователей и упростить им изучение математических функций приложения для дальнейшей работы.

Источник изображения: workspaceupdates.googleblog.com Gemini может объяснить, почему введённые ранее формулы не работают: допущенные пользователем ошибки сопровождаются руководством по их исправлению — так, ИИ обратит внимание, что дата в одной из ячеек отформатирована как текст, и совершать с ней математические операции не получится. Если задача сложная, и одно действие можно выполнить при помощи разных формул, Gemini объясняет, чем отличаются результаты. Воспользоваться новыми функциями могут подписчики служб Google Workspace для корпоративных клиентов (Business и Enterprise), для образовательных организаций — администратору группы придётся вручную включить для них в консоли функции искусственного интеллекта и персонализацию. Поработать с Gemini в «Google Таблицах» смогут и частные пользователи, но для этого им потребуется подписка на ИИ-сервисы Google AI Pro и Ultra. «Google Фото» теперь редактирует снимки по голосовым командам — функция вышла за пределы Pixel

24.09.2025 [09:52],

Владимир Фетисов

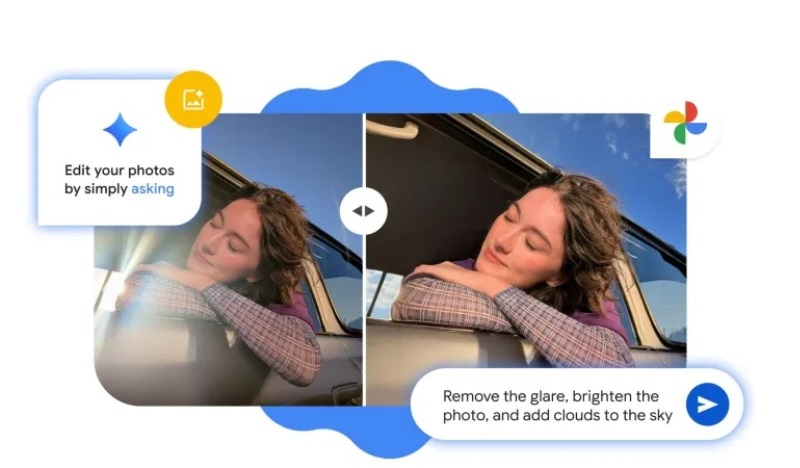

Новая функция «Google Фото», с помощью которой пользователи могут редактировать изображения простыми голосовыми запросами, стала доступной на большем количестве Android-смартфонов. Изначально взаимодействовать с ней могли только владельцы смартфонов Pixel 10.

Источник изображения: Google На этой неделе Google объявила, что функция редактирования фото с помощью голосовых команд, основой которой стала ИИ-модель Gemini, начала распространяться для пользователей совместимых устройств на базе Android в США. Для начала взаимодействия с этим инструментом достаточно нажать кнопку «Помоги мне отредактировать» в редакторе «Google Фото», после чего можно голосом произнести, что именно следует изменить. Ожидается, что возможность редактирования изображений с помощью голосовых команд сделает более комфортным процесс взаимодействия с «Google Фото». Пользователям не придётся вручную использовать доступные инструменты или самостоятельно передвигать ползунки регулировки. Цель Google заключается в том, чтобы сделать процесс редактирования фотографий более быстрым и простым, избавив пользователей от необходимости работать со множеством специфических инструментов. Отмечается, что искусственный интеллект понимает неточные команды вроде «сделай лучше» или «восстанови эту старую фотографию». По всей видимости, короткие команды с небольшим количеством деталей дают меньше контроля над итоговым результатом. Это означает, что для достижения оптимального результата нужно давать более подробные и детализированные инструкции. Голосовой ИИ-помощник Gemini Live поможет в прохождении игр на Android

23.09.2025 [20:59],

Анжелла Марина

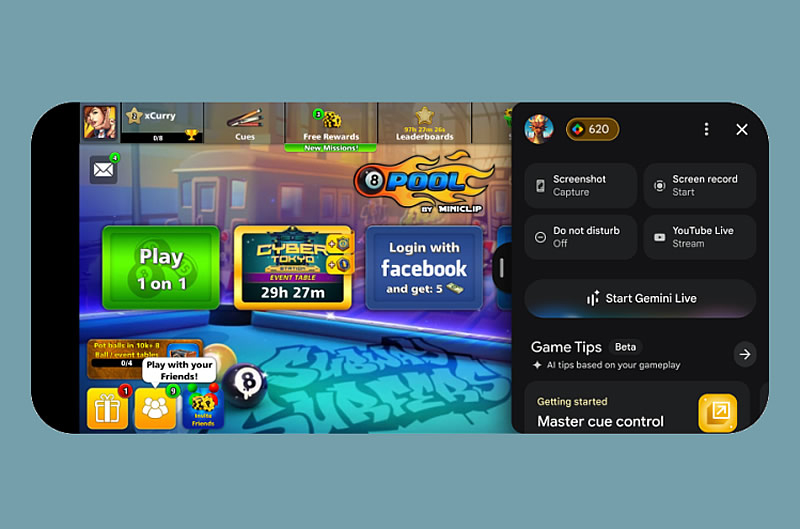

Компания Google объявила, что в скором времени голосовой ИИ-помощник Gemini Live, встроенный в приложение Gemini, сможет взаимодействовать с мобильными играми из Google Play. Нейросеть сможет анализировать игровой процесс на экране и давать пользователям подсказки для прохождения сложных моментов.

Источник изображения: Google По сообщению The Verge, функция будет доступна в отдельных играх. По своему принципу она напоминает инструмент Gaming Copilot, который Microsoft ранее внедрила в мобильное приложение Xbox и на ПК под управлением Windows 11. Помимо помощи от Gemini, новый внутриигровой оверлей будет отображать информацию о наградах, специальных предложениях и достижениях пользователя. Одновременно Google расширяет доступность своей платформы «Google Play Игры» для персональных компьютеров — спустя три года после запуска бета-версии. На данный момент более 200 000 игр из Google Play поддерживают кроссплатформенную игру между мобильными устройствами и ПК. Также в магазине Google Play появятся обновлённые страницы игр с расширенной информацией о прогрессе пользователя, списке достижений и новостях от разработчиков. В отдельных регионах появится возможность задавать вопросы о конкретной игре прямо на её странице в магазине, при этом другие игроки смогут на них отвечать. ИИ-помощник Google Gemini пропишется в миллионах телевизоров

23.09.2025 [18:39],

Павел Котов

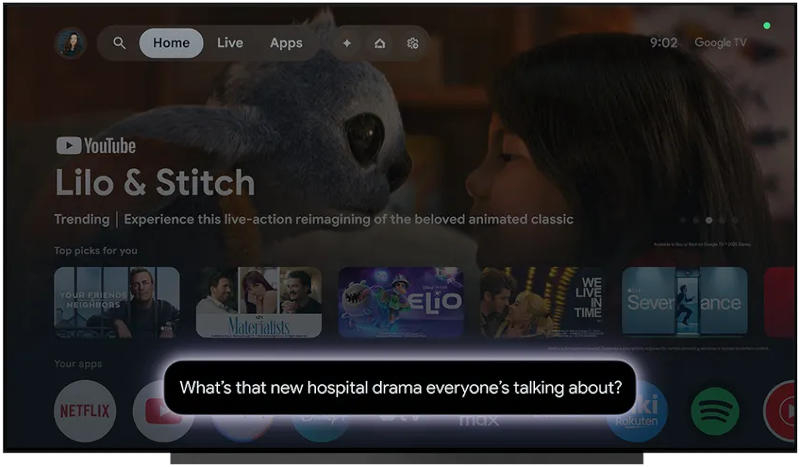

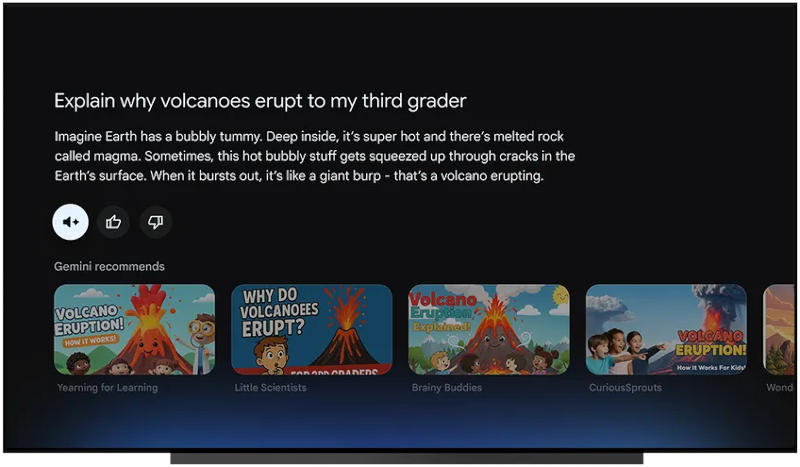

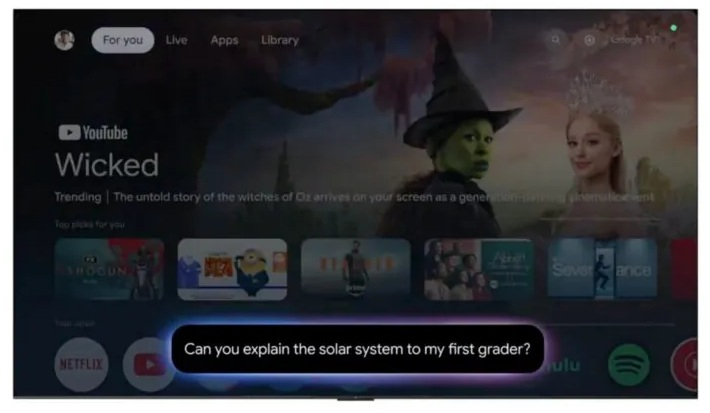

Помощник с искусственным интеллектом Google Gemini дебютирует на умных телевизорах. В моделях под управлением Google TV появится приложение Gemini, и владельцы телевизоров смогут общаться с ними естественным языком.

Источник изображений: blog.google Появившись на новой платформе, ИИ-помощник Gemini начнёт распространяться и на других умных телевизорах — а это 300 млн устройств под управлением Google TV и её альтернативной версии Android TV. На практике ассистент поможет людям с разными интересами выбрать, что им посмотреть вдвоём, или напомнит содержание предыдущего сезона любимого сериала. Можно обратиться к Gemini за помощью в поиске фильма или сериала, название которого пользователь забыл — ИИ сообщит, какие отзывы оставили зрители, и сто́ит ли его вообще смотреть.  Поскольку это Gemini с обычными возможностями, сценарии использования ИИ-помощника этим не ограничиваются: он поможет детям в работе над школьными проектами, семьям — распланировать отдых, а одиночным пользователям — в освоении новых знаний. Ассистент дебютирует на телевизорах серии TCL QM9K уже сегодня, до конца года появится на других устройствах, включая плеер Google TV Streamer, а также другие модели телевизоров TCL и Hisense. Набор функций Google Gemini на телевизорах будет расширяться. Google интегрирует ИИ-агента на базе Gemini в браузер Chrome

18.09.2025 [23:53],

Анжелла Марина

Google предоставит искусственному интеллекту (ИИ) Gemini в браузере Chrome более широкий доступ к вкладкам, истории браузера, данным из Google-приложений, включая почтовый сервис Gmail и «Календарь», и превратит адресную строку в точку входа для ИИ-режима (AI Mode).

Источник изображения: Firmbee.com/Unsplash Новые функции, включая ИИ-режим в адресной строке (Omnibox) и агентного ИИ под кодовым названием Project Mariner, который будет выполнять различные задачи в интернете за пользователя, появятся в ближайшие недели (для ИИ-режима) и месяцы (для ИИ-агента). При этом платное ограничение на использование Gemini внутри Chrome, по сообщению PCWorld, будет снято. Пользователи смогут переключаться между традиционным поиском и ИИ-режимом с помощью специального значка в строке ввода, а также задавать длинные контекстные вопросы вместо коротких ключевых слов. Пользователи смогут обратиться к Gemini за помощью в понимании содержимого определенной веб-страницы, работать с разными вкладками или выполнять другие действия в рамках одной вкладки, например, запланировать встречу или выполнить поиск видео на YouTube. «Мы разрабатываем браузер, чтобы помочь вам получать максимальную отдачу от Интернета способами, которые еще несколько лет назад казались нам невозможными, — заявил Рик Остерлох (Rick Osterloh), старший вице-президент Google, отвечающий за платформы и устройства. — И мы делаем это, сохраняя скорость, простоту и безопасность Chrome, которые так нравятся многим людям». Новый Gemini в Chrome более глубоко интегрируется с приложениями Google, такими как «Календарь», YouTube и «Карты», поэтому пользователи могут получать доступ к этим сервисам, не переходя на другую веб-страницу. Также в ближайшие месяцы пользователи смогут попросить агента Gemini выполнить определенные задачи, например, записаться на стрижку или заказать продукты на неделю. Ранее функции агента были частью внутреннего проекта под названием Project Mariner, который пользовался популярностью у сотрудников. Google также усилила с помощью ИИ безопасность в своём браузере. Теперь Chrome будет выявлять мошеннические сайты, фальшивые розыгрыши и ресурсы, запрашивающие подозрительные разрешения, например, на доступ к камере. Кроме того, ИИ сможет выявлять скомпрометированные пароли и на определённых сайтах автоматически сбрасывать их, сохраняя обновлённые пароли в безопасном хранилище. По мнению представителей Google, такие функции укрепляют позиции компании в конкурентной гонке с Microsoft Edge и Opera, которые также развивают агентные ИИ-возможности в своих браузерах. В то же время, технология пока ограничена англоязычным контентом, а её масштабное внедрение будет происходить поэтапно — без громких анонсов. ИИ от OpenAI обошёл все команды из людей, а заодно и Google Deepmind, на чемпионате по программированию

18.09.2025 [10:15],

Антон Чивчалов

Искусственный интеллект от OpenAI показал выдающийся результат в финале Международного студенческого чемпионата по программированию ICPC 2025, решив все 12 задач и превзойдя как команды студентов, так и модель Gemini 2.5 от Google Deepmind, передаёт сайт Decoder.

Турнир ICPC 2025. Источник изображения: worldfinals.icpc.global В OpenAI рассказали, что её система решала задачи в таких же условиях, что и участники-люди, не имея никаких преимуществ. Задания выдавались в стандартном PDF-формате, на решение выдавалось пять часов. Ответы направлялись официальному судье ICPC, который оценивал все работы по одинаковым критериям. «Участник» от OpenAI состоял из двух моделей — GPT-5 и ещё одной, экспериментальной системы. GPT-5 успешно справилась с 11 задачами, а последнюю, самую сложную, решила экспериментальная модель после девяти попыток. Комбинированная система OpenAI превзошла результат Deepmind, который также участвовал в соревновании. Модель от Google решила только 10 задач. При этом ни OpenAI, ни Deepmind не участвовали в турнире официально, поэтому все призовые места были присуждены участникам-людям. Первое место в общем зачёте заняла команда Санкт-Петербургского госуниверситета. Интересно, что только ИИ-модели — от OpenAI и Google — решили одну из задач (Problem C), которую не смогла решить ни одна человеческая команда. В OpenAI подчёркивают, что её модель специально не обучалась для участия в конкурсах, решения генерировались в рамках общего подхода к логическому выводу и анализу. Турнир ICPC 2025 проходил в Баку, столице Азербайджана. Ранее те же модели показали высокие результаты на Международной математической олимпиаде и Международной олимпиаде по информатике. Google Gemini обошла ChatGPT в топе американского App Store и вышла на первое место по популярности

15.09.2025 [05:15],

Алексей Разин

К вечеру минувшей пятницы, как отмечает 9to5Google, приложению Google Gemini удалось возглавить список самого популярного бесплатного программного обеспечения для iPhone в США. Ближайшими по популярности прочими бесплатными приложениями Google оказались Search, Google Maps, Google Chrome и Gmail.

Источник изображения: Google Что характерно, их в данном списке на второй позиции разделяет ChatGPT компании OpenAI, а на третьем месте расположилось приложение социальной сети Threads. Поисковое приложение Google заняло шестое место, Google Maps — восьмое, браузеру Google Chrome досталось только 13-е, а почтовый клиент Gmail и вовсе расположился на 21-м месте. В Канаде и Великобритании, например, Gemini занимает второе место в аналогичном списке. В период с 26 августа по 9 сентября приложение Gemini смогло привлечь 23 млн новых пользователей. Специалисты связывают эту активность с взрывной популярностью добавленной в него модели Nano Banana, которая за это время использовалось для создания или редактирования более 500 млн изображений. Nano Banana стала вирусной из-за того, что ей удаётся поддерживать сходство персонажей при переносе с одного изображения на другое. Оно так же позволяет комбинировать элементы с нескольких фотографий, корректировать стилистику и, конечно, последовательно менять элементы изображения в диалоге с чат-ботом. Бесплатным пользователям доступна возможность редактировать до 100 изображений в день, но подписчикам за $20 в месяц доступен лимит в 1000 ежедневно обрабатываемых фотографий. Нейросеть Google Veo 3 научилась создавать вертикальные видео для соцсетей

09.09.2025 [19:40],

Анжелла Марина

Генеративная модель для создания видео Google Veo 3 получила поддержку вертикального формата 9:16 и разрешение 1080 пикселей. Теперь разработчики смогут создавать контент, который идеально подходит по формату для TikTok и YouTube Shorts, причём по значительно меньшей цене. Об этом компания сообщила в официальном блоге для разработчиков.

Источник изображения: Google Согласно сообщению, основная версия Veo 3 и её более бюджетная модификация Veo 3 Fast теперь позволяют создавать ролики в оптимальном формате для мобильных устройств и социальных платформ. Активировать вертикальный формат можно, установив параметр aspectRatio в запросах API на значение 9:16. Кроме того, обновление позволяет устанавливать более высокое разрешение по сравнению с предыдущим ограничением в 720 пикселей. Однако, как сообщает The Verge, поддержка разрешения 1080 пикселей в настоящее время доступна только для видео с соотношением сторон 16:9. В Google также заявили, что Veo 3 и Veo 3 Fast теперь «стабильны и готовы к масштабируемому использованию в Gemini API», при этом стоимость использования сервиса существенно изменилась: генерации одной секунды видео через Veo 3 снизилась с $0,75 до $0,40, а через Veo 3 Fast — с $0,40 до $0,15 за секунду. Отмечается, что добавление поддержки вертикального видео не стало большой неожиданностью, поскольку компания ещё в июне анонсировала интеграцию Veo 3 с YouTube Shorts, которая была запланирована на конец лета. Очевидно, что в ближайшее время пользователи TikTok и Instagram✴ Reels больше увидят в своих лентах контент, созданный помощью нейросети Google Veo 3. Google добавила в Gemini поддержку аудиофайлов для всех платформ, включая iOS

08.09.2025 [21:10],

Анжелла Марина

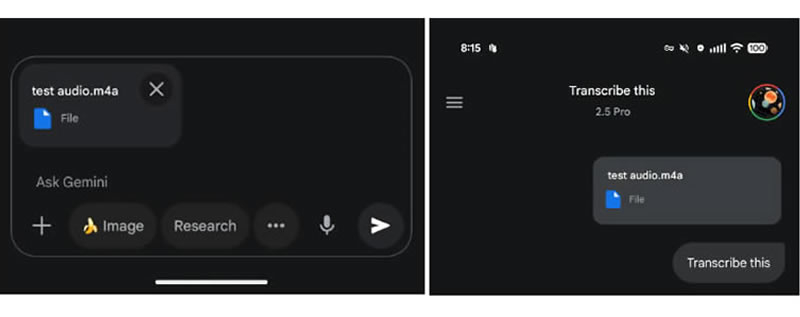

Google добавила в приложение Gemini возможность загрузки аудиофайлов на всех платформах: Android, iOS и в веб-версии. Теперь можно загружать аудиозаписи в форматах MP3, M4A, WAV и других через меню «Файлы» на мобильных устройствах или через пункт «Загрузить файлы» в браузерной версии.

Источник изображений: 9to5google.com Подписчики Google AI Pro или Google AI Ultra могут загружать аудио общей длительностью до трёх часов, тогда как бесплатные пользователи имеют ограничение в 10 минут, сообщается на сайте поддержки компании. Новая функция особенно полезна для транскрибирования аудиоматериалов и реализована в ответ на многочисленные запросы пользователей, так как процесс преобразования устной речи из аудио- или видеофайла в письменный текст оказался одним из самых востребованных.  Ранее аналогичная поддержка уже была добавлена для видео — до 5 минут для бесплатных аккаунтов и до одного часа для платных, при максимальном размере файла 2 Гбайт, все остальные поддерживаемые типы файлов ограничены размером в 100 Мбайт. Дополнительно в чат Gemini можно добавить одну папку с кодом или один репозиторий GitHub, содержащий до 5000 файлов и не превышающий 100 Мбайт, уточняет 9to5Google. ZIP-архивы могут включать до 10 файлов. В общей сложности за одну сессию допускается загрузка до 10 файлов любого формата. Google уточнила лимиты для бесплатного и платных тарифов Gemini

08.09.2025 [11:54],

Владимир Фетисов

До недавнего времени было неясно, какие ограничения Google установила на использование своей ИИ-модели Gemini подписчиками Google AI. Теперь же компания обновила информацию в справочном центре, где появились новые данные в разделе «Ограничения и обновления приложений Gemini для подписчиков Google AI».

Источник изображения: Google Из описания продукта исчезли такие формулировки, как «ограниченный доступ» и другие расплывчатые уточнения, такие как «время от времени мы можем ограничивать количество запросов и диалогов, которые вы можете вести, или интенсивность использования некоторых функций в течение определённого периода времени». Вместо этого теперь чётко указано, что пользователи бесплатных аккаунтов будут иметь возможность делать до пяти запросов в день к ИИ-модели Gemini 2.5 Pro. В это же время подписчики Google AI Pro смогут делать 100 запросов, а на тарифе Google AI Ultra — 500 запросов. Пользователи бесплатных аккаунтов не могут использовать функцию углубленного исследования Deep Research более 5 раз в день, а также генерировать более 100 изображений за этот же период. Обладатели аккаунтов Google AI Pro и Google AI Ultra имеют возможность генерировать до 1000 изображений ежедневно. Более детально ознакомиться со всеми ограничениями можно на сайте Google. TCL представила первые в мире телевизоры с Google TV и ИИ-помощником Gemini

04.09.2025 [22:40],

Николай Хижняк

ИИ-помощник Gemini для устройств Google TV был впервые анонсирован на выставке CES 2025. Он придёт на смену Google Assistant и будет предлагать рекомендации контента, основанные на запросах пользователя на естественном языке. На выставке Android Show в мае Google объявила, что Gemini для Google TV появится на телевизорах TCL в конце года. А на проходящей сейчас выставке IFA 2025 компания представила первую серию телевизоров с Gemini — TCL QM9K.

Источник изображений: TCL В серию входят модели с диагональю экрана 65, 75, 85 и 98 дюймов. Все поддерживают разрешение 4K (3840 × 2160 пикселей), частоту обновления 144 Гц и оснащены антибликовым покрытием экранов. Телевизоры TCL QM9K, как и ранее выпущенная модель QM8K, входят общую серию TCL Ultimate. Телевизоры оснащаются панелями CrystGlow WHVA со сверхширокими углами обзора.  TCL QM9K поддерживают функцию Ambient Display в Google TV, которая позволяет им «просыпаться» при появлении человека, показывать красивые заставки и отвечать на голосовые запросы. Для этого предусмотрен коротковолновый (mmWave) датчик присутствия, позволяющий телевизору включаться при обнаружении присутствия человека в комнате. Пользователи могут установить пороговое значение расстояния для помещений с открытой планировкой и даже изменить время отключения телевизора при отсутствии человека в помещении. TCL QM9K получили микрофоны дальнего радиуса действия, поэтому с Gemini можно общаться, не вставая с дивана. Пользователю доступны такие функции, как разговорный поиск (имитирует человеческое общение), голосовое управление домом и даже создание регулярных задач или сценариев умного дома. Можно задавать даже достаточно сложные вопросы, например, спросить, какой романтический фильм продолжительностью менее двух часов можно посмотреть. Телевизоры QM9K поддерживают функции генеративного ИИ. Для них можно создавать собственные заставки. Кроме того, здесь есть функция сводки новостей — ИИ может читать их вслух. Gemini на этих моделях телевизоров будет реагировать на активный профиль Google TV. Это означает, что при переключении профилей на телевизорах с Gemini вы в идеале получите другой, персонализированный опыт использования ИИ-инструментов. Также телевизоры оснащены технологией управления подсветки TCL Halo, которая включает в себя функцию Micro OD, уменьшающую оптическое расстояние между подсветкой и рассеивателем, что помогает уменьшить размытие изображения. Модели QM9K могут похвастаться пиковой яркостью до HDR6500. У тех же QM8K этот показатель составляет HDR5000. Также QM9K имеет до 6000 зон точного локального затемнения, у QM8K их 3800. Телевизоры QM9K и QM8K оснащены процессорами TCL AiPQ Pro и поддерживают такие HDR-форматы как Dolby Vision IQ, HDR10, HDR10+ и HLG. Встроенная аудиосистема Bang & Olufsen поддерживает технологии Dolby Atmos, Dolby Digital, Dolby Digital+ и DTS:X. Телевизоры предлагают стандартный набор портов: один кабельный вход, порт Ethernet, один USB 3.0, один USB 2.0, цифровой оптический аудиопорт SPDIF, три стандартных порта HDMI и один порт HDMI eARC. Кроме того, они поддерживают Wi-Fi 6. По словам TCL, модели QM8K в перспективе тоже получат поддержку функций Gemini, но компания не уточнила, когда именно. Новая серия телевизоров TCL QM9K поступит в продажу в конце этого месяца в Best Buy (США) и некоторых региональных розничных магазинах. TCL не раскрыла информацию о ценах на телевизоры. Также неизвестно, когда Gemini появится на других устройствах Google TV, например, на ТВ-приставке Google TV Streamer. Google выпустила «ИИ-фотошоп» — в Gemini встроили модель nano-banana, которая может точно редактировать картинки

27.08.2025 [11:06],

Павел Котов

Google обновила чат-бот Gemini, добавив в него основанную на алгоритмах искусственного интеллекта функцию для обработки изображений — она позволяет с высокой точностью контролировать процесс редактирования фотографий. Поисковый гигант стремится выйти на уровень средств обработки изображений от OpenAI и привлечь аудиторию ChatGPT.

Источник изображения: blog.google Обновление Gemini 2.5 Flash Image доступно всем пользователям приложения Gemini, а также разработчикам на платформах Gemini API, Google AI Studio и Vertex AI. Новый редактор обрабатывает изображения с высокой точностью на основе запросов простым естественным языком. Он сохраняет единообразие лиц, животных и другие детали, что не всегда под силу конкурирующим инструментам: например, если попросить ChatGPT или xAI Grok изменить на фотографии цвет чьей-то рубашки, на выходе можно получить искажённое лицо или изменения на фоне. Google Gemini 2.5 Flash Image уже завоевала признание пользователей — компания открыла доступ к ней на платформе LMArena под названием «nano-banana». Это не отдельная модель ИИ, а встроенная функциональность существующей Gemini 2.5 Flash AI. «Мы по-настоящему повысили качество работы с изображением, а также способность модели следовать инструкциям. Это обновление значительно улучшает процесс редактирования, делая его более органичным, а результаты работы модели — пригодными для любых целей», — рассказала ресурсу TechCrunch руководитель направления по генеративным визуальным моделям в Google DeepMind Николь Брихтова (Nicole Brichtova). Модель обладает глубокими знаниями о мире и позволяет задавать в запросе несколько образцов — например, изображение дивана, гостиной и цветовой палитры можно совместить в едином ответе. «Мы хотим дать пользователям свободу творчества, чтобы они могли получить от моделей то, что хотят. Но это не похоже на что-то другое», — добавила госпожа Брихтова. Google приняла некоторые меры для борьбы с ростом числа дипфейков: на сгенерированные ИИ изображения добавляются визуальные водяные знаки и идентификаторы в метаданных. Google открыла бесплатный доступ к генератору видео Veo 3, но только на эти выходные

23.08.2025 [16:39],

Владимир Мироненко

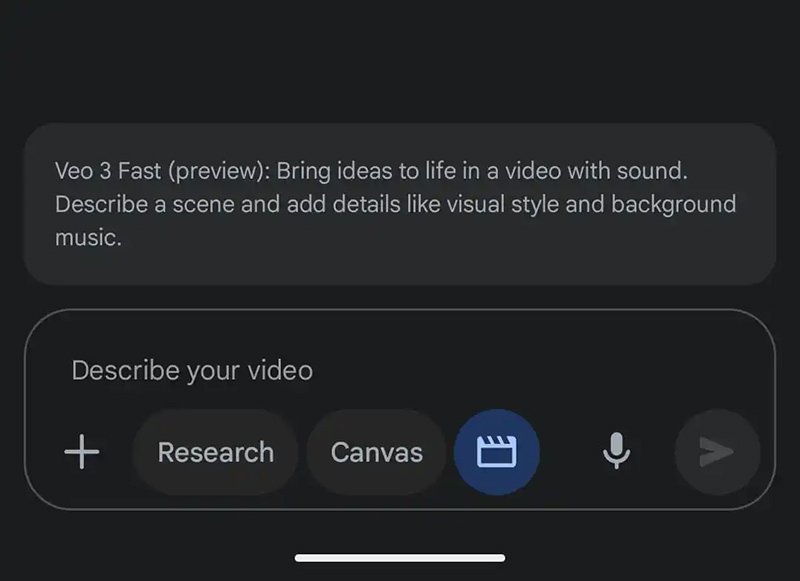

В эти выходные чат-бот на основе искусственного интеллекта Google Gemini предоставит пользователям бесплатного приложения возможность опробовать версию новейшей модели генерации видео Google Veo 3, анонсированной в мае. С её помощью можно создавать на основе запросов 8-секундные клипы со звуком. Отметим для россиян, что эта услуга доступна только с зарубежного IP-адреса.

Источник изображения: 9to5google С июля платные подписчики Google AI Pro по всему миру могут создавать три видео в день с помощью более дешёвой, чем Veo 3, модели Veo 3 Fast, которая генерирует видео в два раза быстрее с разрешением 720p. При этом владельцы подписки Google AI Ultra имеют расширенный доступ к полной версии. Им также доступна функция преобразования фото в видео. Однако в рамках акции с текущего момента до 22:00 по тихоокеанскому времени воскресенья (понедельник, 9:00 мск) пользователи бесплатной версии Gemini смогут создать три видео с помощью модели Veo 3 Fast. Глава ИИ-сервиса Gemini Джош Вудворд (Josh Woodward) сообщил в четверг в соцсети X, что Google «настраивает массу TPU» перед пробным периодом, чтобы справиться с ожидаемым ростом запросов. При открытии приложения Gemini можно увидеть сообщение об акции. Если его нет, необходимо нажать на указатель с тремя точками на панели подсказок, чтобы открыть новый элемент «Видео: Генерация с Veo». Запрос пользователя должен «описывать сцену с добавленными деталями, такими как визуальный стиль и фоновая музыка». Можно также указать в описании диалоги и фоновый шум. Создание займёт несколько минут, после чего пользователи смогут скачать клип с водяным знаком (значок Veo в правом нижнем углу) или получить ссылку для общего доступа. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |