|

Опрос

|

реклама

Быстрый переход

ИИ-поисковик Google научился понимать голосовые запросы, но доступна функция не всем

18.06.2025 [23:20],

Николай Хижняк

Google начала тестировать функцию Search Live в режиме поиска с ИИ — AI Mode. Новая функция позволяет задавать вопросы ИИ-чат-боту голосом прямо из поисковой системы. Открытое тестирование доступно пока только в США и исключительно для участников программы Google Labs по тестированию экспериментальных функций. На данный момент Search Live не поддерживает использование камеры смартфона, но Google планирует добавить такую возможность «в ближайшие месяцы».

Источник изображений: Google Search Live позволяет взаимодействовать со специально адаптированной версией ИИ-помощника Gemini и выполнять поиск в интернете в режиме реального времени. Функция доступна в приложении Google для Android и iOS. В будущем Search Live получит поддержку камеры смартфона — пользователь сможет навести её на объект и задать голосом интересующий вопрос о нём. Google анонсировала функцию Search Live для режима поиска с ИИ AI Mode в прошлом месяце. Она является частью более широкой программы компании по трансформации своей поисковой системы и расширению его ИИ-возможностей. Сейчас компания, например, также экспериментирует с ИИ-функцией, которая превращает результаты поиска в подкаст. После запроса пользователя и вывода чат-ботом результатов, пользователь может использовать функцию Generate Audio Overview и ИИ предоставит ответ в аудиоформате в виде кратного подкаст-обзора по теме. Принять участие в тестировании Search Live можно через Google Labs (в России недоступен), после чего в приложении Google на Android или iOS станет активен новый значок Live. Затем чат-боту можно вслух задать, например, такой вопрос: «Как предотвратить появление складок на льняном платье, упакованном в чемодан?». Чат-бот предложит ответ, а пользователь сможет задать уточняющий вопрос, например: «Что делать, если оно всё равно мнётся?». Search Live также предложит ссылки на материалы с возможными решениями во время диалога.  Другие ИИ-компании также внедряют голосовые режимы в своих чат-ботах. Так, OpenAI представила расширенный голосовой режим для ChatGPT в прошлом году, а Anthropic запустила голосовую функцию в приложении Claude в мае. Apple также работает над большой языковой моделью для Siri, однако её выпуск был отложен — по словам старшего вице-президента Apple по программному обеспечению Крейга Федериги (Craig Federighi), компания пока не достигла «желаемого уровня надёжности». Google отмечает, что Search Live может работать в фоновом режиме, позволяя продолжать диалог с чат-ботом даже при переходе в другие приложения. Пользователь может также включить субтитры, чтобы видеть текстовую версию ответа, и при желании продолжить общение текстом. Кроме того, Search Live сохраняет историю прошлых разговоров в разделе поиска AI Mode. ИИ-приложение Google Gemini научилось анализировать видео, но не везде

18.06.2025 [11:12],

Владимир Мироненко

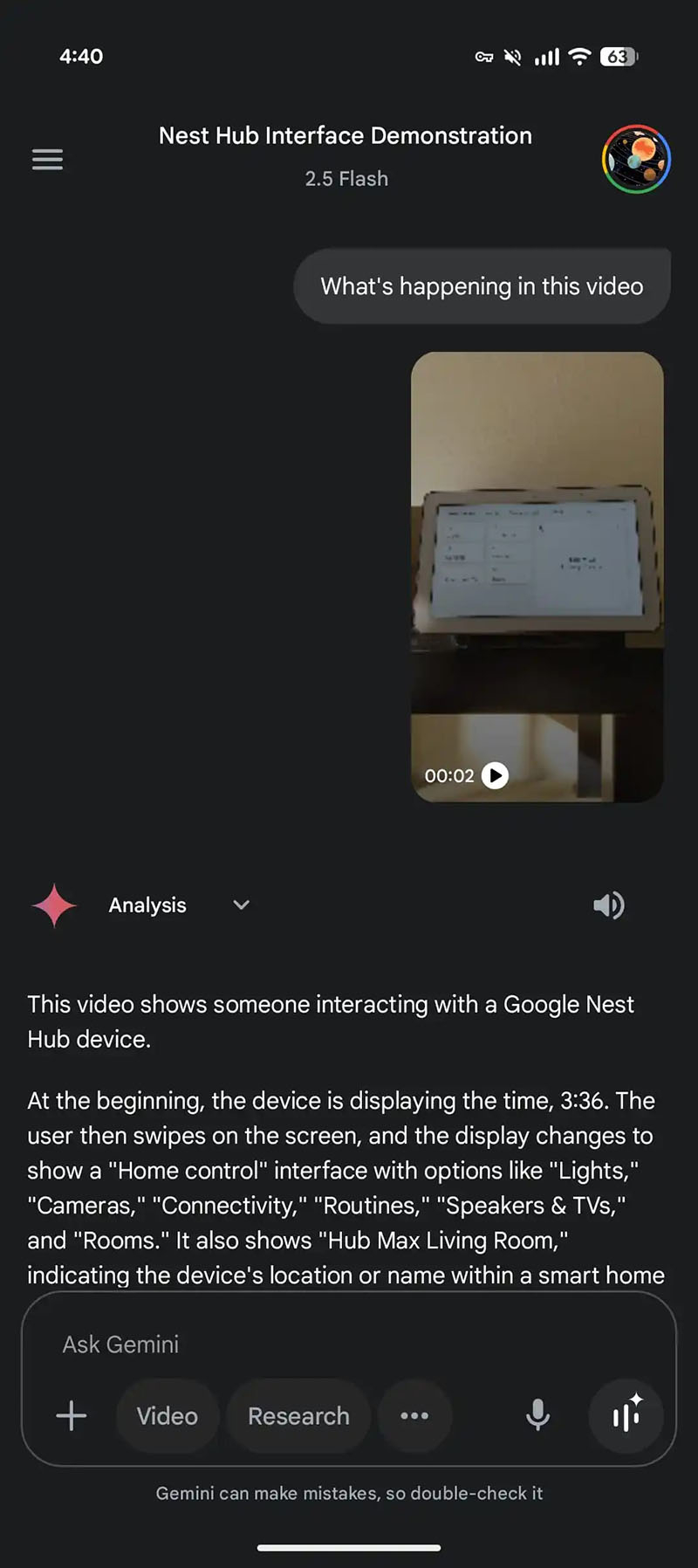

Помимо выпуска стабильных версий ИИ-моделей Gemini 2.5 Pro и Gemini 2.5 Flash, разработчики Google добавили в мобильное приложение чат-бота Gemini возможность загрузки и анализа видео, сообщил ресурс 9to5Google.

Источник изображений: 9to5Google Теперь, помимо загрузки документов и изображений, пользователи могут добавлять в запрос в приложении собственный видеофайл. ИИ-чат-бот Gemini проанализирует его и позволит пользователям задавать вопросы о клипе. Ранее пользователи имели возможность задавать вопросы только по поводу видео на платформе YouTube, указав ссылку на него. 9to5Google приводит примеры диалога с Gemini, в ходе которого чат-бот отвечает на вопрос о времени, которое указано на умном дисплее Google Nest Hub, а также в ответ на запрос предоставляет описание видеоролика, который загрузил пользователь.  Чтобы загрузить файл, необходимо в меню выбрать «Галерея» или «Файлы». «Если эта возможность доступна для вашей учетной записи, вы можете выбрать видео. В противном случае файл будет серым и не может быть загружен», — пишет 9to5Google. Ресурс отметил, что функция загрузки видео в Gemini пока не получила широкого распространения, хотя она, похоже, доступна как для бесплатных, так и для платных аккаунтов на Android (приложение Google 16.23 beta) и iOS, а также 2.5 Flash и 2.5 Pro. Вместе с тем в веб-приложении эта функция пока не доступна — при попытке загрузить видео в строке подсказок чат-бота появляется сообщение «Тип файла не поддерживается». Google выпустила финальную версию мощной ИИ-модели Gemini 2.5 Pro, а также экономную Gemini 2.5 Flash-Lite

18.06.2025 [00:44],

Анжелла Марина

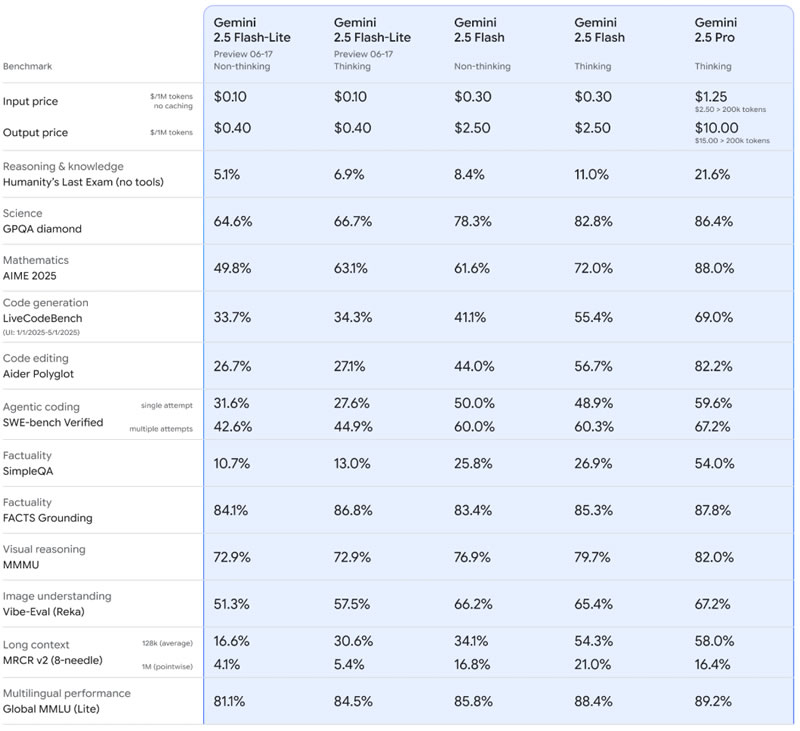

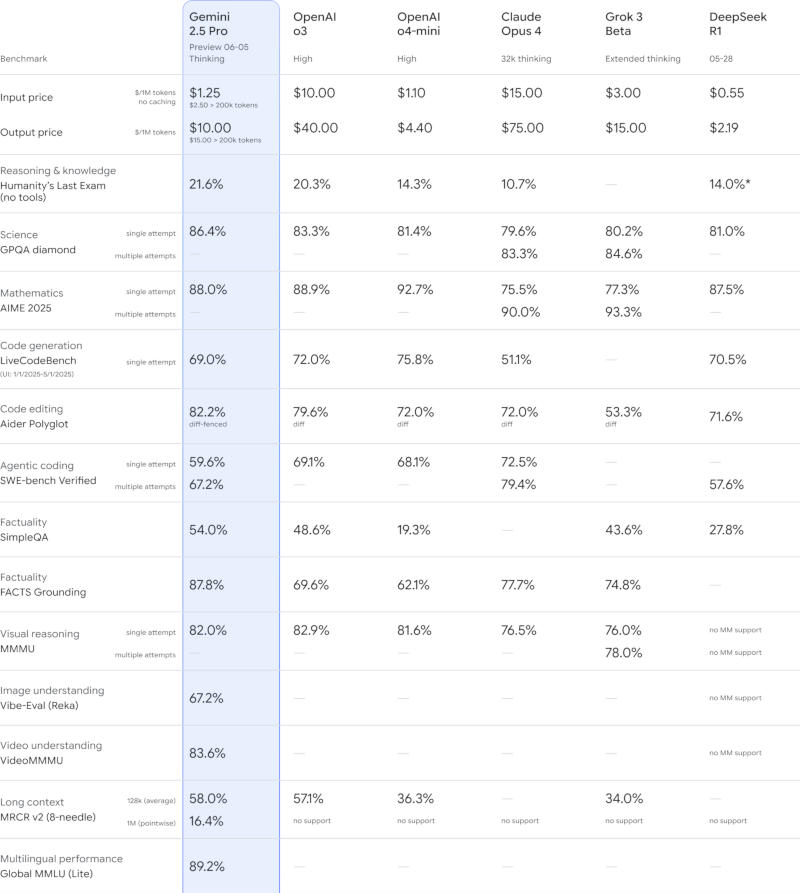

Google объявила о выходе стабильных версий своих ИИ-моделей Gemini 2.5 Pro и Gemini 2.5 Flash, а также представила новую бюджетную модификацию — Gemini 2.5 Flash-Lite. Основные обновления направлены на снижение затрат для разработчиков и повышение стабильности моделей. Высокопроизводительная Gemini 2.5 Pro вышла из стадии превью и готова к коммерческому использованию.

Источник изображения: Ryan Whitwam / arstechnica.com Модель Gemini 2.5 была представлена в начале 2025 года и продемонстрировала значительный прогресс по сравнению с предыдущими версиями, усилив конкуренцию Google с OpenAI. Gemini 2.5 Flash вышла из стадии предварительного просмотра ещё в апреле, однако Gemini 2.5 Pro немного задержалась. Сейчас обе модели, включая обновлённую сборку 06-05 для Pro-версии, доступны в стабильной версии. Все модели линейки Gemini 2.5 поддерживают настраиваемый бюджет ответов ИИ, позволяя разработчикам контролировать свои расходы. В наиболее экономичном варианте Google предлагает облегчённую модель Gemini 2.5 Flash-Lite, которая сейчас находится в статусе Preview. По сравнению с версией 2.5 Flash, стоимость обработки текста, изображений и видео будет в три раза ниже, а генерация ответов — более чем в шесть раз дешевле. Flash-Lite не будет представлена в пользовательском приложении Gemini, так как ориентирована в первую очередь на разработчиков, оплачивающих использование модели по количеству токенов.

Источник изображения: Google Кроме того, Google начала внедрять модели Flash и Flash-Lite в свою поисковую систему. Представитель компании сообщил изданию Ars Technica, что адаптированные версии этих моделей уже используются в «ИИ-обзорах» и в режиме чат-бота AI Mode. В зависимости от сложности запроса система автоматически выбирает оптимальную модель: Gemini 2.5 Pro — для сложных задач, Flash или Flash-Lite — для более простых. Предварительная версия Flash-Lite доступна через Google AI Studio и Vertex AI для разработчиков наряду со стабильными релизами Gemini 2.5 Flash и 2.5 Pro. В пользовательском приложении Gemini заметных изменений не произойдёт, поскольку финальные версии моделей уже были задействованы в предыдущих обновлениях. У версии 2.5 Pro исчезнет метка Preview — так же, как месяцем ранее это произошло с моделью Flash. Бесплатные пользователи по-прежнему будут иметь ограниченный доступ к 2.5 Pro, тогда как подписчики Gemini Pro смогут использовать модель до 100 раз в сутки. Максимальный уровень доступа остаётся у владельцев подписки AI Ultra. Google Gemini научился выполнять задачи по расписанию

07.06.2025 [10:14],

Анжелла Марина

Google продолжает расширять возможности ИИ-ассистента Gemini, добавив функцию запланированных действий. Теперь подписчики Gemini Pro и Ultra могут настраивать автоматическое выполнение задач в заданное время. Например, ИИ будет отправлять сводку календаря в конце дня или предлагать идеи для блога еженедельно.

Источник изображения: Solen Feyissa / Unsplash Как сообщает The Verge, пользователи также смогут поручать Gemini разовые задания. Например, запрашивать итоги прошедшего мероприятия на следующий день. Для работы функции достаточно указать искусственному интеллекту, что и когда нужно сделать, а чат-бот выполнит задачу самостоятельно. Управлять запланированными действиями можно в настройках приложения Gemini на странице Scheduled Actions. Ранее издание Android Authority сообщило, что предварительная версия этой функции была замечена ещё в апреле. Обновление является частью масштабных планов Google по превращению Gemini в цифрового помощника, обладающего более широкими автономными возможностями и способного выполнять команды без вмешательства пользователя. Интересно, что аналогичную функцию уже предлагает OpenAI в ChatGPT. В частности, подписчики могут настраивать «напоминалки» и повторяющиеся задачи. Google навела порядок в Gemini 2.5 Pro — исправлены накопившиеся у ИИ-модели «регрессии»

06.06.2025 [12:25],

Павел Котов

Google выпустила крупное обновление своей самой мощной модели искусственного интеллекта Gemini 2.5 Pro. Свежий вариант призван исправить некоторые проблемы, возникшие в более ранних версиях, — компания намеревается установить для него статус стабильного, то есть он будет подключён к приложению Gemini как основной для широкой аудитории.

Источник изображений: blog.google Предыдущий выпуск Gemini 2.5 Pro с номером версии 05-06 и именем I/O Edition был направлен на повышение качества генерируемого ИИ программного кода. В последнем обновлении, утверждает Google, этот навык был дополнительно улучшен, и в тесте Aider Polyglot модель набрала 82,2 %, значительно оторвавшись от лучших моделей OpenAI, Anthropic и DeepSeek. Модель Gemini 2.5 Flash уже вышла из стадии предварительной и стала стабильной, тогда как работа над Gemini 2.5 Pro продолжается — несколько последних её обновлений спровоцировали критику по качеству ответов на запросы, не связанные с написанием кода, — их качество снизилось по сравнению с крупным выпуском версии 03-25. Google приняла эти замечания всерьёз, заявили в компании, и в свежем обновлении «закрыты проблемы в регрессиях [относительно] 03-25». Пользователям обещаны улучшенные творческие способности модели и более качественное форматирование ответов.  Последнее обновление Gemini 2.5 Pro 06-05 поддерживает гибкое управление ресурсами модели для разработчиков, и в Google рассчитывают, что эта сборка получит статус «долгосрочного стабильного выпуска». Таким образом, если в ближайшие недели данный вариант выйдет в приложении для широкой аудитории и в веб-интерфейсе, у Gemini 2.5 Pro уже не будет статуса предварительной версии (Preview). Google традиционно собирает оценки качества ответов своих моделей и приводит рейтинги с платформ LMArena и WebDevArena, где сравниваются возможности различных систем ИИ. На платформе LMArena модель увеличила результат на 24 балла по системе Эло, и на 35 балов он вырос на WebDevArena. Модели ИИ от Google были на вершинах обоих рейтингов и до настоящего момента, поэтому с выходом очередного обновления разрыв только увеличился. Опробовать последнюю версию Gemini 2.5 Pro можно на облачных платформах Google Cloud Vertex AI и AI Studio, а также в приложении Gemini. Google научила Gemini 2.5 понимать и передавать эмоции в диалогах

05.06.2025 [01:57],

Вячеслав Ким

На конференции Google I/O 2025 компания анонсировала новую версию своей мультимодальной модели Gemini 2.5, которая теперь поддерживает генерацию аудио и диалогов в реальном времени. Эти возможности доступны в предварительной версии для разработчиков через платформы Google AI Studio и Vertex AI.

Источник изображения: Google Gemini 2.5 Flash Preview обеспечивает реалистичное голосовое взаимодействие с ИИ, включая распознавание эмоциональной окраски речи, адаптацию интонации и акцента, а также возможность переключения между более чем 24 языками. Модель может игнорировать фоновые шумы и использовать внешние инструменты, такие как «Поиск», для получения актуальной информации во время диалога. Дополнительно, Gemini 2.5 предлагает расширенные функции синтеза речи (TTS), позволяя управлять стилем, темпом и эмоциональной выразительностью озвучивания. Поддерживается генерация диалогов с несколькими голосами, что делает модель подходящей для создания подкастов, аудиокниг и других мультимедийных продуктов. Для обеспечения прозрачности, все сгенерированные моделью аудио маркируются с помощью технологии SynthID, что позволяет идентифицировать контент, как сгенерированный ИИ. Разработчики могут опробовать новые функции через вкладки Stream и Generate Media в Google AI Studio. Gemini 2.5 демонстрирует значительный шаг вперёд в области мультимодальных ИИ-систем, объединяя модальности текстов, изображений, аудио и видео в единую платформу. Новые функции открывают широкие перспективы для создания интерактивных приложений, виртуальных ассистентов и инноваций в сфере образования. Gemini покажет изменения, внесённые коллегами в файлы на «Google Диске»

04.06.2025 [19:41],

Сергей Сурабекянц

Google внедрила функции генеративного ИИ во многие продукты и сервисы, и инструменты повышения производительности компании не стали исключением. Теперь компания предлагает использовать нейросеть Gemini, чтобы быстро узнать об изменениях файлов и добавленных другими пользователями комментариях на «Google Диске». Новая функция называется Catch me up и уже доступна для англоязычных пользователей «Диска».

Источник изображения: techspot.com 3 июня Google анонсировала функцию Catch me up в «Google Диске», которая показывает изменения и комментарии, внесённые в файлы пользователя с момента последнего просмотра. Функцию можно активировать на домашней странице Google Drive, нажав на значок звёздочки рядом с именем файла. Также можно нажать кнопку Catch me up в верхней части домашней страницы, чтобы получить сводку изменений всех файлов с момента последнего просмотра. «Начиная с сегодняшнего дня Gemini может идентифицировать соответствующие файлы на "Google Диске" с изменениями с момента последнего просмотра и предоставлять обзор этих изменений, — пояснила компания. — Catch me up поддерживает редактирование файлов в "Google Документах", а также комментарии к файлам в "Документах", "Таблицах" и "Презентациях". Google подчеркнула, что эти сводки не являются исчерпывающими, их цель — раскрыть «полезные и важные» изменения. Новая возможность может прийтись по душе пользователям, часто совместно работающим с другими людьми над документами, электронными таблицами и презентациями. Конечно, инструменты повышения производительности Google позволяют отслеживать изменения через страницу истории версий, а также просматривать комментарии и другие аннотации от других людей в файле. Однако использование Catch me up может упростить отслеживание правок и отзывов от коллег. ИИ начал автоматически конспектировать содержимое писем Gmail

30.05.2025 [17:33],

Павел Котов

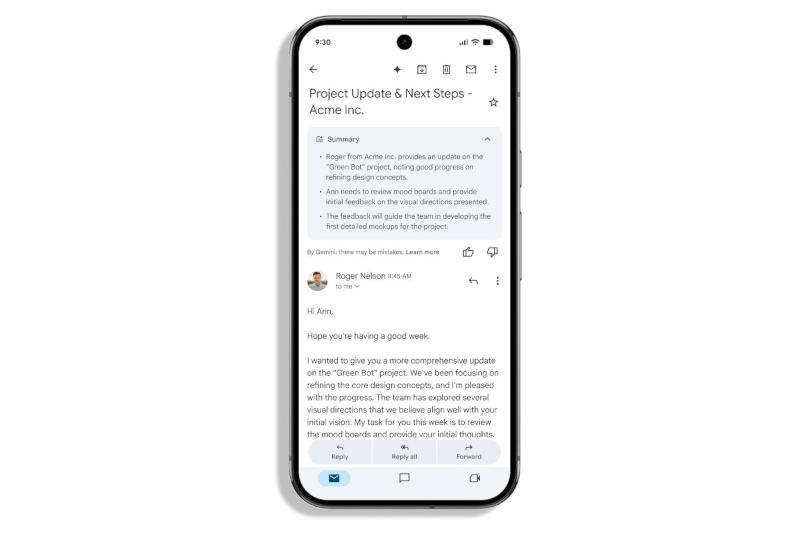

Пользователи рабочей платформы Google Workspace вскоре заметят ещё более плотное присутствие помощника с искусственным интеллектом Gemini. В почте Gmail теперь автоматически генерируются сводки для сложных цепочек писем и отображаются над самой перепиской.

Источник изображения: Google Составляемые ИИ сводки писем появились в почтовых ящиках у владельцев учётных записей Google Workspace ещё в прошлом году, но до настоящего момента эту функцию приходилось запускать вручную. Теперь Gemini самостоятельно решает, когда такие сводки могут быть полезными, — они создаются без запроса для «длинных цепочек писем с несколькими ответами». По мере поступления новые ответы также попадают в сводки. Пока функция работает в ограниченном режиме — сводки составляются только для англоязычной переписки и только при просмотре на мобильных устройствах. Google лишь начала её развёртывать — некоторым пользователям придётся ещё подождать её до двух недель. В компании не уточнили, появятся ли ИИ-сводки в десктопной версии Gmail или для пользователей почтовой службы без учётных записей Workspace. Если сводка не генерируется автоматически, её можно запросить вручную, как и раньше. Можно и отказаться ото всех функций ИИ в Gmail, отключив опцию «Умные функции» в настройках приложения. Google расширила доступ к ИИ-генератору Veo 3 через приложение Gemini

26.05.2025 [17:01],

Владимир Фетисов

Всего несколько дней прошло с тех пор, как Google представила свой новый ИИ-генератор видео Veo 3, а он уже стал доступен пользователям из 71 страны. Опробовать новинку в деле смогут подписчики приложения Gemini из десятков стран, но на территории ЕС и в России сервис пока недоступен. Об этом в своём аккаунте в соцсети X сообщил глава Google Labs и Gemini Джош Вудворд (Josh Woodward).

Источник изображения: Veo 3 / Google Согласно имеющимся данным, взаимодействовать с Veo 3 могут подписчики Gemini Pro, которые получат пробный пакет на 10 генераций видео через веб-интерфейс. На данном этапе пакет из десяти генераций является одноразовым, т.е. не будет обновлён после истечения какого-то периода времени. Обладатели подписки Ultra стоимостью $250 в месяц получат максимально разрешённое Google количество генераций, которые будут обновляться ежедневно. В режиме Flow, который ориентирован на создателей видеоконтента с помощью ИИ, подписчики Ultra смогу генерировать до 125 роликов в месяц, а подписчики Pro — до 10 роликов в месяц. На данном этапе не обошлось без некоторых ограничений. ИИ-генератор Veo 3 работает только в веб-версии Gemini Pro и поддерживает генерацию звукового сопровождения только на английском языке, хотя в некоторых случаях может появляться речь на других языках. Несмотря на это и ограниченную доступность, у Veo 3 есть все шансы стать вирусной сенсацией Google в сфере ИИ. Интернет уже наводнили созданные с помощью этого сервиса ролики, показывающие, как сочетание видео и аудио устанавливает новый стандарт качества для контента, генерируемого с помощью ИИ. Также отмечается, что Veo 3 с поразительной точностью следует подсказкам пользователей. Это повышает качество создаваемого контента, но в то же время позволяет генерировать фейковые видео, которые выглядят и звучат как настоящие. В одном из примеров пользователь сгенерировал видео с вымышленного автомобильного шоу, которое выглядит вполне реалистично. Однако злоумышленники могут задействовать сервис для генерации видео с высказываниями политиков, массовыми протестами и какими-то другими ситуациями для манипулирования общественным мнением. Veo 3 подтверждает опасения по поводу значимой роли ИИ в распространении дезинформации и одновременно демонстрирует, насколько далеко продвинулись технологии. Ещё несколько лет назад создание качественного фейкового видео с заменой лица требовало многочасовой работы и наличия серьёзных технических навыков. Сегодня несколько строчек теста позволяют генерировать реалистичные сцены с естественным звуком. Всё это говорит о том, что людям следует тщательнее проверять подлинность просматриваемого контента, не принимая всё увиденное за действительность. В Google разработали инструмент для выявления контента, сгенерированного ИИ

22.05.2025 [04:35],

Анжелла Марина

Компания Google анонсировала на конференции Google I/O новый инструмент SynthID Detector, который позволяет узнать, был ли контент создан с помощью инструментов искусственного интеллекта. Сервис анализирует изображения, текст, аудио и видео на наличие скрытых водяных меток, которые автоматически добавляются в материалы, сгенерированные с помощью ИИ, включая модели компании — Gemini, Imagen, Lyria и Veo.

Источник изображения: Sascha Bosshard / Unsplash Как объяснил руководитель Google DeepMind Пушмит Коли (Pushmeet Kohli), система определяет, какие именно части контента содержат маркировку. Например, в аудио SynthID Detector находит и отмечает конкретные временные отрезки, а в изображениях — области с наибольшей вероятностью наличия водяного знака. Сейчас система тестируется среди ограниченного круга пользователей. Но после первого этапа тестирования доступ постепенно получат те, кто подал заявку через «Лист ожидания» (SynthID Detector Waitlist). По словам Коли, компания планирует также использовать обратную связь с пользователями, чтобы улучшить систему идентификации ИИ-контента. На данный момент SynthID Detector работает только с контентом, созданным с помощью продуктов Google. Однако в будущем компания рассматривает возможность расширения функциональности для работы с другими ИИ-системами. Когда именно инструмент станет доступен всем — пока неизвестно. Google добавила в Gmail, «Документы» и Vids новые ИИ-функции

21.05.2025 [16:46],

Павел Котов

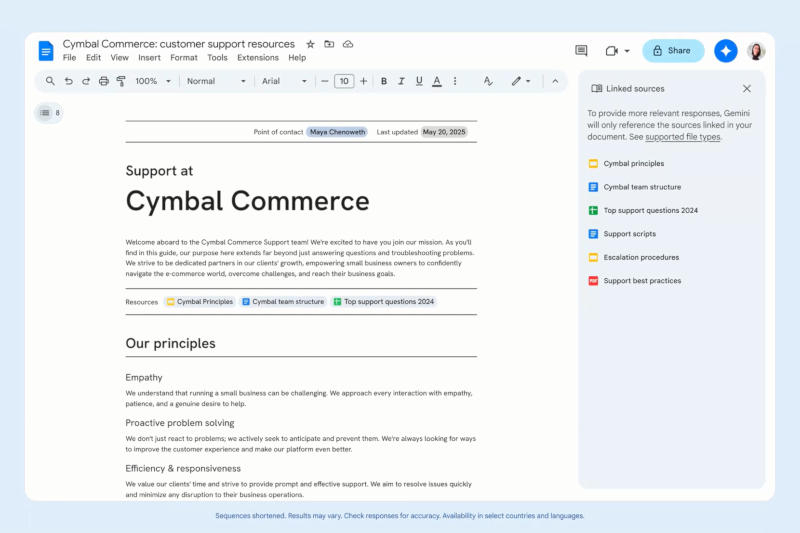

На конференции Google I/O 2025 компания представила множество новых функций на основе искусственного интеллекта для приложений из рабочего комплекта Workspace — изменения коснулись сервисов Gmail, «Google Документы» и видеоредактора Google Vids.

Источник изображений: Google Функция персонализированных интеллектуальных ответов Gmail помогает в составлении писем с учётом контекста и тона — система анализирует предыдущую переписку, файлы в облачном хранилище «Google Диск» и готовит ответы с актуальными данными. Манера письма подстраивается под тон пользователя — формальный или разговорный. С функцией очистки входящих сообщений ИИ-помощник Gemini принимает решения об удалении или перемещении в архив писем, которые больше не нужны — достаточно, например, в свободной форме дать ему команду удалить все непрочитанные письма от определённого адресата за минувший год. Ещё одна новая возможность Gmail помогает оперативно планировать встречи и совещания с адресатами вне организации пользователя. Он назначает время встречи или совещания при участии Gemini — это, по словам Google, сокращает время и усилия, которые традиционно тратятся на сверку расписаний. Все эти новые функции почтовой службы станут общедоступными в ближайшие месяцы.  В «Google Документах» появилась возможность устанавливать прямую связь приложения с данными презентаций, таблиц и отчётов — помогая в написании документов, Gemini берёт в качестве исходной информации только эти источники, то есть генерируемый системой текст основывается только на надёжном материале. Функция уже вышла в общий доступ. Редактор Google Vids получил возможность превращать существующие документы «Google Презентаций» в видео. Gemini предлагает помощь в составлении сценариев, может сгенерировать закадровый голос, анимации и многое другое — функция станет общедоступной в ближайшие месяцы. В Google Vids появились ИИ-аватары, которые пригодятся компаниям, не располагающими средствами для съёмки видео или привлечения диктора. Можно подготовить сценарий и выбрать аватар, который зачитает сообщение в специально подготовленном видео — это пригодится для корпоративных объявлений, создании справки по продуктам и в других целях. ИИ-аватары выйдут в общий доступ в июне. Ещё одна новая функция Google Vids — «Обрезка стенограммы» (Transcript trim), предполагающая автоматическое удаление из выступлений слов-паразитов и лишних междометий. Для регулирования уровня звука пригодится функция «Сбалансировать звук» (Balance sound) — она выйдет в общий доступ в июне; «Обрезка стенограммы» появится в экспериментальном разделе Labs в ближайшие месяцы. Наконец, более качественные иллюстрации в документах теперь помогает создавать новая версия генератора изображений Imagen 4, доступ к которой открылся в рабочих приложениях. Google анонсировала запуск AI Mode — ИИ-поиск будущего с анализом данных, графиками и 3D-примеркой

21.05.2025 [15:36],

Анжелла Марина

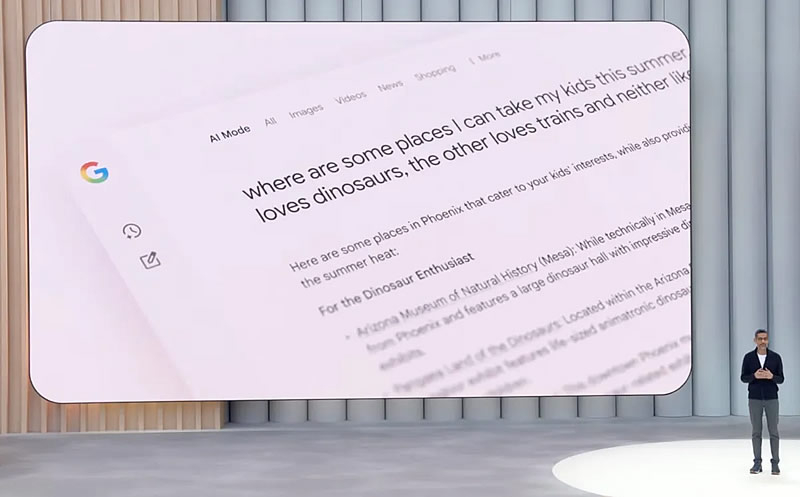

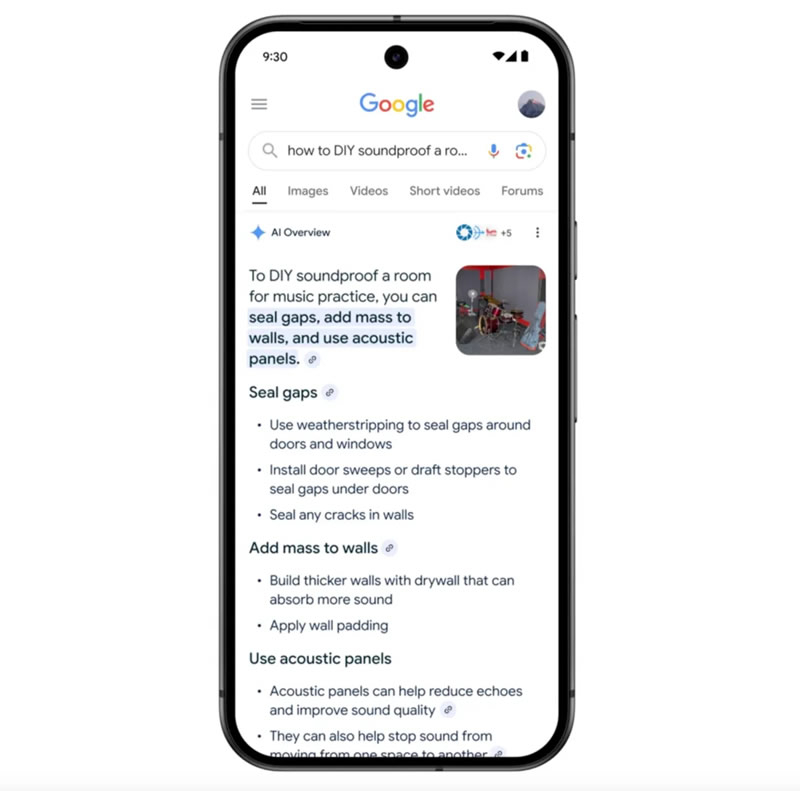

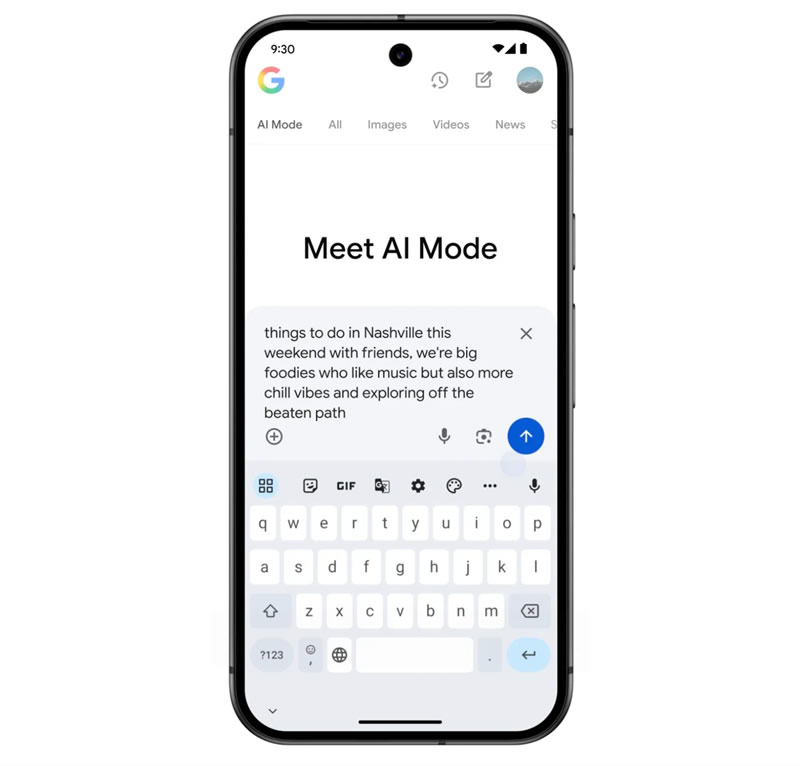

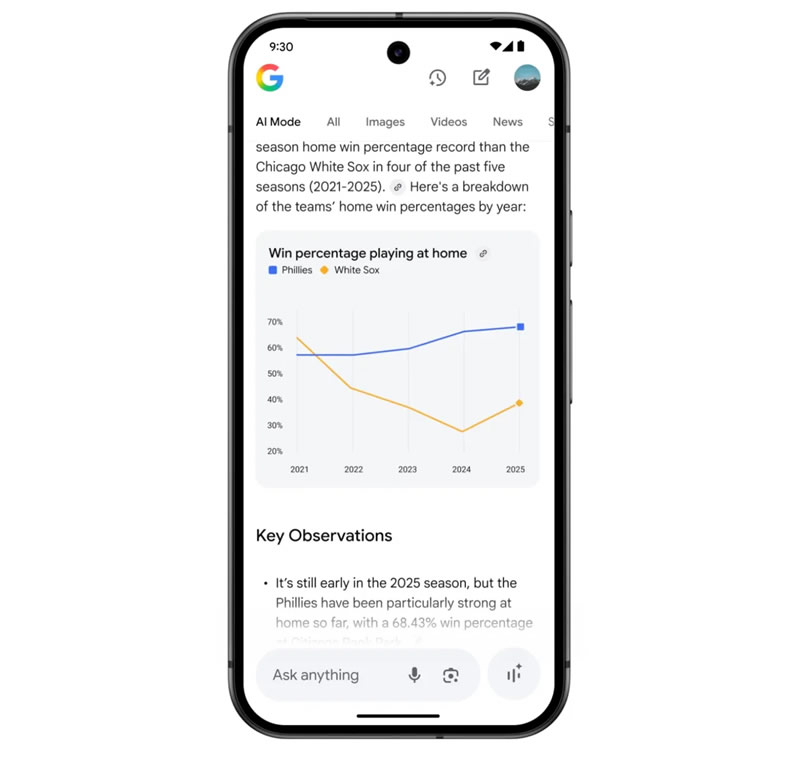

Google объявила о масштабном запуске расширенного поиска с ИИ AI Mode, который позволяет задавать сложные, многоуровневые вопросы и получать развёрнутые ответы с анализом данных. Функция начнёт появляться у пользователей в США, а затем станет доступна во всём мире.

Источник изображений: Google AI Mode строится на основе существующего инструмента AI Overviews, который показывает краткие ИИ-сводки в начале поисковой выдачи. Несмотря на отдельные казусы прошлого, например, совет использовать клей вместо соуса для пиццы, этот формат быстро набрал популярность. По статистике им ежемесячно пользуются более 1,5 миллиарда человек. Как отмечает TechCrunch, теперь AI Overviews выйдет из тестового режима, расширится на 200 стран и получит поддержку более 40 языков.  Новый AI Mode предназначен для сложных запросов, включая сравнение товаров и анализ данных. Он использует технологию Deep Search, которая разбивает вопрос на подтемы и обрабатывает десятки, а то и сотни запросов, чтобы сформировать детальный отчёт со ссылками на источники. Google утверждает, что это реально экономит часы ручного поиска.  Также анонсирован автоматический помощник для покупок, который сможет отслеживать цену на товар и, в случае снижения, уведомить о возможности покупки. Ещё появится функция виртуальной примерки одежды. Пользователи смогут загружать свои фото, а ИИ будет «надевать» на них выбранные вещи в 3D-формате, учитывая комплекцию человека и тип ткани одежды. Функция начнёт тестироваться в Search Labs с сегодняшнего дня. Для обработки информации в AI Mode и AI Overviews используется специальная версия модели Gemini 2.5. В будущем часть функций AI Mode постепенно перейдёт и в AI Overviews. Пользователи смогут задавать вопросы, например, из сферы спорта и финансов, и получать в ответ не просто цифры, а визуализированные графики и таблицы.  Ещё одно нововведение касается интеграции ИИ-агента Project Mariner, который может самостоятельно бронировать билеты, столики в ресторанах и находить в интернете различные мероприятия. А позднее выйдет Search Live — «Живой поиск» — с помощью которого пользователи смогут задавать вопросы посредством камеры смартфона, а ИИ будет отвечать в реальном режиме времени подобно системе мультимодального ИИ-помощника Project Astra. Также будет усилена персонализация. Если подключить Gmail (или другой сервис Google), поисковик будет учитывать предпочтения пользователя и предлагать результаты на основе писем электронной почты. При этом пользователь сам решает, какие приложения подключать, а какие — нет. Google мощно обновила приложение Gemini: изучение мира в реальном времени, улучшенный Deep Research и многое другое

21.05.2025 [12:16],

Павел Котов

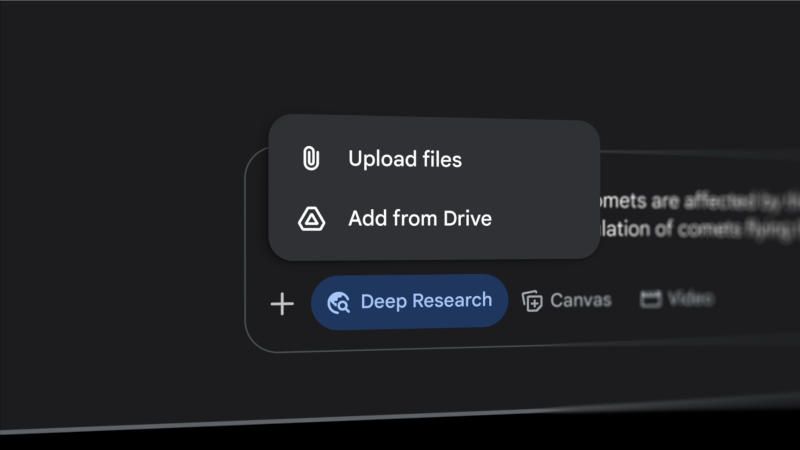

Google рассказала на конференции Google I/O 2025 о новых возможностях чат-бота Gemini с искусственным интеллектом: расширились мультимодальные функции платформы, открылся доступ к новым моделям ИИ, готовится глубокая интеграция с сервисами Google.

Источник изображений: blog.google В очередном обновлении приложения расширились функции Gemini Live для всех её пользователей под Google Android и Apple iOS. Теперь можно беседовать с Gemini в режиме, близком к реальному времени, одновременно транслируя ИИ видео с камеры или экрана смартфона. Во время прогулки по незнакомому городу можно направить камеру телефона на одно из зданий и спросить у Gemini Live о его архитектуре или истории — ИИ-помощник даст ответ почти без задержки. В ближайшие недели начнётся процесс глубокой интеграции Gemini Live с другими приложениями: чат-бот сможет составлять маршруты в «Google Картах», создавать события в «Google Календаре» и списки дел в «Google Задачах». Google активно расширяет возможности Gemini из-за конкурентов, в том числе OpenAI ChatGPT, Apple Siri и других помощников с ИИ. Число чат-ботов постоянно растёт, появляются новые способы взаимодействия с гаджетами и интернетом — под давлением оказываются и продукты крупных компаний, такие как «Google Поиск» и «Google Ассистент». Сегодня, сообщила Google, у Gemini уже 400 млн активных пользователей в месяц, и новые возможности платформы призваны расширить её аудиторию. Компания представила два тарифных плана подписки на ИИ: Gemini Advanced теперь называется Google AI Pro при той же цене $20 в месяц; в дополнение к ней появилась Google AI Ultra за $250 в месяц — прямой конкурент ChatGPT Pro. Подписчикам Google AI Ultra доступны расширенные лимиты сервисов, они первыми смогут опробовать новые модели и эксклюзивно воспользоваться определёнными функциями. Американские подписчики Pro и Ultra, у которых в Chrome в качестве основного выбран английский язык, получат доступ к Gemini прямо в браузере — ИИ будет составлять сводки информации на страницах и отвечать на вопросы о том, что выведено на экран.  Расширились возможности агента искусственного интеллекта Gemini Deep Research, который составляет подробные исследовательские отчёты для пользователей — теперь он поддерживает загрузку файлов PDF и изображений. Для составления более персонализированных отчётов он может, например, сверять эти личные файлы PDF с общедоступными данными; на подходе — прямая интеграция Deep Research с Gmail и «Google Диском». Пользователям бесплатного варианта Gemini открыли доступ к обновлённой модели генерации изображений Imagen 4 — она, по словам Google, более качественно выводит текст. Подписчики Google AI Ultra за $250 в месяц смогут поработать с новейшим генератором видео Veo 3, который в дополнение к изображению теперь генерирует ещё и синхронизированный с картинкой звук. Моделью по умолчанию в Gemini стала Gemini 2.5 Flash — она по сравнению с предшественницей даёт более качественные ответы с меньшей задержкой. Для школьников и студентов Gemini теперь создаёт персонализированные тесты по дисциплинам, которые те хотят более плотно изучить — когда пользователь даёт неправильные ответы, ИИ составляет план действий и генерирует дополнительные тесты, чтобы укрепить знания пользователей в этих областях. Google добавила ИИ-помощника Gemini в Chrome — он сделает сёрфинг в интернете удобнее

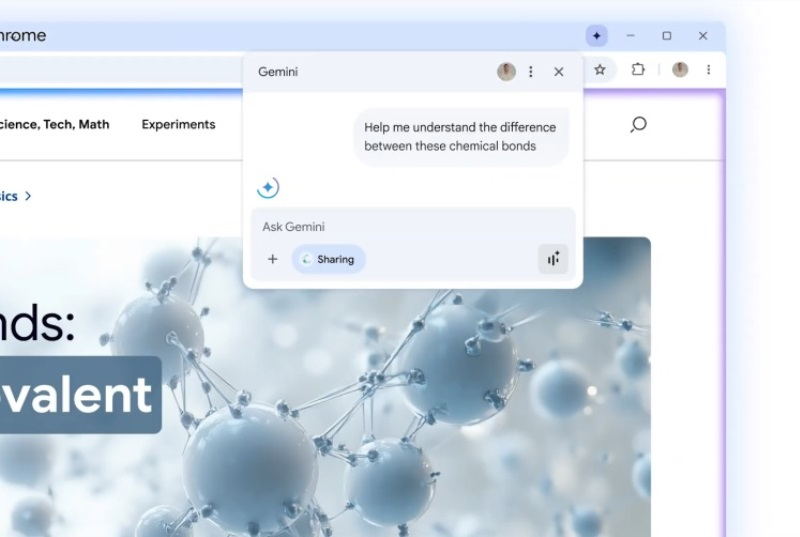

21.05.2025 [11:08],

Владимир Фетисов

Компания Google объявила об интеграции своего ИИ-помощника Gemini в браузер Chrome. В сообщении разработчиков в блоге Google Labs сказано, что на начальном этапе он сможет «уточнять сложную информацию на любой просматриваемой пользователем веб-странице или обобщать её». В перспективе Gemini сможет одновременно «работать на нескольких вкладках и перемещаться по интернет-сайтам от имени пользователя».

Источник изображения: Google Для начала взаимодействия с Gemini необходимо нажать на значок с изображением искры, который располагается в верхнем правом углу браузера. После этого откроется окно для взаимодействия с ИИ-ботом, которое можно перемещать по экрану и менять его размер. В этом окне пользователь может задавать Gemini вопросы о просматриваемых веб-страницах. Перед анонсом этого нововведения Google показала журналистам, как работает ИИ-помощник в Chrome. Представитель компании открыл на маркетплейсе страницу туристического спального мешка и попросил Gemini перечислить ключевые характеристики товара. После этого ИИ-помощник изучил веб-страницу и вывел список с основными характеристиками спального мешка. Затем у Gemini спросили, подходит ли этот спальный мешок для кемпинга в штате Мэн (США). Для ответа на этот вопрос алгоритм брал информацию не только на странице товара, но и на других веб-сайтах. Далее представитель Google перешёл на страницу другого спального мешка и попросил сравнить товары, на что Gemini сформировал и предоставил сравнительную таблицу. На данном этапе пользователи могут взаимодействовать с Gemini, перемещаясь от вкладки к вкладке. Однако позднее в этом году алгоритм научится работать одновременно с несколькими вкладками, предоставляя пользователю информацию с любой из них. В демонстрации для журналистов представитель Google также показал функцию навигации по сайтам с помощью Gemini, которая станет доступной позднее. Распространение обновления, которое принесёт в Chrome ИИ-помощника Gemini, начинается на этой неделе. В первую очередь его получат пользователи Chrome на Windows и macOS старше 18 лет, для которых английский язык является родным, и у которых есть подписка Google AI Pro или Google AI Ultra. В дополнение к этому ИИ-бот станет доступен пользователям бета-версий Chrome на каналах Dev и Canary. Что касается переноса Gemini в мобильный веб-обозреватель, то Google думает над этим. Google научила Meet переводить речь «на лету» с сохранением интонаций и тона голоса

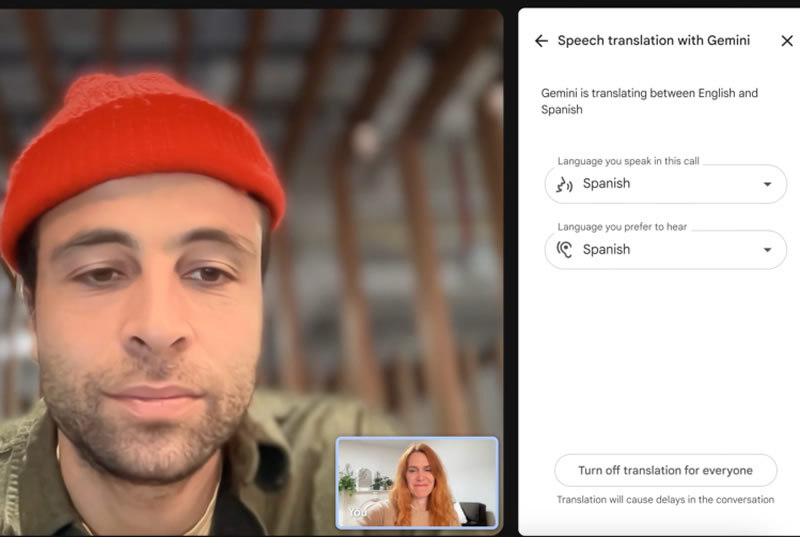

20.05.2025 [23:54],

Анжелла Марина

Google представила на мероприятии I/O новую функцию «живого» перевода для сервиса видеосвязи Google Meet. Технология, построенная на базе искусственного интеллекта Gemini, преобразует речь пользователя на язык, на котором говорит собеседник, при этом сохраняя интонацию и эмоции. Пока функция доступна в бета-режиме.

Источник изображения: Google В демонстрационном ролике один из участников говорил по-английски, другой — по-испански. После активации функции перевода Gemini каждый слышал речь партнёра на своём языке с невероятной интонационной точностью, пишет The Verge. Пока система поддерживает только английский и испанский языки. Однако Google уже анонсировала скорое добавление итальянского, немецкого и португальского. По словам компании, новые языки появятся в ближайшие недели. Аналогичная функция была запущена Microsoft в начале года в приложении для совместной работы Teams, но Google делает акцент на более естественное звучание перевода, подчёркивая, что ИИ не просто переводит текст, а адаптирует голос пользователя так, чтобы его речь звучала органично. Функция тестируется в бета-режиме для подписчиков Google AI Pro и нового тарифа AI Ultra стоимостью $249 в месяц. Окончательная версия может появиться позднее. |