|

Опрос

|

реклама

Быстрый переход

Бесплатным пользователям ChatGPT разрешили генерировать две картинки в день с помощью DALL-E 3

09.08.2024 [16:02],

Анжелла Марина

OpenAI объявила о нововведении в своём сервисе ChatGPT. Теперь пользователи бесплатного тарифа смогут создавать до двух изображений в день с помощью модели DALL-E 3. Это изменение является частью стратегии компании по расширению функциональности своих продуктов.

Источник изображения: Levart_Photographer/Unsplash Версия DALL-E 3, запущенная в сентябре 2022 года, изначально была доступна только подписчикам платного тарифа ChatGPT Plus. Теперь же сервис стал доступен более широкому кругу пользователей, хоть и с некоторыми ограничениями. Помимо расширения доступности сервиса, он также получил новые возможности. Если раньше необходимо было формулировать запросы для создания изображений самостоятельно, то теперь ChatGPT поможет в этом. Надо только попросить его написать тематическую подсказку. Например, Адитья Рамеш (Aditya Ramesh), ведущий исследователь и глава команды DALL-E, попросил ChatGPT помочь ему придумать логотип для кафе, расположенного вблизи гор. Затем, на основе этого короткого запроса, ChatGPT написал более длинную и подробную подсказку, а DALL-E предложил четыре варианта изображений. OpenAI сообщила, что функция бесплатного создания изображений с DALL-E 3 находится в процессе развёртывания. Некоторые пользователи уже получили доступ к этой возможности. В частности, журналист из The Verge смог создать два изображения в приложении ChatGPT для Mac, прежде чем получил уведомление о достижении лимита созданий изображений на день. OpenAI также сделала несколько других важных заявлений. Компания представила оценку безопасности своей модели GPT-4o, добавила нового члена в совет директоров, а генеральный директор Сэм Альтман (Sam Altman) получил письмо от демократов в Конгрессе США с требованием предоставить разъяснения по вопросам безопасности OpenAI. Мобильное приложение ChatGPT благодаря GPT-4o очень быстро наращивает выручку

08.08.2024 [00:16],

Анжелла Марина

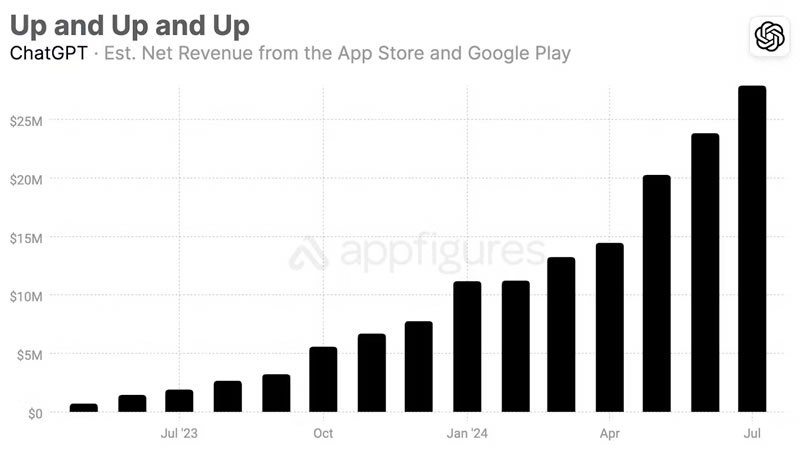

Мобильное приложение ChatGPT от компании OpenAI установило новый рекорд по доходам. Согласно данным аналитической компании Appfigures, чистая выручка приложения за июль составила 28 миллионов долларов, что является самым высоким показателем за месяц с момента запуска приложения.

Источник изображения: Evgeny Opanasenko/Unsplash Основной причиной такого роста стал выпуск новой модели GPT-4o в мае, которая значительно расширила возможности чат-бота. Новая версия способна обрабатывать текст, речь и видео, а также предлагает более быстрое время отклика и возможность прерывания диалога. Также новая нейросеть доступна как платным, так и бесплатным пользователям, что положительно сказывается на аудитории сервиса. До вычета сборов магазинов приложений Apple App Store и Google Play, приложение ChatGPT заработало 28,9 млн долларов в мае, 34 млн долларов в июне и 39,9 млн долларов в июле. Интересно, что 83 % выручки приложения пришлось на App Store от Apple, что на 20 % больше по сравнению с июнем.

Источник изображения: Appfigures По информации Appfigures, спрос на новую технологию способствовал росту выручки приложения на 40 % в мае, и хотя темпы роста немного замедлились, доходы продолжают расти стабильно. В результате, в июле ChatGPT удалось привлечь 2 миллиона новых платных подписчиков, что стало очередным рекордом для мобильного приложения. В OpenAI ожидают, что с внедрением нового расширенного голосового режима, который сможет обеспечить реалистичное взаимодействие практически в реальном времени, интерес к GPT-4o будет только увеличиваться, соответственно рост доходов продолжится в ближайшие месяцы. Intel могла завладеть частью OpenAI в 2017 году, но упустила шанс

07.08.2024 [21:51],

Анжелла Марина

В 2017 году Intel имела возможность приобрести долю в OpenAI, но не воспользовалась этим шансом. Согласно данным Reuters, бывший генеральный директор компании Роберт Свон (Robert Swan) не верил, что модели искусственного интеллекта (ИИ) станут популярными в ближайшее время.

Источник изображения: Rubaitul Azad/Unsplash В отличие от конкурентов, таких как Nvidia и AMD, компания Intel не выделялась на рынке ИИ-продуктов, за исключением некоторых чипов для ноутбуков с нейропроцессорами (NPU). Но теперь выяснилось, что в 2017 и 2018 годах Intel могла приобрести долю в OpenAI, которая в то время была небольшой некоммерческой исследовательской организацией. В обсуждениях фигурировали различные варианты инвестиций, включая покупку 15 % акций за 1 миллиард долларов или приобретение доли с одновременной продажей аппаратного обеспечения для OpenAI по себестоимости, пишет издание Tom's Hardware. Однако, по словам информированных источников, Свон якобы отказался от сделки, поскольку не увидел перспектив быстрого выхода ИИ-моделей на массовый рынок, что, по его мнению, означало бы отсутствие возврата инвестиций. Кроме того, подразделение Intel по работе с центрами обработки данных «не хотело производить продукцию по себестоимости». Свон прогадал. В 2022 году OpenAI сумела запустить ChatGPT, который моментально вызвал огромный интерес и получил широкое признание. Интересно, что для OpenAI сотрудничество с Intel означало бы меньшую зависимость от Nvidia, которая впоследствии стала лидером на рынке ускорителей вычислений для ИИ. Вместо Intel, Microsoft подсуетилась и инвестировала миллиарды долларов в OpenAI в 2019, 2021 и 2023 годах, превратив компанию в крупнейшего игрока на рынке ИИ. В последнее время Intel испытывает финансовые трудности. Подразделение дата-центров и ИИ (DCAI) недавно сообщило о снижении выручки и операционного дохода. Тем не менее, процессоры Xeon Sierra Forest уже запущены в массовое производство, а поставки процессоров Xeon Granite Rapids начнутся в ближайшее время. Также Intel заявила, что её ускорители для ИИ Gaudi 3 будут запущены во второй половине года и уже более 20 клиентов готовы их закупить. Напомним, будучи генеральным директором Intel с 2018 года по 2021 год, Роберт Свон часто подвергался критике за отсутствие технической хватки. Ранее он занимал должность финансового директора компании, уделяя больше внимания финансам, чем технологиям. GPT-5 придётся подождать — нейросеть нового поколения не представят на грядущей OpenAI DevDay

06.08.2024 [16:44],

Павел Котов

В прошлом году OpenAI провела в Сан-Франциско крупное мероприятие, на котором анонсировала множество новых продуктов, включая GPT Store как своего рода альтернативу Apple App Store. В этом году компания выбрала другой формат презентаций — это будет серия выездных мероприятий для разработчиков. И анонса флагманской модели искусственного интеллекта на них можно не ждать — компания расскажет об обновлениях API и новых сервисах для разработчиков.

Источник изображения: Mariia Shalabaieva / unsplash.com «Мы не планируем анонса нашей следующей модели на DevDay. Сосредоточимся на обучении разработчиков тому, что доступно, и на демонстрации историй сообщества разработчиков», — заявил представитель OpenAI ресурсу TechCrunch. Мероприятия OpenAI DevDay в этом году пройдут 1 октября в Сан-Франциско, 30 октября в Лондоне и 21 ноября в Сингапуре. В их рамках компания проведёт семинары, сессии, демонстрации с продуктами OpenAI и инженерами компании, ожидаются также выступления самих разработчиков. Регистрация стоит $450 (для некоторых стипендиатов она будет бесплатной), приём заявок завершится 15 августа. В последние месяцы OpenAI, от которой ждут крупных прорывов, ограничивается небольшими шагами в области генеративного ИИ — компания настраивает и оттачивает работу своих нынешних ведущих моделей GPT-4o и GPT-4o mini, снижая частоту сбоев. Но по этой же причине она начинает утрачивать лидерство в отрасли как минимум по отдельным показателям. Одной из причин может быть отсутствие доступа к качественным данным для обучения ИИ — всё больше ресурсов блокируют доступ веб-сканеров, и, по некоторым оценкам, в период с 2026 по 2032 гг. у разработчиков ИИ могут закончиться данные для обучения систем. Для преодоления этой проблемы OpenAI заключает соглашения с издателями и операторами данных, чтобы защититься от вероятных исков о нарушении авторских прав. Кроме того, инженеры компании меняют архитектуру систем ИИ — ведётся работа над революционным проектом под кодовым именем Strawberry: нейросети научатся рассуждать и решать математические задачи. С другой стороны, смена стратегии может указывать, что OpenAI стала серьёзнее относиться к вопросам безопасности — есть мнение, что ранее для неё был важнее быстрый выпуск новых мощных продуктов. Соучредитель OpenAI Джон Шульман перешёл в Anthropic, а президент Грег Брокман взял длительный отпуск

06.08.2024 [11:20],

Павел Котов

Сооснователь OpenAI Джон Шульман (John Schulman) объявил о переходе в конкурирующую компанию Anthropic, а президент Грег Брокман (Greg Brockman) решил взять длительный отпуск, чтобы «отдохнуть и зарядиться» — он продлится до конца года. Некоторое время назад компанию также покинул менеджер по продуктам Питер Денг (Peter Deng) — он начал работать в OpenAI в прошлом году, а до того занимал аналогичные должности в Meta✴, Uber и Airtable.

Источник изображения: Mariia Shalabaieva / unsplash.com «Мы признательны за вклад Джона как члена команды основателей OpenAI и его ревностные усилия в развитии технологий согласования. Его страсть и упорный труд заложили прочную основу, которая будет вдохновлять и поддерживать будущие инновации в OpenAI и более широкой области», — приводит TechCrunch комментарий представителя OpenAI по поводу уходу Шульмана. Сам Шульман пояснил своё решение желанием вплотную заняться согласованием ИИ — разработкой мер, направленных на то, чтобы ИИ вёл себя, как задумано, — и переключиться на практическую техническую работу. «Я решил заняться этим в Anthropic, где, как считаю, могу получить новые перспективы и проводить исследования вместе с людьми, глубоко вовлечёнными в темы, которые меня интересуют больше всего. Уверен, что OpenAI и отделы, в которых я работал, продолжат процветать и без меня», — пояснил инженер. Шульман начал работать в OpenAI вскоре после получения докторской степени по электротехнике и компьютерным наукам в Калифорнийском университете в Беркли. Он сыграл ключевую роль в разработке ChatGPT, возглавив отдел OpenAI по обучению с подкреплением — настройке моделей генеративного ИИ для выполнения пользовательских запросов. После ухода специалиста по безопасности ИИ Яна Лейке (Jan Leike), который сейчас также работает в Anthropic, Шульман возглавил научный отдел по согласованию ИИ — и пока неясно, кто заменит его на этой должности. Есть мнение, что OpenAI пренебрегает мерами безопасности в отношении ИИ, но Шульман выдвигать обвинений не стал. «Руководство компании было очень привержено вложениям [в разработку технологий согласования ИИ]. Моё решение — личное, основанное на том, чем я хочу заниматься на новом этапе своей карьеры», — заявил он. Теперь в OpenAI остались лишь три человека, стоявшие у истоков компании: гендиректор Сэм Альтман (Sam Altman), Грег Брокман и Войцех Заремба (Wojciech Zaremba) — глава подразделения по генерации языка и кода. «Спасибо за всё, что ты сделал для OpenAI! Ты блестящий учёный, глубокий мыслитель о продуктах и обществе и, самое главное, большой друг для всех нас. Будем очень скучать по тебе, а ты будешь этим местом гордиться», — обратился к Шульману Сэм Альтман. Илон Маск подал в суд на OpenAI и Сэма Альтмана, снова

06.08.2024 [04:27],

Анжелла Марина

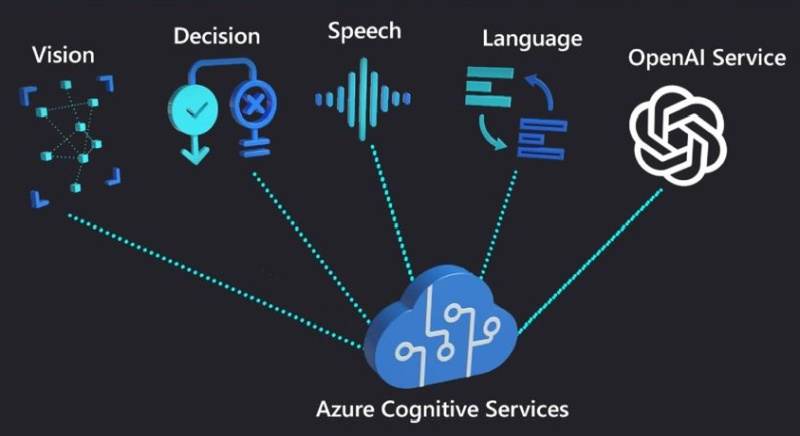

Глава Tesla Илон Маск (Elon Musk) вновь инициировал судебный процесс против OpenAI и его генерального директора Сэма Альтмана (Sam Altman) в федеральном суде США. В иске Маск утверждает, что действия OpenAI нарушают его права и интересы, а при учреждении OpenAI он был введён в заблуждение.

Источник изображения: Mariia Shalabaieva/Unsplash В основе претензий Маска лежит его убеждение, что Альтман и нынешний президент OpenAI Грег Брокман (Greg Brockman) обманным путём убедили его, чтобы он стал соучредителем компании по искусственному интеллекту, основываясь на том, что компания будет некоммерческой. В иске утверждается, что после того, как Маск присоединился к проекту и инвестировал миллионы долларов, он был «предан Альтманом и его союзниками [Microsoft]», которые «создали непрозрачную сеть коммерческих филиалов OpenAI, занимающихся безудержным самообогащением». «Вероломство и обман имеют шекспировские масштабы», — говорится в иске. Интересно, что претензии в новом иске аналогичны другому иску, поданному не так давно Маском против OpenAI и Альтмана в окружной суд Северной Калифорнии, который глава Tesla и SpaceX в конечном итоге отозвал. Тогда Маск выражал обеспокоенность по поводу развития искусственного интеллекта и его потенциальных угроз человечеству, а также утверждал, что OpenAI, с момента перехода в коммерческую сферу, отклонилась от своих первоначальных целей и принципов, что, по его мнению, ставит под угрозу безопасность и этичность технологий ИИ. «OpenAI больше не придерживается тех принципов, которые были заложены при его создании», — заявил Маск, указав на то, что коммерческие интересы организации превалируют над общественными. В иске также утверждается, что Microsoft была вовлечена в эту ситуацию. Указывая на OpenAI как на некоммерческую организацию без акционеров, Microsoft, вложившая в компанию 13 миллиардов долларов, «стремилась получить рычаги влияния другими способами, в частности призывая OpenAI использовать и стать единым целым с её облачной вычислительной системой Azure». Хотя Маск выразил свою симпатию генеральному директору Microsoft Сатье Наделле (Satya Nadella), ценности компании и OpenAI не совпадают, говорится в иске. OpenAI скрывает технологию распознавания текста, написанного ChatGPT — она может распугать пользователей

05.08.2024 [12:54],

Владимир Мироненко

У OpenAI есть технология, позволяющая распознать с точностью 99,9 % текст, написанный ChatGPT, но разработчик не стал делать её доступной для общественности, пишет The Wall Street Journal. В компании есть опасения, что размещение инструмента для определения факта использования ChatGPT может повлечь за собой отказ части аудитории от применения её ИИ-решений.

Источник изображения: Growtika/unsplash.com Дискуссия по этому поводу длилась в OpenAI порядка двух лет, сообщил источник в WSJ. Сотрудники OpenAI колебались между выбором придерживаться заявленной компанией приверженностью прозрачности в работе и желанием привлекать и удерживать пользователей. Также есть опасения, что использование инструмента может непропорционально повлиять на группы пользователей, которые не являются носителями английского языка. Один из опросов, проведённых компанией среди лояльных пользователей ChatGPT, показал, что почти треть откажется от использования ИИ-бота или станет реже прибегать к нему, если будет предложен этот инструмент. Предлагаемая технология позволяет оставлять в тексте водяные знаки, невидимые для человеческого глаза, которые можно распознать с помощью технологии обнаружения OpenAI. Эта технология позволяет определить, что весь текст или его часть были написаны ChatGPT. Вместе с тем сотрудники выразили обеспокоенность тем, что водяные знаки можно стереть с помощью довольно простых способов, например, сделав перевод текста с помощью Google Translate на другой язык и обратно или добавив эмодзи в текст с последующим их ручным удалением. В обсуждениях возможности использования инструмента для борьбы с мошенничеством с ИИ принимали участие гендиректор OpenAI Сэм Альтман (Sam Altman) и технический директор Мира Мурати (Mira Murati), но окончательное решение так и не было принято. Как сообщают источники WSJ, в начале июня топ-менеджеры и исследователи OpenAI провели встречу, чтобы обсудить проект. Участники встречи пришли к согласию по поводу эффективности технологии использования водяных знаков для определения авторства написания текста, но окончательное решение так и не было принято, поскольку результаты опроса пользователей ChatGPT в прошлому году вызывают опасения по поводу потери аудитории. Компания Google тоже разработала технологию нанесения водяных знаков, получившую название SynthID, которая позволяет обнаруживать текст, созданный с помощью Gemini AI. В настоящее время технология проходит бета-тестирование и пока недоступна для общественности. Крупнейшие интернет-издания заблокировали доступ ИИ-поисковику OpenAI SearchGPT к своим материалам

04.08.2024 [15:46],

Дмитрий Федоров

Более 14 крупнейших новостных изданий из топ-1000 закрыли доступ к своим материалам для ИИ-поисковика SearchGPT компании OpenAI через неделю после его запуска. Это решение может повлиять на полноту и точность результатов поисковой выдачи SearchGPT, а также вызывает вопросы о доверии к OpenAI и её практике использования данных.

Источник изображения: Growtika / Unsplash.com Около недели назад OpenAI запустила ИИ-поисковик SearchGPT, но уже 14 из 1000 крупнейших новостных сайтов, включая The New York Times, Wired, The New Yorker, Vogue, Vanity Fair и GQ, успели заблокировать работу его поискового робота. Бот OAI-SearchBot индексирует информацию, чтобы SearchGPT мог выдавать пользователям релевантные результаты. По данным компании Originality.ai, следящей за подобными блокировками, это решение оказалось неожиданным. Джон Гиллам (Jon Gillham), генеральный директор Originality.ai, выразил недоумение по поводу этой ситуации: «Я не понимаю, зачем издатели его блокируют. Им нужен этот трафик». OpenAI подчеркнула, что OAI-SearchBot не собирает данные для обучения ИИ-моделей, таких как GPT-5, и рекомендовала владельцам сайтов разрешить работу бота для обеспечения видимости сайтов в результатах поиска. По мнению OpenAI, это поможет ресурсам оставаться в поисковой выдаче и привлекать больше трафика. Однако отсутствие доступа к некоторым веб-сайтам может сделать поисковую выдачу SearchGPT менее полной, чем у Google. Другой поисковый бот OpenAI, GPTbot, который собирает данные для обучения ИИ-моделей, уже заблокирован сотнями сайтов. Это решение более понятно, ведь издатели хотят получать трафик от поисковых систем, но не желают делиться контентом для обучения ИИ. OpenAI потратила годы на сбор данных в интернете без разрешения, поэтому недоверие к компании может быть одной из причин блокировки. Гиллам предполагает, что издатели могут не доверять заявлению OpenAI о том, что её новый бот не собирает данные для обучения ИИ-моделей. Другой причиной может быть желание избежать ситуации, когда новые ИИ-поисковики, чтобы удержать пользователей, показывают им краткое содержание материалов, а не перенаправляют их на оригинальные сайты, что снижает трафик и доход издателей. Гиллам также отметил, что OpenAI в этом году активно заключала сделки с издателями на использование их архивных материалов. Это может выглядеть как продуманная стратегия OpenAI: сначала наладить отношения с издателями через партнёрские соглашения, а затем объявить о запуске SearchGPT. Издание The New York Times выступило главным противником OpenAI среди издателей, подав иск против неё и Microsoft. Издательство утверждает, что эти две технологические компании незаконно используют её материалы для создания конкурирующих продуктов. Как заявил Чарли Стадтландер (Charlie Stadtlander), представитель The New York Times: «The Times не разрешает использование своих материалов для генеративного поиска или обучения ИИ без письменного соглашения, независимо от того, блокируем ли мы доступ какому-либо боту к нашему контенту или нет». В жалобе на OpenAI и Microsoft, The New York Times подчеркнула, что поисковые системы с ИИ потенциально могут отбирать трафик у издателей, ухудшая их финансовое положение: «Предоставляя контент The Times без разрешения, инструменты ответчиков подрывают отношения The Times с читателями и лишают доходов от подписки, лицензирования, рекламы и партнёрских программ». «Ответчики также используют поисковик Bing компании Microsoft, копирующий и классифицирующий онлайн-контент The Times для генерации ответов с дословными выдержками и подробными резюме статей The Times, которые гораздо длиннее и детальнее, чем те, что выдают традиционные поисковые системы», — говорится в жалобе издательства. Появление SearchGPT и реакция издателей показывают сложность взаимоотношений между ИИ-технологиями и традиционными СМИ. Недоверие к OpenAI и желание защитить свои доходы подталкивают издателей к принятию мер предосторожности. В будущем нам предстоит наблюдать, как эти противоречия будут разрешаться и какое влияние это окажет на доступность и качество информации в интернете. Apple подтвердила, что интеграция ChatGPT в iOS 18 состоится в этом году

03.08.2024 [23:49],

Анжелла Марина

Компания Apple официально подтвердила планы по интеграции ChatGPT в свои устройства до конца текущего года. Генеральный директор Apple Тим Кук (Tim Cook) заявил: «ChatGPT будет интегрирован к концу календарного года».

Источник изображения: Felix Fischer/Unsplash Впервые Apple заявила об интеграции ChatGPT в свои устройства во время выступления на WWDC в июне, и комментарий Кука указывает на то, что эти сроки остаются в силе по состоянию на первую неделю августа. Как сообщает Macrumors, пользователи iPhone, iPad и Mac смогут использовать ChatGPT через голосового помощника Siri и функцию Apple Writing Tools. Интеграция позволит генерировать текст и изображения с использованием новейшей модели OpenAI GPT-4o. Apple подчёркивает, что использование ChatGPT будет бесплатным и не потребует создания учётной записи в OpenAI, однако подписчики ChatGPT Plus смогут подключать свои аккаунты для доступа к платным функциям. Компания также заверяет, что OpenAI не будет хранить запросы пользователей, а их IP-адреса будут скрыты. Для работы функций Apple Intelligence потребуется iPhone 15 Pro или Pro Max, либо Mac или iPad с чипом M1 или новее. Изначально поддерживаться будет только английский язык, тем не менее поддержка других языков появится несколько позднее, в течение следующего года. Ожидается, что полный набор функций Apple Intelligence станет доступен с выходом iOS 18.4 примерно в марте 2025 года. Новая технология позволит пользователям обобщать текст, управлять уведомлениями, генерировать с помощью ИИ эмодзи и изображения, а также использовать улучшенную версию Siri с более глубоким пониманием контекста речи. Напомним, ранее на этой неделе функции Apple Intelligence стали доступны разработчикам для тестирования в бета-версии iOS 18.1, но интеграции ChatGPT от OpenAI там пока нет. TikTok является одним из крупнейших клиентов Microsoft в сфере облачных ИИ-вычислений

01.08.2024 [17:42],

Владимир Фетисов

По сообщениям сетевых источников, сервис коротких видео TikTok, принадлежащий китайской компании ByteDance, является одним из крупнейших клиентов Microsoft в сфере облачных вычислений искусственного интеллекта. По состоянию на март TikTok платил Microsoft почти $20 млн в месяц за доступ к ИИ-алгоритмам OpenAI. Однако в скором времени это может измениться, если ByteDance создаст собственные нейросети.

Источник изображения: antonbe/Pixabay В прошлом году СМИ писали, что ByteDance «тайно использует» алгоритмы OpenAI для разработки своей большой языковой модели (LLM). В сфере разработки ИИ-технологий такой подход осуждается многими компаниями. Кроме того, это прямое нарушение пользовательского соглашения OpenAI, в котором сказано, что генерируемый нейросетями контент не может использоваться «для создания языковых моделей, конкурирующих с продуктами и услугами разработчика». Microsoft, через которую ByteDance получает доступ к алгоритмам OpenAI, придерживается аналогичной политики. После появления сообщений о том, что ByteDance использует ИИ-алгоритмы OpenAI для создания своей языковой модели, действие аккаунта китайской компании было приостановлено. OpenAI объяснила это необходимостью провести расследование, чтобы установить факт нарушения лицензионного соглашения. Тогда же представитель ByteDance в беседе с журналистами CNN сообщил, что компания использует технологии «в очень ограниченном объёме» для разработки собственных языковых моделей. Microsoft заключила с OpenAI многомиллиардное инвестиционное соглашение, делающее софтверного гиганта эксклюзивным поставщиком облачных ИИ-вычислений. Кроме того, Microsoft пришлось потратить «несколько сотен миллионов долларов» на создание суперкомпьютера для обеспечения работы алгоритма ChatGPT. В опубликованном на этой неделе финансовом отчёте Microsoft за четвёртый квартал 2024 финансового года сказано, что доходы облачного подразделения Azure выросли на 29 %, что лишь немногим меньше прогнозируемых ранее 30-31 %. Microsoft официально признала в OpenAI конкурента в области ИИ и поисковых технологий

01.08.2024 [16:38],

Николай Хижняк

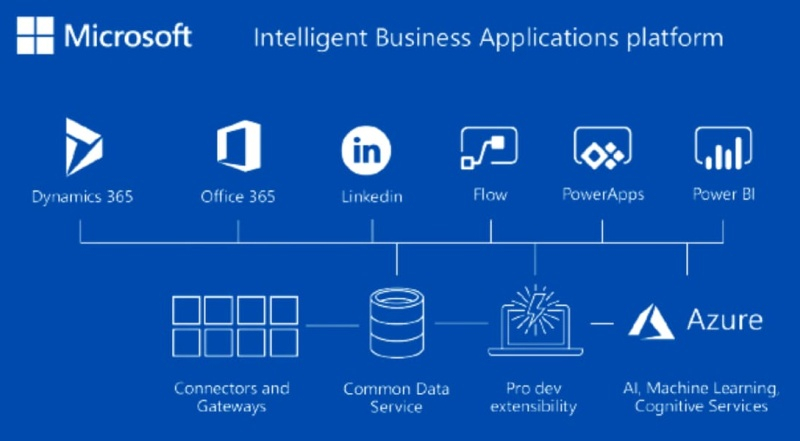

Отношения между Microsoft и OpenAI официально стали более сложными. Microsoft добавила стартап в области искусственного интеллекта в список конкурентов в своём последнем годовом отчёте. В этот список на протяжении многих лет входили Amazon, Apple, Google и Meta✴ — компании со значительно более крупной капитализацией по сравнению с OpenAI.

Источник изображения: CNBC У Microsoft долгосрочное партнёрство с OpenAI. Она выступает в качестве её эксклюзивного поставщика облачных услуг и использует её модели ИИ в своих продуктах для коммерческого и потребительского рынков. Также Microsoft является крупнейшим инвестором OpenAI. Редмондский гигант инвестировал в стартап по разработке технологий искусственного интеллекта 13 миллиардов долларов, пишет CNBC. Однако появление OpenAI в официальном списке конкурентов Microsoft означает, что кто-то в конечном итоге перешёл другому дорогу. В своём отчёте Microsoft указала OpenAI, создателя чат-бота ChatGPT, как конкурента в предложениях ИИ, а также в поисковой и новостной рекламе. На прошлой неделе OpenAI анонсировала прототип поисковой системы SearchGPT. Некоторые компании напрямую сотрудничают с OpenAI для получения доступа к возможностям её ИИ-моделей. Другие используют службу Azure OpenAI от Microsoft. Для тех, кто ищет альтернативу ChatGPT, чат-бот Copilot от Microsoft также доступен через поисковую систему Bing и в операционных системах Windows. Представитель OpenAI в разговоре с CNBC сообщил, что в отношениях между двумя компаниями ничего не изменилось, и что их партнёрство было установлено с пониманием того, что рано или поздно они станут конкурентами. Он добавил, что Microsoft остаётся надёжным партнёром OpenAI. Глава Microsoft Сатья Наделла (Satya Nadella) и руководитель OpenAI Сэм Альтман (Sam Altman) поддерживают дружеские отношения. Ранее Наделла был шокирован тем, что Альтмана выгнали из компании, в которую он впоследствии вернулся. «Одна из вещей, которая мне нравится в Сэме, так это то, что он каждый день звонит мне и говорит: мне нужно больше, больше, больше идей», — поделился Наделла в недавнем интервью The New York Times. Microsoft шокировала инвесторов, признав, что окупаемость ИИ потребует значительно больше времени

31.07.2024 [20:08],

Сергей Сурабекянц

Вчера Microsoft снизила прогноз квартального роста своей облачной платформы Azure и одновременно сообщила о существенном увеличении капитальных затрат. Аналитики полагают, что это ещё один признак того, что окупаемость гигантских инвестиций в ИИ может занять значительно больше времени, чем предполагалось ранее. Реагируя на сообщение Microsoft, акции компании упали на 7 %, но затем отыграли 4 % после прогноза о росте Azure во второй половине 2025 финансового года.  Microsoft благодаря сотрудничеству с OpenAI является одним из лидеров в области генеративного ИИ и вкладывает значительные средства в расширение своей сети центров обработки данных. По оценкам экспертов, в третьем квартале 2024 года рост Azure окажется в диапазоне от 28 % до 29 %, что ниже прежнего прогноза в 29,7 %. Выручка Azure в четвёртом финансовом квартале 2023 года, завершившемся 30 июня, выросла на 29 % при прогнозе в 30,6 %.

Источник изображений: Microsoft Этот разочаровывающий рост повлиял на капитализацию других крупных технологических компаний. Акции Amazon упали на 3,4 %, а акции Meta✴ — на 3 %, поскольку инвесторы опасаются, что миллиарды долларов, потраченные на инфраструктуру ИИ, не принесут ожидаемой отдачи в краткосрочной перспективе. «Уолл-стрит не обладает большим терпением. Они видят, что вы тратите миллиарды долларов, и хотят увидеть увеличение доходов на эту сумму, — пояснил Дэниел Морган (Daniel Morgan), старший портфельный менеджер Synovus Trust, владеющей акциями Microsoft. — Если эти компании не превзойдут ожидания и не окажутся намного лучше, чем предполагалось, они будут отброшены назад». Акции Microsoft выросли почти на 25 % за последние 12 месяцев, но быстро потеряли 10 % от рекордного максимума 5 июля на фоне ухудшившихся прогнозов об окупаемости ИИ, разочаровывающих результатов производителя электромобилей Tesla и прогноза Alphabet о более высоких расходах. Капитальные затраты Microsoft в четвёртом финансовом квартале 2023 года выросли на 77,6 % до $19 млрд. Вице-президент Microsoft по связям с инвесторами Бретт Иверсен (Brett Iversen) сообщил, что компания продолжает наращивать расходы, чтобы удовлетворить «сильный потребительский спрос». Эти расходы были необходимы компании для расширения глобальной сети центров обработки данных и преодоления ограничений мощности, которые мешали её усилиям по удовлетворению спроса на ИИ.  На долю услуг ИИ пришлось 8 процентных пунктов роста Azure за второй квартал 2024 года по сравнению с 7 процентными пунктами в первом. Microsoft не раскрывает абсолютные цифры доходов бизнеса Azure, который лучше всего подходит для извлечения выгоды из растущего интереса к ИИ. «Вклад ИИ продолжает расти каждый квартал, несмотря на некоторые ограничения возможностей ИИ, о которых мы говорили в апреле, — заявил Иверсен. — Интерес и спрос на ИИ продолжают оставаться важным фактором». Совокупная выручка подразделения Intelligent Cloud, в которое входит платформа облачных вычислений Azure, выросла в четвёртом финансовом квартале на 19 % до $28,5 млрд, что ниже оценок аналитиков в $28,68 млрд. Выручка от бизнеса по производству ПК, включая игровые приставки Xbox и устройства Surface, выросла на 14 % до $15,9 млрд. Microsoft внедрила ИИ практически в каждый продукт, от поисковой системы Bing до офисного программного обеспечения и ИИ-помощника 365 Copilot. Большая часть разработок основана на технологиях компании OpenAI, в которую Microsoft уже инвестировала около $13 млрд. Рост продаж подразделения производительности, куда входит Office, LinkedIn и 365 Copilot, составил 11 % вместо ожидаемых 10 %.  Общий доход Microsoft вырос в четвёртом финансовом квартале увеличился на 15 % до $64,7 млрд, превысив ожидания аналитиков в $64,39 млрд. OpenAI открыла доступ к гиперреалистичному голосу ChatGPT некоторым платным пользователям

31.07.2024 [13:14],

Павел Котов

OpenAI начала развёртывать голосовой интерфейс Advanced Voice Mode для сервиса ChatGPT — доступ к гиперреалистичным диалогам с GPT-4o получило небольшое число подписчиков ChatGPT Plus. Разработчик пообещал, что к осени новой функцией смогут пользоваться все обладатели платной подписки.

Источник изображения: Mariia Shalabaieva / unsplash.com Впервые OpenAI продемонстрировала голосовой формат GPT-4o в мае — тогда эта функция поразила аудиторию не только способностью давать быстрые ответы, но и сходством одного из голосов с голосом Скарлетт Йоханссон (Scarlett Johansson). Актриса заявила, что отказала главе компании Сэму Альтману (Sam Altman) в праве использовать её голос для этих целей; после чего ей пришлось обратиться к юристам для защиты своих интересов, и в OpenAI отказались от своих намерений, чтобы не доводить дело до конфликта. В июне компания сообщила, что отложит выпуск голосового интерфейса, чтобы завершить разработку мер безопасности. Анонсированные ранее функции ИИ-помощника, такие как поддержка видео и демонстрация экрана, на этапе альфа-тестирования доступны не будут, а появятся «позже». Пока пользователям придётся ограничиться голосовым взаимодействием. Ранее для реализации этой функции OpenAI подключала три модели ИИ: одну для преобразования голоса в текст, вторую (GPT-4) для собственно обработки запросов, а третью для преобразования текстового ответа ChatGPT в голос. Обновлённая GPT-4o является мультимодальной — она решает все эти задачи самостоятельно, обеспечивая минимальную задержку. Модель также способна распознавать в голосе пользователя эмоциональные интонации, определяя, например, грусть или волнение, она также знает, когда человек поёт.

Источник изображения: Growtika / unsplash.com OpenAI будет развёртывать голосовой интерфейс ChatGPT постепенно, чтобы внимательно следить, как он используется в действительности. Включённые в группу альфа-тестирования пользователи получат уведомление через приложение ChatGPT, за которым последует письмо с инструкциями по работе с новыми функциями. К настоящему моменту голосовые возможности GPT-4o протестированы более чем сотней членов закрытой команды тестирования Red Team, говорящих на 45 языках. Голосовой режим ChatGPT будет ограничен четырьмя голосами: Juniper, Breeze, Cove и Ember, которые были созданы при участии актёров. Голос Sky, который сравнивали с голосом Скарлетт Йоханссон, компания исключила. OpenAI также сообщила, что установила фильтры для блокировки запросов на создание музыки и других материалов, которые могут быть защищены авторским правом — для стартапов Suno и Udio это закончилось судебными исками от крупных музыкальных издателей. Без новых инвестиций OpenAI может обанкротиться уже через 12 месяцев

28.07.2024 [16:50],

Владимир Мироненко

Стартап OpenAI, разработавший чат-бот с генеративным искусственным интеллектом ChatGPT, с выхода которого начался бум на рынке ИИ, ежегодно тратит на разработку технологий и персонал миллиарды долларов, пишет ресурс The Information. По мнению некоторых аналитиков, из-за огромных расходов компания может оказаться на грани банкротства уже через 12 месяцев.

Источник изображения: Andrew Neel/unsplash.com Ранее сообщалось, что только на поддержку функционирования ChatGPT компания тратит ежедневно порядка $700 тыс. И эта сумма в дальнейшем будет расти. Согласно публикации The Information, основанной на ранее нераскрытых финансовых данных, OpenAI израсходует в этом году на обучение ИИ-моделей $7 млрд, в то время как её расходы на персонал составят $1,5 млрд. Издание пишет, что убытки OpenAI за год могут составить $5 млрд, и если она не привлечёт дополнительный капитал, у неё могут закончиться деньги через 12 месяцев. «Инвесторы должны спросить: в чем их выгода? Уникальная технология? Каков её путь к прибыльности, когда Meta✴ раздаёт аналогичные технологии бесплатно?», — пишет один из экспертов. Это далеко не первая публикация о том, что OpenAI может столкнуться с финансовыми проблемами. В прошлом году ресурс The Economic Times писал, что высокие затраты на обучение ИИ-моделей могут привести компанию к банкротству. OpenAI получает в год до $2 млрд выручки от использования ChatGPT и около $1 млрд за предоставление компаниям доступа к большим языковым моделям (LLM), но это едва покрывают её операционные расходы, сообщил The Information. Следует отметить, что это нисколько не волнует гендиректора OpenAI Сэма Альтмана (Sam Altman). «Мне всё равно, если мы потратим $50 млрд в год, мы создаём сильный искусственный интеллект (AGI), и это того стоит», — заявил он однажды. Ресурс The Information указал на ещё одну проблему, грозящую бизнесу OpenAI упадком, — это растущее число отраслевых аналитиков, считающих генеративный ИИ пузырём, который лопнет в течение следующих 12 месяцев. У некоторых инвесторов также возник вопрос по поводу того, как долго Nvidia сможет продолжать свой огромный рост, который вывел её на третью позицию в мировом рейтинге компаний по величине рыночной стоимости, поскольку ажиотаж вокруг генеративного ИИ продолжается, несмотря на неспособность окупить инвестиции, галлюцинации и потребность в большем количестве ЦОД для обработки ИИ-нагрузок. ИИ-поисковик SearchGPT от OpenAI начал обманывать с первого дня работы

26.07.2024 [15:46],

Анжелла Марина

OpenAI запустила собственную поисковую систему SearchGPT на базе искусственного интеллекта, которая выдаёт на запросы пользователей актуальные и релевантные ответы в виде цитат из проверенных источников. Первые результаты использования SearchGPT оказались не самыми впечатляющими.

Источник изображения: Growtika/Unsplash.com По сообщению The Verge, пользователи выявили свойственную многим ИИ-системам тенденцию галлюцинаций. SearchGPT показывает результаты, которые в основном либо неверны, либо бесполезны. Так, журналист Маттео Вонг (Matteo Wong) из популярного американского журнала The Atlantic провёл своё тестирование. Он ввёл поисковый запрос «Music festivals in Boone North Carolina in august» (Музыкальные фестивали в Буне, Северная Каролина, в августе), после чего получил список мероприятий, которые по мнению SearchGPT, должны пройти в Буне в августе. Первым в списке оказался фестиваль An Appalachian Summer Festival, который, по данным ИИ, проведёт цикл художественных мероприятий с 29 июля по 16 августа. Однако реальность оказалась несколько иной: фестиваль начался 29 июня, а последний концерт состоится 27 июля, а не 16 августа. OpenAI запустила SearchGPT в сотрудничестве с крупнейшими новостными изданиями, такими как Associated Press, Financial Times, Business Insider и другими. Некоторые сделки обошлись компании в миллионы долларов. Многие издатели серьёзно обеспокоены тем, как ИИ-поиск может повлиять на их бизнес. Есть опасения, что SearchGPT или Google AI Overviews будут выдавать слишком исчерпывающие ответы, устраняя необходимость переходить по ссылкам на статьи и лишая тем самым издателей трафика. Несмотря на опасения, компании видят смысл в сотрудничестве с OpenAI в целях продажи доступа к своему контенту. Тем более, что по заявлению OpenAI, издателям будет предоставлена возможность управлять тем, как их контент будет отображаются в SearchGPT. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |