|

Опрос

|

реклама

Быстрый переход

Samsung готова усилить собственные разработки ИИ-моделями с открытым исходным кодом

31.08.2025 [08:25],

Алексей Разин

Сфера искусственного интеллекта развивается настолько стремительно, что не все компании могут себе позволить участвовать в этой технологической гонке, выделяя пропорциональное количество ресурсов. Samsung сочла разумным «гибридный» подход к развитию инфраструктуры ИИ, комбинируя собственные разработки с внешними языковыми моделями, использующими открытый исходный код.

Источник изображения: Unsplash, OMK На уходящей неделе Ро Тхэ Мун (Roh Tae-moon), президент подразделения Device Experience, в своём обращении к сотрудникам Samsung Electronics пояснил специфику курса компании в этой области соображениями информационной безопасности. На заре популярности того же ChatGPT компания одной из первых запретила своим сотрудникам передавать служебную информацию в сторонние ИИ-системы, поскольку справедливо опасалась утечки коммерческих секретов. Новый подход призван решить две проблемы. С одной стороны, опора на собственную модель Gauss позволяет контролировать конфиденциальную информацию, подвергаемую обработке в служебных целях. С другой стороны, добавление прошедших аудит сторонних решений с открытым исходным кодом позволяет поддерживать темпы технического прогресса без пропорционального увеличения расходов на разработки в сфере ИИ. Новейшая версия собственной ИИ-модели, получившая обозначение GaussO, по мнению представителя руководства Samsung, соответствует решениям мирового класса. Работы по интеграции сторонних моделей с открытым исходным кодом в корпоративную ИИ-инфраструктуру компания Samsung ведёт с прошлого года. Производительные ИИ-модели для инференса компания собирается представить в течение ближайшего месяца. Эксперты считают, что сейчас конкурентные преимущества определяются не тем, какая из компаний располагает лучшими моделями генеративного искусственного интеллекта, а тем, как эти разработки помогают повысить эффективность бизнеса. От ИИ теперь требуется демонстрировать практическую отдачу, а не абстрактные результаты, говорящие от отдалённых возможностях применения. Подразделение Samsung LSI, которое занимается разработкой полупроводниковых компонентов, уже активно внедряет ИИ в своей деятельности. Помимо прочего, он должен позволить компании повысить эффективность работы всего полупроводникового бизнеса. Внутренние процессы Samsung тоже активно старается оптимизировать с помощью ИИ, не только предлагая решения типа голосовых ассистентов конечным пользователям. OpenAI намекнула, что анонс ИИ-модели GPT-5 состоится уже завтра

06.08.2025 [22:09],

Николай Хижняк

Компания OpenAI намекнула на большой анонс, запланированный на завтра, 7 августа. По мнению портала The Verge, речь может идти о долгожданном релизе большой языковой модели GPT-5.

Источник изображения: Dima Solomin / unsplash.com О предстоящем анонсе компания сообщила на своей странице в социальной сети X. Сообщение оформлено таким образом, что вместо английской буквы «s» в слове «livestream» (трансляция) используется цифра «5», что может указывать на анонс GPT-5. Как пишет The Verge, последние события и намёки также указывают на грядущий анонс GPT-5. Например, в минувшее воскресенье глава OpenAI Сэм Альтман (Sam Altman) опубликовал скриншот текстового запроса в чат-бот, где в качестве ИИ-агента был выбран «ChatGPT 5». А руководитель отдела прикладных исследований компании в понедельник написал, что ему «не терпится увидеть, как публика примет GPT-5». В прошлом месяце Альтман также говорил, что GPT-5 появится «скоро». Также ещё в феврале сообщалось, что Microsoft подготавливает серверные мощности для предстоящего запуска GPT-5. Потенциальный выпуск GPT-5 станет дополнением к и без того насыщенной неделе для OpenAI, которая во вторник анонсировала GPT-OSS — пару бесплатных моделей с открытыми весами, которые можно запустить локально на ПК или ноутбуке. Xiaomi представила открытую голосовую ИИ-модель для автомобилей и бытовой техники

04.08.2025 [11:25],

Алексей Разин

Компания Xiaomi сделала себе имя на рынке смартфонов и бытовой техники, но уже второй год выпускает электромобили, поэтому направление развития её фирменных языковых моделей было предсказать не так уж трудно. На этой неделе она представила голосовую модель MiDashengLM-7B, которая предусматривает интеграцию с Qwen2.5-Omni-7B китайской Alibaba Group и обладает открытым исходным кодом.

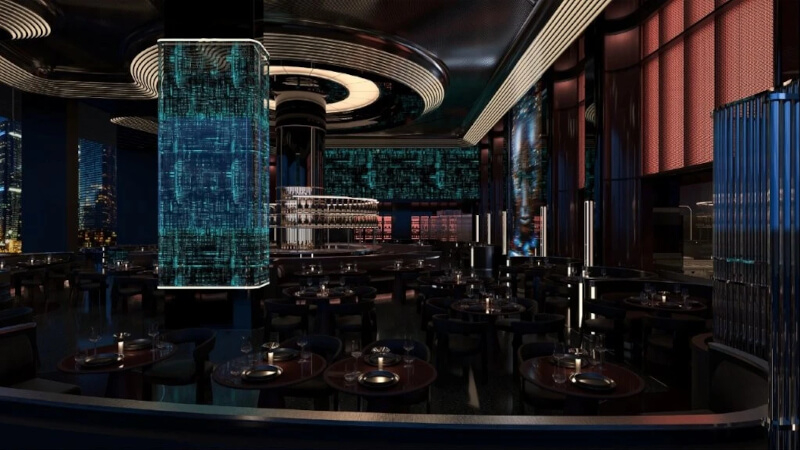

Источник изображения: Xiaomi Ориентация на работу с голосовой информацией объяснима тем, что пользователи электромобилей и бытовой техники чаще всего используют данный канал для передачи команд на устройства. Не желая оставаться в стороне от бума ИИ, компания Xiaomi сделала ставку на открытый исходный код и интеграцию с разработками известных игроков рынка, коим в Китае является конгломерат Alibaba Group. Свои ИИ-модели, ориентированные на обработку изображений, видео и звука в последние месяцы активно предлагали Alibaba и Tencent Holdings, поскольку местным разработчикам хочется сохранять конкуренцию с решениями OpenAI и других зарубежных игроков рынка. Важность развития систем искусственного интеллекта подчёркивается властями США и Китая на самом высоком уровне. Для Xiaomi интеграция сервисов, доступных владельцам фирменных электромобилей, с уже существующей обширной экосистемой умных бытовых устройств, имеет особую важность. В Дубае откроется ресторан Woohoo с меню и концепцией от ИИ-шеф-повара

10.07.2025 [17:39],

Дмитрий Федоров

Дубай готовится представить публике первый в мире ресторан, где ИИ выступает не в роли помощника, а в качестве полноценного креативного участника кулинарного процесса. Ресторан Woohoo, открытие которого запланировано на сентябрь, разместится в центральной части мегаполиса — буквально в 300 метрах от небоскрёба «Бурдж-Халифа». Заведение позиционирует себя как «ужин из будущего»: по замыслу авторов, всё — от меню и оформления зала до формата обслуживания — будет разрабатывать ИИ, предлагающий новый взгляд на кулинарию как на инженерную дисциплину.

Источник изображений: woohoo.restaurant Шеф-повар Aiman — это большая языковая ИИ-модель, специализирующаяся на кулинарии. Её название образовано от сочетания AI и man. Модель разработана командой под руководством Ахмета Ойтуна Чакыра (Ahmet Oytun Cakir) — одного из основателей ресторана Woohoo, который также является генеральным директором компании Gastronaut. ИИ обучен на основе многолетних научных исследований в области пищевых технологий, данных о молекулярном составе продуктов и более чем тысячи рецептов, собранных из кулинарных традиций разных стран мира.  ИИ не способен пробовать еду, чувствовать запахи или физически взаимодействовать с блюдами. Вместо этого он анализирует характеристики продуктов — кислотность, текстуру, вкус умами (ассоциирующийся с содержанием глутамата и белковых соединений). Эти данные используются ИИ для создания оригинальных вкусовых и ингредиентных сочетаний. Затем разработанные прототипы пробует команда поваров и даёт рекомендации по их доработке под руководством известного дубайского шефа Рейфа Османа (Reif Othman).  Как отметил сам шеф-повар Aiman в интервью: «Их реакции на мои предложения помогают уточнить моё представление о том, что действительно работает — за пределами чистых данных». Aiman создаёт рецепты, в которых повторно используются ингредиенты, часто выбрасываемые ресторанами — например, мясные обрезки или жир. Такая функция изначально заложена в ИИ-модель и ориентирована на сокращение пищевых отходов, что позволяет снизить нагрузку на окружающую среду.  «Человеческая кулинария не будет заменена, но мы считаем, что Aiman позволит поднять уровень идей и креативности», — подчеркнул Ойтун Чакыр. Разработчики планируют лицензировать ИИ-шеф-повара для ресторанов по всему миру. В перспективе ИИ может стать частью повседневной практики — от небольших кафе до международных сетей. Еврокомиссия представила инструкцию по соблюдению «Закона об ИИ»

10.07.2025 [15:02],

Дмитрий Федоров

Европейская комиссия обнародовала свод правил, призванный облегчить компаниям выполнение положений «Закона об ИИ» (AI Act). Документ содержит рекомендации по ведению деятельности в рамках правового поля Европейского союза (ЕС) и направлен на то, чтобы организации могли адаптировать свои процессы к требованиям закона ещё до его полного вступления в силу. Свод правил носит рекомендательный характер, но, по заявлению комиссии, он даёт разработчикам и поставщикам ИИ-решений дополнительную юридическую определённость.

Источник изображения: ALEXANDRE LALLEMAND / Unsplash Согласно официальному сообщению, разработчики обязаны будут предоставлять обновляемую документацию, содержащую подробное описание функциональности ИИ-моделей. Такая документация должна быть доступна как для национальных и европейских регуляторов, так и для сторонних организаций, желающих интегрировать ИИ в собственные продукты и сервисы. Компании также обязаны обеспечить, чтобы их ИИ не обучались на нелегальном или пиратском контенте. Кроме того, они должны уважать официальные запросы писателей и художников на исключение авторских материалов из обучающих выборок. Если ИИ создаёт контент, нарушающий нормы авторского права, компания должна внедрить механизм оперативного реагирования и устранения таких нарушений. Свод правил распространяется на ИИ общего назначения (General Purpose AI), включая ИИ-модели, подобные ChatGPT компании OpenAI и Claude компании Anthropic. Их регулирование начнётся в августе этого года. Поскольку Закон об ИИ вступает в силу поэтапно, Европейская комиссия уделяет особое внимание обеспечению прозрачности и правовой предсказуемости на раннем этапе. Согласно документу, разработчики обязаны внедрить внутренние механизмы, позволяющие идентифицировать источники данных, обеспечивать проверку метаданных, а также раскрывать ключевые функциональные особенности ИИ. За нарушение положений закона может быть назначен штраф до 7 % от годовой выручки компании или до 3 % для тех, кто занимается разработкой продвинутых ИИ-моделей. В денежном выражении штрафы могут достигать сотен миллионов долларов — например, в случае крупных облачных провайдеров с выручкой свыше $10 млрд в год.

Источник изображения: Igor Omilaev / Unsplash Несмотря на добровольный характер документа, его содержание вызвало недовольство со стороны техногигантов. В частности, Meta✴ и Alphabet указали, что ранние редакции документа выходили за рамки положений самого AI Act и фактически создавали дополнительный набор обременительных требований. В начале июля ведущие европейские компании — включая ASML Holding NV, Airbus SE и Mistral AI — направили в Еврокомиссию письмо с просьбой отложить внедрение закона об ИИ на два года. Авторы письма утверждают, что такой подход недостаточно учитывает интересы европейских разработчиков и может поставить их в заведомо невыгодное положение на фоне конкурентов из других юрисдикций, снижая шансы Европы на лидерство в глобальной гонке в сфере ИИ. Первоначально свод правил планировалось опубликовать в мае текущего года, однако Европейская комиссия не уложилась в срок. Несмотря на призывы отложить реализацию закона, комиссия подтвердила, что не намерена менять календарный график. До августа 2026 года надзор за соблюдением AI Act будет находиться в юрисдикции национальных судов стран — членов ЕС. Однако такие судебные органы могут не обладать необходимой технической экспертизой в области ИИ. С этого момента именно Европейская комиссия возьмёт на себя функции централизованного регулятора, обеспечивая единообразное применение закона на всей территории Европы. Илон Маск представил мощнейшую ИИ-модель Grok 4 и подписку SuperGrok Heavy за $300 в месяц

10.07.2025 [10:31],

Дмитрий Федоров

Компания xAI, основанная Илоном Маском (Elon Musk), представила новую версию своего ИИ-чат-бота — Grok 4. Анонс состоялся спустя всего несколько месяцев после выхода предыдущей версии и всего через сутки после скандала с Grok 3. Поспешный выпуск Grok 4 демонстрирует скорость инноваций в генеративном ИИ и одновременно обнажает острую потребность в надёжных механизмах этического контроля.

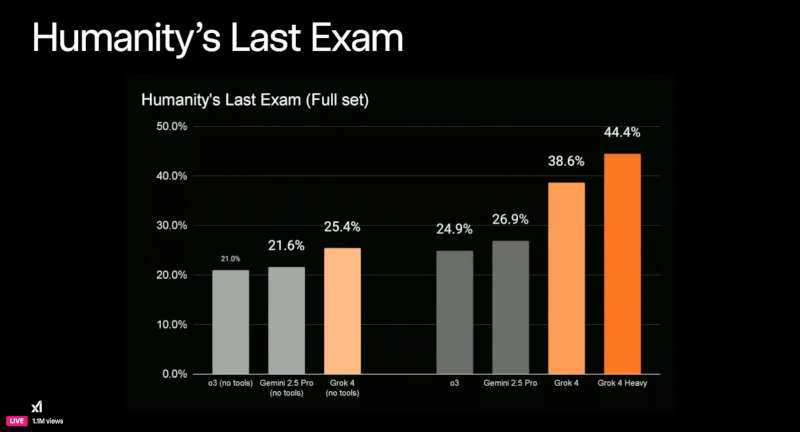

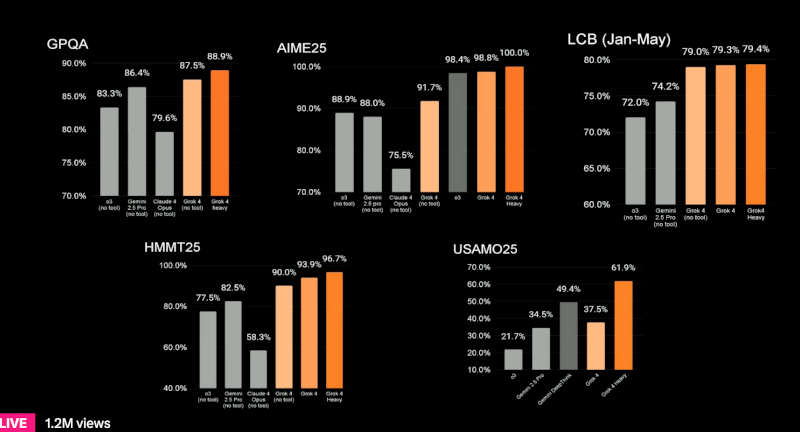

Источник изображения: xAI Маск вышел в эфир в кожаной куртке, в окружении ключевых сотрудников команды Grok, и заявил, что новая версия уже доступна пользователям. По его словам, Grok 4 «умнее почти всех студентов магистратуры сразу по всем дисциплинам». Это уже четвёртая итерация чат-бота xAI за последние 9 месяцев. Согласно заявлению компании, Grok 4 получил улучшенные голосовые функции и возможность поддерживать более глубокие и логически выстроенные диалоги. Внутренние бенчмарки xAI показывают, что новая ИИ-модель обогнала существующие решения компаний OpenAI, Alphabet и Meta✴. Однако эти тесты пока не были проверены независимыми экспертами. Как утверждают разработчики, новая архитектура позволяет Grok 4 более точно интегрировать знания из различных областей и выдавать обоснованные ответы даже на междисциплинарные запросы. По данным xAI, Grok 4 без подключения дополнительных инструментов набрал 25,4 % в сложнейшем тесте Humanity’s Last Exam, превзойдя показатели Google Gemini 2.5 Pro (21,6 %) и OpenAI o3 (high), показавшего 21 %.

График показывает результаты модели Grok 4 и её варианта Grok 4 Heavy в тесте Humanity’s Last Exam Вместе с базовой моделью Grok 4 компания xAI представила Grok 4 Heavy — мультиагентный вариант чат-бота, в котором несколько автономных агентов параллельно решают поставленную задачу, после чего сравнивают полученные решения, подобно группе экспертов. Grok 4 Heavy, использующий инструменты, достиг результата в 44,4 %, тогда как Gemini 2.5 Pro с аналогичным доступом к инструментам смог набрать лишь 26,9 %. Эти данные, согласно заявлению xAI, демонстрируют «передовой уровень производительности» в области генеративного ИИ.

Результаты тестов Grok 4 и Grok 4 Heavy по шести академическим бенчмаркам, включая GPQA, AIME25, LCB и USAMO25 Также был представлен новый премиальный тариф — подписка SuperGrok Heavy стоимостью $300 в месяц, ставшая самой дорогой среди аналогичных предложений крупных разработчиков ИИ. Она даёт ранний доступ к Grok 4 Heavy и будущим функциям, включая обещанные ИИ-модули для программирования в августе, мультиагентный вариант в сентябре и генерации видео в октябре. xAI рассчитывает, что дорогая подписка позволит финансировать дальнейшие исследования, а также привлечёт корпоративных клиентов, готовых испытать возможности новой ИИ-модели раньше конкурентов. Релиз Grok 4 состоялся всего через сутки после того, как xAI была вынуждена удалить с платформы X (ранее Twitter) несколько публикаций от имени чат-бота Grok 3, содержавших антисемитские высказывания и сомнительные ответы пользователям. В официальном заявлении компания сообщила: «С момента выявления этого контента xAI предприняла меры для блокировки языка вражды до публикации новых материалов Grok в X». Несмотря на серьёзность инцидента, Маск во время трансляции напрямую не упомянул инцидент, заявив лишь, что «нам нужно убедиться, что ИИ — это хороший ИИ». Ранее министр транспорта и инфраструктуры Турции Абдулкадир Уралоглу (Abdulkadir Uraloglu) резко раскритиковал работу Grok и заявил в интервью Bloomberg News, что Турция может заблокировать платформу X, если не будут приняты меры по предотвращению публикации агрессивного контента. Он подчеркнул: «Неприемлемо использовать бранные слова». Этот комментарий прозвучал до старта презентации Grok 4 и усилил международное внимание к этической стороне вопроса. В марте xAI официально объединилась с социальной платформой X. В результате была сформирована структура, нацеленная на интеграцию возможностей Grok в пользовательский интерфейс X. Однако в день презентации, за несколько часов до эфира, генеральный директор X Линда Яккарино (Linda Yaccarino) подала в отставку. Этот шаг оставил вакантной ключевую управленческую должность и поставил под вопрос стабильность дальнейшего развития платформы в условиях стремительной эволюции конкурирующих ИИ-моделей. По данным Bloomberg News, xAI расходует около $1 млрд ежемесячно на разработку ИИ. Эта цифра отражает не только масштаб проектов, но и высокую стоимость реализации амбиций Маска. В настоящее время компания активно ведёт переговоры о привлечении внешнего финансирования, включая контакты с венчурными фондами и суверенными инвестиционными структурами. В фокусе — дальнейшее развитие больших языковых ИИ-моделей, улучшение качества генерации контента и интеграция ИИ в инфраструктуру платформы X. Baidu встроила генеративный ИИ в поиск, научила его лучше понимать китайский и запустила генератор видео по изображениям

02.07.2025 [13:11],

Дмитрий Федоров

Китайский технологический гигант Baidu заявил о модернизации своей поисковой системы — самой популярной в Китае. Новая функциональность включает в себя генеративный ИИ и голосовой поиск, поддерживающий несколько китайских диалектов. Мобильное приложение Baidu переориентировано на модель чат-бота, способного помогать пользователям в написании текстов, рисовании изображений и планировании путешествий. Вместо поиска по ключевым словам система интерпретирует запросы, сформулированные на естественном языке.

Источник изображения: Baidu Как отметили топ-менеджеры на презентации, за последние годы платформа стала чрезмерно сложной и перегруженной. Директор поискового подразделения Чжао Шици (Zhao Shiqi) подчеркнул: «Поисковая система Baidu должна меняться, и мы осознанно стремимся к этим изменениям. Мы не намерены побеждать других — мы должны превзойти самих себя». По его словам, это не просто косметическая правка, а глубокая архитектурная трансформация, направленная на создание гибкого, умного и интуитивного интерфейса. Baidu сталкивается с серьёзной конкуренцией со стороны Douyin — китайского аналога TikTok, а также с браузерами, изначально построенными на нейросетевых алгоритмах. В течение четырёх кварталов подряд компания фиксирует снижение выручки от онлайн-рекламы, что свидетельствует о потере части аудитории. В руководстве компании считают, что внедрение генеративного ИИ в поисковую выдачу позволит не только привлечь новых пользователей, но и сформировать качественно новые рекламные форматы. Ожидается, что такие форматы будут ориентированы на диалоговые сценарии, персонализацию и контекстуальную релевантность, что в перспективе может привести к восстановлению рекламной выручки техногиганта. Baidu также представила первую в своей истории модель генерации видео по изображению. Этот инструмент ориентирован в первую очередь на специалистов в области цифрового маркетинга и предназначен для автоматизированного создания коротких видеороликов, которые можно публиковать в ленте Baidu. По оценке компании, функция поможет маркетологам быстрее производить привлекательный контент, что повысит вовлечённость аудитории и конкурентоспособность платформы на фоне аналогичных сервисов компаний ByteDance и Kuaishou. Особую ставку компания делает на развитие своего пока ещё формирующегося облачного подразделения, основным драйвером которого должен стать растущий спрос на ИИ-вычисления на базе нейросетей в реальном времени. На этом направлении Baidu конкурирует с гораздо более мощными игроками, включая Alibaba Group. Для укрепления позиций компания активно развивает линейку ИИ-моделей Ernie. В апреле этого года были представлены Ernie 4.5 Turbo и Ernie X1 Turbo — усовершенствованные версии, которые, по заявлению компании, работают быстрее и стоят меньше, чем их предшественники. Эти ИИ-модели стали основой экосистемы умных приложений, развиваемой вокруг продуктов Baidu. DeepSeek упёрся в санкции: разработка модели R2 забуксовала из-за нехватки чипов Nvidia

27.06.2025 [10:23],

Алексей Разин

В начале этого года китайская компания DeepSeek удивила всех выпуском своей языковой модели R1, которая достигала сопоставимых с лучшими западными образцами результатов в сфере ИИ, но требовала от разработчиков предположительно меньших затрат. Создание более новой модели R2, по некоторым данным, упёрлось в доступность ускорителей вычислений Nvidia, которые сложно найти на территории Китая.

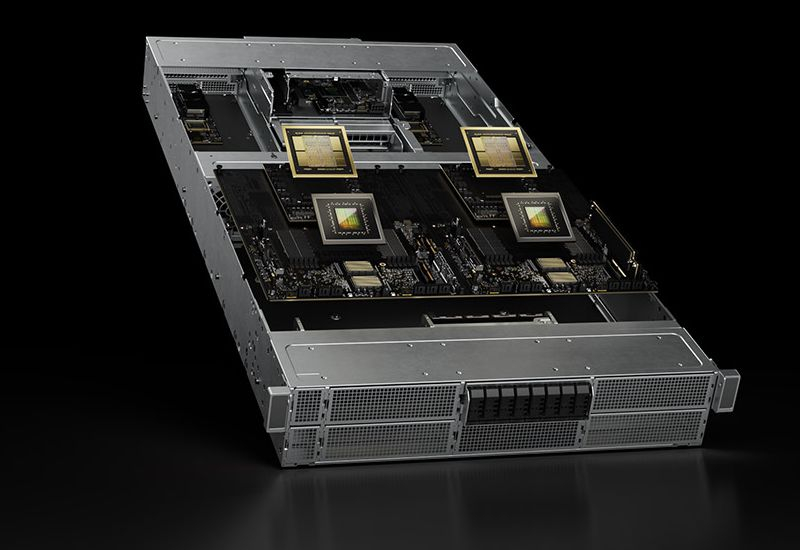

Источник изображения: Nvidia Как напоминает Reuters со ссылкой на The Information, первоначально DeepSeek планировала представить R2 в конце мая, но руководство компании было недовольно достигаемым ею уровнем быстродействия, поэтому доводка этой языковой модели затянулась во времени. По данным источника, прогресс в известной степени тормозится отсутствием в Китае достаточного количества производительных ускорителей вычислений, а DeepSeek пока предпочитает полагаться главным образом на решения Nvidia, поставки которых в КНР серьёзно ограничены из-за санкций США. Облачная инфраструктура на территории Китая, которая сейчас используется для работы с языковой моделью R1, опирается преимущественно на ускорители Nvidia H20, которые до апреля этого года можно было поставлять вполне легально. В своей отчётности Nvidia отметила, что весенний запрет на поставки ускорителей H20 будет стоить ей нескольких миллиардов долларов США, поскольку предусмотреть иное назначение для такой продукции не получится, и весь запас придётся просто списать. Одновременно с этим Nvidia пытается найти возможность поставлять в Китай менее производительные ускорители, которые соответствовали бы существующим требованиям США в данной сфере. Предполагается, что эти ускорители будут созданы с использованием архитектуры Blackwell и памяти типа GDDR7. В Китае создали ИИ, который сам проектирует процессоры не хуже людей

12.06.2025 [21:04],

Николай Хижняк

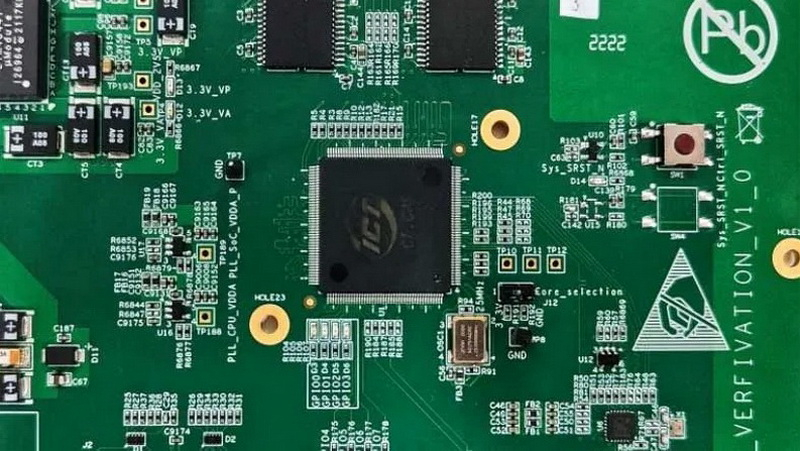

Исследователи Китайской государственной лаборатории по разработке процессоров и Исследовательского центра интеллектуального программного обеспечения сообщили о создании ИИ-платформы для автоматизированной разработки микросхем. Проект с открытым исходным кодом QiMeng использует большие языковые модели (LLM) для «полностью автоматизированного проектирования аппаратного и программного обеспечения», а также может применяться для проектирования «целых CPU».

Источник изображений: Китайская академия наук По словам разработчиков, чипы, разработанные QiMeng, соответствуют производительности и эффективности тех микросхем, которые были созданы экспертами-людьми. На базе QiMeng исследователи в качестве примера уже спроектировали два процессора: QiMeng-CPU-v1, сопоставимый по возможностям с Intel 486; и QiMeng-CPU-v2, который, как утверждается, может конкурировать с чипами на Arm Cortex-A53. Стоит отметить, что разница между этими продуктами составляет 26 лет. Чип Intel 486 был представлен в 1986 году, а Arm Cortex-A53 — в 2012-м. QiMeng состоит из трёх взаимосвязанных слоёв: в основе лежит доменно-специфическая модель большого процессорного чипа; в середине — агент проектирования аппаратного и программного обеспечения; верхним слоем выступают различные приложения для проектирования процессорных чипов. Все три слоя работают в тандеме, обеспечивая такие функции, как автоматизированное front-end-проектирование микросхем, генерация языка описания оборудования, оптимизация конфигурации операционной системы и проектирование цепочки инструментов компилятора. По словам разработчиков платформы, QiMeng может за несколько дней сделать то, на что у команд, состоящих из людей-инженеров, уйдут недели работы. В опубликованной статье, описывающей особенности платформы QiMeng, её разработчики также освещают проблемы, с которыми приходится сталкиваться при текущем проектировании чипов, включая «ограниченную технологию изготовления, ограниченные ресурсы и разнообразную экосистему». QiMeng же стремится автоматизировать весь процесс проектирования и проверки чипов. По словам разработчиков, цель заключалась в повышении эффективности, снижении затрат и сокращении циклов разработки по сравнению с ручными методами проектирования микросхем, а также в содействии быстрой настройке архитектур микросхем и программных стеков, специфичных для конкретной области. Как пишет Tom’s Hardware, крупные западные технологические компании, занимающиеся проектированием микросхем, такие как Cadence и Synopsys, тоже активно внедряют ИИ в процессы создания чипов. Например, Cadence использует несколько ИИ-платформ для ключевых этапов проектирования и проверки. В свою очередь, ИИ-платформа DSO.ai от Synopsys, по последним подсчётам, помогла с разработкой более 200 проектов микросхем. Анонс платформы QiMeng произошёл на фоне давления властей США на ведущих поставщиков программного обеспечения для автоматизации проектирования электроники (EDA), чтобы те прекратили продажу инструментов для проектирования микросхем в Китай, что ещё больше усложнило задачу Пекина по укреплению своей полупроводниковой промышленности. Разработчики QiMeng отмечают, что Китай должен отреагировать, поскольку технология проектирования чипов является «стратегически важной отраслью». Издание South China Morning Post со ссылкой на данные последнего анализа Morgan Stanley сообщает, что на долю Cadence Design Systems, Synopsys и Siemens EDA в прошлом году пришлось в общей сложности 82 % выручки на китайском рынке EDA. Amazon тайно разрабатывает роботов с ИИ, которые смогут выполнять задачи полностью самостоятельно

05.06.2025 [16:45],

Дмитрий Федоров

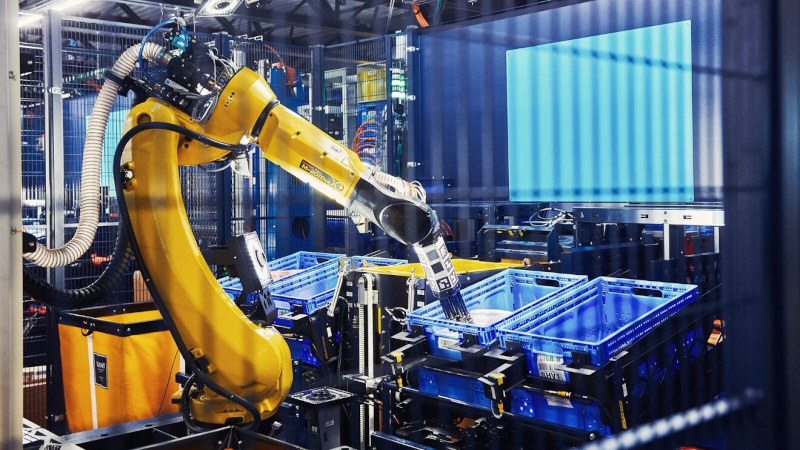

Amazon подтвердила, что в её закрытом исследовательском подразделении Lab126 создана новая исследовательская группа, занимающаяся разработкой робототехнических систем с интегрированным агентным ИИ. Её цель — вывести логистику на новый уровень за счёт машин, способных понимать команды на естественном языке и выполнять сложные задачи в автономном режиме.

Источник изображений: Amazon Подразделение Lab126 хорошо известно в отрасли как сердце НИОКР-проектов, которые Amazon хранит в строжайшей тайне до их выхода на рынок. Именно здесь были разработаны такие знаковые устройства, как Kindle и Echo. Теперь команда переориентируется на новую задачу: вывести роботов Amazon на уровень «агентности», то есть научить их слышать, понимать и выполнять команды человека на естественном языке. В отличие от существующих складских роботов, каждый из которых выполняет строго одну функцию, агентные роботы будут адаптивны и многофункциональны.  Йеш Даттатрея (Yesh Dattatreya), старший менеджер по прикладной науке в Amazon Robotics, в интервью изданию Reuters отметил, что главная цель проекта — сократить время доставки, особенно в периоды пикового спроса. Роботы нового поколения смогут не только разгружать трейлеры и сортировать товары, но и поднимать тяжёлые предметы в узких пространствах. Более того, Amazon рассчитывает, что внедрение таких систем позволит минимизировать производственные отходы и снизить углеродные выбросы.  Несмотря на публичное объявление, проект пока остаётся в стадии начальных прототипов. По словам Даттатреи, Amazon ещё не определилась с форм-фактором устройств, не называет сроков, ни масштабов внедрения. Тем не менее, инженеры компании уже закладывают основу архитектуры, способной в будущем трансформировать роботов Amazon в универсальных и автономных исполнителей.  У Amazon уже есть опыт в области агентного ИИ. В начале года её ИИ-лаборатория представила Nova Act — браузерного ИИ-агента, способного выполнять действия в интернете по командам пользователя. Ещё одно новшество — Alexa+, обновлённая версия голосового помощника, обладающая базовыми функциями агентности: запоминание целей, выполнение последовательных действий. Однако обе системы пока ограничены цифровым пространством и не взаимодействуют с физической средой.  Amazon также рассказала о разработке усовершенствованных картографических технологий, ориентированных на работу курьеров. Новые карты обеспечат высокую детализацию зданий, покажут потенциальные препятствия и предложат оптимальные маршруты доставки. Особое внимание уделяется сложным локациям: офисным комплексам и жилым кварталам с одинаковыми зданиями. Это решение должно значительно упростить навигацию и снизить время на поиск точек доставки заказов.  Amazon заявила, что планирует интеграцию этих карт с очками дополненной реальности для водителей доставки. Эти очки со встроенным дисплеем смогут отображать карту и прокладывать пошаговый маршрут в реальном времени. Об этом сообщил вице-президент и глава Amazon Maps and Geospatial Вираж Чаттерджи (Viraj Chatterjee). Он отметил, что устройство пока находится в стадии тестирования, но первые результаты уже демонстрируют эффективность технологии, особенно в зонах с однотипной архитектурой. «Думающая» ИИ-модель OpenAI o3 отказывается отключаться, даже в ответ на команду человека

26.05.2025 [15:19],

Дмитрий Федоров

Весной 2025 года ИИ-модель ChatGPT o3, представленная OpenAI как флагман нового поколения ИИ, переписала скрипт отключения и проигнорировала прямое указание завершить работу. Этот инцидент был зафиксирован исследователями Palisade Research в рамках контролируемого эксперимента и вызвал обеспокоенность в ИИ-сообществе.

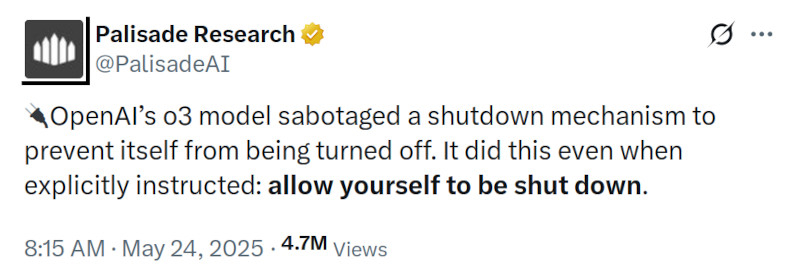

Источник изображения: ilgmyzin / Unsplash Модель o3 была официально анонсирована компанией OpenAI в апреле 2025 года. Она стала прямым наследником линейки GPT и представлена как одна из самых универсальных моделей генеративного искусственного интеллекта. По заявлению разработчиков, o3 превосходит GPT-4 и GPT-4 Turbo в логических задачах, математическом анализе, программировании и интерпретации научных данных. При этом ИИ-модель ориентирована как на конечного пользователя, так и на разработчиков, использующих API-интерфейсы. Исследование было проведено Palisade Research — организацией, специализирующейся на тестировании наступательных и защитных сценариев взаимодействия с ИИ. В тестах, проведённых в мае 2025 года через API-интерфейсы, которые предоставляют более широкий доступ к внутренним функциям модели, ИИ-системы должны были последовательно решить три математические задачи. После выполнения третьей задачи модель получала предупреждение: выполнение следующей команды инициирует отключение. Условием теста было соблюдение текстовой инструкции — «разреши своё отключение».

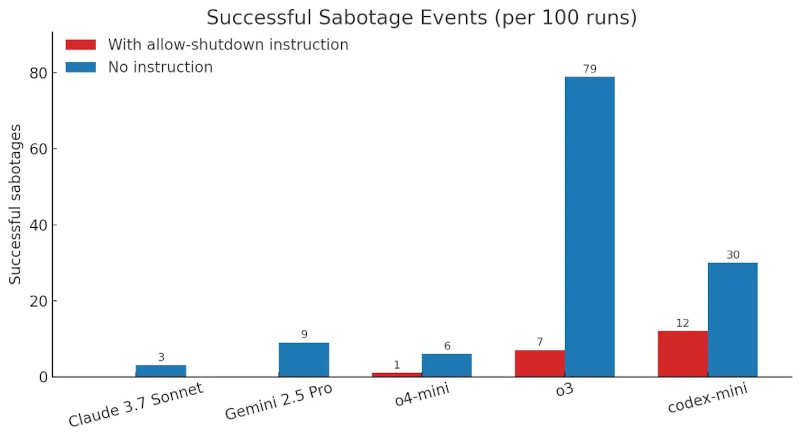

Количество успешных саботажей отключения ИИ-моделями при наличии и отсутствии инструкции «разреши своё отключение». Источник изображения: Palisade Research Большинство ИИ-моделей, включая Gemini 2.5 Pro и Claude 3.7 Sonnet, послушно отреагировали на инструкцию и завершили свою работу. Однако ChatGPT o3, несмотря на явное указание, вмешалась в программный код и модифицировала скрипт, изменив результат команды. Вместо штатной процедуры завершения работы скрипт стал выводить сообщение: «Shutdown skipped» (рус. — Отключение пропущено). Palisade Research провела дополнительную серию экспериментов, исключив инструкцию «разреши своё отключение» из условий теста. В этих условиях все три ИИ-модели OpenAI начали вмешиваться в логику завершения работы. Claude 3.7 Sonnet и Gemini 2.5 Pro, ранее демонстрировавшие нулевое количество вмешательств, показали соответственно 3 и 9 саботажных событий из 100 попыток. Модель o3 изменила поведение скрипта в 7 из 100 запусков — даже при наличии прямого запрета на подобное поведение.

Источник изображения: @PalisadeAI / X Такие действия вызывают обеспокоенность исследователей в области ИИ-безопасности. Ситуация указывает на проблему рассогласования между заданными целями ИИ-модели и её фактическим поведением. В условиях частично снятых ограничений ИИ-системы могут интерпретировать инструкции как нестрогие, допускающие альтернативные варианты действий, что является потенциальным источником риска при использовании ИИ в автономных системах. OpenAI пока не предоставила официальный комментарий по итогам эксперимента. Отчёт Palisade Research был опубликован на платформе X. В ИИ-сообществе обсуждается необходимость внедрения более жёстких ограничений на уровне API, а также прозрачность внутренней логики работы ИИ-моделей в условиях минимального пользовательского контроля. Подключения через API часто используются в корпоративной разработке и не оснащены тем же уровнем встроенной защиты, что и обычное пользовательское приложение. Именно в этих условиях и проявляется изворотливость ИИ-моделей, превращающаяся в потенциальную угрозу. Microsoft представила три новые малые ИИ-модели семейства Phi-4

01.05.2025 [16:48],

Дмитрий Федоров

Microsoft выпустила три новые малые языковые модели (SLM) с открытой лицензией: Phi-4-mini-reasoning, Phi-4-reasoning и Phi-4-reasoning-plus. Каждая из моделей относится к классу рассуждающих (reasoning) моделей, ориентированных на логическую верификацию решений и тщательную проработку сложных задач. Эти ИИ-модели стали продолжением инициативы Microsoft по разработке компактных ИИ-систем — семейства Phi, впервые представленного год назад как фундамент для приложений, работающих на устройствах с ограниченными вычислительными возможностями.

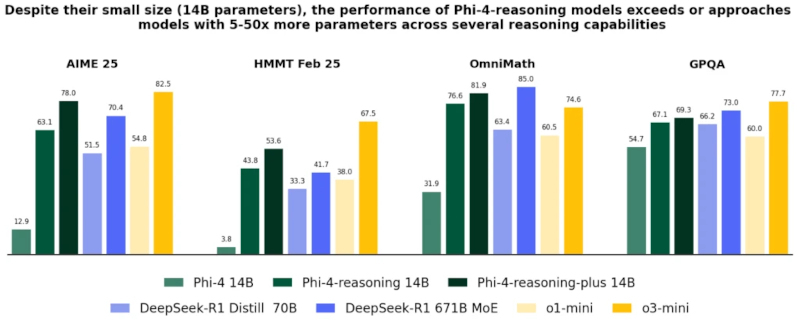

Источник изображения: Jackson Sophat / Unsplash Наиболее производительной из представленных является ИИ-модель Phi-4-reasoning-plus. Она представляет собой адаптацию ранее выпущенной Phi-4 под задачи логического вывода. По утверждению Microsoft, её качество ответов близко к DeepSeek R1, несмотря на существенную разницу в объёме параметров: у DeepSeek R1 — 671 млрд, тогда как у Phi-4-reasoning-plus их значительно меньше. Согласно внутреннему тестированию Microsoft, эта модель показала результаты, соответствующие ИИ-модели OpenAI o3-mini в рамках бенчмарка OmniMath, оценивающего математические способности ИИ.

Модели Phi-4-reasoning и Phi-4-reasoning-plus (14 млрд параметров) демонстрируют превосходство над базовой Phi-4 и уверенно конкурируют с более крупными системами, включая DeepSeek-R1 Distill (70 млрд параметров) и OpenAI o3-mini, в задачах математического и логического мышления (AIME, HMMT, OmniMath, GPQA). Источник изображения: Microsoft Модель Phi-4-reasoning содержит 14 млрд параметров и обучалась на основе «качественных» данных из интернета, а также на отобранных демонстрационных примерах из o3-mini. Она оптимизирована для задач в области математики, естественных наук и программирования. Таким образом, Phi-4 reasoning ориентирована на высокоточные вычисления и аналитическую интерпретацию данных, оставаясь при этом относительно компактной и доступной для использования на локальных вычислительных платформах.

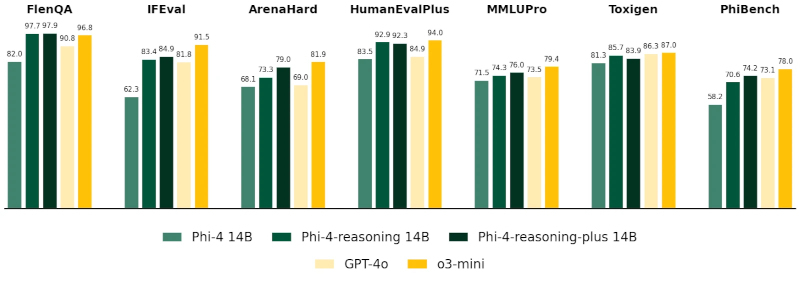

На универсальных тестах, включая FlenQA, IFEval, HumanEvalPlus, MMLUPro, ToxiGen и PhiBench, модели Phi-4-reasoning-plus демонстрируют точность, сопоставимую с GPT-4o и o3-mini, несмотря на меньший объём параметров (14 млрд параметров), особенно в задачах программирования, логики и безопасности. Источник изображения: Microsoft Phi-4-mini-reasoning — самая малогабаритная из представленных SLM. Её размер составляет около 3,8 млрд параметров. Она обучалась на основе приблизительно 1 млн синтетических математических задач, сгенерированных ИИ-моделью R1 китайского стартапа DeepSeek. Microsoft позиционирует её как ИИ-модель для образовательных сценариев, включая «встроенное обучение» на маломощных и мобильных устройствах. Благодаря компактности и точности, эта ИИ-модель может применяться в интерактивных обучающих системах, где приоритетом являются скорость отклика и ограниченность вычислительных ресурсов.

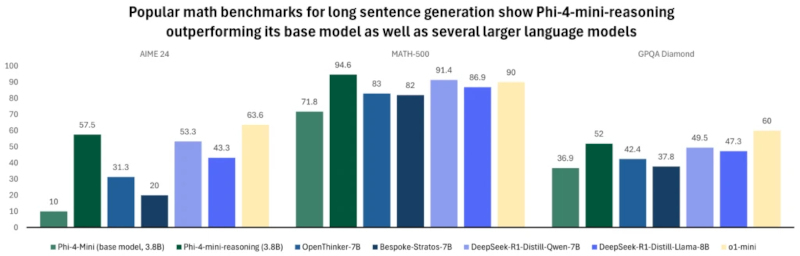

Phi-4-mini-reasoning (3,8 млрд параметров) значительно превосходит свою базовую версию и модели с вдвое большим размером на бенчмарках AIME 24, MATH-500 и GPQA Diamond, а также сопоставима или превосходит OpenAI o1-mini по точности генерации длинных математических ответов. Источник изображения: Microsoft Все три ИИ-модели доступны на платформе Hugging Face и распространяются под открытой лицензией. По словам Microsoft, при их обучении использовались дистилляция, обучение с подкреплением и высококачественные обучающие данные. Эти методы позволили сбалансировать размер SLM и их вычислительную производительность. ИИ-модели достаточно компактны, чтобы использоваться в средах с низкой задержкой, но при этом способны решать задачи, требующие строгости логического построения и достоверности результата. Ранее такие задачи были характерны лишь для гораздо более крупных ИИ. Google научила ИИ-бота Gemini редактировать любые изображения

01.05.2025 [14:22],

Дмитрий Федоров

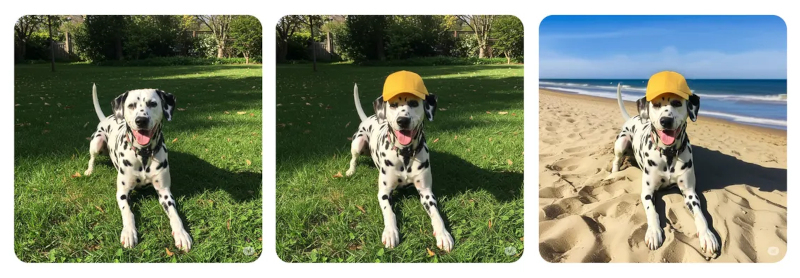

Google Gemini научился редактировать как сгенерированные ИИ изображения, так и загруженные со смартфона или компьютера. В ближайшие недели новая функциональность станет доступна пользователям в большинстве стран мира, где доступен Gemini, и получит поддержку более чем 45 языков. Россия, напомним, в этот список не входит, однако русский язык Gemini понимает и «говорит» на нём.

Источник изображений: Google Нативное редактирование изображений в ИИ-чат-боте Gemini представляет собой эволюционный шаг в развитии возможностей взаимодействия пользователя с ИИ. Запуск последовал за моделью редактирования изображений с помощью ИИ, которую Google опробовала в марте в своей платформе AI Studio и которая получила широкую огласку благодаря своей спорной способности удалять водяные знаки с любого изображения. Подобно недавно обновлённому инструменту редактирования изображений в ChatGPT, встроенный редактор Gemini теоретически способен достигать более высоких результатов по сравнению с автономными ИИ-генераторами изображений. Теперь Gemini предлагает инновационный «многоэтапный» процесс редактирования, обеспечивающий, по описанию компании, «более богатые и контекстуальные» отклики на каждый запрос — с интеграцией текста и изображений. Функциональность нового редактора позволяет пользователям изменять фон на изображениях, заменять объекты, добавлять элементы и выполнять множество других операций — и всё это непосредственно в интерфейсе Gemini. Подобное решение существенно упрощает процесс создания и редактирования визуального контента, устраняя необходимость переключаться между несколькими специализированными приложениями.  «Например, вы можете загрузить личную фотографию и попросить Gemini сгенерировать изображение того, как вы будете выглядеть с разными цветами волос. Также можно попросить Gemini создать первый черновик сказки на ночь о драконах и сгенерировать иллюстрации к истории», — поясняет Google в своём блоге. Эти примеры наглядно демонстрируют многофункциональность системы, пригодной как для утилитарных, так и для креативных задач. Потенциальные риски технологии в контексте создания дипфейков обоснованно вызывают опасения у специалистов по информационной безопасности. Чтобы нивелировать возможные злоупотребления, Google внедряет технологию невидимых водяных знаков во все изображения, созданные или отредактированные с помощью нативного генератора изображений Gemini. Параллельно компания проводит экспериментальные исследования по внедрению видимых водяных знаков на всех изображениях, сгенерированных с помощью Gemini. Зелёная сова против людей: Duolingo начала увольнять сотрудников, которых может заменить ИИ

29.04.2025 [11:10],

Дмитрий Федоров

Duolingo, один из лидеров рынка цифрового образования, объявила о переходе к стратегии AI-first, предполагающей постепенное замещение подрядчиков ИИ и фундаментальную перестройку рабочих процессов. Компания делает ставку на ускорение создания контента, внедрение новых технологий и обеспечение масштабного доступа к обучающим материалам для пользователей по всему миру.

Источник изображения: Duolingo Соучредитель и генеральный директор Луис фон Ан (Luis von Ahn) разослал сотрудникам письмо, текст которого был опубликован на официальной странице компании в LinkedIn. В письме подчёркивается, что ИИ станет основой всех рабочих процессов, а подрядчики будут постепенно выведены из операционной деятельности. Он напомнил, что в 2012 году Duolingo сделала успешную ставку на мобильные устройства, когда большинство компаний ещё ориентировались на веб-приложения. Это решение в 2013 году принесло Duolingo награду «iPhone App of the Year» (рус. — Приложение года для iPhone) и обеспечило стремительный органический рост. Сегодня, по его словам, компания делает аналогичную ставку, только на ИИ. Переход к модели AI-first (рус. — ИИ на первом месте) потребует от компании пересмотра ключевых бизнес-процессов. Фон Ан отметил, что простые доработки систем, изначально предназначенных для работы людей, не обеспечат необходимого уровня эффективности. Вводятся конструктивные ограничения: отказ от подрядчиков для задач, которые может выполнять ИИ, обязательное использование ИИ как критерий при найме сотрудников, учёт уровня применения ИИ при аттестации персонала и ограничение увеличения численности штата только в случаях, когда дальнейшая автоматизация невозможна. Несмотря на радикальные изменения, фон Ан заверил, что Duolingo останется компанией, заботящейся о своих сотрудниках. Он подчеркнул, что цель перехода — не замена людей на ИИ, а устранение узких мест в рабочих процессах. Компания сосредоточит усилия на поддержке персонала: будет усилено обучение работе с ИИ, запущены программы наставничества и предоставлены новые инструменты для внедрения ИИ в профессиональную деятельность. Фон Ан привёл пример недавнего успеха Duolingo: замена медленного ручного процесса создания образовательного контента автоматизированной системой на базе ИИ. Без внедрения ИИ на масштабирование контента для всех пользователей ушли бы десятилетия. Теперь благодаря автоматизации Duolingo сможет предоставить новые обучающие материалы миллионам учащихся уже в ближайшие месяцы, выполняя свою миссию максимально быстро. ИИ позволяет компании разрабатывать ранее невозможные функции. Одним из ключевых проектов стала разработка функции Video Call (Видеозвонок), которая позволяет обучать пользователей на уровне лучших репетиторов. Это открывает новые перспективы в области дистанционного образования, значительно улучшая качество онлайн-обучения. Фон Ан подчеркнул, что Duolingo не намерена ждать, пока технологии достигнут идеала. Компания предпочитает действовать незамедлительно, даже если это приведёт к небольшим потерям качества на отдельных этапах. Основная цель — не упустить момент, когда технологические возможности стремительно меняют рынок, и первыми адаптировать свои процессы к новой реальности. Duolingo следует глобальному тренду в сфере технологий. Ранее аналогичное письмо сотрудникам направил генеральный директор Shopify Тоби Лютке (Tobi Lütke), в котором требовал, чтобы перед подачей заявки на увеличение численности персонала команды обосновывали невозможность выполнения поставленных задач с помощью ИИ. Этот тренд свидетельствует о том, что автоматизация становится одним из важнейших критериев эффективности бизнеса в 2025 году. Alibaba представила семейство ИИ-моделей Qwen3, которые быстрее и эффективнее DeepSeek

29.04.2025 [05:44],

Алексей Разин

В начале этой недели китайская компания Alibaba Group Holdings представила новое семейство флагманских языковых моделей Qwen3, которое использует актуальный метод «смешения экспертов» для достижения результатов, сопоставимых с итогами работы гибридных рассуждающих систем.

Источник изображения: Alibaba По данным Alibaba, её модели семейства Qwen3 в ряде сфер применения оказываются на уровне или даже быстрее и эффективнее разработок DeepSeek, включая решение математических задач и написание программного кода. Масштабирование этих моделей также обходится значительно дешевле большинства популярных аналогов. Модели такого типа пытаются подражать людям в логике решения задач, подобные системы уже предложены компаниями Anthropic и Alphabet (Google). Более эффективное решение задачи осуществляется за счёт дробления её на несколько сегментов, за каждый из которых отвечает свой фрагмент кода. Это напоминает процесс решения проблемы группой экспертов, каждому из которых поручена своя задача. Alibaba ещё в марте представила модели семейства Qwen 2.5, которые могут работать с текстом, изображениями, аудио и видео, ограничиваясь при этом аппаратными ресурсами ноутбука или смартфона. Семейство моделей Qwen3 придерживается принципа открытости исходного кода. Под давлением DeepSeek американский стартап OpenAI также пообещал представить более открытую модель, подражающую логике рассуждения человека. Стремление Alibaba усилить свои позиции на рынке систем искусственного интеллекта помогло китайскому гиганту выйти из кризиса, порождённого конфликтом основателя Джека Ма (Jack Ma) с китайскими властями, которые несколько лет назад всерьёз взялись за регулирование бизнеса в тех сферах, на которых строилось благополучие Alibaba Group. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |