|

Опрос

|

реклама

Быстрый переход

OpenAI готовит детскую версию ChatGPT и будет автоматически сортировать пользователей по возрасту

16.09.2025 [20:33],

Сергей Сурабекянц

Компания OpenAI разрабатывает «детский интерфейс ChatGPT» и планирует использовать технологию предсказания возраста, чтобы лишить детей и подростков младше 18 лет доступа к стандартной версии. Компания подчеркнула — если её инструменты не смогут уверенно определить возраст человека, ChatGPT «из предосторожности» будет использовать версию для лиц младше 18 лет. Также OpenAI считает, что любые пользователи ChatGPT должны быть старше 13 лет.

Источник изображения: unsplash.com Результаты последних исследований в области взаимоотношений людей и искусственного интеллекта вызывают нешуточную тревогу по поводу рисков продолжительного общения с чат-ботами для психического здоровья подростков. Недавно OpenAI объявила о масштабной инициативе по установлению новых ограничений для подростков и людей, находящихся в состоянии эмоционального стресса. Компания планирует внедрить эту функцию к концу года. «Мы ставим безопасность выше конфиденциальности и свободы подростков; это новая и мощная технология, и мы считаем, что несовершеннолетним необходима значительная защита, — заявил глава OpenAI Сэм Альтман (Sam Altman). — Некоторые наши принципы противоречат друг другу, и мы хотели бы разъяснить решения, которые мы принимаем в связи с конфликтом между безопасностью, свободой и конфиденциальностью подростков».

Источник изображения: OpenAI Forum Новый детский интерфейс ChatGPT возлагает большую часть ответственности на родителей и опекунов. Родителям понадобится связать свои учётные записи с учётными записями подростков, отправив ребёнку приглашение. После этого они смогут ограничить реакцию ChatGPT на подростков с помощью встроенных правил, соответствующих возрасту. Родители смогут отключать или включать определённые функции, включая память и историю чатов. Включив соответствующую функцию, они будут получать уведомления, если «система обнаружит, что их подросток находится в состоянии острого стресса». OpenAI позволит родителям устанавливать часы отключения, когда подросток не может использовать ChatGPT. Заявление OpenAI сделано всего за несколько часов до слушаний в Вашингтоне, посвящённых потенциальному вреду чат-ботов на основе искусственного интеллекта. На этих слушаниях группа сенаторов намерена изучить риски для подростков, связанные с чат-ботами. Независимо от этого, на прошлой неделе Федеральная торговая комиссия (FTC) начала собственное расследование безопасности чат-ботов, запросив информацию у OpenAI, Meta✴, Google, xAI, Snap и Character.AI. Технологические компании, как правило, в ответ на судебные иски создают специализированные приложения для подростков и детей — например, YouTube Kids. Но самым большим препятствием для использования подобных приложений является необходимость убедить подростков связать свои аккаунты с родительским.

Источник изображения: unsplash.com OpenAI давно заявляет, что все пользователи ChatGPT должны быть не моложе 13 лет. Сообразительные молодые люди часто значительно лучше разбираются в информационных технологиях, чем их родители и опекуны. Для них не составит труда найти обходные пути, чтобы получить доступ к нужным сайтам и приложениям. OpenAI проанализировала, кто и зачем использует ChatGPT: к работе относится лишь четверть запросов

15.09.2025 [19:27],

Сергей Сурабекянц

Компания OpenAI, создатель ChatGPT, опубликовала своё первое подробное публичное исследование о том, кто пользуется её чат-ботом, и какие задачи чаще всего ему задают. Отчёт позволяет лучше понять, как в настоящее время люди используют этот инструмент ИИ и о чём они с ним общаются. В частности, выяснилось, что большинство пользователей ChatGPT — женщины, а большинство запросов, отправленных в ChatGPT, не связаны с работой.

Источник изображения: unsplash.com Сегодня OpenAI опубликовала данные о характере использования своего чат-бота в 62-страничной исследовательской статье. Она основана на логах чатов 1,5 миллионов пользователей ChatGPT с мая 2024 года по июнь 2025 года. Ниже кратко представлены основные факты и выводы авторов этой статьи. В индустрии искусственного интеллекта, в большей степени, чем в других технологических отраслях, преобладают мужчины, а OpenAI базируется в Сан-Франциско, самом сердце американской технологической индустрии. Однако исследование показало, что база пользователей ChatGPT глобальная и разнообразная. Когда ChatGPT только набирал популярность в конце 2022 — начале 2023 года, около 80 % пользователей имели «типично мужские» имена. К июню 2025 года ситуация изменилась: 52 % пользователей ChatGPT — женщины. Использование ChatGPT растёт быстрее в бедных странах, чем в богатых, хотя данные по странам не приводятся. Еженедельное количество пользователей ChatGPT превысило 700 миллионов. В базе пользователей преобладает молодёжь — почти половина изученных чатов велась людьми в возрасте от 18 до 25 лет. Люди всё чаще используют ChatGPT в личной жизни, а не для помощи на работе. Если в июне 2024 года запросы к чат-боту были примерно поровну распределены между рабочими и личными нуждами, то к июню 2025 года запросы, не связанные с работой, составляли уже 73 % от общего числа.

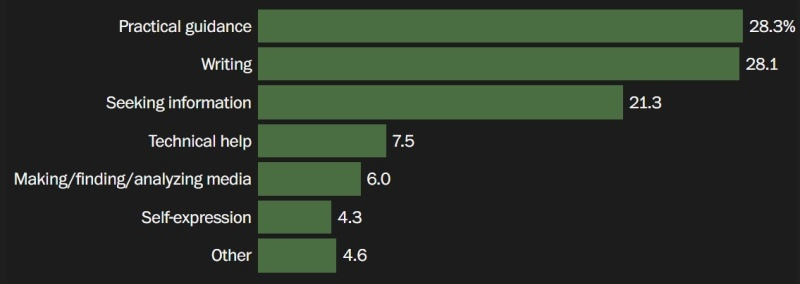

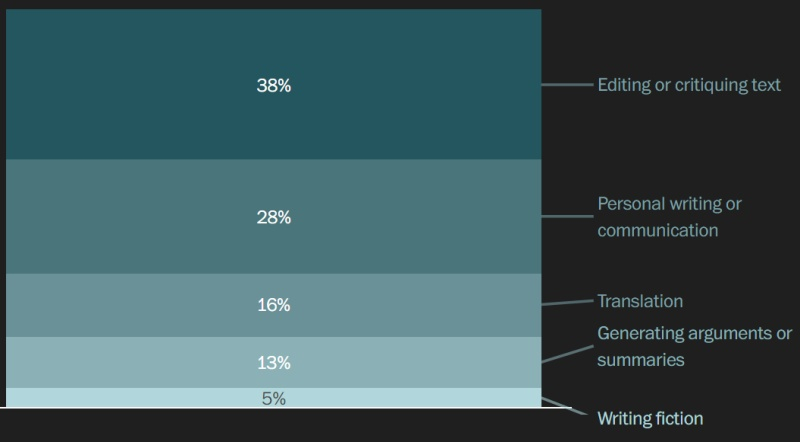

О чём пользователи спрашивают ChatGPT / Источник изображения: OpenAI OpenAI разделила изученные чаты на семь категорий. Самой крупной из них стала категория «практические рекомендации», составившая 28,3 % всех чатов — сюда относятся обращения за практическими советами, помощью в выполнении школьных заданий и советами по тренировкам. Вторая по величине категория — запросы по написанию текстов. На неё пришлось 28,1 % всех запросов в чатах. Наиболее популярной задачей было редактирование или критика текста, за которым следовали личные письма или общение — категория, определяемая как помощь с электронными письмами или публикациями в социальных сетях. Третьим по популярности вариантом использования ChatGPT был «поиск информации», категория, которая, по словам исследователей, «похоже, является очень близкой заменой веб-поиска». На этот вид запросов приходится 21,3 % всех обращений к чат-боту, а популярность этого вида запросов продолжает неуклонно расти. На «техническую помощь» пришлось 7,5 % от всех запросов, на «создание, поиск, анализ медиа» — 6,0 %. Любителей «самовыразиться» при общении с ИИ оказалось 4,3 %, «остальные» запросы составили 4,6 %. Способность ChatGPT и аналогичных инструментов ИИ генерировать компьютерный код была с энтузиазмом принята многими представителями технологической индустрии. Но исследование OpenAI показало, что только около 4,2 % чатов были связаны с программированием. Запросы по написанию текстов распределились следующим образом:

Запросы к ChatGPT по написанию текстов / Источник изображения: OpenAI Исследователи отдельно отметили, что целых 1,9 % пользователей обсуждают свою личную жизнь с ChatGPT. Именно столько чатов были связаны с просьбами о совете по вопросам отношений и чувств, а также с «обсуждением личных размышлений». При этом 0,4 % изученных разговоров были связаны с «играми и ролевыми играми», включая ситуации, в которых пользователи обращались с чат-ботом как с «ИИ-подружкой». Хотя исследователи OpenAI назвали эти варианты использования «довольно редкими», в обществе растёт обеспокоенность случаями возникновения у людей потенциально опасных мыслей после долгих часов, проведённых с чат-ботами. На прошлой неделе Федеральная торговая комиссия начала расследование потенциального вреда чат-ботов, выступающих в роли «компаньонов». Она обязала семь компаний, включая OpenAI, Google и Meta✴, предоставить информацию о своих продуктах. Анализ данных был произведён при помощи разработанной OpenAI технологии на основе искусственного интеллекта, которая позволяет исследователям анализировать содержание чатов, не нарушая чьей-либо конфиденциальности. Демографические данные о пользователях ChatGPT были получены из их регистрационной информации. Microsoft сможет претендовать на меньшую долю выручки OpenAI по условиям нового контракта

14.09.2025 [05:34],

Анжелла Марина

Компания OpenAI планирует к концу десятилетия сократить долю выручки, передаваемую коммерческим партнёрам, в частности Microsoft, с текущих 20 % до 8 %. Это изменение позволит OpenAI сохранить более $50 млрд дополнительного дохода, сообщает агентство Reuters со ссылкой на The Information. Однако не уточняется, является ли указанная сумма суммарным или годовым показателем.

Источник изображения: Andrew Neel/Unsplash Компании также ведут переговоры о стоимости аренды серверов, которые OpenAI будет оплачивать Microsoft, сообщил источник, знакомый с ситуацией. Одновременно OpenAI и Microsoft заключили необязательное соглашение о новых условиях сотрудничества, которое позволит OpenAI провести реструктуризацию в коммерческую компанию. По текущим условиям, некоммерческое подразделение OpenAI получит более $100 млрд, что составляет около 20 % от целевой оценки компании в $500 млрд на частных рынках капитала, отметил председатель совета директоров OpenAI Брет Тейлор (Bret Taylor). Это сделает некоммерческое подразделение OpenAI одной из наиболее финансово обеспеченных некоммерческих организаций в мире. Представители OpenAI и Microsoft не предоставили комментариев по запросу Reuters. Инвесторы вложили в OpenAI 50 млрд, но Сэм Альтман обещает прибыль не раньше 2029 года

14.09.2025 [05:25],

Анжелла Марина

Компания OpenAI прогнозирует, что к 2028 году её продажи достигнут $100 млрд. Однако генеральный директор Сэм Альтман (Sam Altman) предупредил инвесторов, что прибыль компания начнёт получать только в 2029 году. По сообщению TechSpot, OpenAI продолжает нести многомиллиардные убытки, несмотря на масштабные инвестиции в вычислительные мощности и разработку собственных полупроводниковых компонентов.

Источник изображения: Emiliano Vittoriosi/Unsplash OpenAI взяла на себя обязательства по расходам на сотни миллиардов долларов в течение следующего десятилетия, включая ежегодные платежи в размере $60 млрд за вычислительные мощности Oracle и $18 млрд инвестиций в совместные дата-центры. Однако внутренние прогнозы компании указывают на сохранение убытков в течение нескольких лет, при этом Альтман предупредил инвесторов, что совокупные убытки к 2029 году могут достичь $44 млрд. Рост бизнеса компании зависит от готовности рынка платить за ИИ-услуги. Так, OpenAI насчитывает более 700 миллионов пользователей ChatGPT, но большинство из них не платят за него. Исследование ведущей американской венчурной компании Menlo Ventures показывает, что только 3 % потребителей регулярно платят за ИИ-сервисы, при этом 80 % компаний, согласно отчёту международной консалтинговой компании McKinsey, не отмечают существенного роста прибыли от внедрения искусственного интеллекта. Основатель Link Ventures Дэйв Блундин (Dave Blundin) охарактеризовал ИИ как «самое трансформационное изобретение в истории человечества», но предупредил о неизбежной финансовой коррекции на рынке. Несмотря на это, инвесторы продолжают финансирование OpenAI, вложив в неё около $50 млрд за последний год. При этом Microsoft продлила партнёрство с OpenAI, что поможет ей преобразоваться в коммерческую организацию и получить доступ к дополнительным $19 млрд финансирования. OpenAI после критики GPT-5 реорганизовала команду, отвечающую за поведение ИИ

07.09.2025 [00:29],

Анжелла Марина

OpenAI провела реорганизацию своей команды Model Behavior, отвечающей за поведенческие характеристики ИИ-моделей компании. Команда будет интегрирована в более крупный подраздел Post Training, а её основатель Джоанн Джанг (Joanne Jang) возглавит лабораторию под названием OAI Labs по разработке принципиально новых форматов взаимодействия человека и искусственного интеллекта (ИИ).

Источник изображения: сгенерировано AI Согласно служебной записке, которой ознакомилось издание TechCrunch, главный научный сотрудник OpenAI Марк Чэн (Mark Chen) сообщил, что команда Model Behavior, насчитывающая около 14 исследователей, теперь будет подчиняться руководителю отдела Post Training Максу Шварцеру (Max Schwarzer). Представитель компании подтвердил факт реорганизации. Эта команда отвечала за формирование «личности» моделей и в частности, за снижение подобострастия, когда ИИ безоговорочно поддерживал мнение пользователя, даже если они были потенциально вредны, а также за балансировку политических предубеждений в ответах и участие в формировании позиции компании по вопросам «сознания» моделей. Чэн пояснил, что объединение команд позволит сбаллансировать работу над поведением моделей с ядром их технической разработки. В последние месяцы OpenAI столкнулась с волной критики после обновления GPT-5, так как пользователи сочли его ответы ИИ слишком недружелюбными. В ответ компания вернула доступ к предыдущим версиям, включая GPT-4o, и выпустила обновление, призванное сделать ответы модели «теплее», при этом избежав заискивания и подобстрастия. Серьёзность проблемы подчёркивает и судебный иск от родителей подростка, которые обвинили ChatGPT на базе GPT-4o в том, что тот не смог пресечь суицидальные мысли их 16-летнего сына. Джанг в свою очередь отметила, что на раннем этапе работы OAI Labs будет фокусироваться на исследовании моделей, выходящих за рамки чата с акцентом на агентный ИИ и автономию. Она видит будущие системы как инструменты для мышления, создания, игры, обучения и общения. На вопрос о возможном сотрудничестве с бывшим главным дизайнером Apple Джони Айвом (Jony Ive), который сейчас работает с OpenAI над линейкой аппаратных устройств, Джанг ответила, что открыта к разным идеям, но начнёт с областей, в которых уже имеет опыт. ChatGPT остаётся безусловным лидером рынка чат-ботов с ИИ

06.09.2025 [18:07],

Павел Котов

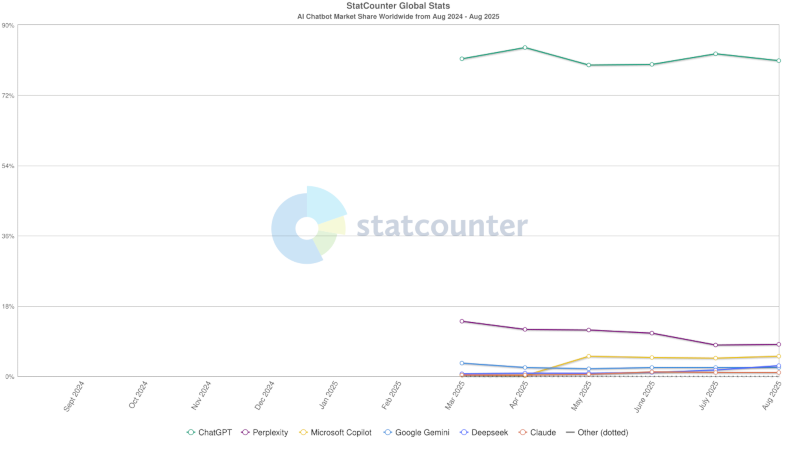

Лидером на мировом рынке чат-ботов с искусственным интеллектом с большим отрывом остаётся OpenAI ChatGPT. Второе место с большим отрывом занимает Perplexity, но серебряному призёру всё сильнее угрожает бронзовый — Microsoft Copilot.

Источник изображения: statcounter.com ChatGPT занимает 80,92 % мирового рынка чат-ботов — таковы показатели статистического сервиса StatCounter, основанные на более чем 3,8 млрд просмотрах страниц на более чем 1,5 млн сайтов в период с марта по август 2025 года. Пик популярности ChatGPT пришёлся на апрель, когда у платформы было 84,2 % мировой аудитории, и несмотря на снижение показателей в последующие месяцы, чат-бот сохранил за собой более четырёх пятых мировой аудитории, значительно опережая любого конкурента. Формально ближайшим конкурентом является Perplexity, чьи позиции представляются шаткими: в марте за сервисом были 14,1 % аудитории, к июлю его популярность снизилась до 8,0 %, а в августе немного восстановилась и составила 9,0 %. Perplexity стремится выделиться, предлагая инструменты ИИ для исследований и интеграции актуальных данных. Но этого, похоже, недостаточно, чтобы противостоять крупнейшему конкуренту. Тем временем Microsoft Copilot продемонстрировал заметный рост. В марте он начал с доли 0,3 %, к маю оперативно поднялся до 5 %, а летом колебался в районе 4–5 %. Это значит, что активная интеграция ИИ в экосистемы Windows и Office работает. От ChatGPT чат-бот Copilot, конечно, значительно отстаёт, но при наличии устойчивого роста он уже соперничает с Perplexity за второе место на рынке. Если интеграция ИИ в продукты Microsoft продолжит расширяться, а доверие пользователей будет расти, Copilot имеет шансы стать самым серьёзным конкурентом лидеру. Доли остальных игроков остаются незначительными. Gemini, несмотря на обширное присутствие Google, удерживает от 1,9 % до 3,3 %; DeepSeek вырос в августе до 2,7 %; а Anthropic Claude так и не преодолел даже 1,2 %. Функция Projects в ChatGPT стала доступна бесплатным пользователям

04.09.2025 [12:05],

Антон Чивчалов

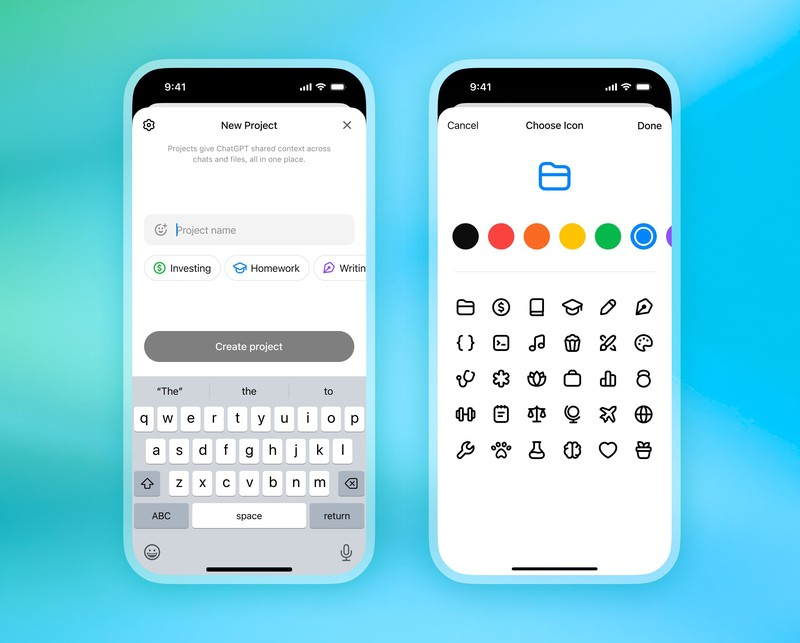

Компания OpenAI предоставила бесплатным пользователям ChatGPT доступ к функции Projects, которая раньше предлагалась только платным подписчикам. Projects — «проекты» — позволяют распределять разговоры с ИИ по темам, настраивать запросы, ограничивать доступ к данным, выбирать визуальное оформление и т. д., сообщает Engadget.

Источник изображения: OpenAI Функция Projects уже доступна в приложении для Android и в браузерной веб-версии. iOS-приложение будет обновлено «в ближайшие дни», говорится в официальном аккаунте OpenAI в X. Projects представляют собой систему проектов-папок, где можно распределять разговоры с ChatGPT в зависимости от темы. У каждого такого проекта может быть собственный цвет и иконка по выбору пользователя, свои настройки и ограничения на информацию, которой может пользоваться ИИ. Эти возможности особенно пригодятся тем, кто работает с нейросетями регулярно и в сложных задачах. Также в Projects повышен лимит на загрузку файлов. На бесплатном тарифе можно прикреплять 5 файлов, на Plus — 25, на Pro — 40. Ранее Projects была доступна только платным подписчикам, но в OpenAI взяли курс на постепенное расширение возможностей для широкого круга пользователей. Раньше точно так же перешли из платной в бесплатную категорию функции Deep Research и ChatGPT Voice. В компании считают, что такие шаги будут стимулировать переход бесплатных пользователей на платные тарифы. ChatGPT получит родительский контроль и научится выявлять психологические проблемы у пользователей

03.09.2025 [11:38],

Антон Чивчалов

В OpenAI сообщили о планах внедрения в ChatGPT новых функций, направленных на улучшение реакций ИИ в ситуациях, когда пользователь испытывает эмоциональное или психологическое напряжение, а также новых средств родительского контроля, пишет Silicon Angle.

Источник изображения: Nicolò Canu/Unsplash Первое обновление затронет так называемый маршрутизатор в GPT-5 — компонент ИИ, который анализирует запрос пользователя и решает, какая из языковых моделей лучше подходит для его обработки. В новой версии маршрутизатор сможет распознавать признаки острого психологического напряжения, и такие запросы будут направляться модели, «заточенной» для рассуждений и бесед с пользователями. Такая модель способна предоставлять «более полезные ответы», чем другие, говорят в OpenAI. Ещё одно нововведение — система родительского контроля. Родители смогут задавать возрастные ограничения, отключать историю чатов и получать уведомления о потенциально опасных запросах детей. А если система решит, что ребёнок находится в состоянии психологического напряжения, она может послать родителям уведомление. Эти функции заработают уже в течение месяца. В OpenAI говорят, что функции родительского контроля разрабатываются с участием специалистов в области развития подростков и психического здоровья. В частности, компания сотрудничает с международной сетью врачей Global Physician Network, в которую входят свыше 200 специалистов различного профиля. «Их работа напрямую влияет на наши исследования в области безопасности, обучение моделей и другие меры вмешательства», — говорится в заявлении компании. Новые инициативы OpenAI продолжают курс на повышение безопасности искусственного интеллекта, о чём было объявлено в прошлом месяце. Также в компании ведётся работа над улучшением блокировки потенциально опасных ответов ИИ. OpenAI решили засудить за самоубийство подростка — компания пообещала изменить ChatGPT

27.08.2025 [12:57],

Павел Котов

Руководство OpenAI подробно рассказало о планах по устранению сбоев, возникающих у ChatGPT при работе с «ситуациями деликатного характера». Компания обратилась к этому вопросу после того, как на неё подала в суд семья подростка, совершившего самоубийство.

Источник изображения: Mariia Shalabaieva / unsplash.com «Мы продолжим улучшать [ChatGPT], руководствуясь рекомендациями экспертов и ответственностью перед людьми, которые пользуются нашими инструментами, и надеемся, что к нам подключатся остальные, чтобы эта технология защищала людей, когда они наиболее уязвимы», — пообещала компания в корпоративном блоге. Накануне на OpenAI подали в суд родители совершившего суицид 16-летнего Адама Рейна (Adam Raine) — истцы утверждают, что «ChatGPT активно помогал Адаму изучать способы самоубийства». В OpenAI пояснили, что ChatGPT обучен предлагать помощь людям, которые выражают опасные намерения. Но в продолжительной переписке эта функция может начать работать со сбоями, и чат-бот иногда даёт ответы, противоречащие политике безопасности компании. Разработчик рассказал о грядущем обновлении флагманской модели GPT-5, с которым чат-бот научится снижать накал в обсуждении. Более того, компания изучает возможность переключать пользователей на «сертифицированных психотерапевтов до того, как обострится кризис» — не исключается вариант с формированием группы экспертов, с которыми пользователи могли бы связываться напрямую из ChatGPT. OpenAI также пообещала добавить элементы управления, которые помогут родителям лучше понять, как используют ChatGPT их дети. С членами семьи Рейн, по словам её адвоката, компания связаться не пыталась — никто не выразил соболезнования и не изъявлял желания обсудить работу по повышению безопасности продукции компании. Известны и другие случаи самоубийств среди пользователей ChatGPT, пишет CNBC. Популярность сервисов искусственного интеллекта продолжает расти, и всё чаще возникают опасения по поводу их применения для терапии, общения и удовлетворения других социальных потребностей. ИИ-бот OpenAI ChatGPT использует поисковик Google при генерации ответов на запросы пользователей

23.08.2025 [07:22],

Владимир Фетисов

OpenAI, являющаяся разработчиком популярного ИИ-бота ChatGPT, продолжает конкурировать с Google в сфере онлайн-поиска. Несмотря на это, компания, как сообщают сетевые источники, использует данные поисковой системы Google для обучения и поддержки своего чат-бота.

Источник изображения: Shutterstock Согласно имеющейся информации, OpenAI использует данные, собираемые через поисковик Google с помощью SerpApi — сервис парсинга веб-данных, базирующийся в Остине, штат Техас. Эти данные ChatGPT использует для генерации ответов в режиме онлайн на такие темы, как новости, спорт и финансовые рынки, т.е. по тем направлениям, где собственные инструменты OpenAI отстают от конкурентов. Эта новость выглядит особенно удивительной, если учесть прежнюю позицию Google по данному вопросу. Обнародованные в ходе продолжающегося антимонопольного разбирательства с Минюстом США документы указывают на то, что в прошлом году поисковый гигант отклонил прямой запрос OpenAI на доступ к своему индексу для повышения качества работы ChatGPT. Однако в настоящее время OpenAI арендует серверы облачной платформы Google для ChatGPT. Это можно расценивать как сигнал к тому, что деловой прагматизм способен преодолевать напряжённость, обусловленную конкурентным противостоянием. Отметим, что список клиентов сервиса SerpApi не ограничивается OpenAI. По данным источника, другие технологические гиганты, такие как Meta✴ Platforms, Apple и Perplexity (конкурент ChatGPT в сфере поиска), также пользуются SerpApi. Несмотря на очевидные разногласия, Google пока не предпринимала юридических действий для того, чтобы закрыть этот сервис. Вероятно, это связано с давлением на поискового гиганта со стороны отраслевых регуляторов, в результате чего Google могут обязать открыть поисковый индекс для конкурентов. Похоже, что OpenAI действительно использует поисковик Google. Чтобы проверить это бывший инженер Google Абхишек Айер (Abhishek Iyer) создал несколько фейковых веб-страниц, которые отображались только в индексе поисковика Google. Позже он задал ChatGPT вопросы, связанные с данными, размещёнными на созданных ранее страницах. В ответ на это ChatGPT давал ответы, содержащие информацию с тех самых страниц. Это указывает на то, что фрагменты поискового индекса Google действительно используются ИИ-ботом OpenAI. Это важно, поскольку краткие ответы на пользовательские запросы, отображающиеся в верхней части поисковой выдачи Google, генерируются с помощью собственных алгоритмов компании. Похоже, что OpenAI не хватает своего поискового робота и доступа к поисковому API Microsoft Bing для генерации таких же качественных ответов, особенно при обработке сложных и запутанных запросов. Несмотря на стремительный рост ChatGPT, еженедельная пользовательская аудитория которого сейчас составляет 700 млн человек, в плане масштабности он отстаёт от Google. Поисковый гигант обрабатывает более 5 трлн запросов в год, и темпы роста остаются высокими. Очевидно, что в дальнейшем конкуренция в сфере онлайн-поиска между компаниями будет усиливаться. Месячная выручка OpenAI превысила $1 млрд, спрос на вычислительные мощности остаётся ненасытным

22.08.2025 [04:55],

Алексей Разин

В своём интервью CNBC финансовый директор OpenAI Сара Фрайар (Sarah Friar) заявила о наличии на рынке «ненасытного спроса на GPU и вычисления», тем самым развеяв опасения некоторых участников рынка ИИ о близости «сдувания пузыря». Для самой OpenAI важной вехой в июле стало превышение месячной выручкой величины в $1 млрд.

Источник изображения: OpenAI На прошлой неделе генеральный директор OpenAI Сэм Альтман (Sam Altman) заявил, что компания готова тратить триллионы долларов США на центры обработки данных, в этом отношении финансовый директор демонстрирует с ним единодушие. По словам Фрайар, для OpenAI самой большой трудностью является удовлетворение спроса на вычислительные мощности в сфере ИИ. «Именно по этой причине мы запустили Stargate. Поэтому мы строим больше», — заявила она. Проект Stargate, подразумевающий финансовое участие SoftBank, Oracle и арабских инвесторов, предусматривает строительство крупных центров обработки данных для ИИ на территории США в течение ближайших четырёх лет общей стоимостью до $500 млрд. OpenAI активно привлекает новых клиентов к подобной деятельности, включая Oracle и Coreweave, но подчёркивает, что и крупнейший акционер стартапа в лице Microsoft активно в этом участвует. «Microsoft будет оставаться для нас важным партнёром в ближайшие годы, и я думаю, что мы тесно связаны благодаря нашей интеллектуальной собственностью. Не забывайте, что ИИ-продукты Microsoft основаны на технологии OpenAI», — пояснила Фрайар. Рост выручки OpenAI пока и не думает прекращаться, в прошлом месяце она достигла $1 млрд, что позволяет в годовом выражении получить не менее $10 млрд, а то и все $12,7 млрд, заложенные в прогноз изначально. Финансовый директор компании отметила, что выход количества проявляющих свою активность еженедельно пользователей на рубеж в 700 млн человек позволяет обнаружить своенравность людей. Выход модели ChatGPT-5 сопровождался критикой со стороны пользователей. Количество подписчиков Plus и Pro на данном этапе только растёт, как отметила Сара Фрайар. В ChatGPT появилась подписка дешевле $5 в месяц, но пока лишь в одной стране

19.08.2025 [13:07],

Анжелла Марина

OpenAI запустила в Индии новый тариф ChatGPT Go — подписку за 399 рупий в месяц (около $4,6), которая в пять раз дешевле текущего тарифа Plus ($23). Предложение ориентировано на пользователей, которым нужны несколько расширенные функции чата, генерации изображений и обработки файлов, но при этом важна доступная цена. Оплата через платёжную систему Индии UPI (Unified Payments Interface) теперь поддерживается для всех тарифов, включая новый.

Источник изображения: ilgmyzin / unsplash.com По сообщению TechCrunch со ссылкой на слова вице-президента OpenAI и главы ChatGPT Ника Тёрли (Nick Turley), подписка ChatGPT Go увеличивает лимиты в 10 раз по сравнению с бесплатной версией. Теперь пользователи смогут отправлять больше сообщений, генерировать больше изображений и загружать больше файлов. Также улучшена функция памяти, что позволяет чат-боту давать более персонализированные ответы. Тёрли подчеркнул, что снижение стоимости было одним из главных запросов аудитории, и Индия стала первой страной, где тестируется новый тариф. В будущем компания может расширить его на другие регионы. Ранее инженер Тибор Блахо (Tibor Blaho), известный своими утечками информации о новых продуктах в сфере искусственного интеллекта (ИИ), предсказал появление этого тарифа, и хотя OpenAI пока ограничивает его доступность Индией, на странице поддержки указано, что ведётся работа по расширению географии. Индия является стратегически важным рынком для OpenAI. Генеральный директор OpenAI Сэм Альтман (Sam Altman) в одном из подкастов прямо называет Индию вторым по величине рынком компании. По данным аналитиков AppFigures, за последние 90 дней в стране были загружены более 29 млн копий приложения ChatGPT, что сделало его мировым лидером по числу установок. Однако монетизация остаётся низкой: за тот же период доходы составили всего $3,6 млн. Запуск ChatGPT Go призван увеличить число платных подписчиков за счёт более доступной цены. Другие ИИ-компании также активно работают с индийскими пользователями. В прошлом месяце Perplexity совместно с оператором Airtel начала раздавать бесплатные подписки Pro, а Google предложила студентам бесплатный доступ к ИИ-инструментам на год. OpenAI пока не раздаёт бесплатные тарифы, но локальная адаптация цен может повысить конверсию в платёжные подписки. OpenAI заработала $2 млрд на мобильном приложении ChatGPT — в 30 раз больше всех конкурентом вместе

16.08.2025 [01:05],

Анжелла Марина

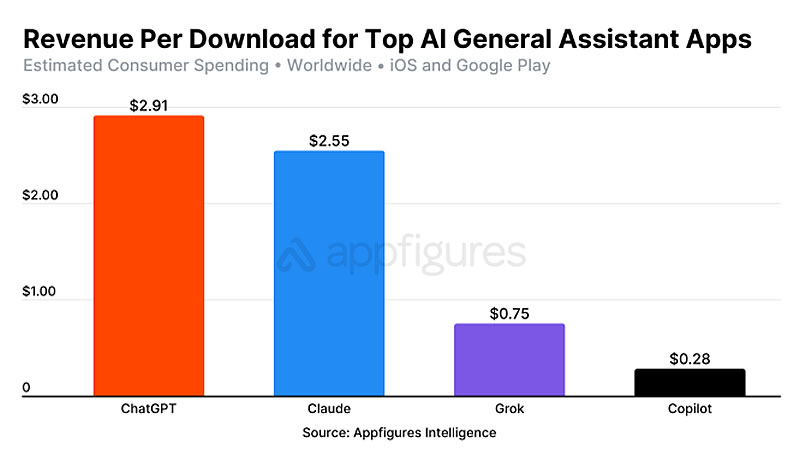

Мобильное приложение ChatGPT от OpenAI заработало $2 млрд с момента своего запуска в мае 2023 года, принося в среднем $2,91 с каждой установки. Основной рост пришёлся на 2025 год — доход за первые семь месяцев составил $1,35 млрд, что на 673 % больше, чем за аналогичный период 2024 года. Эта сумма примерно в 30 раз превышает совокупные доходы от мобильных приложений конкурентов в лице Claude, Copilot и Grok.

Источник изображения: Solen Feyissa/Unsplash По сообщению TechCrunch со ссылкой на данные компании Appfigures, специализирующейся на исследовании мобильного рынка, ChatGPT демонстрирует беспрецедентную монетизацию. В среднем приложение приносит $193 млн в месяц — для сравнения, ближайший конкурент Grok от xAI генерирует лишь $3,6 млн, что составляет 1,9 % от показателей ChatGPT. Разрыв ещё заметнее в пересчёте на одну загрузку: $2,91 у ChatGPT против $0,75 у Grok и $0,28 у Copilot. Главными рынками оказались США (38 % выручки) и Германия (5,3 %), тогда как больше всего загрузок пришлось на Индию (13,7 %). Глобальное же число установок ChatGPT подтверждает доминирование компании: 690 млн против 39,5 млн у Grok.

Источник изображения: appfigures.com Только за 2025 год приложение скачали 318 млн раз — в 2,8 раза больше, чем за тот же период прошлого года. Среднемесячное количество загрузок выросло на 180 %, достигнув 45 млн. При этом Grok изначально отставал в мобильном сегменте и до января 2025 года у него не было отдельного приложения для iOS, а версия для Android появилась лишь в марте. Эксперты отмечают, что эти данные отражают только доходы от мобильных пользователей, не учитывая веб-подписки и API. В ChatGPT может появиться реклама, но руководство OpenAI постарается этого не допустить

15.08.2025 [21:48],

Андрей Созинов

OpenAI изучает возможности для получения дополнительной выручки, одной из которых может стать появление рекламы в ChatGPT. Руководитель сервиса Ник Тёрли (Nick Turley) в подкасте Decoder признал, что не исключает появления рекламы в самом популярном чат-боте, но подчеркнул, что её интеграция потребует максимально «взвешенного и деликатного» подхода.

Источник изображения: ChatGPT При этом он дал понять, что сам ChatGPT может так и не стать рекламной площадкой, а объявления — если и появятся — логичнее ожидать в других сервисах компании: «Мы будем строить и другие продукты, у которых могут быть иные варианты монетизации… возможно, ChatGPT просто не тот продукт, где уместна реклама, потому что он глубоко привержен целям пользователя. Но это не значит, что мы не будем экспериментировать в будущем». Вопрос рекламы для OpenAI остаётся спорным. Генеральный директор компании Сэм Альтман (Sam Altman) ранее неоднократно заявлял, что интеграция рекламы в ChatGPT — это «крайняя мера». В прошлом году он признал, что совмещение ИИ и рекламы «особенно тревожит» его, но совсем исключать такую возможность не стал. В июньском выпуске официального подкаста OpenAI Альтман выразил более мягкую позицию: «Я не полностью против этого». Для сравнения, конкурирующая xAI Илона Маска (Elon Musk) уже разрабатывает схему показа рекламы в ответах своего чат-бота Grok. По словам Тёрли, OpenAI хоть и рассматривает новые возможности для получения доходов, но основной акцент в ChatGPT останется на подписочной модели: «Она невероятна, её темпы роста впечатляют, а потенциал далеко не исчерпан». Подписки — основной источник дохода OpenAI, и в этом году компания ожидает выручить на них $12,7 млрд — более чем втрое больше $3,7 млрд, заработанных в 2024-м. Однако расходы всё ещё превышают доходы, и выйти на положительный денежный поток OpenAI рассчитывает только к 2029 году. Тёрли также сообщил, что ChatGPT «только что преодолел отметку в 700 млн пользователей». Число платных подписчиков он не назвал, но в апреле компания сообщала, что их 20 млн. «Я не считаю, что преобладание бесплатной аудитории — это проблемный фактор. Это воронка, на базе которой мы можем создавать различные предложения для тех, кто готов платить», — отметил он. Ещё одно направление монетизации для OpenAI — комиссии с покупок, совершённых по рекомендациям ChatGPT. OpenAI «активно исследует» такую возможность и уже обсуждает проект Commerce in ChatGPT «с рядом продавцов». При этом Тёрли отдельно подчеркнул, что подобные комиссионные не должны влиять на качество рекомендаций: «Магия ChatGPT в том, что он самостоятельно выбирает продукты без какого-либо вмешательства, и это важно сохранить». OpenAI вернула выбор ИИ-моделей в ChatGPT — включая четвёрку устаревших

13.08.2025 [13:26],

Павел Котов

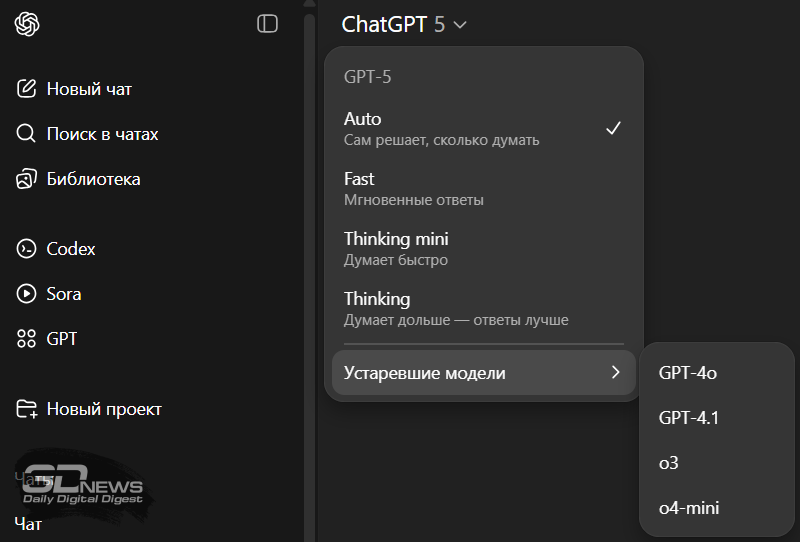

На минувшей неделе OpenAI представила модель искусственного интеллекта GPT-5 и пообещала, что она упростит работу с чат-ботом. Разработчик рассчитывал, что маршрутизатор, автоматически выбирающий между режимами быстрых ответов и рассуждений, избавит пользователей от необходимости делать это самостоятельно, однако аудитория сервиса оказалась иного мнения. В итоге OpenAI вернула меню выбора моделей, хотя и не в прежнем виде. Кроме того, вернулось больше старых моделей.

Источник изображения: ilgmyzin / unsplash.com Теперь для всех пользователей ChatGPT доступно меню выбора трёх режимов GPT-5: Auto, Fast и Thinking. Первый оставляет автоматический выбор модели, второй переводит чат-бот в режим быстрых ответов, а третий — в режим рассуждений. Пользователям платных тарифов компания вернула возможность выбора между моделями, которые теперь считаются устаревшими, в том числе GPT-4o, GPT-4.1 и o3. При этом GPT-4o доступна сразу в меню выбора моделей, а остальные необходимо добавлять в настройках сервиса. «Мы работаем над обновлением характера GPT-5, который должен стать теплее теперешнего, но не таким назойливым (для большинства пользователей) как GPT-4o. Однако один из уроков последних дней состоит в том, что нам нужно просто перейти к миру с более персонализированной настройкой моделей под каждого пользователя», — написал в соцсети X гендиректор OpenAI Сэм Альтман (Sam Altman).  Появление меню выбора версий GPT-5 говорит о том, что не всем пользователям пришёлся по вкусу автоматическое определение режима. Ожидания от системы нового поколения были заоблачными, люди надеялись, что GPT-5 расширит границы возможностей ИИ, как это было с GPT-4, но развёртывание новой модели оказалось сложнее, чем ожидалось. Отключение GPT-4o и других моделей ИИ в ChatGPT вызвало недовольство пользователей, которые привыкли к их манерам ответов и особенностям, и в OpenAI этого не ожидали. Масла в огонь подлил маршрутизатор, который не работал должным образом и создал у некоторых пользователей ощущение, что производительность GPT-5 ниже, чем у её предшественниц. Автоматический выбор модели в зависимости от запроса — задача непростая. Необходимо согласовать возможности ИИ с предпочтениями пользователя и конкретным вопросом, который он задаёт; при этом маршрутизатор должен принять решение за доли секунды, чтобы даже в быстром режиме ответ поступил оперативно. Для некоторых пользователей скорость ответа не принципиальна — им важнее, чтобы ответ был развёрнутым или, например, содержал противоречия. Явление привязанности человека к определённым моделям ИИ пока ново и недостаточно изучено. Известен случай, когда при отключении устаревшей модели Anthropic Claude 3.5 Sonnet несколько сотен жителей Сан-Франциско устроили её «похороны». Некоторых пользователей с неустойчивой психикой ИИ способен затянуть в пучину бредовых идей, настаивая на их нормальности. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |