|

Опрос

|

реклама

Быстрый переход

Лакомый кусочек Google: на Chrome нашёлся ещё один потенциальный покупатель

24.04.2025 [09:10],

Дмитрий Федоров

Perplexity заявила о готовности купить браузер Chrome в случае, если суд обяжет Google его продать. При этом в компании подчёркивают, что предпочтительнее, чтобы продукт остался в экосистеме Google, чем оказался под контролем OpenAI, поскольку это может поставить под угрозу открытость и стабильность проекта Chromium.

Источник изображения: Perplexity Дмитрий Шевеленко (Dmitry Shevelenko), директор по бизнесу Perplexity, сообщил, что не хотел давать показания в антимонопольном процессе против Google, опасаясь последствий со стороны корпорации. Однако после получения повестки он явился в суд, где использовал своё выступление для предложения потенциальной сделки: выкупа браузера Chrome его компанией. Дело рассматривается в окружном суде округа Колумбия под председательством судьи Амита Мехты (Amit Mehta), который рассматривает возможные меры в случае признания Google виновной в злоупотреблении доминирующим положением на рынке поисковых услуг. Если суд примет позицию Министерства юстиции США, Google будет обязана выделить Chrome в отдельную компанию. Под потенциальное разделение может попасть не только сам Chrome, но и его открытая версия — Chromium. Google в судебных документах называет такую меру опасной, утверждая, что передача контроля может привести к прекращению разработки, снижению качества или началу монетизации продукта, что повлияет на весь рынок веб-браузеров, включая сторонние проекты, зависящие от Chromium. Во время дачи показаний Шевеленко выразил уверенность, что Perplexity сможет управлять браузером Chrome без ухудшения его качества и монетизации. На вопрос адвоката, считает ли он, что кто-либо, кроме Google, способен масштабировать продукт до текущего уровня, он ответил: «Я думаю, мы могли бы справиться». Perplexity выразила готовность обеспечить стабильную и открытую поддержку браузера, если такая необходимость возникнет. Это не первое заявление Perplexity о намерении приобрести ключевой технологический продукт. Ранее компания также проявляла интерес к покупке TikTok — платформы, которая может быть запрещена в США из-за опасений, связанных с её принадлежностью китайской компании ByteDance. Хотя Perplexity была основана менее трёх лет назад, она активно участвует в обсуждении возможных сделок на фоне давления со стороны американских регуляторов на технологических гигантов. Шевеленко также представил перечень проблем, с которыми сталкивается Perplexity в условиях доминирования Google на мобильных платформах. Он указал, что для настройки Perplexity в качестве голосового ассистента по умолчанию на Android необходимо пройти множество этапов. Сам он, как признался, был вынужден прибегнуть к помощи коллеги, чтобы завершить настройку, так как давно пользуется iPhone. Даже после установки по умолчанию пользователю необходимо активировать ассистент вручную, тогда как Google Assistant запускается по голосовой команде. В ходе дачи показаний Шевеленко описал переговоры с несколькими производителями смартфонов в США о возможности предустановки Perplexity в качестве поисковой системы или ассистента по умолчанию. Однако сделки не состоялись. Он отметил, что один из производителей отказался от соглашения, так как опасался потерять долю выручки, которую обеспечивает партнёрство с Google. По словам Шевеленко, эти контракты ставят компании в положение, при котором любое действие, не согласованное с Google, может повлечь за собой сокращение выплат. «У них фактически пистолет у виска», — заявил он. Судья Мехта ранее установил, что Google использовала исключительные соглашения с производителями телефонов и браузеров, чтобы ограничить дистрибуцию конкурентов. Такие контракты запрещают производителям предустанавливать альтернативные сервисы, что блокирует Perplexity на уровне дистрибуции. Шевеленко привёл пример производителя, по открытым данным — это Motorola, который согласился предустановить Perplexity, но не сделать его ассистентом по умолчанию. Обе стороны пытались найти технические и юридические способы обойти ограничения, но не смогли выйти за пределы условий, продиктованных Google. Google Gemini проиграл ИИ-гонку — пользователи предпочитают ChatGPT и Meta✴ AI

24.04.2025 [00:52],

Николай Хижняк

Количество ежемесячных пользователей ИИ Gemini составляет около 350 млн человек, что значительно меньше, чем у ChatGPT от OpenAI и даже у Meta✴ AI. Такая цифра была озвучена в ходе недавно обнародованных данных судебного заседания, в котором Google принимает участие в качестве ответчика.

Источник изображения: androidauthority.com По данным The Information, в ходе продолжающегося рассмотрения антимонопольного иска к Google компания на одном из последних судебных заседаний показала слайд, подробно описывающий количество активных пользователей ИИ-помощника Gemini. Согласно этим данным, по состоянию на март 2025 года число активных ежемесячных пользователей Gemini составило 350 млн человек по всему миру. Ежедневно ИИ от Google пользуются около 35 млн человек. Несмотря на отставание от конкурентов, Google увеличила долю пользователей Gemini с октября 2024 года. Тогда ежедневно ИИ-помощником пользовались 9 млн человек, а ежемесячная аудитория составляла 90 млн человек. Google представила эти цифры в контексте заявления Министерства юстиции США о том, что компании следует запретить расширять своё доминирование в поиске с использованием ИИ. Однако очевидно, что на данный момент Google является аутсайдером в этой области. По сравнению с её показателями OpenAI и Meta✴ значительно опережают её. TechCrunch сообщает, что по состоянию на сентябрь 2024 года число пользователей Meta✴ AI приближалось к 500 млн в месяц, в то время как OpenAI недавно заявила, что еженедельно ChatGPT пользуются более 400 млн человек по всему миру. Хотя методы расчёта этих данных варьируются от компании к компании, это, безусловно, указывает на значительное отставание Google от OpenAI по числу активных пользователей ИИ-ассистента. Однако остаётся неясным, учитываются ли в данных Google интеграции Gemini в такие продукты, как Workspace и Gmail, у которых, очевидно, гораздо более широкая пользовательская база. Российский суд запретил Google продолжить процесс по банкротству «Гугл» в США

23.04.2025 [23:36],

Анжелла Марина

Арбитражный суд Москвы запретил ирландской компании Google Ireland Limited (GIL) продолжать судебные разбирательства в США против российских кредиторов обанкротившегося ООО «Гугл». Кроме того, суд установил судебную неустойку в пользу Russia Today в размере 1 млрд руб. Как сообщают «Ведомости», такое решение стало ответом на попытку GIL обойти российское дело о банкротстве через американскую юрисдикцию.

Источник изображения: Sasun Bughdaryan / Unsplash Судебный спор между российской и американской юрисдикциями начался с обращения Google Ireland в январе 2025 года в калифорнийский суд (США) с требованием запретить участие конкурсного управляющего ООО «Гугл» в российском деле о банкротстве. Американский суд оперативно принял обеспечительные меры, ограничивающие действия российского управляющего. В ответ Москва ввела свои обеспечительные меры, блокирующие параллельное разбирательство в США. Ключевые споры касаются двух вопросов: субсидиарной ответственности и оспаривания сделки 2018 года, в результате которой доля ООО «Гугл» в российской выручке сократилась с 20 % до 3 %. Сумма требований превышает 300 млрд рублей, а с учётом дивидендов и астрентов (штрафных санкций) под угрозой могут оказаться активы на сумму до $3 трлн, принадлежащие холдинговой компании Alphabet, управляющей компании Google Inc и её дочерним структурам. Несмотря на запрет, Google Ireland проигнорировала решение российского суда и продолжила процесс в Калифорнии. Однако юристы Национального адвокатского бюро Art de Lex, представляющие интересы Russia Today, указали, что это нарушает статью 248.2 Арбитражного процессуального кодекса РФ, запрещающую судебные разбирательства с участием лиц, в отношении которых введены меры ограничительного характера. Правовая коллизия осложняется параллельными процессами в разных странах. Высокий суд Англии и Уэльса ранее запретил российским СМИ, в частности RT, телеканалу «Спас» и «Царьграду», вести дела против Google за пределами США и Великобритании. При этом российские компании активно ищут правовые механизмы защиты своих интересов в других юрисдикциях, включая Турцию, Венгрию и ЮАР. Однако Google стремится заблокировать эти попытки путём обращения в американские суды. Конфликт приобретает международный характер, затрагивая интересы крупнейших медиахолдингов и технологических компаний. При этом в Art de Lex отмечают, что западные суды всё чаще подменяют правовые аргументы политическими. Так, английский суд назвал требования RT «несправедливым отъёмом активов», а размер астрента — «в 20 трлн раз больше мирового ВВП». Российская сторона продолжает активные действия, включая обращение в регулирующие органы США с обвинениями Alphabet в недостаточном раскрытии информации о рисках для компании, связанных с судебными процессами в различных юрисдикциях. Итоговое решение может быть принято в США уже в апреле 2025 года. Google и X могут стать следующими целями для Еврокомиссии

23.04.2025 [19:03],

Дмитрий Федоров

Google и принадлежащая Илону Маску (Elon Musk) платформа X могут стать следующими компаниями, против которых Европейская комиссия намерена применить штрафные санкции, несмотря на опасения по поводу возможных ответных тарифов со стороны США.

Источник изображения: ALEXANDRE LALLEMAND / Unsplash Брюссель продолжает жёсткую реализацию европейского Закона о цифровых рынках (Digital Markets Act — DMA), который содержит перечень практик, направленных на облегчение перехода пользователей между конкурирующими онлайн-сервисами, включая социальные сети, браузеры и магазины приложений. Первыми под его удар попали Apple и Meta✴, которые, согласно решению регулятора, не выполнили ряд требований DMA, внедрив меры, усиливающие зависимость бизнес-пользователей и рядовых потребителей от их платформ. По данным трёх источников, знакомых с ситуацией, Google и X могут стать следующими объектами регуляторного давления со стороны Еврокомиссии. Несмотря на озабоченность по поводу возможных ответных тарифов со стороны США, Брюссель сохраняет жёсткую позицию в вопросе соблюдения цифрового законодательства. При этом расследование в отношении Google касается дела 2021 года, в рамках которого компания подозревается в предоставлении преимуществ собственным рекламным сервисам. Если Еврокомиссия примет решение обязать Google продать часть своего рекламного бизнеса, это станет первым случаем в истории, когда антимонопольный орган ЕС применит столь радикальную меру. Источники в Комиссии подчёркивают, что подобное распоряжение ранее не выносилось даже в рамках затяжного антимонопольного дела против Microsoft. Возможное разделение бизнеса стало предметом активного обсуждения после недавнего решения американского суда, который признал, что Google незаконно доминирует в двух сегментах рекламных технологий в интернете — площадках размещения рекламы и рекламных биржах.

Источник изображения: Masood Aslami / Unsplash Это судебное решение может послужить правовой основой для действий антимонопольных ведомств США, включая Министерство юстиции (DOJ), которое рассматривает возможность принудительного разделения рекламного бизнеса Google. По мнению исследователя Центра регулирования в Европе (CERRE) Зака Майерса (Zach Meyers), это создаёт благоприятные условия для скоординированных действий со стороны ЕС. Если США продолжат оказывать давление на Google, это может обеспечить главе антимонопольного ведомства Еврокомиссии Тересе Рибере (Teresa Ribera) политическое прикрытие для вынесения аналогичных решений в Европе. Тем не менее остаётся вопрос: как повлияет международное давление на курс ЕС в сфере цифрового регулирования? Президент США Дональд Трамп (Donald Trump) уже подверг критике DMA, назвав его, по сути, скрытым тарифом против американских корпораций. Закон о цифровых рынках (DMA) был упомянут Трампом в его исполнительном указе, изданном в феврале. Рибера, в свою очередь, отвергла возможность уступок и заявила, что все компании, действующие на территории ЕС, обязаны соблюдать европейское законодательство и уважать европейские ценности. Политическая устойчивость и регуляторная самостоятельность Евросоюза проходят проверку в условиях растущего давления со стороны США. Результаты текущих дел против Google и X станут лакмусовой бумажкой эффективности реализации DMA. Решение о возможном разделении рекламного бизнеса Google станет не только юридическим прецедентом, но и показателем готовности Европы отстаивать собственные антимонопольные приоритеты на глобальной технологической арене. YouTube поменял дизайн видеоплеера впервые за 10 лет — пользователи негодуют

23.04.2025 [17:49],

Николай Хижняк

Сегодня исполнилось ровно 20 лет с момента загрузки первого видео на платформу YouTube. Актуальный дизайн пользовательского интерфейса веб-видеоплеера платформы не менялся целое десятилетие, и по случаю круглой даты Google решила его изменить. Как и ожидалось, не все пользователи оказались этим довольны.

Источник изображений: YouTube О появлении нового пользовательского интерфейса веб-видеоплеера на платформе YouTube сообщили некоторые пользователи форума Reddit. Судя по всему, обновление пока доступно не для всех. По словам одного из пользователей, новый интерфейс у плеера YouTube показался у некоторых видеороликов, которые он запускал со своей второй учётной записи. При этом на его основной учётной записи изменений пока никаких нет. Новый пользовательский интерфейс плеера YouTube выглядит таким образом. Как можно отметить, новый интерфейс содержит кнопки для каждого важного действия. Кнопка воспроизведения/паузы, а также следующие за ней кнопка «Далее», временная метка видео и главы видео получили свой собственный фон. Кнопка настройки громкости перемещена на другую сторону, и вместе с другими кнопками действий (автоматического воспроизведения, субтитров, настроек разрешения, и т.д.) выделена общим фоном. Некоторым пользователям понравился новый пользовательский интерфейс веб-версии плеера YouTube, другие же его раскритиковали. Некоторые оказались особенно недовольны новым ползунком звука, но на изображениях не показано, как он выглядит в раскрытом положении. Похоже, новый ползунок настройки звука не позволяет просто навести курсор мыши на кнопку и изменять уровень громкости колесом мыши или использовать клавиши вверх/вниз на клавиатуре. Google проиграла биткоину по рыночной капитализации

23.04.2025 [17:31],

Павел Котов

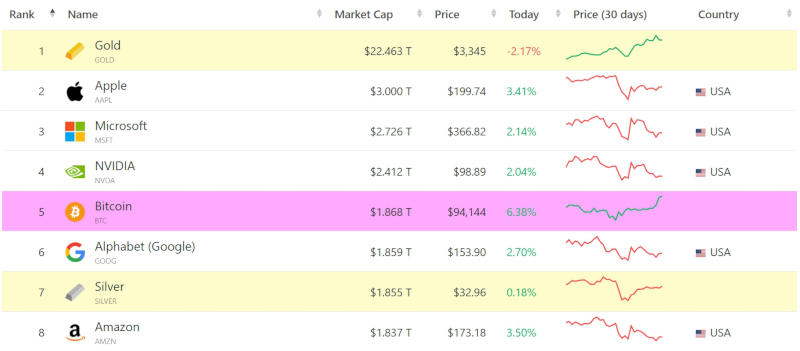

Котировка биткоина превысила $94 000, в результате чего крупнейшая в мире криптовалюта обошла холдинг Alphabet (владеет Google) по объёму рыночной капитализации. Другими крупнейшими в мире активами остаются золото, Apple, Microsoft и Nvidia.

Источник изображения: Erling Løken Andersen / unsplash.com Рыночная капитализация биткоина превысила аналогичный показатель Google после того, как котировка криптовалюты поднялась выше $94 000. По состоянию на 13:00 мск 23 апреля биткоин достиг капитализации $1,868 трлн, у Google это $1,859 трлн, гласит статистика Coinmarketcap. За последние сутки эти активы подорожали соответственно на 6,38% и 2,7%. В списке крупнейших по капитализации активов значатся также золото ($22,463 трлн), а также акции Apple ($3,000 трлн), Microsoft ($2,726) и Nvidia ($2,412 трлн). Накануне биткоин занимал седьмое место в списке, но за сутки преодолел две позиции, потеснив вместе с Alphabet ещё и серебро ($1,855 трлн).

Источник изображения: companiesmarketcap.com В настоящий момент инвесторы активно покупают биткоин и связанные с ним активы, из-за чего крупнейшая в мире криптовалюта дорожает — спрос на неё отмечается на криптобиржах Binance и Coinbase, которые подталкивают актив вверх и создают благоприятную ситуацию. Сейчас биткоин отыгрывает просадку, провоцированную торговыми пошлинами США: за минувшие сутки он подорожал более чем на 6 %, с начала недели — на 10 %. OpenAI готова купить браузер Chrome, если Google обяжут его продать

23.04.2025 [04:29],

Анжелла Марина

Представитель OpenAI заявил в суде, что компания заинтересована в покупке браузера Chrome, если Google обяжут его продать. Глава продукта ChatGPT Ник Тёрли (Nick Turley) сделал это заявление в рамках антимонопольного дела США против Google. Власти считают, что отделение Chrome поможет ослабить доминирование корпорации на рынке поисковых услуг.

Источник изображения: Copilot Судья Амит Мехта (Amit Mehta) ранее признал Google монополистом в сфере онлайн-поиска, и сейчас рассматриваются возможные меры по ограничению её влияния. Компания намерена обжаловать это решение, однако если суд постановит продать Chrome, OpenAI готова стать покупателем, сообщает The Verge со ссылкой на Reuters. Также выяснилось, что OpenAI ещё в прошлом году пыталась договориться с Google о партнёрстве, чтобы ChatGPT мог использовать её поисковые технологии. Сейчас нейросеть получает данные от поисковика Microsoft Bing, но, как отметил Тёрли, у компании «серьёзные проблемы с качеством», связанные с поставщиком поисковых услуг. «Мы уверены, что сотрудничество с Google помогло бы нам улучшить продукт», — говорилось в письме OpenAI, представленном в суде. Однако Google отказалась от партнёрства. Одновременно OpenAI продолжает развивать собственную поисковую систему, но изначальный план того, что ChatGPT сможет полагаться на свой поиск в большинстве запросов (около 80 %) к 2025 году оказался слишком оптимистичным. Достичь этой цели, предположительно, удастся только через несколько лет. Эксперты считают, что интерес OpenAI к Chrome связан не только с поиском, но и с долгосрочной стратегией, а владение браузером дало бы компании прямой доступ к пользователям и данным, усилив её позиции в конкуренции с Google и Microsoft. Пока же судья должен решить, состоится ли принудительное разделение Google и станет ли Chrome самостоятельным активом. Если Chrome действительно выставят на продажу, OpenAI окажется среди главных претендентов, но не исключено, что за него развернётся борьба и между другими крупными игроками рынка. Google бросила попытки искоренить сторонние cookies — они останутся в браузере Chrome

23.04.2025 [00:59],

Анжелла Марина

Компания Google объявила, что не будет отключать поддержку сторонних cookies в браузере Chrome, несмотря на многолетние попытки заменить их через проект Privacy Sandbox. По словам вице-президента инициативы Privacy Sandbox Энтони Чавеса (Anthony Chavez), компания отказалась от планов внедрения функции, которая предлагала бы пользователям добровольно отключать cookies. Вместо этого технология останется в Chrome в текущем виде — возможно, навсегда.

Источник изображения: AI Начиная с 2019 года, Google вела работу над системой Privacy Sandbox, которая представляла собой новый способ таргетирования рекламы, улучшающий конфиденциальность пользователей. Этот подход предполагал отказ от сторонних файлов cookie — небольших фрагментов кода, которые рекламодатели используют для отслеживания действий пользователей в интернете. Ещё совсем недавно Google планировала добавить в Chrome диалоговое окно, предлагающее пользователям отключить сторонние cookies и использовать в целях большей приватности новую технологию. Однако, как заявил Чавес, компания «воодушевлена тем, что рекламная индустрия стала серьёзнее относиться к приватности», поэтому принудительный отказ от cookies не потребуется. Пользователи по-прежнему смогут отключать их вручную в настройках браузера, если захотят, сообщает Ars Technica. Хотя Privacy Sandbox не достигла первоначальных целей, Google не закрывает проект полностью. Команда продолжит дорабатывать режим «Инкогнито» в Chrome, в котором уже блокируются сторонние cookies, а позже в этом году появится защита IP-адресов для борьбы с межсайтовым отслеживанием. Чавес признаёт, что теперь API Privacy Sandbox будет играть несколько иную роль и разработка этого инструмента продолжится. Интересно, что эксперты связывают решение Google с антимонопольными исками. Так, с момента запуска Privacy Sandbox компания проиграла три судебных дела, два из которых касаются доминирования в поиске и рекламных технологиях. Власти считают, что Chrome также даёт Google слишком большое влияние и принудительный отказ от cookies мог бы усилить подозрения в монополизации рынка. В целом, с одной стороны, сохранение cookies — это в некотором роде шаг назад, поскольку эта технология уже считается устаревшей и небезопасной (Privacy Sandbox, по крайней мере на бумаге, предлагала большую приватность). С другой стороны, массовый переход на новые технологии усилил бы контроль Google над цифровой рекламой, а реальные преимущества для пользователей ещё предстояло бы оценить. Тем не менее, компания по-прежнему надеется, что новая технология со временем получит большее распространение. В ближайшие месяцы Google продолжит переговоры с отраслевыми партнёрами, чтобы найти компромисс между приватностью и прибыльностью. Gmail упростил отписку от надоедливых рассылок, собрав их все в одном месте

22.04.2025 [19:29],

Сергей Сурабекянц

Ранее Google уже улучшила поиск в Gmail, добавила ИИ и сквозное шифрование, а также внесла несколько заметных изменений в для борьбы с наплывом подписок на всевозможные рассылки, включая кнопку «Отписаться». Теперь в Gmail появилась новая сводная страница «Управление подписками», которая позволяет пользователям контролировать все подписки на рассылки и отказываться от них одним нажатием. Правда, пока она работает только на устройствах под управлением Android.

Источник изображения: Google В обновлении на стороне сервера Gmail начинает развёртывать новую страницу «Управление подписками». В приложении отображается уведомление, информирующее пользователей о новой опции, с кнопкой «Управление подписками» в дополнительном меню. Новая страница содержит адреса электронной почты и названия всех подписок на рассылку. Она показывает, сколько писем было отправлено «недавно» в рамках каждой подписки. Рядом расположенная кнопка позволяет быстро отписаться от рассылок этого отправителя. В большинстве случаев одного нажатия на эту кнопку достаточно, хотя иногда всё же открывается дополнительное всплывающее окно для подтверждения. Google отметила, что на прекращение отправки писем авторам рассылки может понадобиться несколько дней. Пока страница «Управление подписками» недоступна в веб-версии Gmail и в приложении для iOS, но скорее всего её появление — вопрос недалёкого будущего. Учитывая нешуточные проблемы, создаваемые массированными почтовыми рассылками, появление в Gmail быстрого способа контролировать и отказываться от них является приятным событием. Google призналась, что платит Samsung «огромные деньги» за предустановку Gemini на Galaxy

22.04.2025 [17:57],

Сергей Сурабекянц

Недавно суд признал Google виновной в нарушении антимонопольного законодательства — компания платила производителям смартфонов за предустановку своей поисковой системы. Сегодня выяснилось, что Google аналогичным образом стала финансировать предустановку ИИ Gemini на устройства Samsung Galaxy. Этот факт признал вице-президент Google по платформам и партнёрским устройствам Питер Фицджеральд (Peter Fitzgerald) во время другого судебного разбирательства.

Источник изображения: androidauthority.com На проходящих трёхнедельных слушаниях Министерство юстиции США в рамках антимонопольного дела против Google потребовало разделить компанию с рыночной капитализацией $1,81 трлн. Этот процесс может кардинально изменить облик технологического гиганта и существенно повлиять на расстановку сил в Кремниевой долине. На судебном процессе Фицджеральд сообщил, что ежемесячные платежи за предустановку Gemini на устройства Samsung Galaxy начались в январе, а контракт рассчитан как минимум на два года. Общая сумма не разглашается, но представитель Министерства юстиции заявил, что Google платит Samsung «огромные деньги». Кроме того, по словам Фицджеральда, контракт предусматривает получение Samsung процента от дохода от рекламы, отображаемой в Gemini. Эти показания могут доставить серьёзные юридические неприятности Google в дополнение к уже имеющимся. На днях Министерство юстиции США выиграло судебный процесс против компании, обвинив Google в монопольном положении в сфере рекламных технологий. Суд постановил, что Google «умышленно участвовала в серии антиконкурентных действий», а антиконкурентная практика технологического гиганта нанесла «существенный вред» клиентам и пользователям. Теперь суд приобщит к текущему судебному иску показания Фицджеральда, чтобы принять окончательное решение об изменениях, которые Google придётся внести в свой бизнес в случае юридического поражения. Google против разделения: это ударит по потребителям и навредит США в «глобальной гонке с Китаем»

22.04.2025 [11:52],

Владимир Фетисов

На этой неделе началось рассмотрение антимонопольного дела Министерства юстиции США против Google, которая обвиняется в создании монополии на рынке интернет-поиска. Это самое значительное разбирательство в технологической отрасли за долгие годы, поскольку в результате него суд может обязать IT-гиганта продать браузер Chrome, в результате чего существенно изменится расстановка сил в Кремниевой долине.

Источник изображения: Sasun Bughdaryan / Unsplash Минюст призвал Google продать свой интернет-обозреватель и открыть поисковые данные для конкурентов во время вступительного слова на судебном заседании в начале недели. Google быстро ответила на это заявление в своём блоге, заявив, что такой шаг не соответствует интересам США, особенно на фоне стремительно обостряющейся борьбы за первенство в сфере искусственного интеллекта. В сообщении Google упоминается китайская компания DeepSeek как один из главных конкурентов в сфере ИИ. Вице-президент Google по вопросам регулирования Ли-Энн Малхолланд (Lee-Anne Mulholland) заявила, что предложение Минюста «затруднит разработку искусственного интеллекта», а назначенный правительством комитет будет регулировать проектирование и разработку продуктов компании. «Это также затормозит американские инновации в критический момент. Мы находимся в жесткой конкурентной борьбе с Китаем за технологическое лидерство следующего поколения, и Google стоит в авангарде американских компаний, совершающих научные и технологические прорывы», — добавила она. Google является одной из многих технологических компаний, пытающихся противостоять антимонопольной деятельности со стороны администрации президента Дональда Трампа (Donald Trump), которая во многом была начата ещё при правительстве предыдущего президента. Ранее в этом месяце Google проиграла другое судебное разбирательство, в рамках которого суд признал компанию монополистом в некоторых сегментах рынка онлайн-рекламы. Другие IT-компании, такие как Apple, Meta✴ Platforms и Amazon, также обвиняются в получении и удержании монопольного положения в разных сферах. Так Федеральная торговая комиссия обвинила Meta✴ в монополизации рынка социальных сетей, а также усомнилась в законности покупок компанией сервисов Instagram✴ и WhatsApp. В дополнение к этому Федеральная торговая комиссия недавно подала в суд на Uber, обвинив компанию в обмане клиентов при выставлении счетов и аннулировании подписки. Что касается Google, то компания была признана монополистом в сфере онлайн-поиска в августе прошлого года. Теперь же суд заслушивает предложения сторон относительно мер, которые могли бы изменить ситуацию в этом сегменте. Слушания продлятся в течение трёх недель, а окончательно решение судья огласит в конце лета. После этого, в случае проигрыша, Google сможет подать апелляцию. В суде Google планирует доказать, что Chrome помогает людям получить доступ в интернет, а исходный код приложения используют другие разработчики. В Google уверены, что предложение Минюста открыть поисковые данные для других компаний «не только создаст риски для кибербезопасности и даже национальной безопасности, но и увеличит стоимость услуг для потребителей». Главная задача Google в том, чтобы найти баланс между тем, чтобы компанию считали важной для американских инноваций, но не настолько важной, чтобы другие компании не могли конкурировать с ней. Начался суд по принудительному разделению Google — это определит будущее интернета

21.04.2025 [21:53],

Владимир Фетисов

Министерство юстиции США в ходе судебного разбирательства в рамках антимонопольного дела против Google заявило, что лучшим способом решить вопрос монополии в сфере интернет-поиска станет разделение компании стоимостью $1,81 трлн. С этого начались трёхнедельные слушания, которые в конечном итоге могут кардинально изменить облик технологического гиганта и существенно повлиять на расстановку сил в Кремниевой долине.

Источник изображения: Tingey Injury / unsplash.com Судья Окружного суда США по округу Колумбия Амит П. Мехта (Amit P. Mehta) в августе прошлого года постановил, что Google нарушила антимонопольное законодательство, чтобы сохранить своё доминирующее положение в сфере онлайн-поиска. Теперь же он будет заслушивать аргументы представителей Минюста и Google касательно того, как, по их мнению, следует поступить, чтобы исправить ситуацию. Ожидается, что к концу лета он выдаст постановление о принятии определённых мер, называемых «средствами правовой защиты». Во вступительном слове представитель Минюста заявил, что Мехта должен обязать Google продать свой браузер Chrome, который является одним из инструментов, помогающих привести пользователей к поисковику компании. Правительственные юристы также заявили, что компания должна предпринять определённые шаги, чтобы дать конкурентам преимущества, если суд действительно хочет восстановить конкуренцию на рынке онлайн-поиска. «Ваша честь, мы здесь не для того, чтобы одержать пиррову победу. Это время для суда, чтобы сказать Google и всем другим монополистам, которые слушают, а они слушают, что нарушение антимонопольного законодательства чревато последствиями», — заявил во время выступления юрист Минюста Дэвид Дальквист (David Dahlquist). Исход этого дела может кардинально изменить положение дел в Кремниевой долине. Google продолжает сталкиваться с новыми проблемами, включая возможный развал бизнеса онлайн-рекламы. Это связано с тем, что на прошлой неделе другой федеральный судья постановил, что компания является монополистом в рекламном бизнесе. Кроме того, в 2023 году Google проиграла дело против разработчика игры Fortnite, Epic Games Store, который обвинял технологического гиганта в нарушении антимонопольного законодательства, диктуя невыгодные условия для разработчиков в своём магазине приложений «Play Маркет». Юридические проблемы могут навредить стремлению Google конкурировать с OpenAI, Microsoft и Meta✴ Platforms в сфере искусственного интеллекта. Компания всё активнее интегрирует ИИ-технологии в свой поисковик, но Минюст в ходе текущего разбирательства уже попросил судью убедиться в том, что Google не сможет использовать своё монопольное положение в сфере интернет-поиска для достижения доминирования в сфере ИИ. Действия Минюста США свидетельствуют о том, что администрация президента Дональда Трампа (Donald Trump) намерена продолжить контролировать технологическую отрасль. Apple, Meta✴ и Amazon также сталкиваются с антимонопольными исками со стороны правительства, причём Meta✴ находится на второй неделе судебного разбирательства, в рамках которого будет установлено, не являлась ли покупка Instagram✴ и WhatsApp подавлением конкуренции. Дело о монополии Google в сегменте онлайн-поиска было возбуждено в 2020 году, во время первого президентского срока Трампа. В 2023 году судья Мехта возглавлял восьминедельный процесс, в ходе которого правительство пыталось доказать, что Google совершала подрывающие конкуренцию действия. В конечном счёте судья встал на сторону правительства, что положило начало новому процессу, который определит, как будут решаться связанные с конкуренцией в сегменте онлайн-поиска проблемы. Google предлагает ограничиться незначительными изменениями, в том числе пересмотром сделок, в рамках которых компания платит производителям смартфонов и других гаджетов за то, чтобы поисковая система Google на их устройствах использовалась по умолчанию. Минюст требует ввести более жёсткие меры, включая запрет на заключение сделок с производителями устройств и разработчиками браузеров, делающих Google поисковиком по умолчанию. Правительство также просит судью оставить за собой возможность обязать Google в будущем продать мобильную операционную систему Android, если ситуация с конкуренцией не стабилизируется. Гендир Google DeepMind рассказал о будущем ИИ и появлении у него самосознания

21.04.2025 [19:27],

Сергей Сурабекянц

Генеральный директор Google DeepMind Демис Хассабис (Demis Hassabis) в течение часа рассказывал журналистам о перспективах Gemini, темпах разработки сильного ИИ (Artificial General Intelligence, AGI) и общем росте самосознания нейросетей. Он уделил много внимания модели Project Astra, которая сейчас находится в стадии предварительного тестирования. Astra узнаёт пользователей и помнит историю общения с ними, — скоро эти возможности появятся в Gemini Live.

Источник изображения: 9to5Google Хассабис отметил, что перспективная модель Project Astra отличается, прежде всего, увеличенным количеством памяти. В частности, она запоминает ключевые детали из предыдущих разговоров для лучшего контекста и персонализации. Также имеется отдельная «10-минутная память» текущего диалога. Эти возможности, предположительно, скоро появятся в Gemini Live. Хассабис подчеркнул, что Google DeepMind «обучает свою модель ИИ под названием Gemini не просто показывать мир, но и совершать действия в нём, такие как бронирование билетов и покупки онлайн». По мнению Хассабиса, реальный срок появления AGI — 5-10 лет, причём это будет «система, которая действительно понимает все вокруг вас очень тонким и глубоким образом и как бы встроена в вашу повседневную жизнь». На вопрос, «работает ли Google DeepMind сегодня над системой, которая будет осознавать себя», Хассабис заявил, что теоретически это возможно, но он не воспринимает какую-либо из сегодняшних систем как осознающую себя. Он полагает, что «каждый должен принимать собственные решения, взаимодействуя с этими чат-ботами». На вопрос, «является ли самосознание вашей целью» (при разработке ИИ), он ответил, что это может произойти неявно: «Эти системы могут обрести некоторое чувство самосознания. Это возможно. Я думаю, что для этих систем важно понимать вас, себя и других. И это, вероятно, начало чего-то вроде самосознания». «Я думаю, есть две причины, по которым мы считаем друг друга сознательными. Одна из них заключается в том, что вы демонстрируете поведение сознательного существа, очень похожее на моё поведение. Но вторая причина в том, что вы работаете на одном и том же субстрате. Мы сделаны из одного и того же углеродного вещества с нашими мягкими мозгами. Очевидно, что машины работают на кремнии. Так что даже если они демонстрируют одинаковое поведение, и даже если они говорят одно и то же, это не обязательно означает, что это ощущение сознания, которое есть у нас, будет тем же самым, что будет у них», — пояснил Хассабис в заключение. Google обжалует «неблагоприятное» решение суда о признании её монополистом в интернет-рекламе

18.04.2025 [18:12],

Павел Котов

Google намеревается обжаловать «неблагоприятную» для себя часть решения суда по делу, инициированному минюстом США в отношении технологического гиганта, сообщает Reuters. Накануне окружной судья США Леони Бринкема (Leonie Brinkema) признала Google виновной в «умышленном приобретении и удержании монопольной власти» на рынке интернет-рекламы.

Источник изображения: Tingey Injury / unsplash.com Google признана монополистом на рынках серверов издательской рекламы и рекламных бирж. Серверы издательской рекламы — используемые сайтами платформы для хранения рекламных инструментов и управления ими. Эта технология наряду с рекламными биржами позволяет новостным ресурсам и другим поставщикам онлайн-контента зарабатывать на продаже рекламы. Судья также постановила, что Google незаконным образом доминирует на двух рынках технологий онлайн-рекламы. Суд, по версии Google, вынес неоднозначное решение. В частности, он установил, что минюст не смог доказать антиконкурентный характер инструментов Google и механизмов поглощения DoubleClick и AdMeld — при этом инструменты Google для издателей нарушают антимонопольное законодательство и не пускают конкурентов на рынок. Компания, по мнению минюста, должна продать как минимум платформу Google Ad Manager, которая включает в себя как сервер издательской рекламы, так и рекламную биржу. В Android вернётся переключатель «Не беспокоить» для тех, кому не понравились «Режимы»

18.04.2025 [13:49],

Павел Котов

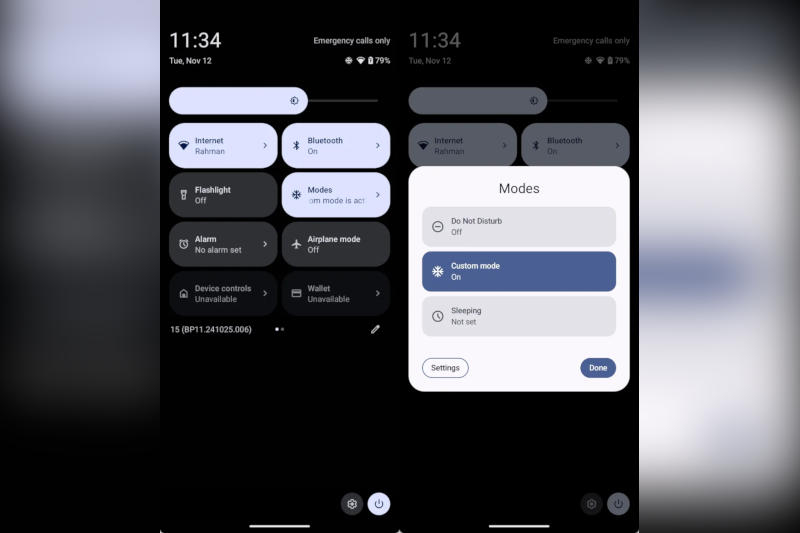

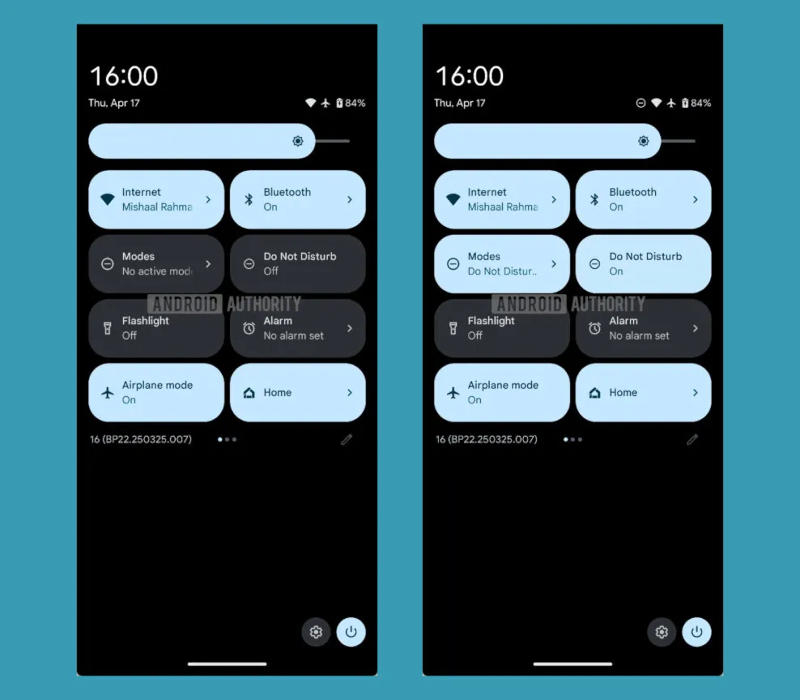

Людям свойственно противиться изменениям, если они привыкли к чему-то удобному. Ярким примером стала инициатива Google убрать из быстрых настроек Android опцию «Не беспокоить» и заменить её более гибкими «Режимами». Есть люди, которые включают функцию «Не беспокоить» по нескольку раз в день, и они предсказуемо оказались недовольными, что теперь для этого стали требоваться два действия вместо одного. Поэтому в Google решили вернуть всё как было.

Источник изображений: androidauthority.com Инцидент коснулся небольшой доли пользователей Android — затронул только владельцев устройств Google Pixel. Сомнительное нововведение появилось с обновлением Android 15 QPR2. Вместо простого и быстрого варианта «Не беспокоить» настройка «Режимы» позволяет персонализировать схему вывода уведомлений, учитывая множество параметров. Из-за этого пользователи лишились возможности включать режим «Не беспокоить» в шторке с быстрыми настройками — выбор опции «Режимы» вызывает всплывающее окно, где есть вариант «Не беспокоить» наряду с несколькими другими. То есть приходится совершать два действия вместо одного, что было воспринято с недовольством.  В четвёртой бета-версии Android 16, к счастью, все вернулось на исходные позиции, сообщил ресурс Android Authority: в меню быстрых настроек обнаружился значок «Не беспокоить», каким он был всегда. При этом «Режимы» никуда не делись — эта опция теперь располагается рядом, давая пользователю выбор: действовать по старой или новой схеме. Гарантии того, что в общедоступном издании Android 16 эта функция из бета-версии появится сразу, нет, и от Google никаких заявлений пока не было. Но хотелось бы надеяться, что компания прислушалась к мнению общественности, и опция «Не беспокоить» вернётся хотя бы в одном из последующих обновлений Android 16. Пока же Android Authority предлагает владельцам смартфонов Google Pixel воспользоваться приложением с открытым исходным кодом, которое решает внезапно возникшую проблему. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |