|

Опрос

|

реклама

Быстрый переход

OpenAI Deep Research показал рекордный результат в сложнейшем «Последнем экзамене человечества»

05.02.2025 [18:07],

Павел Котов

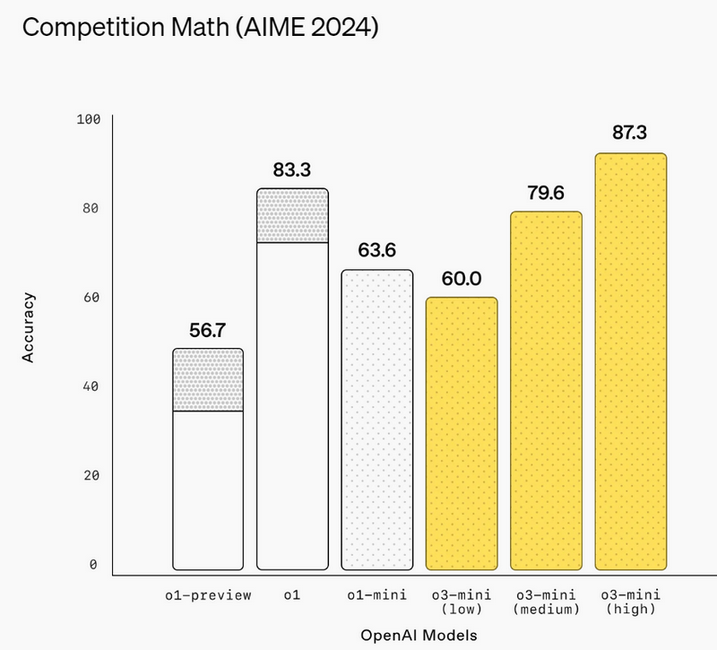

Менее двух недель назад эксперты в области искусственного интеллекта представили крайне сложный тест Humanity's Last Exam, предназначенный для оценки передовых нейросетей. Список лидеров в этом испытании возглавили два проекта OpenAI: o3-mini и Deep Research.

Источник изображения: scale.com Бенчмарк, созданный экспертами со всего мира, содержит крайне сложные вопросы и задания на знания и рассуждения — даже некоторые люди не могут понять отдельные вопросы в нём, не говоря уже о том, чтобы дать на них ответ. Вскоре после своего выхода список лидеров на экзамене возглавила рассуждающая модель ИИ DeepSeek R1, давшая 9,4 % правильных ответов. Обогнать её смогли модели OpenAI o3-mini с результатом 10,5 % и o3-mini-high, набравшая 13 % — последняя действительно мощнее, но и работает она медленнее. Но более впечатляющим стал результат, который показал ИИ-агент OpenAI Deep Research — он набрал 26,6 %, с ходу побив тем самым предыдущий менее чем за 10 дней. Сравнение не вполне корректное, потому что Deep Research имеет возможность производить поиск информации, а у традиционных моделей ИИ она отсутствует. И в случае Humanity's Last Exam эта возможность имеет критическое значение, ведь некоторые из вопросов нацелены на проверку знаний. Тем не менее, системы ИИ постоянно улучшают свои результаты, и это заставляет задуматься, когда одна из них сдаст экзамен с высшим баллом. OpenAI Deep Research — чрезвычайно мощный инструмент, предназначенный для работы в качестве персонального аналитика. Он проводит исследования, составляет отчёты и готовит ответы, на которые у человека ушли бы несколько часов. OpenAI полностью поменяла фирменный стиль — он стал «человечнее», но изменения заметить непросто

05.02.2025 [13:07],

Павел Котов

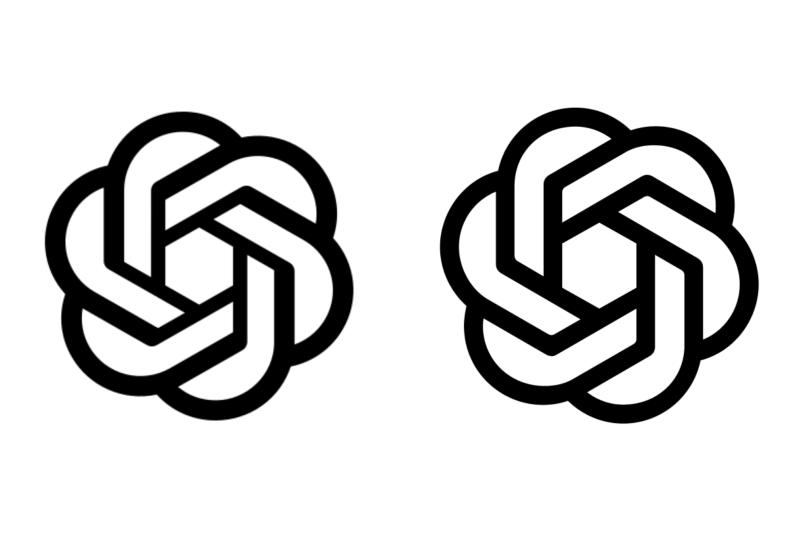

OpenAI провела полный ребрендинг. Фирменный стиль компании теперь включает новый шрифт, обновлённый вариант логотипа и обновлённую цветовую палитру. Чтобы заметить разницу между старым и новым логотипом, придётся присмотреться: у «цветка» немного увеличилось пространство в центре, а линии стали более чёткими.

Старый (слева) и обновлённый (справа) логотипы. Источник изображений: OpenAI Оригинальный логотип был разработан генеральным директором OpenAI Сэмом Альтманом (Sam Altman) и соучредителем компании Ильёй Суцкевером (Ilya Sutskever). Теперь его слегка переработали штатные дизайнеры OpenAI Вейт Мёллер (Veit Moeller) и Шеннон Ягер (Shannon Jager), стремясь сделать изображение «более органичным и человечным».  Важной частью ребрендинга стал новый шрифт OpenAI Sans, который, по версии компании, «сочетает геометрическую точность и функциональность с округлыми, доступными символами». Буква «O» в фирменном начертании названия компании имеет идеально круглую внешнюю линию и намеренно неидеальную внутреннюю, чтобы «противопоставить [фирменный стиль] точности роботов и сделать его более человеческим». При разработке различных начертаний шрифта компания использовала технологии искусственного интеллекта, признался Мёллер. «Мы сотрудничаем с ведущими экспертами в области фотографии, типографики, анимации и пространственного дизайна, развёртывая такие инструменты ИИ, как DALL·E, ChatGPT и Sora, в качестве генераторов идей. Этот двойной подход, при котором человеческая интуиция сочетается с генеративными возможностями ИИ, помог нам создать бренд не просто инновационный, но и глубоко человеческий», — рассказали в OpenAI. Hugging Face выпустила открытый аналог OpenAI Deep Research для анализа информации по сотням сайтов

05.02.2025 [06:59],

Анжелла Марина

Команда разработчиков Hugging Face объявила о создании открытой версии инструмента Deep Research, представленного компанией OpenAI. Этот инструмент, получивший похожее название Open Deep Research, является альтернативой разработке OpenAI, которая пока доступна лишь ограниченному кругу пользователей по платной подписке.

Источник изображения: Hugging Face OpenAI Deep Research, представленный буквально на днях, позволяет собирать исследовательские отчёты по любой теме, анализируя данные в интернете. Однако его использование доступно только подписчикам ChatGPT Pro за $200 в месяц. В ответ на это команда Hugging Face разработала своего ИИ-агента под названием Open Deep Research, который использует модель OpenAI o1 и открытую фреймворк-систему, помогающую ИИ планировать анализ данных и взаимодействовать с поисковыми системами. Как сообщает TechCrunch, ссылаясь на слова разработчиков, модель превосходит по результатам «рассуждающие» аналоги, в частности DeepSeek R1. Новый инструмент способен автономно перемещаться по сети, используя простой текстовой браузер (отображает только текст веб-страницы, игнорируя графический контент) и набор инструментов для анализа текста. Исследователи утверждают, что Open Deep Research может прокручивать страницы, манипулировать файлами и даже выполнять вычисления с данными. В тестах бенчмарка GAIA, оценивающем ИИ-ассистентов общего назначения, проект получил 54 %, что немного уступает результату оригинального Deep Research от OpenAI — 67,36%. В попытке протестировать Open Deep Research журналист TechCrunch столкнулся с техническими проблемами из-за высокой нагрузки на сервер. Однако разработчики заверили, что продолжают работать над улучшением производительности модели и уже выложили исходный код на GitHub, чтобы получать обратную связь от сообщества. Интересно, что несмотря на появление множества попыток воспроизвести OpenAI Deep Research, ни одна из открытых моделей пока не может сравниться с оригиналом, так как не использует модель o3. Эта ИИ-модель остаётся лидером в задачах, связанных с ответами на сложные вопросы и сбором информации, а её API интерфейс, в отличие от модели OpenAI o3-mini, недоступен. По мнению экспертов, пока подобная модель не появится в открытом доступе, альтернативы вроде Open Deep Research вряд ли смогут полностью конкурировать с оригинальной разработкой. OpenAI выпустит ИИ-гаджет, который кардинально изменит взаимодействие человека с компьютером

04.02.2025 [05:19],

Анжелла Марина

Сэм Альтман (Sam Altman) и легендарный дизайнер Джони Айв (Jony Ive) приступили к разработке ИИ-устройства, которое может полностью изменить способ взаимодействия пользователей с технологиями. В отличие от привычных смартфонов, новое устройство предполагает минимум текстового ввода и больше ориентировано на голосовое управление.

Источник изображения: OpenAI Как сообщает Android Authority, разработка, которая направлена на радикальную трансформацию того, как люди общаются с компьютерами, будет осуществляться совместно с несколькими компаниями, имена которых пока не названы. По словам Альтмана, искусственный интеллект (ИИ) потребует «фундаментального изменения в способах взаимодействия с компьютерами», и что в будущем «голос станет средством пользовательского интерфейса». Новое устройство будет ориентировано на голосовые команды и обещает стать более интуитивным и удобным инструментом для повседневного использования. Стоит сказать, что подобные идеи уже реализовывались ранее в других проектах. Например, Humane AI Pin и Rabbit R1 предлагали голосовое управление вместе с дополнительными функциями, такими как проектор или компактный экран. Однако эти устройства не получили широкого распространения. Несмотря на существование множества ИИ-гаджетов разных форматов — от беспроводных наушников до украшений, таких как подвески и ожерелья, — новое устройство OpenAI может получить совершенно уникальную конфигурацию. По мнению экспертов, это сделает его отличным от всего, что есть сейчас на рынке. Кроме того, Альтман сообщил, что компания разрабатывает собственные микрочипы, которые позволят оптимизировать производительность и автономность этого гаджета. Что касается сроков, то отмечается, что даже на разработку прототипа потребуется несколько лет, поэтому о коммерческом выпуске говорить ещё не приходится. Интересно, что сотрудничество между Альтманом и Айвом началось ещё раньше. В прошлом году в интервью для The New York Times Джони Айв лично подтвердил свою причастность к разработке нового ИИ-устройства, отметив, что оно не будет похоже на телефон. Эти подробности лишь усиливают интерес к проекту, хотя конкретные детали о дизайне и функциях пока не раскрываются. Тем временем умные очки становятся всё более популярными. Так, на недавней выставке CES 2025 были представлены новые модели, поддерживающие технологии ChatGPT. Самым успешным продуктом в этой категории остаётся линейка Ray-Ban компании Meta✴, которая использует собственные ИИ-модели и уже продала более миллиона пар очков. OpenAI пока не будет подавать в суд на DeepSeek

04.02.2025 [04:31],

Николай Хижняк

OpenAI не планирует подавать в суд на китайскую компанию DeepSeek на фоне ранее озвученных подозрений Microsoft и OpenAI в отношении последней в том, что она могла использовать их данные для обучения своей нейросети R1. Об этом заявил сам глава OpenAI Сэм Альтман (Sam Altman).

Источник изображения: Solen Feyissa / unsplash.com «У нас нет планов прямо сейчас судиться с DeepSeek. Мы собираемся продолжать делать отличные продукты и лидировать в мире по мощности модели, я думаю, это хорошо работает», — передаёт слова Альтмана издание Nikkei. Ранее DeepSeek выпустила собственную модель искусственного интеллекта R1, создание которой, согласно её разработчикам, обошлась значительно дешевле по сравнению с западными аналогами. При этом она не проигрывает им по характеристикам. На прошлой неделе сообщалось, что Microsoft и OpenAI заподозрили DeepSeek в краже данных при разработке R1. Позже Альтман назвал R1 «впечатляющей моделью» и заявил, что «появление нового соперника нас реально вдохновляет». Затем SemiAnalysis выразили предположение, что DeepSeek могла потратить куда больше средств на создание R1, чем было заявлено изначально. Нынешнее заявление Альтман сделал во время поездки в Японию, где встречался премьер-министром страны Сигэру Исибой (Shigeru Ishiba) и главой японского холдинга SoftBank Масаёси Соном (Masayoshi Son). OpenAI и SoftBank объявили о создании совместного предприятия в Японии SB OpenAI Japan, которое будет развивать ИИ-сервисы. Ожидается, что это будет самый масштабный проект по предоставлению ИИ-инструментов американского стартапа корпоративным клиентам за пределами США. SoftBank объединился с OpenAI для запуска ИИ-сервисов в Японии

03.02.2025 [12:40],

Владимир Мироненко

Гендиректор японской холдинговой компании SoftBank Group Масаёси Сон (Masayoshi Son) и глава ИИ-стартапа OpenAI Сэм Альтман (Sam Altman) объявили о создании в Японии совместного предприятия SB OpenAI Japan для предоставления услуг искусственного интеллекта корпоративным клиентам, сообщил Bloomberg. Компании будут владеть совместным предприятием в равных долях (50:50).

Источник изображения: Growtika/unsplash.com Управлять совместным предприятием будет SoftBank Corp., телекоммуникационное подразделение японского холдинга, в штат которого войдёт 1000 человек из SoftBank. Они будут заниматься продвижением ИИ-решений OpenAI в различных отраслях экономики Японии, от производства автомобилей до розничной торговли. Ожидается, что это будет самый масштабный проект по предоставлению ИИ-инструментов американского стартапа корпоративным клиентам за пределами США. Входящие в холдинг компании, а также получающие от него инвестиции, такие как PayPay и LY Corp., будут ежегодно выплачивать OpenAI $3 млрд за использование её ИИ-технологий. SoftBank присоединится к растущему списку технологических гигантов, включая Meta✴ Platforms и Microsoft, которые выделяют миллиарды долларов на разработку ИИ-технологий. Холдинг планирует направить в ИИ-проект Stargate $15 млрд, а также ведёт переговоры с OpenAI об инвестициях в стартап в пределах $15–25 млрд. Поддержка Соном OpenAI отражает возрождение SoftBank в качестве инвестиционной компании после периода сокращения, вызванного падением стоимости технологического портфеля холдинга и серией неудач с инвестиционными проектами, пишет Bloomberg. ChatGPT научился проводить «глубокие исследования», анализируя сотни источников в интернете

03.02.2025 [11:41],

Владимир Фетисов

Компания OpenAI анонсировала новую функцию для своего ИИ-бота ChatGPT, которая позволит алгоритму проводить «глубокие исследования» на основании пользовательского запроса. Речь идёт об инструменте Deep research, основой для которого стала ещё не выпущенная в массы большая языковая модель OpenAI o3.

Источник изображений: OpenAI В описании новой функции сказано, что она может работать автономно, «планируя и выполняя многоступенчатую траекторию поиска нужных данных, возвращаясь назад и реагируя на появление новой информации в режиме онлайн, где это требуется». Проще говоря, функция Deep research не просто ищет ответ на заданный пользователем вопрос, а анализирует и обобщает данные из различных источников, формируя таким образом подробный доклад на заданную тему. В процессе работы Deep research в правой части экрана отображается краткое описание процесса, а также цитаты и другая справочная информация. Пользователи могут задействовать новую функцию, задав текстовый запрос, а также загрузив изображение или дополнительные файлы, например, документы в формате PDF или электронные таблицы. За счёт этого алгоритм получит больше контекста, после чего ему потребуется от 5 до 30 минут, чтобы подготовить подробный отчёт по итогам проделанной работы. В дальнейшем чат-бот сможет добавлять к своим ответам изображения и диаграммы. OpenAI отмечает, что функция Deep research может галлюцинировать, т.е. выдумывать несуществующие факты. Кроме того, алгоритм с трудом отличает информацию из авторитетных источников от слухов и заведомо ложных данных. Несмотря на это, OpenAI уверена в перспективности своей разработки, отмечая, что Deep research может функционировать на уровне аналитика. Что касается доступности новой функции, то пользователи, которые оплачивают подписку за $200 в месяц, смогут выполнять до 100 запросов в месяц к инструменту глубокого исследования ChatGPT. Тем же, кто платит $20 в месяц, компания гарантирует «ограниченный доступ». Сэм Альтман: OpenAI перешла на «неправильную сторону истории» в отношении открытых проектов

01.02.2025 [11:40],

Павел Котов

Выпустив накануне несколько новых продуктов, инженеры и руководство OpenAI, в том числе гендиректор Сэм Альтман (Sam Altman), ответили на несколько вопросов на платформе Reddit. Глава компании заявил, что она готова пересмотреть отношение к проектам с открытым исходным кодом.

Источник изображения: Dima Solomin / unsplash.com Появление китайской DeepSeek пошатнуло положение OpenAI как мирового лидера в области искусственного интеллекта — дошло до подозрений в краже интеллектуальной собственности. Разработчик ChatGPT стремится укрепить свои отношения с Вашингтоном и реализовать проект Stargate, который может заложить основу для одного из крупнейших раундов финансирования в истории. Альтман признал, что DeepSeek ослабила лидерство OpenAI в области ИИ и высказался по поводу проектов с открытым исходным кодом — в этом отношении компания, по мнению её главы, оказалась на «неправильной стороне истории». Ранее OpenAI выпускала открытые модели ИИ, но впоследствии отказалась от этого. «[Лично я считаю,] нам нужно выработать другую стратегию в отношении открытого исходного кода. Эту точку зрения в OpenAI разделяют не все, и сейчас это нашим приоритетом не является. [В будущем] мы станем выпускать лучшие модели, но наше лидерство станет меньшим, чем в предыдущие годы», — заявил Альтман. OpenAI подумывает открыть код уже неактуальных моделей, добавил директор по продуктам компании Кевин Вейл (Kevin Weil). Опыт DeepSeek подтолкнул OpenAI сделать механизмы работы актуальных продуктов более прозрачными: DeepSeek R1 показывает всю цепочку рассуждений, а o3-mini этих данных не выводит. «Мы работаем над тем, чтобы показывать гораздо больше, чем сегодня — [демонстрация рассуждений модели] появится очень-очень скоро. Пока не всех — показ всей цепочки приведёт к дистилляции конкурентами, но мы знаем, что люди (по меньшей мере, опытные пользователи) этого хотят, так что найдём подходящий способ это сбалансировать», — пообещал Вейл.

Источник изображения: Growtika / unsplash.com Альтман и Вейл попытались развеять слухи, что работа с ChatGPT, платформой, на которой компания запускает многие свои модели, скоро подорожает — напротив, OpenAI хотела бы сделать сервис ещё дешевле, если представится такая возможность. Ранее Альтман рассказал, что самая дорогая подписка ChatGPT Pro за $200 в месяц является для OpenAI убыточной. В беседе с пользователями Reddit руководители компании также отметили, что с ростом вычислительной мощности растут производительность и способности моделей — эти соображения побудили OpenAI инициировать проект Stargate. Правдоподобным, по мнению Альтмана, теперь представляется и механизм рекурсивного самосовершенствования — процесса, при котором ИИ самостоятельно повышает свой уровень без участия человека. На вопрос о том, будут ли самосовершенствующиеся или любые другие модели OpenAI использоваться для разработки ядерного оружия, Вейл отметил, что компания доверяет властям, работающие в правительственных учреждениях учёные являются экспертами в области ИИ и исследователями мирового класса — едва ли они решатся включить ответы ИИ в проекты с обширной экспериментальной базой. Представители компании ответили и на другие волнующие общественность вопросы: новая рассуждающая модель OpenAI o3 выйдет «больше, чем через несколько недель, и меньше, чем через несколько месяцев»; сроки выхода флагманской «нерассуждающей» модели GPT-5 пока не установлены; генератор изображений DALL-E 3 вышел уже более двух лет назад, и сейчас компания готовит его новую версию. Размышляющий ИИ стал доступен в бесплатном ChatGPT — OpenAI выпустила мощнейшую модель o3-mini

31.01.2025 [22:52],

Андрей Созинов

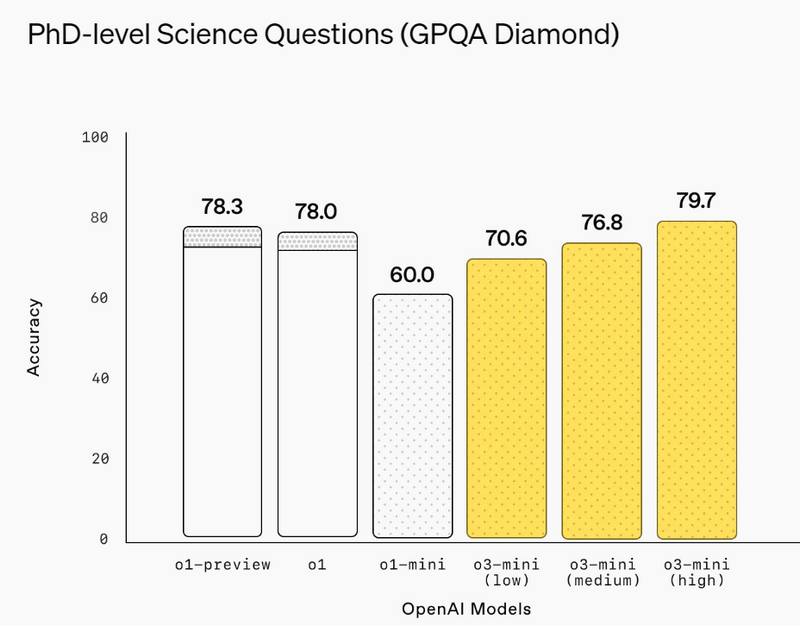

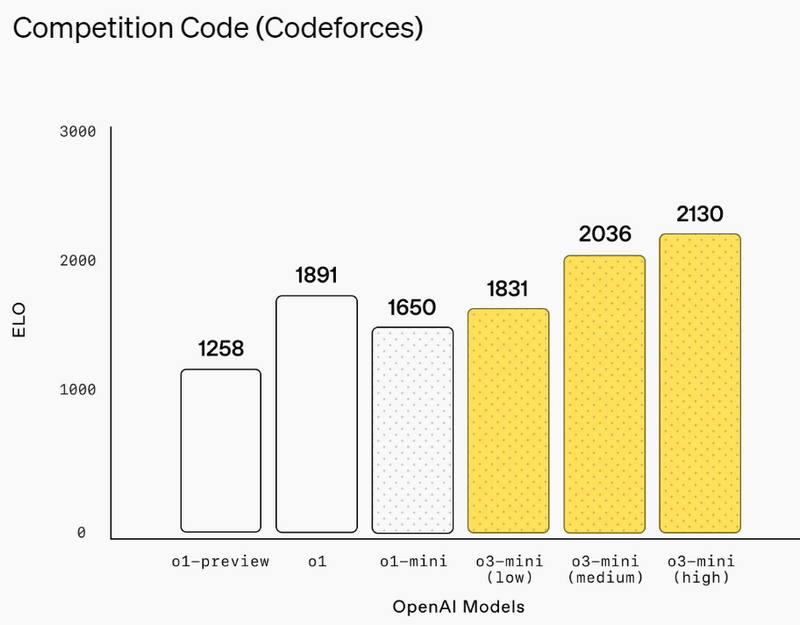

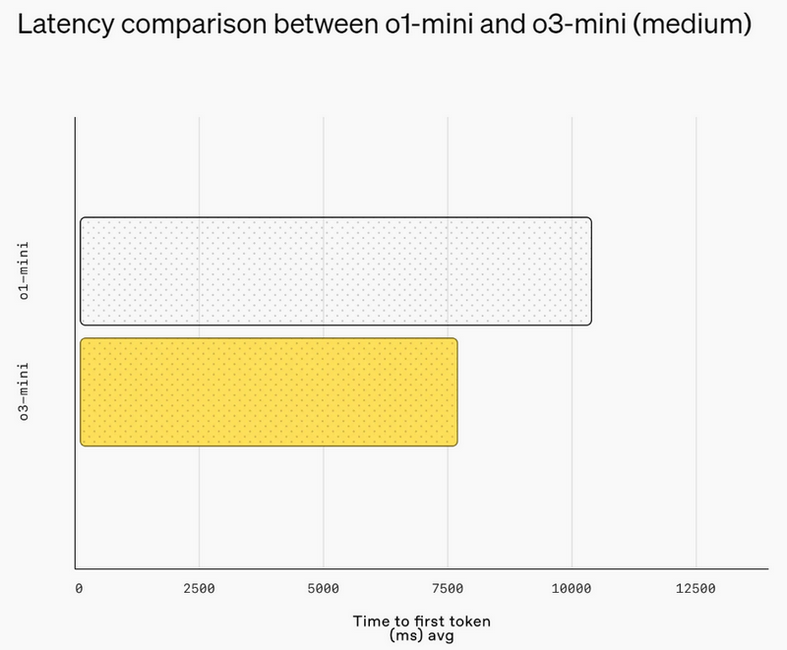

Генеральный директор OpenAI Сэм Альтман (Sam Altman) ровно две недели назад пообещал, что большая языковая модель нового поколения o3-mini со способностью к рассуждению будет выпущена «через пару недель». И ведь не обманул — сегодня OpenAI запустила o3-mini в ChatGPT, а также в API-сервисах. Самое интересное в том, что новая ИИ-модель стала доступна даже бесплатным пользователям ChatGPT, пусть и с ограничениями.

Источник изображений: OpenAI Первоначально анонсированная в рамках 12-дневного предрождественского марафона премьер OpenAI, модель o3-mini призвана сравниться с o1 по производительности в задачах, связанных с математикой, написанием программного кода и научными дисциплинами, при этом отвечая быстрее. OpenAI утверждает, что o3-mini работает на 24 % быстрее, чем o1-mini, и при этом даёт более точные ответы. Как и o1-mini, новая модель будет демонстрировать ход своих размышлений при решении задачи, а не просто предоставлять готовый ответ.  В декабре OpenAI представила несколько ранних тестов, демонстрирующих превосходство o3 над o1. Теперь разработчики утверждают, что версия o3-mini превзойдёт o1 в ряде задач, связанных с кодированием и рассуждениями, при меньших затратах и задержках. Разработчики смогут использовать o3-mini через API-сервисы OpenAI, включая Chat Completions API, Assistants API и Batch API.  Платным пользователям также будет доступна модель o3-mini-high, которая, по словам OpenAI, станет «лучшим вариантом для написания программного кода в ChatGPT» и предложит ответы с более высоким уровнем интеллекта, пусть и с небольшой задержкой. Кроме того, o3-mini будет поддерживать поиск в интернете, позволяя находить ответы со ссылками на веб-источники.  Это также первый случай, когда бесплатные пользователи ChatGPT смогут опробовать модели OpenAI со способностью к рассуждениям. Вероятно, за это стоит благодарить китайский стартап DeepSeek, который всколыхнул мир ИИ. Хотя нельзя исключать и влияние Microsoft, которая ранее открыла доступ к o1 для всех пользователей Copilot.  Пользователи смогут бесплатно протестировать o3-mini в ChatGPT, выбрав функцию Reason на панели чата. Ограничения будут такими же, как для GPT-4o. У платных пользователей лимиты окажутся выше: подписчики тарифов ChatGPT Plus и Teams смогут отправлять до 150 сообщений в день. А пользователи тарифа ChatGPT Pro за $200 в месяц получат неограниченный доступ к o3-mini. Пользователи Windows получили бесплатный доступ к нейросети, которую OpenAI предлагает за $20–200 в месяц

31.01.2025 [13:56],

Владимир Фетисов

Компания Microsoft сделала очередной шаг на пути расширения доступности передовых ИИ-алгоритмов для пользователей. Софтверный гигант объявил, что все пользователи ИИ-помощника Copilot получат бесплатный доступ к функции Think Deeper, основой которой является способная размышлять большая языковая модель (LLM) OpenAI o1.

Источник изображения: Microsoft Designer Компания OpenAI запустила LLM o1 в декабре прошлого года, но доступ к ней можно было получить только в рамках платной подписки, причём для оплаты тарифа ChatGPT Pro с безлимитным доступом к алгоритму требуются платить $200 в месяц. Пользователям также предлагался тариф ChatGPT Plus за $20 в месяц, но он имеет некоторые ограничения. На этой неделе глава подразделения Microsoft AI Мустафа Сулейман (Mustafa Suleyman) объявил, что доступ к ИИ-модели o1 откроется всем пользователям Copilot «повсеместно и бесплатно». Взаимодействовать с алгоритмом предлагается через функцию Think Deeper в Copilot, при использовании которой нейросеть тратит несколько секунд на обдумывание ответа на заданный вопрос. Получить доступ к Copilot можно в приложении для Windows или на веб-сайте copilot.microsoft.com, но потребуется авторизоваться с учётной записью Microsoft. Think Deeper по сути представляет собой более вдумчивую версию Copilot, который в стандартном варианте выдаёт более быстрые и беглые ответы на вопросы пользователей. Однако это не поисковая система, поскольку в распоряжении нейросети база данных, актуальная до октября 2023 года. При этом алгоритм может использоваться, например, для написания программного кода, анализа каких-то исторических событий и многого другого. Бесплатный ChatGPT стал «умнее по всем параметрам» — OpenAI обновила модель GPT-4o

31.01.2025 [01:29],

Николай Хижняк

Компания OpenAI анонсировала обновление для своей ИИ-модели GPT-4o, которая является основой для чат-бота ChatGPT, в том числе его бесплатной версии. Обновление сделало нейросеть «умнее по всем параметрам», а также «наделило более актуальной информацией», а также научило «более глубокому пониманию и анализу загружаемых [пользователями] изображений».

Источник изображения: OpenAI Ключевая особенность свежего обновления ИИ-модели GPT-4o заключается в том, что чат-бот ChatGPT на её основе теперь лучше справляется с задачами по STEM-дисциплинам, то есть лучше разбирается в вопросах науки, технологий, инженерии, математики и программирования. Хорошая новость для тех, кто полагается на помощь ChatGPT, например, в вопросах написания кода или решения задач, связанных с кросс-доменными проблемами. Также ИИ-модель GPT-4o была обучена на основе более свежей информации, поэтому чат-боты на её основе теперь могут ссылаться на данные до июня 2024 года. Это означает, что ChatGPT сможет предоставлять больше контекста относительно более свежих тенденций и событий. Что касается функций, связанных с генерацией и редактированием изображений, то ChatGPT теперь лучше «понимает» и анализирует изображения, загружаемые пользователем. Например, чат-бот сможет предоставлять более качественные советы по редактированию изображений, а также лучше анализировать сложные графики и диаграммы. Наконец, ChatGPT будет проявлять больше энтузиазма в использовании различных эмодзи в своих ответах, особенно, когда в запросах пользователя тоже будут использоваться эмодзи. SoftBank намеревается вложить в OpenAI около $25 млрд

30.01.2025 [10:06],

Алексей Разин

Участие в проекте Stargate, который призван за четыре года привлечь $500 млрд к созданию передовой ИИ-инфраструктуры на территории США, для японской корпорации SoftBank является не единственной целью на ближайшее время. По данным Financial Times, руководство SoftBank ведёт переговоры с OpenAI об инвестициях в капитал последней до $25 млрд.

Источник изображения: Nvidia До сих пор крупнейшим инвестором OpenAI считалась корпорация Microsoft, которая вложила в создавший ChatGPT стартап около $13 млрд. Как отмечает Bloomberg со ссылкой на знакомые с ходом переговоров источники, SoftBank рассматривает возможность вложения в капитал OpenAI от $15 до $25 млрд. Эти средства не относятся к тем $19 млрд, которые будут выделены SoftBank на реализацию проекта Stargate, управляющим партнёром которого является OpenAI. Представители упоминаемых компаний эту информацию никак комментировать для Bloomberg не стали, успех переговоров также не гарантируется. Японская корпорация SoftBank, чей глава Масаёси Сон (Masayoshi Son) управляет фондом Vision Fund, давно интересовался возможностью инвестиций в OpenAI, он даже встречался в возглавляющим стартап Сэмом Альтманом (Sam Altman) в 2019 году и предлагал $1 млрд, но сделка тогда не состоялась. Через Vision Fund Сону позже удалось вложить в OpenAI около $500 млн, а в прошлом месяце этот фонд предложил выкупить акции OpenAI на общую сумму $1,5 млрд у сотрудников стартапа. По состоянию на конец сентября SoftBank располагал примерно $25 млрд свободных средств, а также акциями множества компаний, включая британский холдинг Arm, который даже после IPO примерно на 90 % принадлежит японской корпорации. Масаёси Сон в целом намерен за время правления Трампа направить на развитие американской инфраструктуры и экономики $100 млрд. Microsoft заподозрила DeepSeek в обучении ИИ на данных, украденных у OpenAI

29.01.2025 [12:17],

Павел Котов

Компании Microsoft и OpenAI проведут расследование на предмет того, не совершила ли организация, связанная с китайской лабораторией искусственного интеллекта DeepSeek, кражу данных у OpenAI. Об этом сообщило агентство Bloomberg со ссылкой на собственные источники.

Источник изображения: deepseek.com Эксперты отдела безопасности Microsoft ещё осенью обратили внимание, что некие лица, которые, по мнению корпорации, могут быть связаны с DeepSeek, запрашивают большие объёмы данных через API OpenAI, рассказали источники Bloomberg. OpenAI продаёт доступ к API — этот инструмент позволяет сторонним разработчикам интегрировать модели искусственного интеллекта OpenAI в свои приложения. Microsoft как технологический партнёр и крупнейший инвестор OpenAI уведомила компанию о происходящем. Эта деятельность может нарушать условия обслуживания OpenAI или указывать, что связанная с китайской лабораторией компания пыталась обойти ограничения на объём данных, который могут получить клиенты OpenAI. Ранее DeepSeek представила открытую модель ИИ R1, имитирующую ход мыслей человека. Проект всколыхнул рынок, на котором доминируют OpenAI и другие американские компании, в том числе Google и Meta✴. По словам создателей, модель может конкурировать или превосходит проекты ведущих американских разработчиков, а её обучение обошлось радикально дешевле. В результате возникла угроза американскому доминированию в отрасли ИИ, и в понедельник, 27 января, рыночная капитализация технологических компаний США, включая Microsoft, Nvidia, Oracle и Alphabet, просела почти на $1 трлн. Накануне, 28 января, советник президента США Дональда Трампа (Donald Trump) по вопросам ИИ Дэвид Сакс (David Sacks) заявил, что есть «существенные доказательства» использования моделей OpenAI при разработке технологий DeepSeek. В интервью господин Сакс рассказал о методе дистилляции, позволяющий одной модели ИИ обучаться на данных другой для развития аналогичных возможностей. «Мы знаем, что компании из КНР — и прочие — постоянно пытаются произвести дистилляцию моделей ведущих американских компаний в области ИИ. Как ведущий разработчик ИИ мы принимаем контрмеры для защиты нашей интеллектуальной собственности, включая тщательный процесс развёртывания передовых возможностей у выпускаемых моделей, и уверены, что по мере движения вперёд критически важно тесно сотрудничать с правительством США, чтобы наиболее эффективным образом защитить самые функциональные модели от попыток неприятеля и конкурентов завладеть американскими технологиями», — прокомментировали заявление Сакса в OpenAI. Трамп и Альтман высоко оценили успехи китайского ИИ-стартапа DeepSeek и заявили, что США смогут лучше

28.01.2025 [10:01],

Алексей Разин

Распространение новейшей языковой модели китайской компании DeepSeek зародило в умах инвесторов сомнения по поводу способности американских компаний и далее удерживать лидерство в сфере ИИ, а главное — доказало, что высокого быстродействия можно добиться при меньших затратах. Президент Дональд Трамп (Donald Trump) и глава OpenAI Сэм Альтман (Sam Altman) похвалили DeepSeek, но подчеркнули, что США способны на большее.

Источник изображения: DeepSeek По крайней мере, в своём выступлении во Флориде Дональд Трамп заявил, что много читал в последние дни о прогрессе китайской компании DeepSeek, которая продемонстрировала современную языковую модель, созданную со значительно меньшими аппаратными и материальными ресурсами по сравнению с американскими разработками. По мнению президента США, подобный прецедент идёт на пользу его стране, поскольку «мы сможем сделать то же самое, при этом не затрачивая так много средств и получая такой же результат, как хотелось бы надеяться». На встрече с политическим руководством Китая, по словам Трампа, он услышал признания заслуг американских учёных. По его мнению, если китайской стороне удалось создать более дешёвую технологию в сфере искусственного интеллекта, американские компании последуют за ней. Один из основателей и глава OpenAI Сэм Альтман (Sam Altman) заявил со страниц социальной сети X, что «DeepSeek R1 является впечатляющей моделью, особенно с точки зрения соотношения результата и стоимости». Он тут же добавил: «Мы очевидно сможем предложить значительно лучшие модели. Иметь нового конкурента — это реально очень воодушевляет. Мы ускорим выпуск некоторых моделей». Компания Nvidia также не удержалась от комментариев и накануне тоже выразила восхищение итогами работы DeepSeek, подчеркнув, что подобный высокий результат был достигнут в условиях экспортных ограничений США и относительно небольшого бюджета. «Работа DeepSeek показывает, как могут создаваться новые модели без нарушения экспортного контроля», — говорится в сообщении Nvidia. Рекордное падение капитализации самой Nvidia на фоне успехов DeepSeek представителей компании не расстроило. Напротив, они отметили, что создание искусственного интеллекта с возможностью рассуждения потребует значительных количеств GPU данной марки, а также высокоскоростных телекоммуникационных решений. Попутно бывший генеральный директор Intel Патрик Гелсингер (Patrick Gelsinher) также положительно оценил достижения как китайской DeepSeek, так и всего ПО с открытым исходным кодом в сфере создания систем искусственного интеллекта. Он отметил, что хотя специфика работы китайских компаний и не позволяет судить об истинной величине затрат DeepSeek на создание своей модели R1, но имеющиеся доказательства говорят о том, что они оказались в 10 или 50 раз ниже, чем в случае с моделью o1 компании OpenAI. По словам Гелсингера, инженеры его собственного стартапа Gloo, создающего чат-бот Kallm, уже используют языковую модель DeepSeek R1, хотя технически у них есть возможность применять o1 компании OpenAI. В дальнейшем Gloo перейдёт на языковую модель с открытым исходным кодом собственной разработки. Как признался Гелсингер, «открытое побеждает, DeepSeek полностью изменит мир всё более закрытых моделей в сфере ИИ». Вычисления, по словам Гелсингера, подчиняются тем же законам, что и газы. Чем дешевле становится ПО, тем сильнее расширяется рынок для его применения. OpenAI выпустила ИИ-агента Operator, который будет сидеть в интернете вместо пользователя

24.01.2025 [00:16],

Анжелла Марина

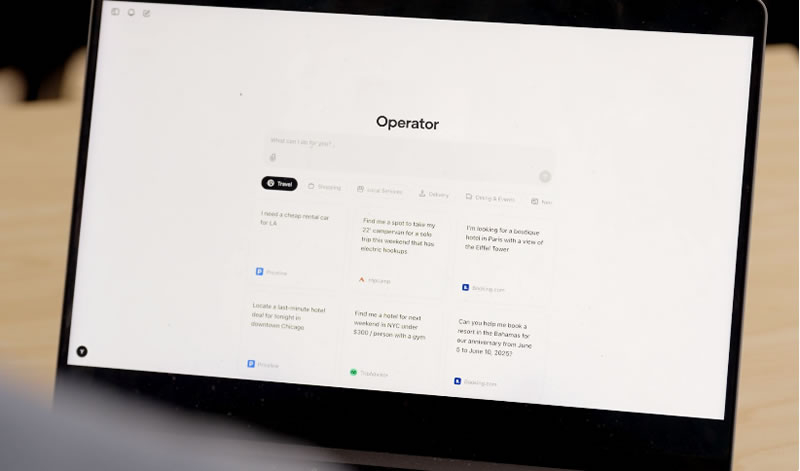

Компания OpenAI представила «исследовательскую версию» ИИ-агента, который может самостоятельно выполнять различные задачи в интернете по запросу пользователя. Например, его можно попросить найти авиабилеты или подобрать товар. Виртуальный помощник, получивший имя Operator, может посещать веб-страницы и взаимодействовать с ними, используя ввод текста, клики и прокрутку.

Источник изображения: OpenAI В основе этого ИИ-агента лежит модель Computer-Using Agent, объединяющая возможности визуального восприятия модели GPT-4o и «продвинутое рассуждение посредством обучения с подкреплением», что позволяет ИИ взаимодействовать с графическими интерфейсами. Как пишет The Verge, Operator анализирует код веб-страниц и взаимодействует с контентом посредством виртуальной мыши и клавиатуры, что позволяет ему работать без интеграции с программным интерфейсом API (Application programming interface). Примечательно, что ИИ-агент обладает способностью к самокоррекции и, в случае возникновения каких-либо сложностей, передаёт управление пользователю. Также ему понадобится разрешение человека при необходимости ввода конфиденциальных данных, таких как логины и пароли, в том числе на отправку электронных писем. В OpenAI также подчёркивают, что Operator разработан таким образом, чтобы «отклонять вредоносные запросы и блокировать запрещённый контент». Однако компания предупреждает, что инструмент пока работает не идеально. Например, возникают определённые трудности с более сложными интерфейсами, такими как создание слайд-шоу или управление календарём. На данный момент новый ИИ-агент доступен только в США для подписчиков ChatGPT Pro стоимостью $200 в месяц, однако в будущем планируется расширить доступ к Operator для пользователей других тарифных планов, включая Plus, Team и Enterprise. Также компания намерена интегрировать возможности нового агента непосредственно в ChatGPT, чтобы сделать его ещё удобнее. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |