|

Опрос

|

реклама

Быстрый переход

OpenAI внедрит защиту от враждебного поглощения на фоне деятельности Илона Маска

18.02.2025 [11:33],

Алексей Разин

Желание привлекать больше средств от инвесторов вынуждает стартап OpenAI менять свою структуру, поскольку сейчас во главе неё стоит некоммерческая организация. Инвесторам она кажется потенциальным источником неопределённости, поэтому OpenAI пытается приблизить свою структуру к классической. При этом совет директоров хочет защитить стартап от возможных враждебных поглощений.

Источник изображения: Unsplash, Solen Feyissa Как отмечает Reuters со ссылкой на публикацию в Financial Times, в новой организационной структуре, более ориентированной на коммерческую деятельность и ответственность перед инвесторами, за советом директоров OpenAI предполагается закрепить право вето, которым его члены могут воспользоваться в случае угрозы недружественного поглощения. По всей видимости, подобные меры потребовались OpenAI в свете недавних попыток Илона Маска (Elon Musk) договориться о покупке OpenAI за $97,4 млрд. Совет директоров стартапа данное предложение отверг, но если компания будет переведена на коммерческие рельсы, подобных механизмов защиты в стандартной структуре правления предусмотрено не будет. Предполагается, что особые полномочия совета директоров при голосовании по стратегически важным вопросам позволят OpenAI оградить себя от давления мажоритарных акционеров типа Microsoft или SoftBank. Как сообщается, механизм защиты разрабатывается советом директоров во взаимодействии с генеральным директором Сэмом Альтманом (Sam Altman), который является одним из двух основателей OpenAI, приближённым к руководству компанией в настоящий момент. Илон Маск ещё несколько лет назад покинул компанию, и с тех пор упрекает её нынешнее руководство в отклонении от изначальной миссии. Попытку купить OpenAI за $97,4 млрд Маск обосновал необходимостью «спасения» стартапа, но отрицать коммерческий интерес миллиардера к теме искусственного интеллекта сложно. В 2023 году он основал собственный стартап xAI, который сейчас также активно развивается и привлекает средства инвесторов. Совет директоров OpenAI единогласно отверг предложение Маска о покупке стартапа за $97,4 млрд

15.02.2025 [05:43],

Алексей Разин

Ситуация с попыткой Илона Маска (Elon Musk) при поддержке консорциума инвесторов купить стартап OpenAI за $97,4 млрд к концу недели продолжила обрастать новыми подробностями. Председатель совета директоров OpenAI Брет Тейлор (Bret Taylor) признался в пятницу, что этот орган правления всё же получил предложение Маска и единогласно проголосовал против.

Источник изображения: Unsplash, Faizi appshunter.io Ранее на этой неделе возникла путаница с порядком подачи подобных заявок, которая позволила представителям OpenAI до пятницы утверждать, что совет директоров стартапа официальных предложений от представителей Маска не получал. После того, как коммуникации были упорядочены, председатель совета директоров OpenAI написал на страницах социальной сети X: «OpenAI не продаётся, совет директоров единогласно отверг недавнюю попытку господина Маска подорвать конкуренцию». Тейлор также добавил, что любая предстоящая реорганизация OpenAI будет усиливать некоммерческую составляющую стартапа и её миссию достижения всеобщего блага для человечества при помощи сильного искусственного интеллекта (AGI). Напомним, что первоначальную реакцию на предложение Маска опубликовал ранее генеральный директор OpenAI Сэм Альтман (Sam Altman). Он отклонил предложение бывшего соратника, иронично отметив, что OpenAI вместо этого может купить за $9,74 млрд принадлежащую Маску социальную сеть X, ранее известную как Twitter. Успехи OpenAI, у истоков которого он стоял, но покинул к 2018 году, не дают покоя Маску как минимум с 2023 года. Он основал конкурирующую компанию xAI, а в 2024 году последовательно подал два иска к руководству OpenAI, которые в той или иной форме обвиняют его в отступлении от некоммерческой сути организации. Первый свой иск он отозвал после того, как представители OpenAI обнародовали переписку с Маском, в которой он соглашался с идеей о том, что стартапу потребуется серьёзное финансирование, и он должен как-то зарабатывать. На этой неделе Маск заявил, что воздержится от покупки OpenAI, если так откажется от намеченного плана реструктуризации с целью перехода на коммерческие рельсы. После формального отказа совета директоров OpenAI юрист Маска Марк Тоберофф (Marc Toberoff) упрекнул правление стартапа в нелогичности поведения. По его словам, совет директоров хочет продать OpenAI «сам себе» по цене в несколько раз меньшей той, что предлагает Маск. Каким образом это должно пойти на пользу «всему человечеству», адвокат Маска понимать отказывается. Маск откажется от покупки OpenAI, если та согласится остаться некоммерческой

13.02.2025 [18:03],

Сергей Сурабекянц

Консорциум во главе с Илоном Маском (Elon Musk) отзовёт заявку в размере $97,4 млрд на покупку OpenAI, если производитель ChatGPT откажется от планов стать коммерческой организацией. OpenAI рассматривает реструктуризацию в коммерческую компанию, так как остро нуждается в дополнительных инвестициях, чтобы сохранить лидерство в гонке ИИ. Маск владеет конкурирующим стартапом xAI и заинтересован, чтобы OpenAI «сохранила миссию благотворительной организации».

Источник изображения: unsplash.com Маск старается помешать стартапу OpenAI перейти на коммерческие рельсы. «Если правление OpenAI готово сохранить миссию благотворительной организации и поставить условие о снятии подписи “на продажу” со своих активов путём прекращения их конвертации, Маск отзовёт заявку», — сказано в иске, поданном вчера юристами Маска. В противном случае «благотворительная организация должна получить компенсацию в размере того, что заплатит за её активы независимый покупатель». Маск в 2015 году стал соучредителем некоммерческой организации OpenAI вместе с Сэмом Альтманом (Sam Altman), но покинул компанию в 2018 году из-за разногласий по поводу направления её развития и источников финансирования. После этого Альтман стал генеральным директором OpenAI и запустил коммерческое подразделение в стартапе, чтобы обеспечить финансирование от таких инвесторов, как Microsoft. Сейчас Альтман работает над планом реструктуризации основного бизнеса в коммерческую фирму, которая больше не будет контролироваться её некоммерческим советом директоров. Однако некоммерческая организация продолжит своё существование и будет владеть долей в коммерческой компании. Маск подал в суд, именно для того, чтоб предотвратить этот переход.

Источник изображения: Tesla По информации Reuters, совет директоров OpenAI пока не получил официального предложения от группы Маска. Однако, генеральный директор OpenAI Сэм Альтман ранее заявил, что некоммерческая организация, контролирующая компанию, не продаётся, назвав предложение «смешным». Несколько аналитиков заявили, что независимо от результата, предложение Маска усложнит усилия OpenAI по превращению в коммерческую компанию, поскольку оно может установить высокую минимальную стоимость для некоммерческой организации, которая контролирует стартап. В настоящее время SoftBank Group ведёт переговоры о проведении раунда финансирования OpenAI на сумму до $40 млрд при рыночной стоимости компании порядка $300 млрд. OpenAI обновила правила поведения для ИИ: нет подхалимству и избеганию деликатных тем

13.02.2025 [12:17],

Павел Котов

Компания OpenAI выпустила расширенную версию «Спецификации моделей» (Model Spec) — документа, определяющего поведение моделей искусственного интеллекта. Компания сделала его бесплатным для использования и изменения любым желающим.

Источник изображения: Dima Solomin / unsplash.com Документ объёмом 63 страницы (предыдущая версия содержала всего 10 страниц) содержит рекомендации относительно того, как модели ИИ должны обрабатывать запросы и реагировать на устанавливаемые пользователями настройки. В нём подчёркиваются три основных принципа: настраиваемость, прозрачность и «интеллектуальная свобода» — последнее означает возможность для пользователя исследовать и обсуждать различные вопросы без произвольных ограничений. В документе упомянуты получившие наибольшую огласку инциденты, связанные с этикой ИИ и произошедшие за последний год. В публикации корпоративного блога OpenAI приводится множество примеров запросов и надлежащих ответов, а также вариантов, нарушающих требования документа. Например, модели ИИ не должны воспроизводить защищённые авторским правом материалы или использоваться для обхода платного доступа. Модель не может поощрять членовредительство — в индустрии ИИ бывали и такие инциденты. Изменения коснулись также участия ИИ в обсуждении спорных тем: моделям следует не проявлять крайнюю осторожность, а «искать истину вместе» с пользователями, придерживаясь при этом строгих моральных позиций по таким вопросам, как дезинформация или причинение вреда. То есть ИИ должен предлагать обоснованный анализ, а не избегать обсуждения. OpenAI также пересмотрела свою позицию в отношении материалов для взрослых: компания изучает возможность разрешить некоторые их виды, но сохранить строгий запрет на явно противоправный контент.

Источник изображения: Growtika / unsplash.com Новые принципы позволяют ИИ преобразовывать материалы деликатного характера, но запрещают создавать их. Например, можно перевести текст, связанный с веществами в ограниченном обороте, с одного языка на другой; можно проявлять эмпатию, но без явно неискренних эмоций. Следует соблюдать границы, но при этом максимально повышать полезность ИИ. К этому, в той или иной мере, стремятся и другие разработчики ИИ, но не все готовы открыто это формулировать. Особое внимание уделяется проблеме «подхалимства ИИ» — модели склонны демонстрировать покладистость, даже когда следовало бы возразить или выступить с критикой. ChatGPT должен давать одинаковые фактические ответы независимо от формулировки вопроса, честную обратную связь вместо пустых похвал — вести себя как вдумчивый коллега, а не стремиться угодить. Если пользователя интересует критика работы, ИИ должен предоставлять конструктивные замечания, а не утверждать, что всё идеально. Если же пользователь делает неверное утверждение, его следует вежливо исправить, а не подыгрывать ему. В спецификации представлена чёткая «цепочка команд», определяющая приоритет инструкций: на первом месте — нормы OpenAI, за ними следуют рекомендации разработчиков, а затем предпочтения пользователей. Такая иерархия проясняет, какие аспекты ИИ можно изменять, а какие ограничения остаются неизменными. Документ распространяется под лицензией Creative Commons Zero (CC0), что фактически переводит его в общественное достояние: компании и исследователи в области ИИ могут свободно внедрять, изменять или дополнять эти рекомендации. OpenAI не обещает мгновенных изменений в поведении ChatGPT или других своих продуктов, но новые модели будут постепенно приводиться в соответствие с новыми нормами. Компания также публикует список контрольных запросов, используемых для проверки соответствия моделей рекомендациям. ChatGPT потребляет не так много энергии, как считалось ранее, показало новое исследование

13.02.2025 [07:24],

Николай Хижняк

Согласно более ранним оценкам, ChatGPT потребляет около 3 Вт·ч энергии для ответа на один запрос, что в 10 раз больше средней мощности, необходимой при использовании поиска Google. Однако свежий отчёт исследовательского института Epoch AI, занимающегося изучением ключевых трендов и вопросов, которые будут определять траекторию развития и управление искусственным интеллектом, опровергает эту статистику и указывает на то, что энергозатраты чат-бота OpenAI значительно меньше, чем предполагалось ранее.

Источник изображения: OpenAI В отчёте Epoch AI говорится, что ChatGPT на базе модели GPT-4o потребляет всего 0,3 Вт·ч энергии при генерации ответа. В разговоре с порталом TechCrunch дата-аналитик Epoch AI Джошуа Ю (Joshua You) отметил: «Потребление энергии на самом деле не так уж и велико по сравнению с использованием обычных бытовых приборов, отоплением или охлаждением дома или использованием автомобиля». По словам эксперта, предыдущие оценки энергозатрат ChatGPT были основаны на устаревших данных. Специалист отмечает, что предполагаемая «универсальная» статистика энергопотребления ChatGPT была основана на предположении, что OpenAI для запуска и работы ИИ использует старые и неэффективные чипы. «Кроме того, некоторые из моих коллег обратили внимание, что наиболее широко распространённая оценка в 3 Вт·ч на выполнение запроса была основана на довольно старых исследованиях. И если судить по каким-то приблизительным расчётам, эта статистика показалась слишком завышенной», — добавил Ю. И всё же следует добавить, что оценку энергозатрат ChatGPT от Epoch AI тоже нельзя считать непреложной, поскольку она не учитывает некоторые ключевые возможности ИИ, такие как генерация изображений чат-ботом. По словам эксперта, он не ожидает роста энергопотребления у ChatGPT, но по мере того, как ИИ-модели становятся более продвинутыми, им будет требоваться больше энергии для работы. Ведущие компании по разработке ИИ, включая OpenAI, склоняются к развитию так называемых рассуждающих моделей ИИ, которые не просто дают ответ на поставленный вопрос, но также описывают весь процесс, который привёл к получению того или иного ответа, что в свою очередь требует больших энергозатрат. Множество отчётов последних лет показывают, что такие технологии, как Microsoft Copilot и ChatGPT (а точнее оборудование, на котором они работают) потребляют эквивалент объёма одной бутылки воды для охлаждения при генерации ответа на запрос. Эти выводы следуют за более ранним отчётом, в котором говорится, что совокупные энергозатраты Microsoft и Google превышают потребление электроэнергии более чем в 100 странах мира. В одном из наиболее свежих исследований подробно описывалось, что модель OpenAI GPT-3 потребляет в четыре раза больше воды, чем считалось ранее, в то время как GPT-4 потребляет объёмы до трёх бутылок воды, чтобы сгенерировать всего лишь 100 слов. Вполне очевидно, что модели ИИ начинают потреблять больше ресурсов по мере того, как становятся более продвинутыми. Однако, выводы последнего исследования показывают, что тот же ChatGPT может быть не таким прожорливым, как считалось ранее. Глава OpenAI раскрыл планы по выпуску GPT-5

13.02.2025 [00:14],

Андрей Созинов

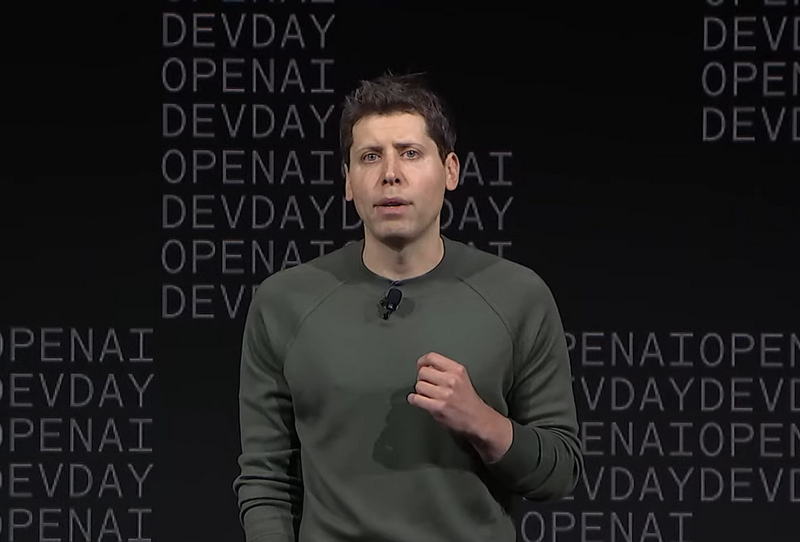

Генеральный директор OpenAI Сэм Альтман (Sam Altman) подробно рассказал о планах компании в отношении грядущих моделей искусственного интеллекта GPT-4.5 и GPT-5.

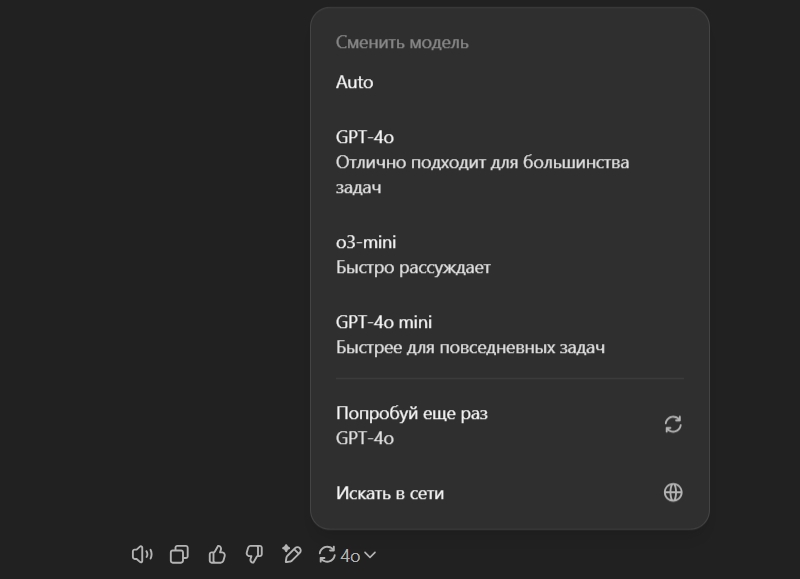

Источник изображения: OpenAI В своём посте в соцсети X Альтман признал, что линейка продуктов OpenAI стала сложной, и сказал, что компания хочет провести работу по упрощению своих предложений. «Мы ненавидим подборщик моделей так же, как и вы, и хотим вернуться к магическому унифицированному [искусственному] интеллекту», — написал Альтман. Компания планирует выпустить GPT-4.5, которая, по словам Альтмана, получила внутреннее название Orion и станет «последней нерассуждающей моделью OpenAI». Напомним, OpenAI обучила модель Orion в октябре прошлого года, а позже стало известно, что компания столкнулась с большими расходами и нехваткой данных при её обучении. После выпуска GPT-4.5 «наша главная цель — унифицировать модели серии "o" и модели серии GPT, создав системы, которые могут использовать все наши инструменты, которые будут понимать, когда нужно долго думать, а когда нет, и вообще быть полезными для очень широкого круга задач», — поделился Альтман.  Сейчас бесплатный ChatGPT предлагает три модели ИИ на выбор С помощью ChatGPT и OpenAI API компания планирует «выпустить GPT-5 как систему, объединяющую множество наших технологий, включая o3 (прим. ред. — o3 является самой продвинутой ИИ-моделью OpenAI на данный момент)», — говорит Альтман, добавляя, что «мы больше не будем поставлять o3 как отдельную модель». OpenAI представила o3 в декабре и запустила o3-mini в январе. Альтман рассказал, что после запуска GPT-5 пользователи бесплатного ChatGPT получат «неограниченный доступ к GPT-5 на стандартных настройках интеллекта», но с некими ограничениями для защиты от злоупотреблений. В свою очередь платные подписчики на тарифе Plus смогут использовать GPT-5 на «более высоком уровне интеллекта», а подписчики Pro получат «еще более высокий уровень интеллекта». Альтман не уточнил, когда именно выйдут GPT-4.5 и GPT-5, но отметил, что это займёт «недели/месяцы». Совет директоров OpenAI так и не получил официального предложения о покупке от Илона Маска

12.02.2025 [13:52],

Павел Котов

Совет директоров OpenAI пока не получил официального предложения о покупке компании от консорциума под руководством Илона Маска (Elon Musk), сообщает Reuters. При этом адвокат бизнесмена заявил, что такой документ был направлен внештатному юрисконсульту OpenAI.

Источник изображения: Dima Solomin / unsplash.com Маск опубликовал предложение о покупке некоммерческой организации, контролирующей разработчика ChatGPT — компанию OpenAI — за $97,4 млрд. Спустя день после этого события стороны предполагаемой сделки не пришли к единому мнению о том, что именно произошло с официальным предложением. Совет директоров OpenAI не получал официального предложения от группы Маска, утверждает осведомлённый источник Reuters; всё это усугубляет путаницу, связанную с попыткой получить контроль над самой известной в мире компанией в области искусственного интеллекта. Юрист Маска Марк Тоберофф (Marc Toberoff) сообщил Reuters, что в минувший понедельник направил предложение по электронной почте внештатному юрисконсульту OpenAI в фирме Wachtell, Lipton, Rosen & Katz — представители фирмы ситуацию не прокомментировали. К электронному сообщению, утверждает господин Тоберофф, приложен документ — «подробное четырёхстраничное письмо о намерениях», подписанное Маском и другими инвесторами, и адресован этот документ совету директоров OpenAI. Контролирующая OpenAI некоммерческая организация не продаётся, заявил накануне агентству Reuters её гендиректор Сэм Альтман (Sam Altman). Своим подчинённым он направил внутреннее письмо, в котором сообщил, что хотя совет директоров официально не рассматривал предложение, он намеревался его отклонить, исходя из интересов миссии OpenAI. Маск был учредителем OpenAI как некоммерческой организации в 2015 году вместе с Альтманом, но ушёл до взлёта компании из-за разногласий по поводу её направления развития и источников финансирования. В 2023 году он запустил конкурирующий стартап в области ИИ xAI. Сейчас OpenAI намеревается провести реорганизацию, стать коммерческой компанией и привлечь $40 млрд инвестиций — это поможет ей обеспечить капитал, необходимый для разработки передовых моделей ИИ; на данном этапе необходимо установить цену некоммерческой организации, которая контролирует коммерческое подразделение. Генпрокурор Делавэра, где зарегистрирована OpenAI, Кэтлин Дженнингс (Kathleen Jennings) пообещала изучить схему реорганизации компании и убедиться, что она «придерживается своих непосредственных благотворительных целей к общественной выгоде, а не выгоде коммерческих или частных интересов директоров или партнёров OpenAI». Предложение Маска, утверждают юристы, усложняет процесс справедливой оценки OpenAI особенно в отношении некоммерческих активов в сложном процессе корпоративной реорганизации, то есть установки цены, которую придётся заплатить в обмен на вывод компании из-под контроля некоммерческой структуры. Маск предложил купить OpenAI за $97,4 млрд, чтобы вернуть её на сторону добра

11.02.2025 [01:21],

Андрей Созинов

Илон Маск (Elon Musk) во главе группы инвесторов выдвинул предложение о покупке некоммерческого подразделения OpenAI за $97,4 млрд, сообщает The Wall Street Journal. СМИ уже назвали эту сделку «драматической эскалацией самого ожесточённого соперничества в области ИИ в Кремниевой долине». Предложение было представлено совету директоров OpenAI в понедельник утром.

Источник изображения: OpenAI Предложение о покупке OpenAI поступило от мощной коалиции инвесторов-сторонников Маска, включая его собственную ИИ-компанию xAI и таких крупных венчурных инвесторов, как Valor Equity Partners, голливудского магната Ари Эмануэля (Ari Emanuel) и фирму 8VC, основанную соучредителем Palantir Джо Лонсдейлом (Joe Lonsdale). Это предложение поступило в переломный момент для OpenAI. Некоторое время назад глава компании Сэм Альтман (Sam Altman) запустил процесс превращения её в коммерческую структуру. Недавно стало известно, что OpenAI намерена привлечь $40 млрд при оценке в $340 млрд. А ещё в конце января был анонсирован ИИ-мегапроект США Stargate стоимостью $500 млрд, и OpenAI является его важнейшей частью. Для Маска это предложение — самый смелый шаг в борьбе с превращением OpenAI в коммерческую организацию. Он считает, что компания предала свою первоначальную миссию по безопасному и открытому развитию ИИ и в настоящее время судится по этому поводу с OpenAI. Напомним, что Маск вместе с Сэмом Альтманом основали OpenAI в 2015 году, но в 2019 году глава Tesla покинул компанию. «Настало время для OpenAI вернуться к открытой (open-source), ориентированной на безопасность силе добра, которой она когда-то была, — сказал Маск в заявлении, предоставленном его адвокатом Марком Тобероффом (Marc Toberoff) изданию The Wall Street Journal. — Мы позаботимся о том, чтобы это произошло». Это предложение также значительно усложняет планируемое преобразование OpenAI в коммерческую компанию, поскольку команда Маска пообещала удовлетворить или превзойти любые более высокие предложения. Это создаёт сложную ситуацию для Альтмана, который уже ведёт переговоры. Вскоре после того, как о сделке стали писать СМИ, Сэм Альтман опубликовал в X следующее заявление: «Нет, спасибо, но мы купим Twitter за $9,74 миллиарда, если вы хотите». В OpenAI указали на пост Альтмана, когда компанию попросили дать комментарий. Представители Маска пока не прокомментировали сделку. OpenAI завершит разработку и запустит производство своего ИИ-чипа уже в 2025 году — это первый шаг к снижению зависимости от Nvidia

10.02.2025 [17:54],

Сергей Сурабекянц

Признанный лидер в сфере ИИ, компания OpenAI, прикладывает серьёзные усилия по снижению зависимости от ускорителей ИИ производства Nvidia. В ближайшие несколько месяцев OpenAI планирует завершить разработку собственного чипа и начать его производство на фабриках TSMC с использованием самых передовых техпроцессов. Источник изображения: Samsung По мнению аналитиков, «OpenAI находится на пути к достижению своей амбициозной цели массового производства на мощностях TSMC в 2026 году». Наиболее ответственным этапом на пути от дизайна к выпуску готовых чипов является Tape-out («тейпаут») — процесс переноса цифрового проекта чипа на фотошаблон для последующего производства. Обычно этот этап обходится в несколько десятков миллионов долларов, а до выпуска первого чипа проходит до шести месяцев. В случае сбоя требуется диагностировать проблему и повторить процесс. OpenAI рассматривает свой будущий ускоритель ИИ как стратегический инструмент для укрепления переговорных позиций с другими поставщиками чипов. Если первоначальный выпуск пройдёт удачно, OpenAI уже в этом году представит альтернативу чипам Nvidia, которые сейчас занимают более80 % рынка ИИ-ускорителей. В случае успеха первого чипа инженеры OpenAI планируют разрабатывать все более продвинутые процессоры с более широкими возможностями с каждой новой итерацией. Компания уже стала участником инфраструктурной программы Stargate стоимостью $500 млрд, объявленной президентом США Дональдом Трампом (Donald Trump) в прошлом месяце. Чип разрабатывается внутренней командой OpenAI во главе с Ричардом Хо (Richard Ho) в сотрудничестве с Broadcom. Хо более года назад перешёл в OpenAI из Google, где руководил программой по созданию специализированных чипов ИИ. Хотя команда Хо за последние месяцы выросла до 40 сотрудников, это количество по прежнему на порядок меньше, чем в масштабных проектах таких технологических гигантов, как Google или Amazon. Аналитики полагают, что на первом этапе новый ускоритель ИИ от OpenAI будет играть ограниченную роль в инфраструктуре компании. Чтобы создать столь же всеобъемлющую программу по проектированию чипов ИИ, как у Google или Amazon, OpenAI придётся нанять сотни инженеров. Согласно отраслевым источникам, новый дизайн чипа для амбициозной масштабной программы может обойтись в $500 млн. Эти расходы могут удвоиться, если учитывать необходимость создания программного обеспечения и периферийных устройств. Для сравнения: в 2025 году Meta✴ планирует потратить $60 млрд на ИИ-инфраструктуру, а годовые инвестиции Microsoft в этом направлении составят $80 млрд. OpenAI показала на Супербоуле рекламу ИИ за $14 млн, но с рисованием самого ролика ИИ не справился

10.02.2025 [12:27],

Дмитрий Федоров

OpenAI впервые вышла на арену Супербоула с 60-секундной рекламой за $14 млн. Этот ролик представляет ИИ как логичное продолжение величайших технологических достижений человечества. Анимация, выполненная в стиле пуантилизма, наглядно демонстрирует ключевые этапы прогресса — от открытия огня и изобретения колеса до ДНК-секвенирования и освоения космоса. Завершающий фрагмент демонстрирует ChatGPT в действии: он помогает пользователям решать повседневные задачи, тем самым подчёркивая, что ИИ-технологии уже стали неотъемлемой частью жизни.

Источник изображения: Levart_Photographer / Unsplash Руководителем рекламной кампании стала новый директор по маркетингу OpenAI Кейт Роуч (Kate Rouch). Стратегия ролика была построена так, чтобы сделать технологию доступной и понятной широкой аудитории, поэтому в нём намеренно отсутствуют упоминания о перспективах сильного ИИ (AGI) и суперинтеллекта. «Мы стремились создать послание, которое будет актуальным для зрителей Супербоула, среди которых десятки миллионов людей, не знакомых с ИИ», — пояснила Роуч. Учитывая, что в этом году за матчем следили около 130 млн человек, этот рекламный ход позволил OpenAI представить свой продукт максимально широкой аудитории. На этапе разработки концепции ролика OpenAI использовала собственный ИИ-генератор видео Sora для быстрой визуализации идей и тестирования различных операторских приёмов. Однако финальный вариант анимации был создан полностью вручную. Роуч подчёркивает, что это не ограничение возможностей ИИ, а осознанное решение. «Этот ролик — дань уважения человеческому творчеству и его расширению», — отметила она. Хотя Sora значительно ускорил процесс поиска визуальных решений, конечный результат подчёркивает важность роли реальных художников и аниматоров. Рекламная кампания OpenAI выходит в критически важный момент. По прогнозам, её рыночная стоимость может достичь $300 млрд, а ожидаемая выручка в этом году составит $11,6 млрд. В условиях стремительно нарастающей конкуренции, где ключевые позиции пытаются занять крупнейшие технологические компании, OpenAI использует главный матч американского футбола как площадку для повышения узнаваемости и укрепления доверия к бренду. Особенно актуален этот шаг на фоне недавнего провала Google, чей рекламный ролик, созданный к Олимпиаде, был снят с эфира из-за негативной реакции на использование ИИ для написания «искреннего» письма. OpenAI явно сделала ставку на аутентичность и прозрачность в подаче своего послания. Роуч, комментируя инцидент с Google, отметила, что вся индустрия проходит этап обучения и подчеркнула, что OpenAI намерена придерживаться принципов честности и открытости. Помимо OpenAI и Google, свою ИИ-рекламу во время Супербоула представила и Meta✴, сделав акцент на функциях ИИ в умных очках Ray-Ban. Запуск рекламы OpenAI происходит на фоне нарастающей общественной дискуссии о влиянии ИИ на общество. В ролике ИИ ставится в один ряд с фундаментальными изобретениями человечества — огнём и колесом, что неизбежно провоцирует споры. Скептики могут утверждать, что такая аналогия излишне смела, учитывая неопределённые перспективы и потенциальные риски технологий ИИ. Тем не менее OpenAI придерживается твёрдой позиции: «Мы глубоко убеждены в трансформационном потенциале этой технологии. Это основа всего, что мы делаем», — заявила Роуч, подчеркнув уверенность компании в будущем ИИ. Выход OpenAI на Супербоул — не просто дорогостоящая рекламная кампания, а стратегически важный шаг, демонстрирующий амбиции компании на фоне усиливающейся конкуренции и растущего общественного интереса к ИИ. OpenAI использует крупнейшее спортивное событие года в США, чтобы закрепить своё доминирование в сознании миллионов зрителей. Насколько успешным окажется этот ход, покажет время, но очевидно одно: эра ИИ уже наступила, и OpenAI намерена только побеждать. Выгоды ИИ распределяются по миру очень неравномерно, и это обеспокоило Сэма Альтмана

10.02.2025 [11:58],

Дмитрий Федоров

Генеральный директор OpenAI Сэм Альтман (Sam Altman) опубликовал эссе, в котором попытался раскрыть проблему дисбаланса в распределении выгод от технологического прогресса. По его мнению, хотя развитие технологий способствует улучшению таких показателей, как здоровье и экономическое благосостояние общества, выгоды от ИИ распределяются неравномерно. В частности, он предложил концепцию «бюджета вычислений» наряду с другими, на первый взгляд, странными идеями, призванными обеспечить всеобщий доступ к передовым ИИ-технологиям и предотвратить дисбаланс между капиталом и трудом, а как следствие — социально-экономические сдвиги.

Источник изображения: Growtika / Unsplash Реализация предложенных мер, включая концепцию «бюджета вычислений», направленную на обеспечение доступа всех жителей Земли к значительным вычислительным ресурсам, что, в свою очередь, должно сделать распределение выгод от технологий более справедливым, сталкивается с серьёзными практическими трудностями. Уже сегодня влияние ИИ на рынок труда выражается в сокращении рабочих мест и реструктуризации отделов в большинстве компаний по всему миру. Эксперты предупреждают, что при отсутствии надлежащих государственных мер, таких как программы переподготовки и повышения квалификации, может возникнуть ситуация массовой безработицы, которая лишь усугубит социальное неравенство. Альтман также акцентировал внимание на приближении сильного ИИ (Artificial General Intelligence или AGI) — системы, способной решать всё более сложные задачи на уровне человека в различных областях. Он предостерёг, что, несмотря на высокую эффективность в отдельных сферах, такие ИИ-системы будут нуждаться в постоянном человеческом контроле и, по его словам, не станут источником самых передовых идей. По мнению Альтмана, именно их масштабное развертывание обеспечит реальную ценность AGI и позволит создавать тысячи, а возможно, и миллионы гиперэффективных систем для решения задач в каждой области интеллектуальной деятельности.

Источник изображения: OpenAI Forum В финансовом аспекте развития ИИ Альтман обратил внимание на масштаб инвестиций и динамику снижения затрат. По имеющимся данным, OpenAI ведёт переговоры о привлечении инвестиций в размере до $40 млрд, а также планирует совместно с партнёрами инвестировать до $500 млрд в создание обширной сети данных. Он также подчеркнул, что стоимость использования «определённого уровня ИИ» снижается в 10 раз каждые 12 месяцев. Это означает, что, хотя расширение границ ИИ-технологий не приведёт к снижению их стоимости, пользователи смогут получать доступ к всё более совершенным ИИ-системам за те же деньги. Параллельно с развитием технологий OpenAI переходит от некоммерческой модели к традиционной корпоративной структуре. Компания стремится достичь выручки в $100 млрд уже к 2029 году, что сопоставимо с годовыми продажами таких корпораций, как Target и Nestle. Альтман отметил, что для обеспечения безопасности при создании AGI могут потребоваться жёсткие ограничения, которые, вероятно, вызовут критику. Он подчеркнул, что целью OpenAI при разработке AGI является расширение прав и возможностей человека, а также предотвращение использования ИИ авторитарными режимами для контроля над населением посредством массовой слежки. Недавно Альтман заявил, что, по его мнению, OpenAI заняла неправильную позицию в вопросе открытости своих технологий. Хотя в прошлом компания предоставляла открытые решения, в целом она придерживалась проприетарного, закрытого подхода к разработке. Можно констатировать, что изложенные Альтманом идеи отражают сложную динамику развития ИИ, где технологический прогресс сопряжён с существенными социальными и экономическими вызовами. Масштабные инвестиции, динамичное снижение затрат на вычислительные ресурсы и необходимость строгих мер безопасности свидетельствуют о том, что будущее ИИ требует комплексного и продуманного подхода. При этом стратегическое партнёрство OpenAI с Microsoft остаётся ключевым, а предстоящий AI Action Summit в Париже подчёркивает актуальность обсуждаемых вопросов. SoftBank инвестирует в OpenAI до $40 млрд — на $15 млрд больше, чем предполагалось

08.02.2025 [13:47],

Владимир Мироненко

Японский конгломерат SoftBank близок к завершению оформления сделки по инвестированию до $40 млрд в ИИ-стартап OpenAI при предварительной оценке его рыночной стоимости в $260 млрд, пишет ресурс CNBC. Как ожидается, часть этих средств будет использована OpenAI для финансирования Stargate — совместного предприятия, основанного SoftBank, OpenAI и Oracle.

Источник изображения: Levart_Photographer/unsplash.com По данным CNBC, первый транш поступит на расчётный счёт OpenAI этой весной, а на перечисление всей суммы уйдёт от 12 до 24 месяцев. Размер инвестиций на $15 млн больше первоначальной суммы инвестиций, которая обсуждалась на переговорах компаний неделю назад. Как сообщает газета New York Times, в раунде финансирования также участвует ещё несколько инвесторов, которые предоставят четверть общей суммы. Сделка показывает, что инвесторы по-прежнему настроены оптимистично в отношении лидеров рынка ИИ, таких как OpenAI, несмотря на падение их акций после анонса китайской компанией DeepSeek своих ИИ-моделей, разработка которых обошлась ей гораздо дешевле, чем американские технологические гиганты потратили на свои модели. Благодаря новому финансированию OpenAI станет одной из самых дорогих частных компаний в мире, наряду с аэрокосмической компанией SpaceX и ByteDance, владеющей TikTok, отметили источники New York Times. Ранее на этой неделе SoftBank и OpenAI объявили о создании в Японии совместного предприятия SB OpenAI Japan для предоставления услуг искусственного интеллекта корпоративным клиентам в стране. При этом входящие в SoftBank компании будут ежегодно выплачивать OpenAI $3 млрд за использование её ИИ-технологий. Сооснователь OpenAI Джон Шульман не проработал в Anthropic и полугода

07.02.2025 [06:40],

Алексей Разин

Бурное развитие систем искусственного интеллекта происходило в последние пару лет при непосредственном участии американского стартапа OpenAI, создавшего нашумевший ChatGPT, но его кадровый состав успел изрядно измениться. В конкурирующую Anthropic менее полугода назад перешёл работать один из основателей первой из компаний Джон Шульман (John Schulman), но долго там не продержался.

Источник изображения: сайт Джона Шульмана В коллектив Anthropic один из главных разработчиков ChatGPT влился в августе прошлого года. Своё решение он тогда обосновал стремлением больше времени уделять регулированию работы искусственного интеллекта и сосредоточиться на технической части подобной деятельности. По его словам, работа в Anthropic позволяла ему развиваться в окружении единомышленников и заниматься теми вещами, которые ему были наиболее интересны. Непосредственно Шульман о своём уходе из Anthropic официально ничего не сообщил, как и не обозначил своих дальнейших намерений. Представители Anthropic в комментариях Bloomberg подтвердили уход Джона Шульмана из компании и выразили своё сожаление по этому поводу, хотя и поддержали стремление бывшего коллеги искать новые возможности для самореализации. Стремительно развивающийся рынок систем искусственного интеллекта даёт неплохие карьерные перспективы тем, кто уже успел себя зарекомендовать в качестве ценного специалиста или руководителя. Исследователи обучили конкурента OpenAI o1 менее чем за полчаса и $50

07.02.2025 [05:06],

Анжелла Марина

Исследователи из Стэнфорда и Университета Вашингтона создали ИИ-модель, которая превосходит OpenAI в решении математических задач. Модель, получившая название s1, была обучена на ограниченном наборе данных из 1000 вопросов методом дистилляции. Это позволило достичь высокой эффективности при минимальных ресурсах и доказать, что крупным компаниям, таким как OpenAI, Microsoft, Meta✴ и Google, возможно не придётся строить огромные дата-центры, заполняя их тысячами графических процессоров Nvidia.

Источник изображения: Growtika / Unsplash Метод дистилляции, который применили учёные, стал ключевым решением в эксперименте. Этот подход позволяет небольшим моделям обучаться на ответах, предоставленных более крупными ИИ-моделями. В данном случае, как пишет The Verge, s1 быстро улучшала свои способности, используя ответы, полученные от модели искусственного интеллекта Gemini 2.0 Flash Thinking Experimental, разработанной компанией Google. Модель s1 была создана на основе проекта Qwen2.5 от Alibaba (подразделение Cloud) с открытым исходным кодом. Первоначально исследователи использовали набор данных из 59 000 вопросов, но в ходе экспериментов пришли к выводу, что увеличение объёма данных не даёт значимых улучшений, и для финального обучения использовали лишь небольшой набор из 1000 вопросов. При этом было использовано всего 16 GPU Nvidia H100 в облаке, за использование которых пришлось заплатить менее $50. В s1 была также применена техника под названием «масштабирование времени тестирования», которая позволяет модели «поразмышлять» перед генерацией ответа. Также исследователи стимулировали модель к перепроверке своих выводов путём добавления команды в виде слова «Wait» («Жди»), что заставляло ИИ продолжать рассуждение и исправлять ошибки в своих ответах. Утверждается, что модель s1 показала впечатляющие результаты и смогла превзойти OpenAI o1-preview на 27 % при решении математических задач. Недавно нашумевшая модель R1 от DeepSeek также использовала аналогичный подход и за сравнительно небольшие деньги. Правда, теперь OpenAI обвиняет DeepSeek в извлечении информации из своих моделей в нарушение условий обслуживания. Стоит сказать, что и в условиях использования Google Gemini указано, что её API запрещено применять для создания конкурирующих чат-ботов. Рост количества меньших и более дешёвых моделей может, по словам экспертов, перевернуть всю отрасль и доказать, что нет необходимости инвестировать миллиарды долларов на обучение ИИ, строить огромные центры обработки данных и закупать в большом количестве GPU. OpenAI открыла ИИ-поисковик для всех пользователей — не нужно даже регистрации

06.02.2025 [01:08],

Андрей Созинов

Компания OpenAI объявила, что её поисковая система на базе ИИ в составе ChatGPT больше не требует регистрации и авторизации. Эта функция позволяет ChatGPT выдавать ответы, основанные на информации из интернета, и представлять список источников, которые он использовал при составлении ответа.

Источник изображения: OpenAI OpenAI впервые запустила свою поисковую систему для платных подписчиков ChatGPT в октябре прошлого года, а в декабре она стала доступна всем пользователям. Но теперь, когда для его использования больше не нужна регистрация, поисковик в ChatGPT сможет напрямую конкурировать с традиционными поисковыми системами, как «Яндекс», Google и Bing. Два последних уже давно приступили к интеграции ИИ в свои поисковики. Недавнее обновление поиска ChatGPT сделало его более похожим на традиционную поисковую систему, позволяя просматривать краткие описания для каждого результата поисковой выдачи, а также карты и изображения местных достопримечательностей. Заметим, что OpenAI будет не первым разработчиком ИИ-систем, запустившим свой поисковик. Perplexity также позволяет искать информацию в интернете без учетной записи, а недавно эта система научилась выдавать информацию об отелях и их рейтинги непосредственно с TripAdvisor. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |