|

Опрос

|

реклама

Быстрый переход

Илон Маск пообещал, что в 2026 году xAI выпустит «отличную игру, сгенерированную ИИ»

07.10.2025 [17:42],

Дмитрий Рудь

Владелец X, гендиректор Tesla, руководитель SpaceX и глава Neuralink Илон Маск (Elon Musk), недавно ставший первым человеком с состоянием в $500 млрд, рассказал, когда собирается «сделать игры снова великими» с помощью ИИ. Напомним, прошлой осенью Маск пообещал «сделать игры снова великими», открыв игровую ИИ-студию на базе стартапа xAI. В феврале бизнесмен объявил о запуске такой студии, но никаких подробностей не предоставил. Теперь Маск заверил, что игровая студия xAI до конца 2026 года выпустит «отличную игру, сгенерированную ИИ». Заявление стало ответом на утверждение пользователя, будто видеоигры будущего будут динамически генерироваться чат-ботом Grok. Спустя примерно час Маск выложил аналогичное сообщение, но уже в отношении кино: «Grok сделает как минимум смотрибельный фильм до конца следующего года, а действительно хорошие — в 2027-м». В настоящее время xAI ищет специалиста на должность «видеоигрового наставника». Работник будет обучать Grok «создавать увлекательные, весёлые и новаторские видеоигры, которые позволят пользователям изучать ИИ-дизайн». В конце 2024 года xAI представила генератор фотореалистичных изображений Aurora на базе Grok, а прошедшим летом запустила генератор видео Grok Imagine (сначала для подписчиков SuperGrok и Premium+, потом для всех остальных). Технологии в области искусственного интеллекта развиваются крайне быстро, но пока сложно представить, как до конца 2026 года Grok сможет выпустить не просто нормальную, но отличную видеоигру. Новая статья: ИИтоги сентября 2025 г.: вайб-райтингу — да; вайб-трейдингу — нет

07.10.2025 [10:52],

3DNews Team

Данные берутся из публикации ИИтоги сентября 2025 г.: вайб-райтингу — да; вайб-трейдингу — нет Windows скоро станет умнее — Microsoft видит будущее ОС в ИИ и NPU

07.10.2025 [00:27],

Владимир Фетисов

В течение последнего года Microsoft продвигает концепцию Copilot+ PC, определяя компьютеры этой категории, как устройства с процессорами, в составе которых есть блок NPU для обработки задач искусственного интеллекта. NPU способен выполнять десятки триллионов операций в секунду, и, по мнению Microsoft, именно нейронный сопроцессор прокладывает путь к более интеллектуальной версии Windows.

Источник изображения: neowin.net Microsoft подчеркнула, что архитектура NPU делает возможным выполнение задач искусственного интеллекта с гораздо большей скоростью, чем при использовании CPU или GPU, при этом энергопотребление ниже. Это позволит компании предлагать «сложные» технологии на базе ИИ на устройствах стоимостью всего несколько сотен долларов, а не на специализированном дорогостоящем оборудовании. Поэтому Microsoft считает, что NPU сыграет ключевую роль, когда появятся более продвинутые ИИ-функции. Несмотря на то что NPU можно задействовать только для запуска небольшой ИИ-модели на локальном устройстве, он может взаимодействовать с облачными сервисами для обеспечения работоспособности более крупных моделей. Microsoft связывает разработку устройств Copilot+ PC с нейронным сопроцессором с опытом, полученным при создании интеллектуальной камеры Surface Hub 2, которая хорошо справлялась с выполнением ИИ-задач локально. Затем Microsoft поделилась своими наработками с партнёрами, такими как Qualcomm, AMD и Intel, которые впоследствии разработали процессоры с NPU. «Функции искусственного интеллекта, доступные в Windows, создают совершенно новые возможности, и мы разработали необходимые аппаратные решения для поддержки этих возможностей <…> Если задуматься, за последние 60 лет то, как мы используем компьютер, остаётся неизменным <…> ИИ-агенты — это действительно путеводная звезда. Теперь они стали новой единицей взаимодействия для людей и новой единицей программирования для разработчиков», — рассказал Стивен Батиче (Steven Bathiche), корпоративный вице-президент Microsoft и глава подразделения Applied Sciences, отвечающего за разработку ИИ-функций для Windows. Поскольку Windows обеспечивает работу ИИ-агентов через облачные сервисы и NPU, в будущем операционная система, вероятно, будет требовать от пользователей меньше кликов. Ярким примером такого подхода является специальный агент, доступный в разделе «Параметры». Однако Microsoft уже сейчас намекает на автоматизацию более сложных задач в будущем. ChatGPT научился запускать Spotify, Canva и множество других приложений прямо в чате

06.10.2025 [23:14],

Николай Хижняк

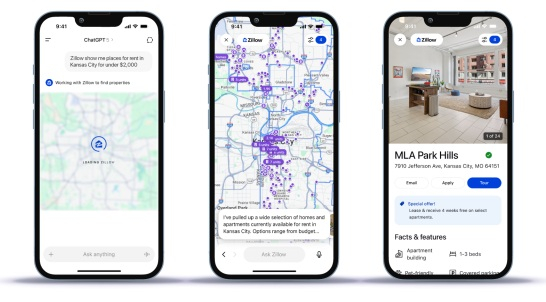

На ежегодном мероприятии DevDay 2025 компания OpenAI представила новый способ создания и взаимодействия со сторонними приложениями внутри ChatGPT. С понедельника пользователи чат-бота смогут получить доступ к приложениям таких компаний, как Booking.com, Expedia, Spotify, Figma, Coursera, Zillow и Canva. OpenAI также запускает предварительную версию Apps SDK — инструментария для разработчиков, предназначенного для создания и поддержки приложений внутри ChatGPT.

Источник изображения: Unsplash / Levart_Photographer «Мы хотим, чтобы ChatGPT стал отличным способом для людей добиваться прогресса, быть более продуктивными, более изобретательными, быстрее учиться и лучше делать всё, что они пытаются делать в своей жизни. [Приложения в ChatGPT] позволят создать новое поколение интерактивного, адаптивного и персонализированного программного обеспечения, с которым можно взаимодействовать», — заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Как пишет TechCrunch, новая система приложений в ChatGPT представляет собой очередную попытку OpenAI построить экосистему приложений вокруг своего флагманского продукта на основе искусственного интеллекта. В отличие от предыдущего решения — отдельного магазина приложений GPT Store, — новая система размещается непосредственно в ответах ChatGPT, что позволяет пользователям вызывать сторонние инструменты прямо в своих повседневных диалогах. Такой подход, по мнению OpenAI, позволит разработчикам эффективнее распространять создаваемые ими продукты, а также сделает ChatGPT более удобным для пользователей. Вводя названия различных приложений в строку запроса ChatGPT, пользователи могут получать контент из разных сервисов. Например, можно сказать: «Figma, преврати этот набросок в рабочую диаграмму», чтобы открыть приложение Figma. Пользователи также могут вызвать приложение Coursera, спросив: «Coursera, можешь научить меня чему-нибудь о машинном обучении?»

Риэлторский сервис Zellow внутри ChatGPT В демоверсии риэлторского приложения Zillow пользователи через ChatGPT на естественном языке просили подсказать, какие квартиры в их районе находятся в определённом ценовом диапазоне. Затем ChatGPT отобразил интерактивную карту с вариантами, и пользователи могли задавать дополнительные вопросы, чтобы узнать больше о каждом из предложений. ChatGPT также будет показывать пользователям, какие приложения могут быть полезны для решения той или иной задачи. Например, если кто-то запросит плейлист для вечеринки на выходные, ChatGPT может вызвать приложение Spotify. По словам OpenAI, в будущем в ChatGPT также появятся такие приложения, как DoorDash, Instacart, Uber и AllTrails. OpenAI заявляет, что новая система приложений построена на основе протокола контекста модели (MCP), который позволяет разработчикам подключать свои источники данных к системам искусственного интеллекта. Приложения ChatGPT также могут запускать действия и отображать полностью интерактивный пользовательский интерфейс в ответах чат-бота. Некоторые приложения смогут отображать видео в ChatGPT — оно будет закреплено в верхней части веб-страницы и может изменяться в зависимости от запросов пользователя. Если пользователи уже подписаны на тот или иной продукт, они смогут войти в свою учётную запись непосредственно через ChatGPT для доступа к дополнительным функциям. Альтман также отметил, что в будущем OpenAI будет поддерживать способы монетизации приложений внутри ChatGPT, в том числе с помощью недавно запущенной функции мгновенного заказа (Instant Checkout). Что касается безопасности, OpenAI заявляет, что разработчики должны «собирать только минимально необходимые данные и предоставлять прозрачные разрешения». Однако пока неясно, будут ли создатели приложений для ChatGPT иметь доступ ко всей переписке пользователя с чат-ботом, к нескольким последним сообщениям или только к последнему запросу, вызвавшему запуск того или иного приложения. Также остаётся вопрос, как ChatGPT будет выбирать сервисы среди конкурирующих компаний, таких как DoorDash и Instacart. Возможно, компании смогут платить за упоминание в ответах ChatGPT. OpenAI пока не даёт прямого ответа и заявляет, что намерена ставить в этом вопросе «пользовательский опыт превыше всего». ChatGPT достиг 800 млн пользователей в неделю — плюс 60 % всего за полгода

06.10.2025 [22:55],

Николай Хижняк

Генеральный директор OpenAI Сэм Альтман (Sam Altman) сообщил в понедельник, что число еженедельно активных пользователей ChatGPT достигло 800 млн, что свидетельствует о продолжающемся росте популярности ИИ-чат-бота среди потребителей, разработчиков и предприятий по всему миру.

Источник изображения: OpenAI Впечатляющий рост ChatGPT происходит на фоне стремления OpenAI получить как можно больше ИИ-чипов и построить как можно более мощную ИИ-инфраструктуру. В августе OpenAI заявила, что приближается к 700 млн еженедельно активных пользователей. К концу марта их количество составляло 500 млн. «Сегодня 4 млн разработчиков работают с OpenAI. Более 800 млн человек используют ChatGPT каждую неделю, и мы обрабатываем более 6 млрд токенов в минуту через API. Благодаря всем вам ИИ превратился из того, с чем люди просто играют, в то, что люди создают каждый день», — сказал Альтман. Альтман сделал заявление во время основного доклада на Дне разработчиков OpenAI, где также были представлены новые инструменты для создания приложений в ChatGPT и построения более сложных агентных систем. «Это позволит создать новое поколение интерактивных, адаптивных и персонализированных приложений, с которыми можно общаться», — отметил Альтман, представляя новые продукты. ChatGPT был запущен в ноябре 2022 года и практически сразу же продемонстрировал беспрецедентный рост числа пользователей, став ведущим потребительским продуктом на основе ИИ, а также одним из самых быстрорастущих онлайн-сервисов в истории. Недавно инструмент был расширен новой функцией ChatGPT Pulse, предоставляющей пользователям персонализированные утренние сводки. OpenAI, по-прежнему юридически зарегистрированная как некоммерческая организация, в четверг стала самой дорогой частной компанией в мире после частной продажи акций на сумму $6,6 млрд. Она оценивается в $500 млрд. Компания продолжает активно выпускать новые продукты. На прошлой неделе OpenAI представила новую версию инструмента для создания видео Sora вместе с сопутствующей социальной сетью. На той же неделе компания совместно с Stripe сообщила об интеграции онлайн-шоппинга в диалоговое окно ChatGPT. Акции AMD взлетели на 30 % после объявления о многомиллиардной сделке с OpenAI

06.10.2025 [18:50],

Сергей Сурабекянц

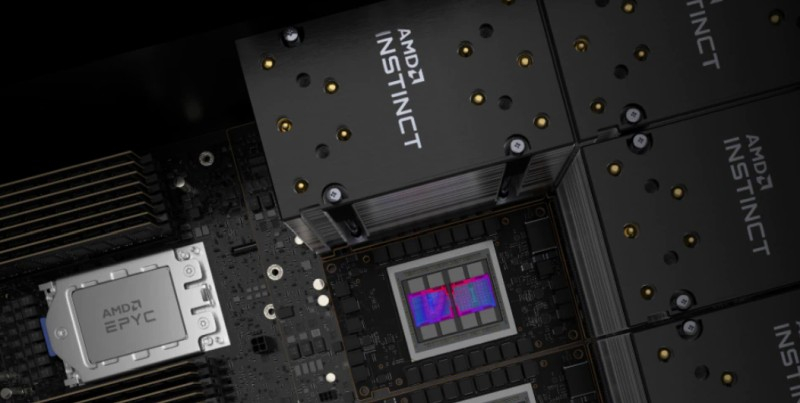

OpenAI и Advanced Micro Devices подписали соглашение, по которому компания Сэма Альтмана (Sam Altman) может приобрести 10 % акций производителя чипов. После опубликования этой новости акции AMD мгновенно подорожали более чем на 30 %. В настоящее время развитие OpenAI тормозится из-за недостатка вычислительных мощностей.

Источник изображений: AMD В рамках этого сотрудничества AMD выдала OpenAI право на покупку до 160 миллионов обыкновенных акций AMD с контрольными сроками, привязанными как к объёму развёртывания, так и к цене акций AMD. OpenAI сможет приобрести около 10 % акций AMD, исходя из текущего количества выпущенных акций. Представитель OpenAI сообщил, что сумма сделки исчисляется «миллиардами долларов», но конкретную сумму раскрывать отказался. В совместном пресс-релизе компании сообщили, что OpenAI в течение ближайших нескольких лет произведёт массированное развёртывание графических процессоров AMD Instinct нескольких поколений в дата-центрах OpenAI общей мощностью 6 ГВт. На первом этапе во второй половине 2026 года должны быть развёрнуты специализированные чипы AMD общей мощностью 1 ГВт, после чего OpenAI сможет купить часть выделенных акций. Последующие транши будут разблокированы по мере масштабирования систем OpenAI и достижения ключевых технических и коммерческих целей.  «Мы должны это сделать, — заявил президент OpenAI Грег Брокман (Greg Brockman). — Это ключевая часть нашей миссии, если мы действительно хотим масштабироваться и охватить всё человечество, именно это нам и нужно сделать». Он добавил, что компания уже испытывает затруднения с запуском многих функций ChatGPT и других продуктов, которые могли бы приносить доход, из-за нехватки вычислительных мощностей. ИИ нашёл себя в маркетинге: каждый четвёртый пресс-релиз написан нейросетью

05.10.2025 [16:09],

Владимир Фетисов

Похоже, что есть сфера, где искусственный интеллект нашёл применение — это работа в корпоративных пресс-службах. На это указывают данные исследования, которые были опубликованы в журнале Patterns. Авторы работы провели анализ письменных материалов, которые публиковались корпоративными и государственными структурами в период после появления ChatGPT. Оказалось, что ИИ, вероятно, регулярно использовался для генерации разных материалов — от пресс-релизов до объявлений о вакансиях.

Источник изображения: Shutterstock Исследователи изучили тысячи примеров текстов со всего интернета, включая такие популярные платформы для корпоративных новостей, как Newswire, PRWeb и PRNewswire. В результате было установлено, что с момента запуска ChatGPT в ноябре 2022 года примерно каждый четвёртый пресс-релиз был сгенерирован ИИ, причём в публикациях, связанных с наукой и технологиями, этот показатель даже выше. Ещё генеративные ИИ-алгоритмы часто использовались при написании объявлений о вакансиях. Исследователи установили, что созданный ИИ текст встречается примерно в 6-10 % объявлений о вакансиях на платформе LinkedIn. Примечательно, что чаще к помощи нейросетей прибегают небольшие компании (около 15 % от общего количества таких объявлений). Любопытно, что созданный ИИ текст встречается не только в материалах, публикуемых представителями корпоративного сегмента. Исследователи изучили пресс-релизы Организации Объединённых Наций за последние годы. Они установили с большой долей вероятности, что сотрудники ООН регулярно используют ИИ при написании пресс-релизов. Авторы работы подсчитали, что доля созданных с помощью ИИ текстов выросла с 3,1 % в первом квартале 2023 года до 10,1 % к третьему кварталу того же года. При этом к третьему кварталу 2024 года этот показатель достиг рекордных 13,7 %. Любопытно и то, что, по всей видимости, уровень использовании ИИ в данном сегменте достиг своего максимума и не продолжает расти. Для написания пресс-релизов пик использования ИИ был достигнут в декабре 2023 года, когда около 24,3 % попавших в исследование материалов с большой долей вероятности были созданы с использованием нейросетей. С тех пор уровень использования ИИ-алгоритмов снизился примерно на 0,5 % и практически не меняется. Что касается объявлений, то здесь прослеживается аналогичная динамика. Если же говорить об использовании ИИ в ООН, то там, похоже, рост сохраняется, но его темпы значительно замедлились. В потребительском сегменте внедрение генеративных технологий на базе ИИ проходит по похожему сценарию. Чтобы понять, как обычные люди используют ИИ, исследователи собрали и обработали более 687 тыс. жалоб, которые были поданы в Бюро финансовой защиты потребителей в период с 2022 года по 2024 год. Оказалось, что 18 % из них с большой долей вероятности были составлены с помощью ИИ. Любопытно и то, что люди, проживающие в регионах с более низким уровнем образования, немного чаще использовали ИИ-алгоритмы для написания жалоб, чем другие. Это несколько противоречит многим технологическим трендам, поскольку чаще всего новыми технологиями начинают пользоваться более молодые и образованные люди. Однако ИИ-инструменты, особенно бесплатные генераторы текста, вполне могут развиваться по другому сценарию. Авторы исследования планируют продолжить работу, чтобы более точно оценить уровень проникновения нейросетей в разные сферы деятельности человека. OpenAI столкнулась с проблемами при разработке собственного ИИ-устройства

05.10.2025 [13:47],

Владимир Фетисов

OpenAI и команда бывшего главного дизайнера Apple Джони Айва (Jony Ive) работают над устранением технических проблем, которые возникли в ходе разработки секретного устройства на базе искусственного интеллекта. Ожидается, что этот загадочный продукт представят широкой публике в следующем году.

Источник изображения: OpenAI OpenAI приобрела принадлежащий Айву стартап io за $6,5 млрд в мае этого года. С тех пор появлялось мало информации о реализуемых совместно проектах. Однако известно, что компании работают над компактным устройством размером с ладонь, которое лишено экрана, но способно распознавать звуковые и визуальные команды, а также реагировать на запросы пользователей. По словам осведомлённых источников, OpenAI и Айву ещё предстоит решить ряд критических проблем, которые могут повлиять на сроки запуска устройства. Несмотря на наличие аппаратной части, которую создала команда Айва, остаются проблемы с программным обеспечением и необходимой для его работы инфраструктурой. Речь в том числе идёт о выборе «личности» виртуального помощника, вопросах конфиденциальности данных и расчете затрат на вычислительные мощности для работы ИИ-алгоритмов OpenAI на выпускаемом серийно потребительском устройстве. «Вычислительные мощности — один из важных факторов задержки. У Amazon есть мощности для Alexa, как и у Google [для устройств Home], но OpenAI изо всех сил пытается получить достаточно вычислительных мощностей для ChatGPT, не говоря уже об ИИ-устройстве — сначала им нужно решить этот вопрос», — рассказал близкий к Айву источник на условиях анонимности. Близкий к OpenAI источник сообщил, что возникшие проблемы являются частью процесса разработки нового продукта. Другой осведомлённый источник заявил, что возникшие трудности являются нормальной частью процесса разработки продукта. Ранее СМИ писали, что OpenAI и команда Айва работают над устройством размером со смартфон, взаимодействие пользователя с которым будет осуществляться через камеру, микрофон и динамик. Один из источников сообщал, что устройство могут оснастить несколькими камерами. Согласно имеющимся данным, устройство предназначено для размещения на столе или другой рабочей поверхности, но при необходимости его можно будет носить с собой. По словам одного из источников, устройство будет непрерывно находиться в активном состоянии, а не активироваться по ключевому слову или команде. Встроенные в него датчики будут собирать данные в течение дня, что поможет со временем сформировать «память» виртуального помощника. Разработчики хотят улучшить умные колонки, которые обычно используются для выполнения ограниченного набора задач, например, прослушивания музыки или установки таймеров на кухне. Одна из проблем заключается в обеспечении того, чтобы устройство вмешивалось в разговоры пользователей только в уместных моментах и не мешало им, не понимая, когда следует завершить беседу. Это одна из проблем, которая присутствует в нынешней версии ChatGPT. «Идея в том, что у вас появится друг-компьютер, который не является вашей странной ИИ-подружкой <…> что-то вроде Siri, но лучше», — сообщил осведомлённый источник. Он также добавил, что OpenAI ищет способы сделать его доступным, но ненавязчивым. Другой источник отметил, что сбалансировать личность ИИ-модели весьма сложно. Алгоритм не должен быть подобострастным, слишком прямолинейным, он должен быть полезным, но не должен болтать слишком много. Несмотря на стремление разработчиков создать мощное и полезной устройство, формирование личности ИИ-помощника и определение манер общения с пользователем представляет собой сложную задачу. Устройству OpenAI предстоит выйти на сложный рынок. ИИ-компаньон Friend, который носят как кулон на шее, подвергся резкой критике за стиль общения. Устройство AI Pin от Humane, в разработку которого инвестировал глава OpenAI Сэм Альтман (Sam Altman), быстро сняли с производства. Несмотря на это компания наращивает штат сотрудников подразделения, занимающихся аппаратными продуктами. Приобретение io пополнило компанию более чем 20 бывшими сотрудниками Apple, которых ранее переманил Айв в свой стартап. По данным источника, в этом году OpenAI также наняла более 10 экспертов по устройствам Apple. Аналогичным образом переманивались специалисты из Meta✴ Platforms, работавшие над VR-гарнитурой Quest и умными очками компании. По данным источника, OpenAI также сотрудничает с китайскими контрактными производителям, такими как Luxshare, на пути создания своего первого аппаратного продукта. При этом не исключается, что сборка устройства будет организована за пределами Китая, что не удивительно на фоне сложных отношений между КНР и США. Netflix ищет директора по игровому ИИ — зарплата до $840 тыс. в год

05.10.2025 [11:18],

Владимир Фетисов

Сможет ли Netflix когда-нибудь разработать и выпустить высокобюджетную игру? Этот вопрос остаётся открытым, но, похоже, компания всё ещё полна решимости попытаться сделать это. В настоящее время Netflix ищет директора для команды Gen AI for Games в Лос-Анджелес и готова платить большие деньги тому, кто займёт эту должность.

Источник изображения: Mariia Shalabaieva / unsplash.com «Мы ищем дальновидного и прагматичного директора Gen AI, который будет руководить стратегией и применением генеративного искусственного интеллекта в нашем игровом подразделении. Эта должность находится на стыке технологий, продуктов и креативности — она определяет, как мы будем использовать передовые ИИ-технологии для создания значимых, новых и масштабируемых возможностей для геймеров», — говорится в описании вакансии. Ещё там сказано, что занявший упомянутую должность человек станет одним из «ключевых партнёров для наших игровых студий, технологических и платформенных команд, а также руководства». Среди задач упоминается формирование и масштабирование стратегии по использованию генеративного ИИ, от базовых возможностей до внутриигровых функций и совершенно новых форм игрового процесса. Потенциальные кандидаты должны иметь не менее 10 лет опыта работы в индустрии, всестороннее понимание полного цикла разработки игр — от концепции до поддержки готового продукта, а также соответствовать ряду других требований. Подходящему человеку Netflix наряду с полным социальным пакетом готова предложить зарплату в диапазоне от $430 тыс. до $840 тыс. в год. Открытая Netflix вакансия выглядит особенно любопытно на фоне более широкого контекста усилий компании по выходу на рынок гейминга. В 2021 году Netflix назначила бывшего главу EA и Facebook✴ Майка Верду (Mike Verdu) вице-президентом по разработке игр. В 2022 году компания объявила о запуске своей первой игровой студии. Однако спустя всего два года студия была закрыта, даже не успев анонсировать ни одного проекта. Вскоре после этого Верду перешёл на должность директора Gen AI for Game, но уже через четыре месяца покинул компанию. Теперь Netflix ищет ему замену, чтобы ещё раз попытаться создать большую игру, опираясь на ИИ-технологии. Отметим также, что в начале года Netflix закрыла принадлежащую ей студию Night School, которая разработала игру Oxenfree. «Тектонический сдвиг»: у Microsoft появится второй гендир — текущий сосредоточится на технических вопросах

01.10.2025 [19:59],

Сергей Сурабекянц

Исполнительный вице-президент и главный коммерческий директор Microsoft Джадсон Альтофф (Judson Althoff) займёт новую должность генерального директора коммерческого направления. Это очередное кадровое изменение стало результатом того, что генеральный директор Сатья Наделла (Satya Nadella) называет «тектоническим сдвигом платформы ИИ». Этот шаг также позволит Наделле больше внимания уделять техническим вопросам, сохранив пост генерального директора Microsoft.  Сегодня в служебной записке для сотрудников Наделла объявил о повышении Альтоффа, объяснив этот шаг необходимостью перестроиться в эпоху ИИ и «объединить продажи, маркетинг, операционную деятельность и разработку для стимулирования роста и укрепления наших позиций как предпочтительного партнёра для трансформации в сфере ИИ». Альтофф возглавлял отдел глобальных продаж Microsoft последние девять лет, помогая компании развивать подразделение Microsoft Customer and Partner Solutions (MCAPS). Теперь он также будет отвечать за операционные и маркетинговые команды, которые помогают продавать корпоративным клиентам программное обеспечение и услуги Microsoft.

Джадсон Альтофф / Источник изображения: Microsoft «Внедряя операционные функции в коммерческий бизнес, мы можем усилить обратную связь между потребностями клиентов и тем, как мы их предоставляем и поддерживаем, — уверен Наделла. — Кроме того, Джадсон возглавит новую команду коммерческого руководства, которая объединит руководителей отделов разработки, продаж, маркетинга, операционной деятельности и финансов». В результате этой кадровой перестановки Альтофф выглядит практически прямым заместителем Наделлы, особенно учитывая, что теперь он отвечает за основной источник дохода Microsoft от важнейших корпоративных клиентов. Аналитики считают, что это скорее похоже на попытку Наделлы сосредоточиться на технической работе Microsoft, а не на признак его планов уйти в отставку в ближайшее время. «Это также позволит нашим руководителям инженерных подразделений и мне полностью сосредоточиться на наших самых амбициозных технических задачах — в области построения центров обработки данных, системной архитектуры, науки об искусственном интеллекте и продуктовых инноваций — чтобы эффективно и динамично лидировать в этой смене поколений платформы, — считает Наделла. — Это не просто эволюция, это переосмысление — для каждого из нас в профессиональном плане и для Microsoft».

Сатья Наделла / Источник изображения: Microsoft Microsoft всё чаще «присваивает звания» генеральных директоров руководителям некоторых из своих крупнейших подразделений, например, главе Microsoft Gaming Филу Спенсеру (Phil Spencer) или руководителю Microsoft AI Мустафе Сулейману (Mustafa Suleyman). Компания также использовала должности генерального директора для руководителей поглощённых GitHub и LinkedIn, хотя должность генерального директора GitHub исчезла после отставки Томаса Домке (Thomas Dohmke) этим летом. OpenAI объединится с Samsung и SK hynix, чтобы удовлетворить потребность в памяти для ИИ-мегапроекта Stargate

01.10.2025 [18:08],

Сергей Сурабекянц

Компания OpenAI сообщила, что заключила «стратегическое партнёрство» с южнокорейскими Samsung и SK hynix ради поставки передовых компьютерных чипов, необходимых для реализация масштабного проекта Stargate. OpenAI планирует ежемесячно получать от обеих компаний в сумме 900 000 полупроводниковых пластин с микросхемами памяти. Источник изображения: Samsung Samsung и SK hynix заявили, что будут масштабировать своё производство, чтобы удовлетворить растущий спрос OpenAI на чипы памяти, необходимые для работы требовательных к вычислительным ресурсам моделей искусственного интеллекта. OpenAI также ведёт переговоры с обеими компаниями об открытии двух центров обработки данных для ИИ в Южной Корее. Это партнёрство является последним в серии стратегических шагов OpenAI, направленных на обеспечение вычислительных мощностей, электроэнергии и финансирования для своих проектов в области ИИ. В прошлом месяце компания Nvidia заявила, что инвестирует до $100 млрд в компанию по мере её масштабирования. Samsung сообщила, что рассматривает возможность создания плавучих центров обработки данных, которые, по её словам, позволят сократить расходы и снизить выбросы углерода. Жители США столкнулись с резким ростом счетов за электричество из-за прожорливого ИИ

30.09.2025 [23:58],

Анжелла Марина

Стремительный рост числа центров обработки данных для искусственного интеллекта привёл к резкому скачку оптовых цен на электроэнергию в некоторых регионах США, вынуждая местных жителей сокращать расходы на самое необходимое. Согласно анализу Bloomberg, проведённому на основе данных энергетической аналитической платформы Grid Status, в зонах расположения новых дата-центров цены за пять лет взлетели на 267 %.

Источник изображения: AI Например, 57-летний Кевин Стэнли (Kevin Stanley), живущий на пособие по инвалидности, столкнулся с ростом счетов за электричество на 80 % за три года. Мария Руффин (Mary Ruffine) из Арлингтона сообщила о единовременном скачке счетов более чем на 25 %. Их бюджеты, как и бюджеты их соседей, ведущих частные домохозяйства и проживающих вблизи новых центров обработки данных, находятся на грани своих возможностей, пишет Tom's Hardware. При этом эксперты предупреждают, что ИИ-бум только набирает обороты: большинство крупных проектов дата-центров, анонсированных в этом году, ещё даже не начали строиться. По прогнозам, к 2035 году на их долю придётся почти 10 % общего энергопотребления США. Стоит также принять во внимание недавний анонс OpenAI относительно концепции будущего с 10 миллиардами графических процессоров, где каждый человек на планете сможет иметь персональный GPU для работы с ИИ. Одним из решений проблемы является строительство электростанций непосредственно на месте объекта. Именно так был запущен дата-центр Colossus компании xAI, где были установлены десятки газовых турбин для поддержания бесперебойного электроснабжения. Такой подход поможет предотвратить рост цен на электроэнергию в регионах, а в случае избытка энергии, производимого для ЦОД, даже снизить расходы. Однако даже в этом идеальном сценарии возникают вопросы о воздействии на окружающую среду, поскольку энергопотребление этих объектов в ближайшее время, очевидно, не уменьшится, а стоящие за ними крупные технологические компании, несмотря на сохраняющиеся опасения по поводу финансирования, демонстрируют слишком большую заинтересованность в ускорении их строительства. ИИ-пузырь покорил новую веху: капитализация Nvidia превысила $4,5 трлн

30.09.2025 [22:26],

Николай Хижняк

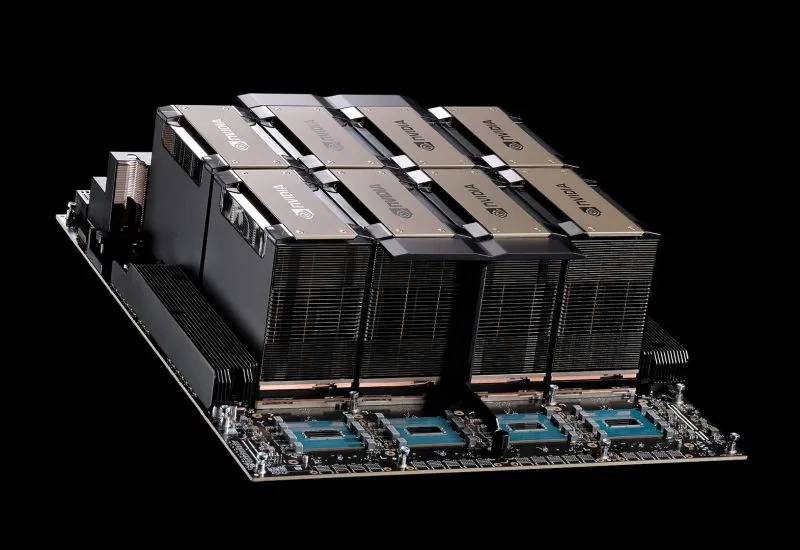

Акции Nvidia во вторник достигли нового рекорда, поднявшись почти на 3 %, что увеличило рыночную капитализацию производителя чипов до невероятных $4,5 триллиона. За год акции Nvidia выросли примерно на 49 % и продолжают привлекать инвесторов, поскольку компания наращивает темпы заключения сделок, укрепляя свои позиции в центре бума искусственного интеллекта, сообщает CNBC.

Источник изображения: Nvidia На прошлой неделе OpenAI заявила, что Nvidia приобретёт долю в стартапе в сфере ИИ на сумму до $100 млрд и построит центры обработки данных стоимостью в сотни миллиардов долларов, которые будут оснащаться графическими ускорителями Nvidia. Затем OpenAI объявила о строительстве пяти новых крупных центров обработки данных совместно с Oracle в рамках ИИ-мегапроекта Stargate. По словам компаний реализация плана обойдётся в $500 млрд. Генеральный директор Nvidia Дженсен Хуанг (Jensen Huang) заявил, что на продукцию Nvidia приходится около 70 % расходов на новые центры обработки данных для ИИ. Аналитики Citi во вторник повысили целевую стоимость акций Nvidia с $200 до $210, ссылаясь на прогноз роста расходов на инфраструктуру ИИ после анонсов OpenAI. «Мы считаем, что OpenAI обратилась к Nvidia за помощью, поскольку у Nvidia есть очень привлекательный продукт, а число пользователей и объёмы потребляемых вычислительных мощностей на одного пользователя растут», — цитирует CNBC аналитика Citi Атифа Малика (Atif Malik). Meta✴, Google и другие компании также значительно увеличивают свои расходы на инфраструктуру. CoreWeave, поставщик облачных услуг, крупным акционером которого является Nvidia, сообщил во вторник о достижении соглашения о поставке Meta✴ услуг по инфраструктуре ИИ на сумму $14,2 млрд. Акции Nvidia в этом году опережают по темпам роста всех конкурентов, за исключением производителя микросхем Broadcom, бумаги которого выросли примерно на 40 %, чему также способствовал OpenAI. Китайский ответ Nvidia и Qualcomm: Orange Pi выпустила мини-ПК AI Studio на процессоре Huawei Ascend 310 AI

30.09.2025 [21:59],

Николай Хижняк

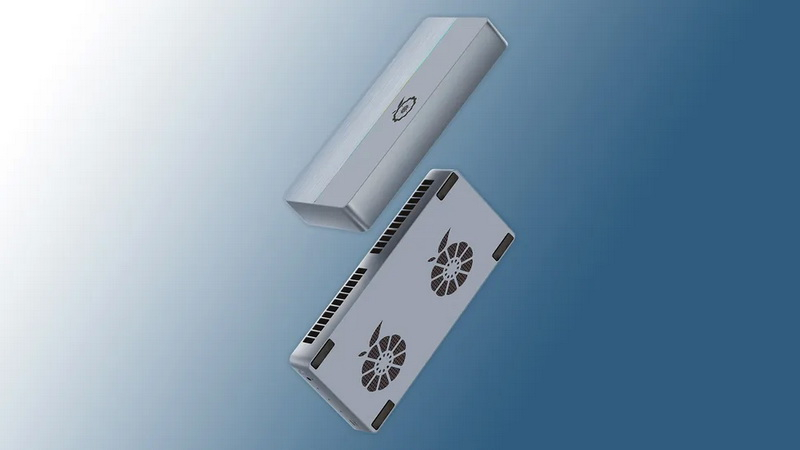

Компания Orange Pi представила мощный мини-ПК, созданный для тех, кто интересуется разработкой и применением искусственного интеллекта. В его основе лежит 64-битный восьмиядерный процессор Huawei Ascend 310 AI на архитектуре Arm, который, как заявлено, обеспечивает производительность до 176 TOPS в задачах ИИ. Это более чем вдвое превышает возможности недавно анонсированного Qualcomm Snapdragon X2 Elite, хотя последний предназначен для ноутбуков.

Источник изображений: Orange Pi Производитель представил две версии Orange Pi AI Studio: базовая модель оснащена вышеупомянутой SoC и предлагает 48 или 96 Гбайт оперативной памяти LPDDR4X-4266 и 32 Мбайт SPI Flash; Pro-версия объединяет два мини-ПК AI Studio в один. Благодаря этому владелец получает два восьмиядерных процессора, обеспечивающих вдвое большую производительность — 352 TOPS. Кроме того, Pro-версия предлагает 96 или 192 Гбайт оперативной памяти. Модель Pro также оснащена двумя вентиляторами для охлаждения, а не одним, как у обычной версии. Пожалуй, самым большим недостатком Orange Pi AI Studio является ограниченный набор интерфейсов: мини-ПК оснащён кнопкой питания, светодиодным индикатором, разъёмом питания и всего одним портом USB 4.0 Type-C. Наличие одного порта USB означает, что все подключения, включая вывод изображения, хранилище и периферийные устройства, должны осуществляться через него, возможно посредством док-станции или концентратора. Также, судя по всему, система не поддерживает сетевые возможности. По крайней мере на странице продукта (на китайском) не упоминаются встроенные беспроводные модули Wi-Fi или Bluetooth. Orange Pi AI Studio поддерживает Ubuntu 22.04.5 и Linux 5.15.0.126, а в будущем для мини-ПК ожидается поддержка Windows. Также утверждается, что он подходит для локального развертывания модели дистилляции Deepseek-R, а также для решения базовых задач искусственного интеллекта в офисах, приложений Интернета вещей, интеллектуальных транспортных систем и многого другого. Мини-ПК Orange Pi AI Studio с искусственным интеллектом уже представлен на китайской торговой онлайн-площадке JD.com. Стоимость AI Studio составляет 6808 юаней ($955) за модель с 48 Гбайт оперативной памяти и 7854 юаня ($1100) за модель с 96 Гбайт ОЗУ. Что касается AI Studio Pro, он доступен за 13 606 юаней ($1909) с 96 Гбайт памяти и за 15 698 юаней ($2200) с 192 Гбайт ОЗУ. Также Orange Pi AI Studio Pro можно приобрести на AliExpress по цене более $2350 без учета доставки. Сделка по выходу с биржи обернулась для Electronic Arts долгом на $20 миллиардов — новые владельцы собираются сокращать расходы за счёт ИИ

30.09.2025 [12:11],

Дмитрий Рудь

Анонсированная накануне сделка на $55 млрд по переходу в частный статус обернётся для американского издателя и разработчика Electronic Arts многомиллиардным долгом и необходимостью быстро адаптироваться. Напомним, выкупать EA взялся консорциум инвесторов: инвестиционные компании Silver Lake и Affinity Partners, а также Суверенный фонд (PIF) Саудовской Аравии. Сделку планируют закрыть в первом квартале 2027 финансового года. В пресс-релизе упоминается, что $20 млрд из $55 млрд — заёмные средства (то есть долг), предоставленные банком JPMorgan Chase. Ожидается, что $18 млрд из этой суммы будут профинансированы к моменту закрытия сделки. Аналитик компании Circana Мэт Пискателла (Mat Piscatella) назвал долг Electronic Arts «шокирующе большим». По данным Financial Times, «справляться с большой долговой нагрузкой» новые владельцы компании собираются в том числе за счёт ИИ. Как передают источники Financial Times, новое руководство рассчитывает, что ИИ позволит «значительно сократить операционные расходы» Electronic Arts и увеличить прибыль компании в ближайшие годы. Что сделка означает для игр Electronic Arts, неясно. Более 70 % прибыли компании приносят сервисы вроде Madden NFL, EA Sports FC, Apex Legends и The Sims 4, в то время как Dragon Age: The Veilguard руководство разочаровала. В аналитической компании GlobalData отметили, что из-за растущих долгов EA становится всё менее новаторской, но сделка позволит устроить компании стратегическую перезагрузку и чаще идти на риск. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |